SkyReels V4 im Test: Echte Fähigkeiten, Benchmarks & ehrliche Einschränkungen

Ein ehrlicher Blick auf die tatsächliche Leistung von SkyReels V4, Benchmark-Ergebnisse und was das Paper verschweigt – bevor Sie entscheiden, ob es Ihre Zeit wert ist.

Es begann mit einer kleinen Schwierigkeit: Ich brauchte ein kurzes Video, bei dem die Musik nicht gegen die Bewegung ankämpft. Kein Kinotrailer, nur saubere 12–15 Sekunden, die sich kohärent anfühlen. Die Tools, die ich normalerweise benutze, bringen mich nah ans Ziel, aber ich muss immer noch das Timing nachkorrigieren und kleine Fehler in Premiere kaschieren. Also öffnete ich SkyReels V4.

Dieser SkyReels V4-Test ist kein Triumphzug. Es ist eine Feldnotiz aus ein paar fokussierten Tests, ein Blick auf das Veröffentlichte und darauf, wo es in der echten Arbeit landet. Mich interessieren die unspektakulären Dinge: Sync, Kontrolle, Wiederholbarkeit und die Kompromisse, die nach dem dritten Versuch auftauchen – nicht beim ersten Demo.

Was wir wissen (und woher wir es wissen)

Paper-Ergebnisse vs. realer Zugriffsstatus

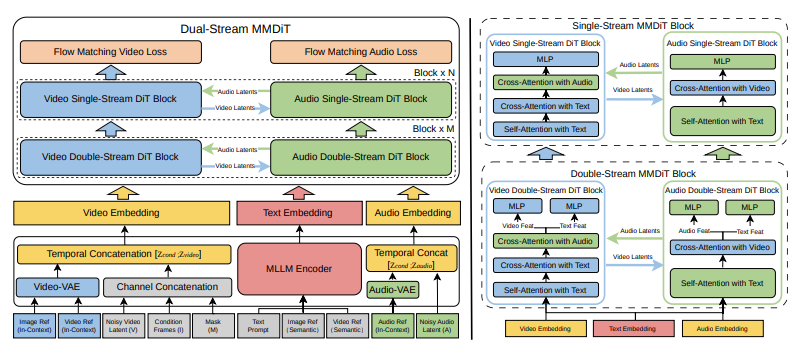

Ich habe das V4-technische Dokument gelesen. Auf dem Papier ist SkyReels V4 ein multimodales Generierungs- und Bearbeitungssystem: Text-zu-Video, Bild-zu-Video, Video-zu-Video, plus konditionierte Generierung mit Audio als Timing-Leitfaden. Wer mit dem Modell noch nicht vertraut ist, findet in dieser Übersicht über was SkyReels V4 ist eine detailliertere Beschreibung seiner Architektur, Positionierung und Kernfähigkeiten. Das Paper betont zeitliche Konsistenz, audiogesteuerte Bewegungshinweise und eine Bearbeitungsschnittstelle, die Änderungen anwendet, ohne eine vollständige Neugenerierung zu erfordern.

Das ist die Theorie. In der Praxis ist der Zugang noch eingeschränkt. Ich hatte kurzfristigen API-Zugriff über den Arbeitsbereich eines Kollegen (kleines Batch-Kontingent, mit Rate-Limiting). Ich führte über zwei Tage neun Prompts und eine Handvoll Bearbeitungen an drei dieser Clips durch. Ich verglich die Ergebnisse auch mit öffentlichen Demo-Reels (die immer den besten Fall darstellen) und Notizen von zwei anderen Nutzern, die Storyboard-Workflows testeten. Das ist also keine riesige Testsuite – eher ein sorgfältiges Küchenexperiment mit den üblichen Vorbehalten.

Benchmark-Leistung

SkyReels-VABench-Ergebnisse (2000+ Prompts, 5 Inhaltskategorien)

SkyReels veröffentlicht einen eigenen Benchmark, SkyReels-VABench, aufgebaut aus 2.000+ Prompts in fünf Kategorien: Anweisungsbefolgung, Bewegungsrealismus, Szenenkohärenz, Audio-Video-Ausrichtung und Bearbeitbarkeit. Laut ihrem Bericht führt V4 bei Audio-Video-Ausrichtung und Szenenkohärenz und zeigt Verbesserungen bei der Anweisungsbefolgung gegenüber V3.2. Die Unterschiede wirken bedeutsam, aber es ist immer noch ein interner Benchmark – ich lese ihn als richtungsweisend, nicht als endgültig.

In meinen Tests stimmte die Ausrichtungsbehauptung mit dem überein, was ich sah: Schlagzeugschläge landeten dort, wo sie sollten, und Schnitte lagen nah an den Beat-Markierungen, selbst ohne übermäßige Prompt-Optimierung. Die Anweisungsbefolgung war bei räumlichen Vorgaben besser als erwartet (“Kamera schwenkt links, während das Motiv sich zum Fenster dreht”), schwächer bei der Textlesbarkeit in Szenen (Ladenschilder waren in Ordnung; kleiner UI-Text auf einem Laptop-Bildschirm nicht).

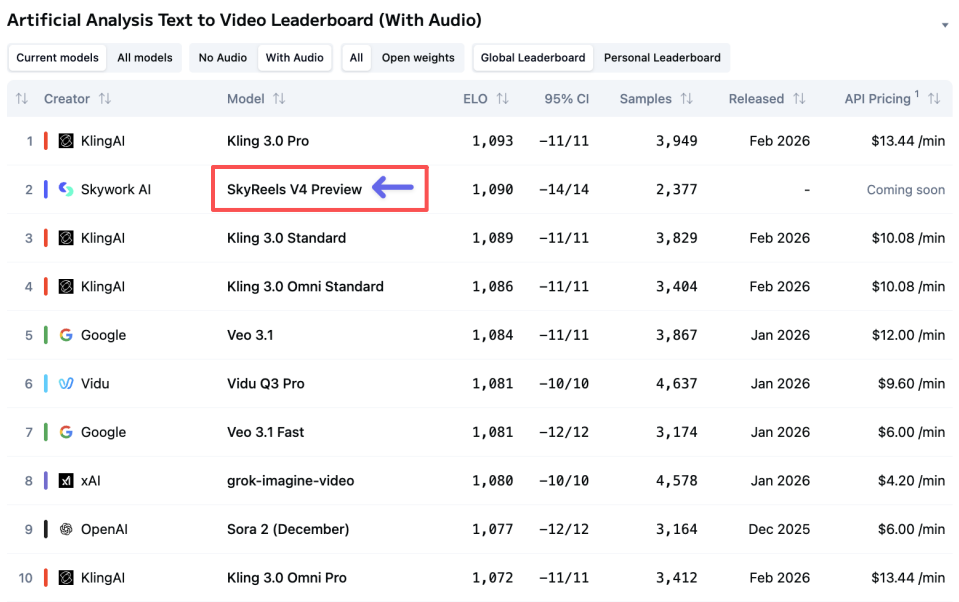

Artificial Analysis Leaderboard Rang #2 (Feb. 2026)

Stand Ende Februar 2026 listet das Community-Leaderboard bei Artificial Analysis SkyReels V4 auf Platz #2 gesamt für Text-zu-Video, mit besonders hohen Wertungen für zeitliche Konsistenz und Audio-Sync. Es ist ein zusammengesetzter Score aus paarweisen Vergleichen und einigen automatischen Metriken. Hilfreich zum Durchstöbern, aber ich nehme jedes Aggregat mit Vorsicht – Leaderboards komprimieren viel Nuance in eine einzige Zahl.

Was es für mich tat, war einfach: Es veranlasste mich, zunächst audiogesteuerte Prompts zu testen, da V4 dort besonders gut zu sein scheint. Das erwies sich als gute Entscheidung.

Was die Rankings tatsächlich messen

Leaderboards erfassen hauptsächlich Oberflächenqualität und Präferenz in kurzen Clips unter idealen Bedingungen. Sie messen nicht:

- wie viele Wiederholungen nötig sind, um dorthin zu gelangen,

- wie stabil sich das System über eine Woche Nutzung anfühlt,

- oder wie mühsam es ist, kleine Bearbeitungen vorzunehmen, ohne von vorne zu beginnen.

In dieser Lücke zählen meine kleinen Testrunden mehr als der Rang. V4 fühlt sich wie ein System an, das für Timing und Kontinuität gebaut wurde. Es ist (noch) nicht das Tool, das ich wählen würde, wenn ich 45 Sekunden Narration mit gestochen scharfem, lesbarem Text auf dem Bildschirm bräuchte.

Worin V4 besonders stark ist

Qualität der Audio-Video-Synchronisation

Hier verdient SkyReels V4 seinen Platz. Ich spielte einen 120-BPM-Track ein und bat um einen langsamen Dolly auf eine Keramiktasse, während Dampfkräusel auf dem Downbeat aufsteigen. Im ersten Durchgang landeten Bewegungsakzente innerhalb von ~40 ms des Rasters – visuell fühlte sich das eng an. Lip-Sync bei einer sprechenden Person war besser als ich es gewohnt bin: Konsonanten richteten sich aus, ohne den typischen gummiartigen, verzögerten Mundeffekt. Nach 12–13 Sekunden sah ich noch leichten Drift, aber ein kleiner Zeitstretch im Editor hat das problemlos behoben. Der wichtigere Punkt: Ich verbrachte weniger mentale Energie mit Mikro-Timing.

Eine kleine Sache, die ich schätzte: Als ich um Kamerawackeln nur auf Off-Beats bat, respektierte das Modell das die meiste Zeit. Nicht perfekt, aber die Absicht zeigte sich.

Umgang mit komplexen multimodalen Prompts

Ich probierte ein Storyboard-Bild + Textprompt + Audio-Leitfaden für einen schnellen Erklärungs-Beat aus: zwei Einstellungen, Schreibtischaufbau, natürliches Licht, eine Hand, die ein Notizbuch legt, während die Snare trifft. V4 handhabte die Beziehungen gut. Der Schreibtisch aus dem Storyboard setzte sich fort. Die Handbewegung synchronisierte sich ein oder zwei Frames auf die Snare. Ich musste nicht jede Vorgabe einzeln aufzählen. Diese Reduzierung der Prompt-Ausführlichkeit ist… entspannend.

Es folgte auch räumlichen Anweisungen besser als erwartet: Ich bat darum, dass das Motiv von rechts ins Bild tritt, während die Kamera nach links drückt. Die Parallaxe fühlte sich geerdet an, nicht schwebend. Als ich es mit einem abstrakteren Prompt herausforderte (“Stadtlichter pulsieren im Takt mit Hi-Hats, aber der Vordergrund bleibt ruhig”), behielt V4 die Vordergrundstabilität bei und behandelte das Bokeh als modulierte Ebene. Das ist die Art von Kontrolle, die ich mir wünsche.

Bearbeitung ohne Neutraining

Der Bearbeitungsablauf ist keine Magie, aber er ist praktisch. Ich konnte:

- die ersten 6 Sekunden sperren und nur den letzten Beat neu generieren,

- die Tasse maskieren und die Glasurfarbe ändern, ohne den Hintergrund neu zu bemalen,

- die Bewegungsintensität auf einer Skala anpassen, anstatt den Prompt umzuschreiben.

Das sind kleine Dinge, aber sie bewahren vor der typischen Neugenerierungsspirale. Ich stieß auf eine Schwierigkeit: Als ich einen neuen Fokuszieh mitten in der Einstellung anforderte, berührte die Neugenerierung mehr vom Bild als erwartet und weichte einige Texturen auf. Die Lösung war, die Einstellung zu teilen und Segmente zu bearbeiten. Nicht elegant, aber schnell genug.

Ehrliche Einschränkungen

Maximale Dauer von 15 Sekunden vs. Sora 2 / Veo

Zum Zeitpunkt meiner Tests begrenzte SkyReels V4 Generierungen auf 15 Sekunden. Das ist in Ordnung für Hooks, Bumper oder Motion-Logos. Es ist einschränkend für narrative oder erklärende Stücke. Sora 2-Vorschauen und Veo erlauben längere Aufnahmen – bis zu 60 Sekunden in den Versionen, die ich ausprobiert habe –, sodass V4 zum Zusammenfügen zwingt, wenn man eine einzelne, anhaltende Einstellung benötigt.

Das Zusammenfügen funktioniert, aber man zahlt eine Kohärenzsteuer: Farbverschiebungen über Schnitte, Hintergrunddrift, kleine Veränderungen im Motivdetail. Wer damit in der Nachbearbeitung umzugehen weiß, hat kein großes Problem. Wer fertige, saubere 45 Sekunden out-of-the-box möchte, wird diese Grenze wie eine Wand wahrnehmen.

Zugang und Reife der Bereitstellung

Der Zugang ist stark einladungsbasiert. Die Web-UI wirkt stabil; die API fühlt sich früh an. Ich erlebte Warteschlangen in Stoßzeiten und einen Timeout, der einen neuen Job erforderte. Die Dokumentation deckt das Wesentliche ab, aber erweiterte Steuerungsparameter hinken dem Paper hinterher. SDKs existieren; Type-Hints sind lückenhaft. Wasserzeichen sind standardmäßig aktiv (gut); Schalter dafür waren mir nicht zugänglich.

Aus Teamperspektive: Ich sehe noch keine klar definierten Enterprise-Schutzmaßnahmen (Überprüfungs-Workflows, Content-Policy-Hooks, Logging-Tiefe). Wer Features an Endnutzer ausliefert, dem ist das wichtig. Wer ein Einzelkünstler ist, wird wahrscheinlich gut damit auskommen, innerhalb der Web-UI zu arbeiten und zu exportieren.

Hardware-Anforderungen für Self-Hosting

Ich fand keine produktionsreife Self-Hosting-Option für V4. Wer On-Premises auf der Roadmap hat, sollte entsprechend planen. Selbst wenn die Gewichte irgendwann für lokale Nutzung lizenziert würden, benötigen Modelle dieser Größe typischerweise Multi-GPU-Setups (denken Sie an A100/H100-Klasse mit hohem VRAM), um mit angemessener Geschwindigkeit zu laufen. Für die meisten Teams bedeutet das vorerst Cloud-Inferenz oder verwaltetes Hosting.

Wer sollte SkyReels V4 nutzen?

Wer sich um Timing, Kontinuität und kleine, zuverlässige Bearbeitungen sorgt, sollte SkyReels V4 seine Aufmerksamkeit schenken. Es hat mich nicht mit Spektakel beeindruckt; es hat die Anzahl der Male reduziert, die ich von vorne anfangen musste. Das ist seine stille Stärke.

Wer es wahrscheinlich mögen wird:

- Kreative, die 6–15-Sekunden-Segmente mit musikalischer Struktur erstellen,

- Marketer, die konsistente Markenbewegung über Varianten hinweg brauchen, ohne jedes Rendering zu überwachen,

- Produktteams, die kurze Interaktionen oder Hero-Loops prototypisieren, bei denen Audio-Sync wichtig ist.

Wer es möglicherweise nicht mag:

- Personen, die 30–60-Sekunden-Narrative in einem Stück benötigen,

- alle, die auf gestochen scharfen, lesbaren UI-Text in Szenen angewiesen sind,

- Teams, die heute ausgereifte Bereitstellungskontrollen benötigen (Audit-Trails, feingranulare Rollen, strenge SLAs).

Warum mir das wichtig ist: Tools, die Bearbeitungen respektieren und den Rhythmus halten, reduzieren Entscheidungsermüdung. Nach drei Durchläufen hatte ich einen Clip, der sich fertig genug anfühlte – kein zusätzliches Ringen. Ihr Ergebnis kann natürlich variieren. Wer Audio von Hand mit Video synchronisiert und die kleinen Fehler satt hat, sollte einen Blick riskieren.

Eine letzte, kleine Beobachtung: Der beste Clip, den ich bekam, war nicht der aufsehenerregendste. Es war die Tasse, der Dampf und der Downbeat, der sauber landete. Nichts zum Vorführen. Alles an seinem Platz.