SkyReels V4 Funktionen erklärt: Video- und Audiogenerierung, Inpainting & Bearbeitung

Ein verständlicher Leitfaden zu allen wichtigen SkyReels V4 Funktionen – von der gemeinsamen Audio-Video-Generierung bis hin zu Inpainting und Bearbeitung – und was jede davon für echte Creator bedeutet.

Haben Sie schon einmal das gleiche Problem wie ich erlebt?

Ich bin Dora. Damals erstellte ich ein kurzes Erklärungsvideo und stieß auf ein häufiges Problem: Der Voiceover und die Visuals gerieten während des Bearbeitungsprozesses immer aus dem Takt. Die Situation war nicht gravierend, es fühlte sich nur etwas holprig an. Ich sehe oft, wie Leute „synchronisiertes Audio” und neue Bearbeitungsworkflows erwähnen, daher habe ich letzte Woche (Ende Februar bis Anfang März 2026) SkyReels V4 sorgfältig ausprobiert.

Der folgende Inhalt ist keine Rezension, sondern mein persönlicher Erfahrungsbericht über die Funktionen von SkyReels V4, die meine tägliche Arbeit tatsächlich verändert haben. Wenn Sie ebenfalls von diesen Problemen geplagt werden, lesen Sie weiter!

Funktion 1 — Gemeinsame Video- und Audiogenerierung

Was „synchronisiertes Audio” in der Praxis bedeutet

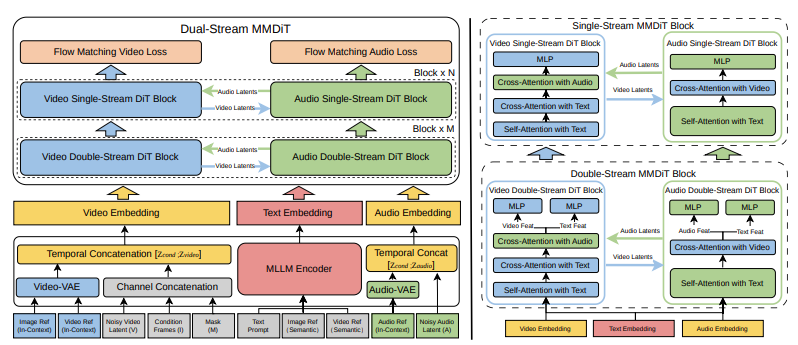

Ich dachte, das wäre ein Modewort. War es nicht. SkyReels V4 verwendet eine Dual-Stream Multimodal Diffusion Transformer (MMDiT)-Architektur, bei der ein Zweig Video synthetisiert und der andere zeitlich ausgerichtetes Audio generiert, während beide einen leistungsstarken Textencoder auf Basis von Multimodal Large Language Models (MMLM) teilen. Wenn SkyReels Video und Audio gemeinsam generiert, wirkt das Timing eingebaut – nicht nachträglich aufgeklebt. In einem 20-sekündigen Demo-Reel traf die Handbewegung auf dem Bildschirm die kleinen perkussiven Beats, ohne dass ich Keyframes anpassen musste. Es war keine perfekte Lippensynchronisation (erwarten Sie keinen synchronisierten Film), aber es reduzierte die Mikro-Edits, die ich normalerweise vornehme, um Asynchronität zu verbergen.

Die eigentliche Veränderung: weniger Sprünge in der Timeline. Normalerweise wechsle ich zwischen einer DAW und einem Videoeditor hin und her, um Millisekunden zu korrigieren. Mit der gemeinsamen Generierung machte ich nur eine Runde Schnitte. Das hat beim ersten Durchlauf keine Zeit gespart – das Erlernen der Prompts dauerte etwas –, aber beim dritten Clip bemerkte ich, dass meine mentale Belastung sank. Weniger Grübeln über „ist das Audio hier leicht zu früh?” und mehr Aufmerksamkeit auf Rhythmus und Texteinblendungen.

Audio-Referenzeingabe – so funktioniert es

Eine Audio-Referenz einzuspeisen fühlte sich an, als würde man dem Modell gleichzeitig ein Metronom und ein Stimmungsbild geben. Ich verwendete einen sanften Lo-Fi-Track als Leitfaden und bat um gedämpfte Stadtaufnahmen mit langsamen Schwenks. Das Ergebnis respektierte das Tempo – Schnitte lagen nahe an den Downbeats, und die Atmosphäre spiegelte die Referenz wider, ohne sie zu kopieren. Gut: Es bewahrte die Energiekurve. Einschränkung: Wenn die Referenz einen lebhaften Mittelteil hatte, wurden die Visuals dort manchmal zu schnell geschnitten. Ich lernte, einfachere Referenzen zu wählen oder den Abschnitt zu markieren, auf den es mir ankam.

In der Praxis würde ich Audio-Referenzen verwenden, wenn ich frühzeitig einen Soundtrack festgelegt habe (Kunden-Markentrack, Podcast-Intro) und Visuals möchte, die damit im Dialog stehen. Wenn Sie die Musik lieber zuletzt auswählen, ist diese Funktion weniger relevant.

Funktion 2 — Multimodale Eingabeunterstützung

Text-zu-Video

Text-Prompts dienten als schnelle Skizze. Ich schrieb: „Vogelperspektive auf Schreibtisch, umblätternde Notizbuchseiten, warmes Morgenlicht.” Der erste Durchgang hatte eine anständige Komposition, aber generische Requisiten. Nach ein paar Anpassungen – Erwähnung von Papiermaserung und einem Gefühl langer Belichtungszeiten – verbesserte sich die Bewegung und die Lichter beruhigten sich. Es ist kein Requisitenstylisten-Tool: Es ist ein Stimmungssetzer. Ich behandle es wie Thumbnails: gut für die Richtung, nicht für Details.

Bild-zu-Video

SkyReels V4 akzeptiert reichhaltige multimodale Anweisungen, einschließlich Text, Bilder, Videoclips, Masken und Audio-Referenzen, was eine feingranulare visuelle Führung unter komplexen Bedingungen ermöglicht. Bild-zu-Video war der Bereich, in dem SkyReels V4 mich überraschte. Ich lud ein Standbild meines echten Schreibtisches hoch. Das Modell erweiterte es zu einigen Sekunden eines glaubwürdigen Kameraschwenkens, mit Schatten, die meinem Lampenwinkel entsprachen. Beim ersten Durchgang bemerkte ich leichte Verzerrungen um einen Kaffeebecher herum. Eine erneute Ausführung mit „Objektsteifigkeit erhalten” half. Wenn Sie versuchen, Produktbilder oder Social-Media-Beiträge zu animieren, ohne eine 3D-Szene neu aufzubauen, trifft dies genau den richtigen Punkt.

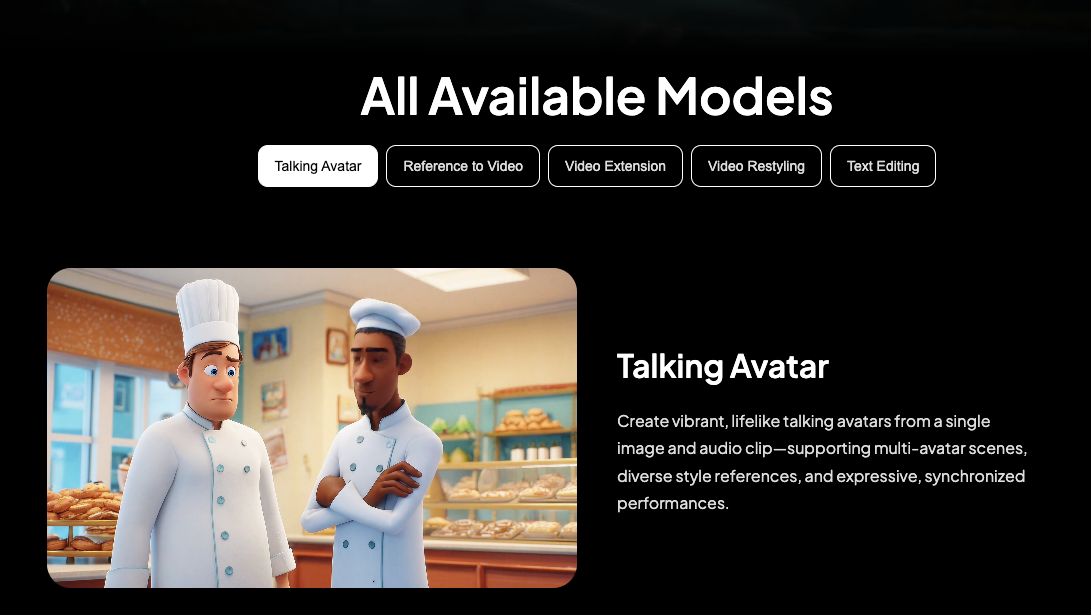

Video-zu-Video (Erweiterung & Bearbeitung)

Video-zu-Video fühlte sich wie eine Zeitersparnis für die Kontinuität an. Ich verlängerte einen 7-sekündigen Clip auf 12 Sekunden und behielt dabei die gleiche Tonstimmung bei. Bearbeitungen wie das Stabilisieren eines wackligen Schwenks oder das Abschwächen harter Lichter funktionierten gut mit kurzen, klaren Anweisungen. Als ich zu viele Dinge auf einmal verlangte – neue Bewegung, andere Tageszeit und Farbkorrektur –, schwankte das Ergebnis. Meine Notiz an mich selbst: Eine Absicht pro Durchgang. Denken Sie „verlängern”, dann „graden”, dann „bereinigen” – in dieser Reihenfolge.

Funktion 3 — Einheitliche Inpainting- und Bearbeitungsschnittstelle

Was Kanal-Konkatenation für Kreative bedeutet (nicht-technisch)

Auf der Videoseite verwendet SkyReels V4 eine Kanal-Konkatenations-Formulierung, die eine breite Palette von Inpainting-ähnlichen Aufgaben – wie Bild-zu-Video, Videoerweiterung und Videobearbeitung – unter einer einzigen Oberfläche vereint und sich natürlich auf visions-referenziertes Inpainting und Bearbeitung via multimodaler Prompts ausdehnt. Im Hintergrund behandelt SkyReels die Bearbeitungseingaben – Masken, Text, Audio-Hinweise – als eine gemeinsame Konversation statt als isolierte Schritte. Für mich bedeutete das, dass ich ein störendes Kabel wegmalen, den Bewegungshinweis anpassen und denselben Prompt-Kontext beibehalten konnte, ohne Assets neu laden zu müssen. Weniger Kontextverlust, weniger Export-Reimport-Schleifen. Das klingt klein, aber das Überspringen von zwei oder drei Hin-und-Her-Transporten pro Clip summiert sich.

Visions-referenziertes Inpainting erklärt

Ich testete Inpainting an einem Produktfoto, bei dem eine Etikettenkante schief aussah. Ich malte eine schnelle Maske und richtete den Prompt auf „vorhandene Etikettentextur als Quelle verwenden”. Die Füllung respektierte Beleuchtung und Maserung besser als das Klonstempel-Gefühl, das ich manchmal bei anderen Tools bekomme. Bei feinerem Text wurden Mikrodetails gelegentlich weichgezeichnet – ein zweiter Durchgang mit „Typografie-Kanten erhalten” half. Ich würde mich nicht für forensische Korrekturen darauf verlassen, aber für die Bereinigung von Hintergründen und kleine Requisitenanpassungen mischte es sich schneller ein als mein manueller Workflow.

Funktion 4 — Kinematische Ausgabequalität

1080p / 32FPS / 15 Sekunden

Spezifikationen erzählen nicht die ganze Geschichte, aber sie sind wichtig. 1080p bei 32FPS für bis zu 15 Sekunden gaben mir genug Spielraum für kurze Erklärvideos und Teaser. Die Bewegung fühlte sich flüssig an, ohne den Seifenopern-Glanz. Ich testete eine dichte Stadtszene und sah bei schnellen seitlichen Bewegungen leichte zeitliche Unschärfe – das Hinzufügen von „langsamere Kamera” und etwas Bewegungsunschärfe verbesserte es. Wenn Sie längere Sequenzen benötigen, werden Sie weiterhin Aufnahmen zusammenfügen müssen.

Mehrfachaufnahmen-Fähigkeit

Mehrfachaufnahmen waren mein stilles Favorit. Ich erstellte ein Storyboard mit drei Beats – Establishing, Detail, Auflösung – und generierte sie als Geschwister mit gemeinsamen Stilhinweisen. Schnitte passten sauberer zusammen als wenn ich Szenen separat generiere. Es ist kein vollständiger Editor: Denken Sie an „kohärente Aufnahmengruppe”, nicht an eine Timeline. Für Social-Media-Sequenzen oder Landing-Page-Loops reichte das aus. Für Dokumentationen oder Werbung mit gesprochenen Texten würde ich dennoch zu einem traditionellen NLE für feinere Kontrolle wechseln.

Funktion 5 — Effizienz im Maßstab

Die Zwei-Phasen-Strategie mit niedriger Auflösung und Keyframes einfach erklärt

Die Engine scheint zuerst zu skizzieren und dann zu verfeinern. Sie entwirft einen Bewegungsplan mit niedriger Auflösung, schärft dann Keyframes und interpoliert. Ich bemerkte dies, als frühe Vorschauen rau aussahen, die finalen Ergebnisse sich aber gut bereinigten. Praktisch gesehen ermöglichte mir das, früher Entscheidungen zu treffen. Ich konnte eine Aufnahme in weniger als einer Minute ablehnen, wenn die Bewegung falsch wirkte, anstatt auf ein vollständiges Rendering zu warten. Bei einem morgendlichen Batch von sechs Variationen sparte mir das etwa 20–25 Minuten.

Welche Funktionen fehlen noch?

Einige Lücken fielen auf:

- Kontrolle für längere Inhalte. Die 15-Sekunden-Grenze drängt Sie zu modular denkendem Ansatz. Gut für Social Media, schwierig für Erzählungen.

- Granulare Audiobearbeitungen nach der Generierung. Gemeinsames Audio ist großartig, aber ich wollte trotzdem Lautstärkekurven pro Clip und Beat-genaue Anpassungen innerhalb des Tools.

- Versions-Nachverfolgbarkeit. Ich führte eigene Notizen, weil die Verknüpfung von Ausgaben mit Prompt-Änderungen nicht so klar ist, wie sie sein könnte.

- Harte Einschränkungen bei der Kontinuität. Beim Verlängern eines Clips möchte ich bestimmte Objekte oder Farben „sperren”, damit sie nicht abdriften können.

Warum das wichtig ist: SkyReels V4-Funktionen reduzierten meinen kognitiven Aufwand bei Kurzform-Inhalten. Wenn Sie bereits DAWs, Farbkorrektur und Bewegungstools jonglieren, konsolidiert dies das unübersichtliche Mittelstück. Wenn Sie pixelgenaue Markenkontrolle oder lange Skript-Inhalte benötigen, werden Sie es weiterhin mit einem leistungsstärkeren Editor kombinieren.

Das funktionierte für mein Tempo – Ihre Ergebnisse können variieren. Ich werde es wahrscheinlich weiterhin für 10–30-sekündige Erklärvideos und Produkt-Loops verwenden. Der kleine, stetige Gewinn für mich war Aufmerksamkeit: weniger Timeline-Akrobatik, etwas mehr Zeit für die Wahl dessen, was auf dem Bildschirm wirklich wichtig ist. Und das reicht, um mich hier zu halten – zumindest vorerst.

Also bin ich neugierig —

In Ihrem Bearbeitungsworkflow: Was kostet Sie mehr Energie – Audio und Visuals synchronisieren oder die kleinen Unstimmigkeiten danach ausbügeln?

Wenn Sie Tools ausprobiert haben, die „synchronisiertes Audio” versprechen – haben sie die Reibung wirklich reduziert – oder nur verlagert?

Ich teste noch, wo dies in meinen Stack passt. Was wäre der eine Engpass, den Sie in Ihrem Stack zuerst beseitigen würden?