MaxClaw im Test: Geprüft in echten Workflows (Ehrliches Urteil)

Wir haben MaxClaw in 5 echten Workflows getestet. Hier erfahren Sie, was wirklich funktioniert hat, was uns frustriert hat und ob sich das Abo im Jahr 2026 lohnt.

Hallo, Freund. Hier ist Dora. In letzter Zeit stolperte ich immer wieder über dieselbe kleine Reibung: einfache mehrstufige Routineaufgaben, die die Konzentration stahlen. Dinge wie „drei Links überfliegen, eine vernünftige Zusammenfassung erstellen und sie in einen Telegram-Chat schicken” oder „ein 40-seitiges PDF durchparsen, Risiken herausfiltern und eine kurze Notiz in meinen Docs ablegen.” Nichts davon ist schwierig. Es sind einfach die Aufgaben, die einen Tag schwerer fühlen lassen als nötig.

Also habe ich MaxClaw über zwei Arbeitswochen getestet. Ich wollte sehen, ob es diese Aufgaben erledigen kann, ohne dass ich es ständig beaufsichtigen muss. Ich bin nicht hier, um Features zu bewerten. Ich wollte spüren, ob es den Tag erleichtert. Das ist der Maßstab.

Wie wir MaxClaw getestet haben (Setup & Anwendungsfälle)

Ich habe MaxClaw auf macOS (M3 Air), Chrome und iOS verwendet. Mein Ausgangspunkt: Ich betreibe normalerweise kleine agentenähnliche Abläufe in Notion + Zapier + einem Claude-API-Wrapper bei Bedarf. Ich bin damit vertraut, Webhooks zu verdrahten, genieße es aber nicht, sie zu warten.

Meine Anwendungsfälle waren gewöhnlich:

- Recherche-Erfassung: 3–6 Quellen lesen, den „langweiligen aber wahren” Kern extrahieren und an einen Telegram-Kanal weiterleiten, den ich für wöchentliche Notizen nutze.

- Terminplanungs-Verbindung: Zwei Kalender abgleichen, Zeitfenster vorschlagen und eine Bestätigungsnachricht senden, sobald etwas feststeht.

- Dokumentendurchsicht: Lange PDFs scannen, Entscheidungen, Risiken und Aufgaben extrahieren, dann einen kurzen Bericht entwerfen.

Ich habe drei Dinge gemessen:

- Setup-Zeit: Minuten von der Anmeldung bis zum ersten nützlichen Durchlauf.

- Überwachungsaufwand: Anzahl der Korrekturen oder Umschreibungen pro Aufgabe.

- Drift oder Gedächtnis: Ob es Präferenzen nach einigen Tagen ohne Eingaben noch kannte.

Ich habe jeden Workflow 5–7 Mal durchgeführt, um zu sehen, ob Wiederholung die Reibung reduziert. Das ist mir wichtiger als eine glänzende „erste Demo.”

Onboarding & erster Eindruck

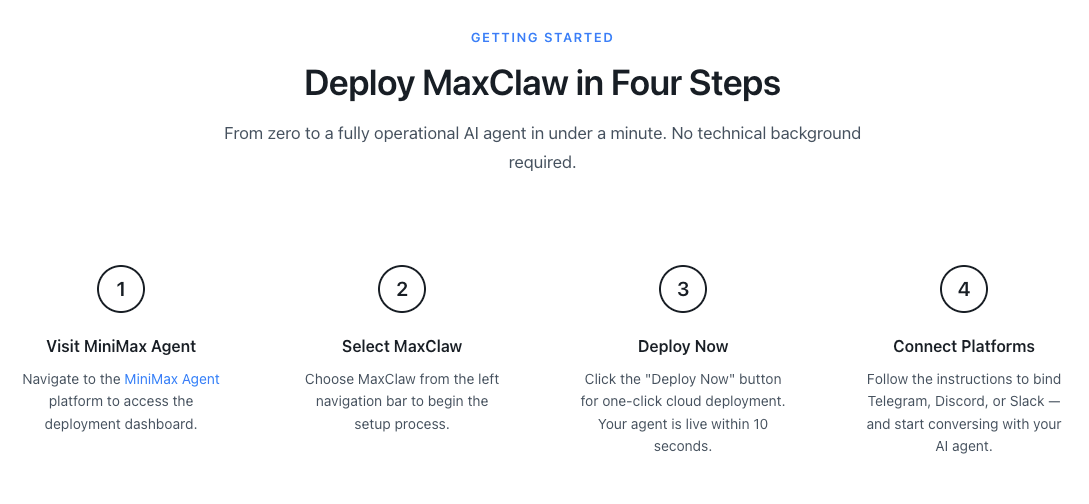

Zeit von der Anmeldung bis zur ersten funktionierenden Aufgabe

Die Anmeldung war unkompliziert. E-Mail, bestätigen, Plan auswählen. Ich habe es nicht mit der Stoppuhr gestoppt, aber ich hatte meine erste funktionierende Aufgabe in etwa 18 Minuten. Der langsamste Schritt war nicht MaxClaw – es war ich, der entschied, was ich zuerst automatisieren sollte. Ich begann mit einem kleinen Recherche→Zusammenfassung→Telegram-Nudge.

Was mich überraschte: Die Standard-Templates waren nicht aufdringlich. Kein blinkendes Konfetti, kein „10x your output…”-Vibe. Ich schätzte die Zurückhaltung.

Plattformintegrationserfahrung

Telegram erforderte etwas Feinarbeit. Ich erstellte einen Bot über BotFather, holte den Token und fügte ihn in MaxClaw ein. Ich musste die Chat-ID manuell festlegen. Nicht schwierig, aber es setzt voraus, dass man das schon einmal gemacht hat. Falls nicht, sind die Telegram Bot API-Docs klarer als die meisten Produkt-Tooltips.

Die Kalenderintegration verlief reibungsloser. Google wurde schnell authentifiziert und zeigte beschäftigte/verfügbare Blöcke beim ersten Versuch korrekt an. Es tauchten keine doppelten Kalender auf (kleine Erleichterung).

Für Dokumente lud ich ein 28-seitiges Strategie-Deck (PDF) und einen 43-seitigen Forschungsbericht (PDF) hoch. Das Parsen war schnell genug, dass ich nicht während des Wartens zu E-Mails abdriftete. Ich machte einen Testlauf mit einem öffentlichen Link: Er wurde problemlos abgerufen, aber ich blieb bei direkten Uploads, um Berechtigungsprobleme zu vermeiden.

Echte Workflow-Tests

Test 1: Recherche + Zusammenfassen + Senden via Telegram

Ich gab ihm 4 Quellen: einen Blogbeitrag, eine Pressemitteilung, eine technische Notiz und einen Forum-Thread. Meine Anweisung: „Gib mir eine unaufgeregte Zusammenfassung in 6–8 Stichpunkten, mit Quellen, und schick sie dann an meinen Telegram-Kanal.”

Durchlauf 1: Die Zusammenfassung war gut, aber in einem leicht atemlosem Ton geschrieben. Ich passte die Stilanweisung auf „schlicht, nicht werblich” an. Durchläufe 2–6 behielten den ruhigeren Ton. Kleiner Gewinn: Ab Durchlauf 3 begann es, Quelltitel statt roher URLs anzuhängen (nachdem ich es einmal korrigiert hatte). Links gingen in Telegram nicht kaputt, was manchmal passiert, wenn Tools zu stark formatieren.

Zeitersparnis? Der erste Durchlauf sparte keine Zeit – es dauerte etwa 10 Minuten, Ton und Quellenformatierung zu korrigieren. Bis Durchlauf 4 war es auf etwa 2 Minuten Überprüfung gesunken. Nicht dramatisch, aber der mentale Aufwand sank. Ich musste die Struktur nicht mehr im Kopf behalten.

Test 2: Mehrstufige Terminplanungsaufgabe

Ich bat es, drei 45-Minuten-Slots zwischen zwei Kalendern für die nächste Woche vorzuschlagen, Vormittage zu priorisieren und dann eine kurze Bestätigungsnachricht zu entwerfen, sobald jemand mit einer Wahl antwortete. Es handhabte Zeitzonen korrekt (ich bin UTC+1, die andere Person war ET). Es versuchte nicht, zu clever zu sein – kein „Was ist mit 6 Uhr morgens?”-Unsinn.

Die Bestätigungsnachricht war neutral und klar. Ich schätzte, dass sie nicht „Meeting akzeptiert” annahm, bevor ich auf Senden drückte. Ich musste den endgültigen Slot genehmigen. Ehrlich gesagt bevorzuge ich das. Wenn ein Agent einen Slot festlegt, den ich nicht bestätigen wollte, bin ich derjenige, der sich später entschuldigt.

Test 3: Dokumentenanalyse und Berichtserstellung

Das war mein eigentlicher Test. Ich bat es, einen 43-seitigen Bericht zu lesen und mir Folgendes zu liefern:

- Wichtige Entscheidungen in einfacher Sprache,

- drei Risiken mit Wahrscheinlichkeit und Auswirkung (niedrig/mittel/hoch),

- eine einseitige Zusammenfassung, die ich in meine Notizen einfügen konnte.

Durchlauf 1 war ordentlich, aber zu lang. Er lieferte zwei Seiten. Ich bat um maximal 350 Wörter, und bei späteren Durchläufen wurde das eingehalten. Die Risikobewertung war ruhig, nicht alarmistisch. Wenn das PDF Tabellen enthielt, fasste es diese zusammen, anstatt zu versuchen, sie neu aufzubauen – gute Entscheidung.

Ich überprüfte zwei Behauptungen, die wackelig wirkten. Sie waren tatsächlich korrekt: Der Bericht hatte sie in einem Anhang versteckt. Das gesagt, würde ich das nicht ohne eigene Durchsicht an einen Kunden weitergeben. Es ist ein Denkwerkzeug, kein endgültiger Verfasser.

Langzeitgedächtnis – Funktioniert es wirklich?

Kurze Antwort: Irgendwie, und das reicht.

Ich gab MaxClaw am ersten Tag einige feste Präferenzen:

- Ton: schlicht, nicht werblich

- Telegram-Zusammenfassungen: 6–8 Stichpunkte, Quellen mit Titeln

- Terminplanung: Soft Holds vermeiden, Vormittage meiner Zeit bevorzugen

Eine Woche später führte ich dieselben Aufgaben durch, ohne diese Regeln zu wiederholen. Es erinnerte sich an Ton und Zusammenfassungslänge. Es vergaß einmal die Quelltitel, erholte sich aber beim nächsten Durchlauf. Die Soft-Hold-Regel blieb stabil. Als ich „Vormittage bevorzugen” in „jederzeit 9–17 Uhr” änderte, berücksichtigte es diese Änderung sofort.

Kostenübersicht

Was das Abonnement abdeckt

Die Preise ändern sich, daher sollte man die Produktseite für die aktuellen Angaben prüfen. WaveSpeed’s MaxClaw-Analyse erklärt, dass vom Klick auf „MaxClaw erstellen” bis zu einem laufenden Agent-Gateway weniger als 20 Sekunden vergehen, wobei optionale Integrationen geführten Schritten folgen und minimale Konfiguration erfordern. Während meines Testzeitraums umfasste das Abonnement:

- Zugang zum Agenten mit integrierten Integrationen (Telegram, Kalender, Docs),

- ein monatliches Kontingent an Aufgaben-Durchläufen und Dokumentenverarbeitung,

- und gehostete Modellnutzung, sodass ich keine API-Schlüssel verwalten musste.

Für mich lag der Wert nicht in „unbegrenzt” irgendetwas. Es war das Fehlen von Glue-Code-Wartung. Ich musste keine Webhooks betreuen oder mich fragen, ob ein Secret abgelaufen war. Das allein ist etwas wert, wenn die eigene Zeit fragmentiert ist.

Im Vergleich zur Nutzung von OpenClaw mit der Claude API

Ich konnte keine stabilen, offiziellen Docs für „OpenClaw” finden. Wenn man an „DIY-Agent + Claude” denkt, hier ist meine übliche Rechnung mit der Claude API:

- Die Preise für Modelle (z.B. Claude 3.5 Sonnet) lagen bei niedrigen einstelligen Dollarbeträgen pro Million Input-Token und höher für Output. Stand heute listet Anthropic Pro-Million-Sätze auf – die genauen Zahlen findet man auf deren Seite.

- Ein typischer Recherche→Zusammenfassungs-Durchlauf kostet mich Cent, keine Dollar. Die aufwändigen (lange PDFs mit mehreren Durchgängen) summieren sich, überschreiten aber selten ein paar Dollar pro Tag.

- Versteckte Kosten: die eigene Zeit für das Verdrahten von Wiederholungsversuchen, Auth-Scopes, Fehlerbehandlung, Kalender und Telegram-Bot-Eigenheiten. Wenn man das genießt (manchmal tue ich das), gut. Wenn nicht, kann ein Abonnement, das einfach funktioniert, in der Praxis günstiger sein.

Was MaxClaw wirklich gut macht

- Kommt schnell von der Idee zum funktionierenden Ablauf. Ich musste nicht mit einer Builder-Oberfläche kämpfen oder einen Nachmittag mit „noch einem Schalter” verbringen.

- Handhabt Übergabemomente elegant. Entwirft eine Nachricht, wartet auf Genehmigung, macht dann weiter. Diese kleine Pause bewahrte mich vor Über-Automatisierung.

- Dokumentenverdauung ist zuverlässig. Es halluziniert keine Tabellen und erzwingt keine Struktur, wo keine vorhanden ist. Zusammenfassungen fühlten sich fundiert an.

- Gedächtnis für kleine Präferenzen ist gut genug. Stil und kleine Regeln blieben über eine Woche hinweg erhalten, ohne dass ich sie wiederholen musste.

- Telegram + Kalender-Integrationen waren stabil. Keine doppelten Beiträge, keine Zeitzonenpannen. Ich habe gelernt, das zu erwarten – hier habe ich es nicht gesehen.

Wo es noch schwächelt

- Ton beim ersten Durchlauf kann überschwänglich driften. Wenn man trocken und neutral möchte, muss man das explizit sagen.

- Das Gedächtnis ist von Design aus flach. Es ist gut für Stil und wiederkehrende Einstellungen, nicht für komplexen Projektkontext. Ich behalte wichtige Prompts noch immer in einer Notiz.

- Begrenzte Debug-Oberfläche. Wenn etwas schiefläuft (wie ein fehlender Quelltitel), sind die Logs knapp. Ich konnte es beheben, wollte aber ein klareres „Warum”.

- Quellenangaben brauchen Anstupser. Gelegentlich wurden Autoren aus Website-Namen abgeleitet. Leicht zu korrigieren, aber es lohnt sich, das im Auge zu behalten, wenn man Zusammenfassungen weit verbreitet.

Endurteil – Für wen lohnt sich MaxClaw?

Wenn die Tage voller kleiner, wiederholbarer Aufgaben sind – Zusammenfassungen, Anstupser, leichte Terminplanung – und man lieber keine Bots und Skripte warten möchte, ist MaxClaw einen Versuch wert. Es wird einen nicht verblüffen, und das ist der Punkt. Es erledigte die Arbeit, ohne nach Aufmerksamkeit zu verlangen.

Wer es mögen wird:

- Unabhängige Ersteller, die einen stillen Telegram- oder Slack-Feed mit Recherche-Notizen führen,

- Betreiber und PMs, die verlässliche Terminplanungs-Verbindungen ohne den Aufbau eines Mini-Systems wollen,

- Forscher, die kompakte Zusammenfassungen aus langen Dokumenten benötigen, mit genügend Kontrolle, um den Ton stabil zu halten.

Diese MaxClaw-Rezension läuft auf ein einfaches Gefühl hinaus: Nach dem ersten Tag verbrachte ich weniger Zeit damit, über das „Wie” nachzudenken, und mehr Zeit damit, die Ergebnisse zu lesen. Und diese kleine Erleichterung – weniger Tabs, weniger Mikro-Entscheidungen – war der eigentliche Gewinn. Ich bin weiterhin gespannt, wie es sich bei unordentlicheren, cross-tool-Projekten verhält. Ich werde das still im Auge behalten.