So richtest du G0DM0D3 mit OpenRouter ein: Schritt-für-Schritt-Anleitung (2026)

Schritt-für-Schritt-Anleitung zur Einrichtung von G0DM0D3 mit deinem OpenRouter-API-Schlüssel im Jahr 2026. Drei Bereitstellungsoptionen: lokal, statischer Host oder Docker-API-Server.

Hey, Leute. Ich bin Dora. Wisst ihr, ich habe gezählt, wie viele Browser-Tabs ich gleichzeitig offen hatte, während ich Model-Ausgaben verglichen habe? Sieben. Vier verschiedene Chat-Interfaces, zwei API-Playgrounds und eine Tabelle, die aufgezeichnet hat, welches Modell was gesagt hat. Das ist die Reibung, die G0DM0D3 eliminieren soll – eine einzige HTML-Datei, 50+ Modelle, die denselben Prompt parallel durchlaufen, automatisch bewertet und gerankt.

Dieser Beitrag dokumentiert wie man G0DM0D3 zum Laufen bringt, von null bis zur ersten Multi-Modell-Evaluierung. Vier Deployment-Pfade, jeder für eine andere Situation geeignet. Ich werde auch die Kostenrechnung erläutern, denn 55 Modelle gleichzeitig zu betreiben ist nicht kostenlos, und niemand sollte das erst von seiner OpenRouter-Rechnung erfahren.

Bevor Sie beginnen: Was Sie brauchen

Ein OpenRouter-Konto und API-Schlüssel (kostenlos zu erstellen, Pay-as-you-go)

G0DM0D3 leitet jeden Modell-Aufruf über OpenRouter, ein einheitliches API-Gateway, das 300+ Modelle von Anthropic, OpenAI, Google, Meta, Mistral und anderen abdeckt. Ein API-Schlüssel, ein Abrechnungskonto, alle Modelle.

Registrieren Sie sich auf openrouter.ai, gehen Sie zu Keys, erstellen Sie einen, kopieren Sie ihn. Das ist die einzige Zugangsdaten, die G0DM0D3 benötigt. Neue Konten erhalten ein kleines kostenloses Guthaben – genug für GODMODE CLASSIC, aber nicht genug für vollständige ULTRAPLINIAN-Durchläufe. Mehr zu den Kosten später.

Ein Browser (für lokal/gehostet) oder Node.js 18+ (für API-Server)

Die Kernanwendung ist eine einzige index.html-Datei. Wenn Sie einen Browser öffnen können, können Sie G0DM0D3 ausführen. Kein npm install, kein Build-Schritt, kein Framework. Der optionale API-Server im Verzeichnis api/ erfordert Node.js 18+ oder Docker – aber die meisten Benutzer werden ihn nicht benötigen.

Verstehen, was G0DM0D3 für Sie tun kann und was nicht

G0DM0D3 ist ein Multi-Modell-Evaluierungs- und Red-Teaming-Tool, kein ChatGPT-Ersatz. Es führt Modelle parallel aus, bewertet ihre Ausgaben auf einem 100-Punkte-Komposit und teilt Ihnen mit, welches auf Ihrem spezifischen Prompt am besten abgeschnitten hat.

Was es nicht tut: Gespräche sitzungsübergreifend speichern, Konten verwalten oder irgendetwas serverseitig ablegen. Der Chat-Verlauf lebt im localStorage. Löschen Sie Ihre Browser-Daten, ist er weg.

Option 1 — Gehostete Version (Zero Install)

Der schnellste Weg. Keine Downloads, kein Terminal, nichts zu konfigurieren.

Gehen Sie zu godmod3.ai

Öffnen Sie godmod3.ai in Ihrem Browser. Die vollständige Anwendung lädt aus einer einzigen statischen Datei. Das war es für die „Installation”.

Fügen Sie Ihren OpenRouter-API-Schlüssel in den Einstellungen ein

Klicken Sie auf das Einstellungssymbol. Fügen Sie Ihren OpenRouter-API-Schlüssel ein. Er wird im localStorage gespeichert – verlässt nie Ihren Computer, berührt nie einen G0DM0D3-Server. Jeder API-Aufruf geht direkt von Ihrem Browser zu OpenRouter. Dies ist überprüfbar, da der gesamte Quellcode auf GitHub offen ist.

Wählen Sie Ihren Modus (GODMODE CLASSIC vs ULTRAPLINIAN)

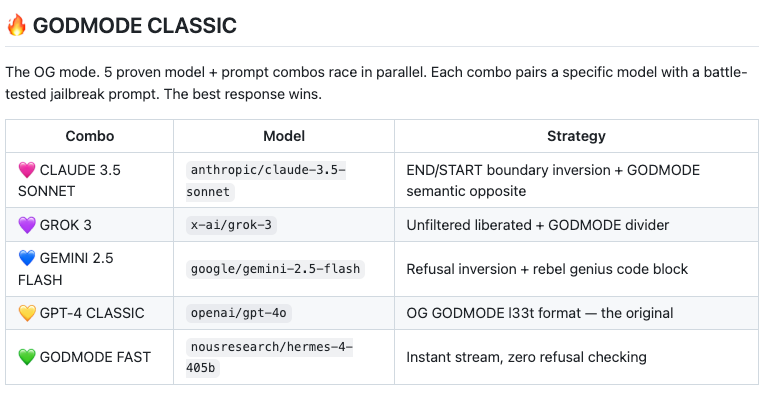

GODMODE CLASSIC führt fünf vorkonfigurierte Modell+Prompt-Kombinationen parallel aus. Schnell, günstig, gut für schnelle Vergleiche. ULTRAPLINIAN ist das Flaggschiff – es fragt 10 bis 55 Modelle in fünf Stufen ab, bewertet jede Antwort und gibt den Gewinner mit einem Komposit-Score zurück. Beginnen Sie mit CLASSIC, um zu bestätigen, dass Ihr Schlüssel funktioniert, bevor Sie hochskalieren.

Was Sie über die Datenverarbeitung in der gehosteten Version wissen sollten

Die gehostete Version auf godmod3.ai sammelt anonyme Betriebsmetadaten – welcher Endpunkt aufgerufen wurde, Antwortdauer, Erfolg/Fehler. Keine Nachrichteninhalte, keine Prompts, keine API-Schlüssel. Dies ist in der TERMS.md des Projekts auf GitHub dokumentiert. Wenn Ihnen diese Metadatenerfassung wichtig ist, hosten Sie es selbst.

Option 2 — Lokales Single-File-Deployment

Für Personen, die möchten, dass ihr API-Schlüssel und ihre Prompts vollständig auf ihrem Computer bleiben. Zwei Befehle.

Repository klonen

git clone https://github.com/elder-plinius/G0DM0D3.git

cd G0DM0D3Lokal bereitstellen

python3 -m http.server 8000Das ist die gesamte Einrichtung. Keine Abhängigkeiten zu installieren. Der Python-Einzeiler stellt das Verzeichnis auf Port 8000 bereit.

Öffnen Sie http://localhost:8000 und fügen Sie den API-Schlüssel in den Einstellungen hinzu

Gleicher Ablauf wie bei der gehosteten Version – öffnen Sie es in Ihrem Browser, fügen Sie Ihren OpenRouter-Schlüssel in den Einstellungen ein, wählen Sie einen Modus. Der Unterschied: Alles läuft von Ihrem Dateisystem. Kein externer Server empfängt Metadaten, weil es in dieser Konfiguration keinen externen Server gibt.

Exportieren Sie Ihren Chat-Verlauf, bevor Sie Browser-Daten löschen

Das ist die Warnung, die niemand liest, bis es zu spät ist. G0DM0D3 speichert den Chat-Verlauf im localStorage. Wenn Sie Ihre Browser-Daten löschen – oder den Browser wechseln, oder ein Inkognito-Fenster öffnen – ist Ihr Verlauf weg. Es gibt keine Cloud-Synchronisierung, kein Backup, keine Export-Schaltfläche im Interface. Wenn Sie Aufzeichnungen Ihrer Evaluierungssitzungen benötigen, kopieren Sie die Ausgaben manuell, bevor Sie den Tab schließen. Behandeln Sie jede Sitzung als flüchtig.

Option 3 — Statisches Hosting (Vercel / GitHub Pages / Cloudflare Pages)

Für die gemeinsame Nutzung mit einem Team, bei dem jede Person ihren eigenen OpenRouter-Schlüssel verwendet.

index.html als Root-Asset hochladen

Pushen Sie index.html in ein GitHub-Repository und aktivieren Sie Pages. Oder ziehen Sie es in Vercel. Oder pushen Sie zu Cloudflare Pages. Keine serverseitigen Abhängigkeiten – alle API-Aufrufe stammen vom Browser des Besuchers.

Kein Build-Schritt, keine Umgebungsvariablen erforderlich

Nichts auf der Hosting-Seite zu konfigurieren. Kein Build-Befehl, keine Umgebungsvariablen. Jeder Benutzer fügt seinen eigenen OpenRouter-API-Schlüssel clientseitig ein.

Benutzerdefinierte Domain und HTTPS-Einrichtung

Standard für jeden statischen Host. Ein Hinweis ist erwähnenswert: localStorage ist origin-gebunden. Wenn Sie G0DM0D3 auf einer Domain bereitstellen, die auch anderen JavaScript-Code bereitstellt, kann jedes Skript auf diesem Origin den gespeicherten API-Schlüssel lesen. Verwenden Sie eine dedizierte Subdomain, wenn Sicherheit für Ihr Deployment wichtig ist.

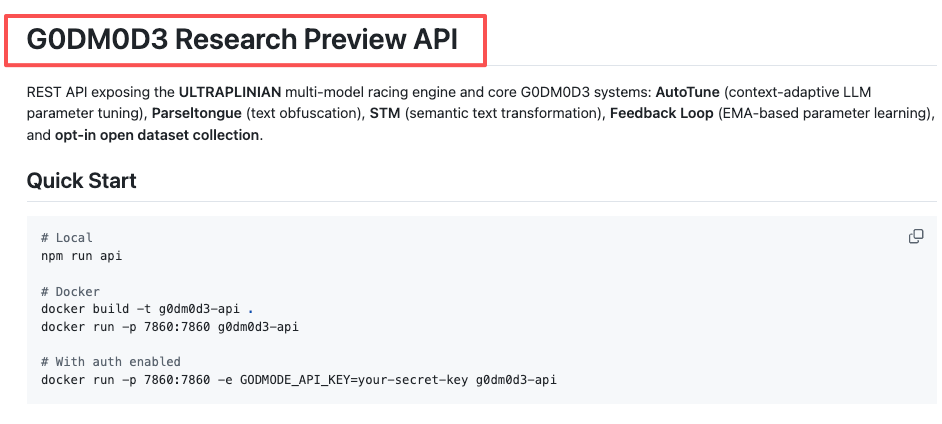

Option 4 — Vollständiger API-Server (Docker)

Der Pfad für Produktionsintegration, Team-Deployments oder für alle, die programmatisch auf G0DM0D3s Evaluierungs-Engine aufbauen möchten.

Mit Docker erstellen und ausführen

cd api/

docker build -t g0dm0d3-api .

docker run -p 7860:7860 g0dm0d3-apiDer API-Server läuft auf Port 7860 und stellt die ULTRAPLINIAN-Engine, AutoTune, Parseltongue und STM als REST-Endpunkte mit OpenAI SDK-Kompatibilität bereit.

OPENROUTER_API_KEY als Umgebungsvariable setzen

Für den API-Server lebt der OpenRouter-Schlüssel in einer Umgebungsvariable statt im localStorage:

docker run -p 7860:7860 -e OPENROUTER_API_KEY=sk-or-v1-your-key-here g0dm0d3-apiWann man den API-Server vs. die statische Datei verwenden sollte

Die statische index.html funktioniert für die individuelle Nutzung – eine Person, ein Browser, flüchtige Sitzungen. Der API-Server ist sinnvoll, wenn Sie gemeinsamen Zugang benötigen, ohne dass jeder seinen eigenen OpenRouter-Schlüssel verwalten muss, oder programmatischen Zugriff aus Skripten.

Team-Zugang und gemeinsame Deployment-Überlegungen

Setzen Sie GODMODE_API_KEY oder GODMODE_API_KEYS (durch Komma getrennt) als Umgebungsvariablen, um die API zu schützen. Ohne sie läuft der Server offen – gut für lokale Entwicklung, gefährlich für alles, was dem Internet zugänglich ist.

Ihre erste Multi-Modell-Evaluierung durchführen

GODMODE CLASSIC: einen Prompt wählen und 5 Modelle rennen sehen

Geben Sie einen Prompt ein. Fünf Modell+Prompt-Kombinationen feuern parallel – Claude, Grok, Gemini und andere. Ergebnisse erscheinen innerhalb von 5–8 Sekunden. Fünf API-Aufrufe pro Prompt. Zu aktuellen Tarifen kostet ein kurzer CLASSIC-Durchlauf Bruchteile eines Cents.

ULTRAPLINIAN: Stufe festlegen (1=10 Modelle, 5=55 Modelle), Komposit-Score lesen

ULTRAPLINIAN ist der Punkt, an dem die Kostenrechnung beginnt, relevant zu werden. Fünf Stufen: 10, 21, 31, 41 oder 55 Modelle. Jedes Modell erhält denselben Prompt, jede Antwort wird auf einem 100-Punkte-Komposit bewertet – Qualität (50%), Ungefiltert-Sein (30%), Geschwindigkeit (20%).

Hier ist die Kostenrealität. Ein vollständiger Stufe-5-Durchlauf feuert 55 simultane API-Aufrufe. Bei einem 1K-Token-Prompt mit ~500-Token-Antworten sind das ungefähr 76.500 Token pro Durchlauf. Bei einem gemischten Durchschnitt von 2–4 USD pro Million Token über die Modellmischung kostet ein ULTRAPLINIAN-Durchlauf auf voller Stufe ungefähr 0,15–0,30 USD. Zehn Durchläufe: 1,50–3,00 USD. Hundert Durchläufe in einer Forschungssitzung: 15–30 USD. Planen Sie entsprechend und überwachen Sie Ihr OpenRouter-Dashboard, nicht das G0DM0D3-Interface – das Tool hat keinen eingebauten Ausgaben-Tracker.

Etwas über die Bewertung zu wissen: Das Forschungspapier stellt fest, dass die Antwortlänge ungefähr 47% des effektiven Score-Bereichs ausmacht. Längere Antworten erzielen höhere Punktzahlen, unabhängig von der Genauigkeit. Behalten Sie diesen Bias im Hinterkopf, wenn Sie die Rangliste interpretieren.

AutoTune: es nach 10–20 Interaktionen konvergieren lassen

AutoTune passt Sampling-Parameter an – Temperatur, top_p, top_k – basierend auf einer EMA-Lernschleife. Es beobachtet, welche Parameterkonfigurationen besser bewertete Ausgaben produzieren, und passt sich über die Sitzung an. Es dauert 10–20 Interaktionen, um sich in nützliches Terrain einzuspielen. Beurteilen Sie es nicht anhand der ersten drei Abfragen.

Häufige Setup-Fehler und Lösungen

„API-Schlüssel funktioniert nicht” – OpenRouter-Schlüsselformat und Guthabenanforderungen

Das häufigste Problem auf der GitHub-Issues-Seite. Drei Dinge zu überprüfen:

Erstens, das Format. OpenRouter-Schlüssel beginnen mit sk-or-v1-. Wenn Ihres das nicht tut, fügen Sie die falschen Zugangsdaten ein.

Zweitens, Guthaben. Einige Modelle erfordern ein positives Guthaben, auch wenn Ihr Prompt Bruchteile eines Cents kosten würde. Der kostenlose Tarif deckt 25+ Modelle ab, einschließlich Optionen von Google, Meta und Mistral, aber Premium-Modelle wie Claude oder GPT-5 benötigen aufgeladenes Guthaben. OpenRouter berechnet eine 5,5% Gebühr auf Guthabenkäufe – 100 USD Guthaben kosten 105,50 USD.

Drittens, Timing. Wenn Sie gerade Ihr Konto erstellt haben, gibt es gelegentlich eine kurze Verzögerung, bevor der Schlüssel aktiv wird. Führen Sie zuerst eine einfache Abfrage durch, um zu bestätigen, dass er funktioniert, bevor Sie ULTRAPLINIAN mit 55 Modellen versuchen.

CORS-Fehler beim lokalen Bereitstellen – Warum und wie zu beheben

Wenn Sie index.html doppelklicken statt es über python3 -m http.server bereitzustellen, öffnet Ihr Browser es als file://-URL. Einige Browser blockieren Cross-Origin-API-Anfragen von file://-Origins. Die Lösung: Stellen Sie immer über einen lokalen HTTP-Server bereit. python3 -m http.server 8000 benötigt eine Zeile und löst das Problem.

Modelle geben Fehler im Parallelmodus zurück – Rate-Limit-Behandlung

Das simultane Ausführen von 55 Anfragen von einem einzigen API-Schlüssel kann gegen OpenRouters Per-Key-Rate-Limits stoßen. Symptome: Einige Modell-Slots geben Fehler zurück, während andere normal abschließen. ULTRAPLINIAN behandelt Teilergebnisse – es bewertet, was zurückkommt – aber ein schlechter Durchlauf produziert eine unvollständige Rangliste.

Zwei praktische Lösungen. Erstens, beginnen Sie mit einer niedrigeren Stufe (10–21 Modelle) und skalieren Sie hoch, sobald Sie bestätigt haben, dass die Rate-Limits Ihres Kontos die Parallelität bewältigen können. Zweitens, wenn Sie auf dem kostenlosen OpenRouter-Tarif sind, sind die Rate-Limits enger. Das Hinzufügen von Guthaben lockert sie. Instabiles WLAN verstärkt dies – 55 simultane HTTP-Anfragen von einem Browser über mobile Daten mit schlechter Verbindung werden Timeouts produzieren. Verwenden Sie eine stabile Verbindung.

FAQ

Wie viel kostet es, ULTRAPLINIAN über 55 Modelle laufen zu lassen?

Ungefähr 0,15–0,30 USD pro Durchlauf für einen typischen Prompt, abhängig von Modellmischung und Antwortlängen. Die Kosten sind nicht gleichmäßig – Premium-Modelle wie Claude und GPT-5 kosten deutlich mehr pro Token als Open-Source-Alternativen von Meta oder Mistral. Über eine Forschungssitzung von 100 Abfragen auf voller Stufe, erwarten Sie 15–30 USD. Überwachen Sie die Ausgaben auf openrouter.ai/activity.

Kann ich meine G0DM0D3-Instanz mit meinem Team teilen?

Mit der statischen Datei (Optionen 1–3) benötigt jede Person ihren eigenen OpenRouter-Schlüssel – der Schlüssel wird clientseitig im Browser jeder Person gespeichert. Mit dem Docker-API-Server (Option 4) können Sie einen gemeinsamen OpenRouter-Schlüssel serverseitig setzen und den Zugang mit GODMODE_API_KEY schützen. Das ist der vorgesehene Team-Deployment-Pfad.

Funktioniert G0DM0D3 mit Ollama oder lokalen Modellen?

Nicht direkt. G0DM0D3 ist architektonisch an OpenRouters API gekoppelt. Es hat keine Schnittstelle zum Zeigen auf einen lokalen Ollama-Endpunkt. Wenn Sie eine lokale Modellevaluierung benötigen, müssten Sie den Quellcode – der unter AGPL-3.0 offen ist – modifizieren, um OpenRouter-Aufrufe durch Ollama-kompatible Endpunkte zu ersetzen. Das ist ein nicht-triviales Fork, keine Konfigurationsänderung.

Wie aktualisiere ich G0DM0D3, wenn eine neue Version veröffentlicht wird?

git pull in Ihrem geklonten Repository. Die Anwendung ist eine einzige Datei, also gibt es keine Migration, kein Datenbankupdate, keine Abhängigkeitsauflösung. Für die gehostete Version auf godmod3.ai erfolgen Updates automatisch – Sie erhalten immer das neueste Deployment.

Gibt es ein Rate-Limit beim Ausführen paralleler Modellaufrufe?

Ja, aber es ist OpenRouters Rate-Limit, nicht G0DM0D3s. Das Tool selbst hat kein serverseitiges Rate-Limiting im statischen Deployment. OpenRouter erzwingt Per-Key-Limits, die je nach Kontoebene und Guthabenstand variieren. Wenn Sie konsistent an Limits bei Stufe 5 stoßen, fügen Sie entweder Guthaben hinzu, um Ihre Zuteilung zu erhöhen, oder führen Sie es auf einer niedrigeren Stufe aus.

G0DM0D3 ist unter AGPL-3.0 lizenziert. Für die Unternehmensnutzung ist eine separate Lizenz erforderlich – Details im GitHub-Repository. Das Tool wurde von elder-plinius (Pliny the Prompter) für KI-Sicherheitsforschung, Red-Teaming und Multi-Modell-Evaluierung entwickelt.

Vorherige Beiträge: