Claude Managed Agents Preise und Beta-Limits

Claude Managed Agents berechnet Token plus 0,08 $/Sitzungsstunde Laufzeit, mit Websuche für 10 $/1.000 Anfragen. Das bedeutet die Beta-Abrechnungsstruktur für Ihren Workload.

Gestern habe ich unsere Kostenübersicht für die Agent-Infrastruktur aufgerufen und sie eine Weile angestarrt. Ich bin Dora. Wir betreiben eine selbst gehostete Agent-Loop — Tool-Orchestrierung, Sandboxing, Fehlerwiederherstellung, Checkpoint-Logik — und sie frisst ungefähr 0,4 der Arbeitszeit eines Ingenieurs, nur um sie am Laufen zu halten. Als Anthropic am 8. April Claude Managed Agents veröffentlichte, habe ich als erstes nicht die Feature-Liste gelesen. Ich öffnete die Preisseite.

Dieser Artikel dokumentiert, wie die Abrechnungsstruktur tatsächlich aussieht, wenn man die Zahlen durchrechnet, wo die Rate Limits liegen und was aufgrund des Beta-Labels noch ungewiss ist.

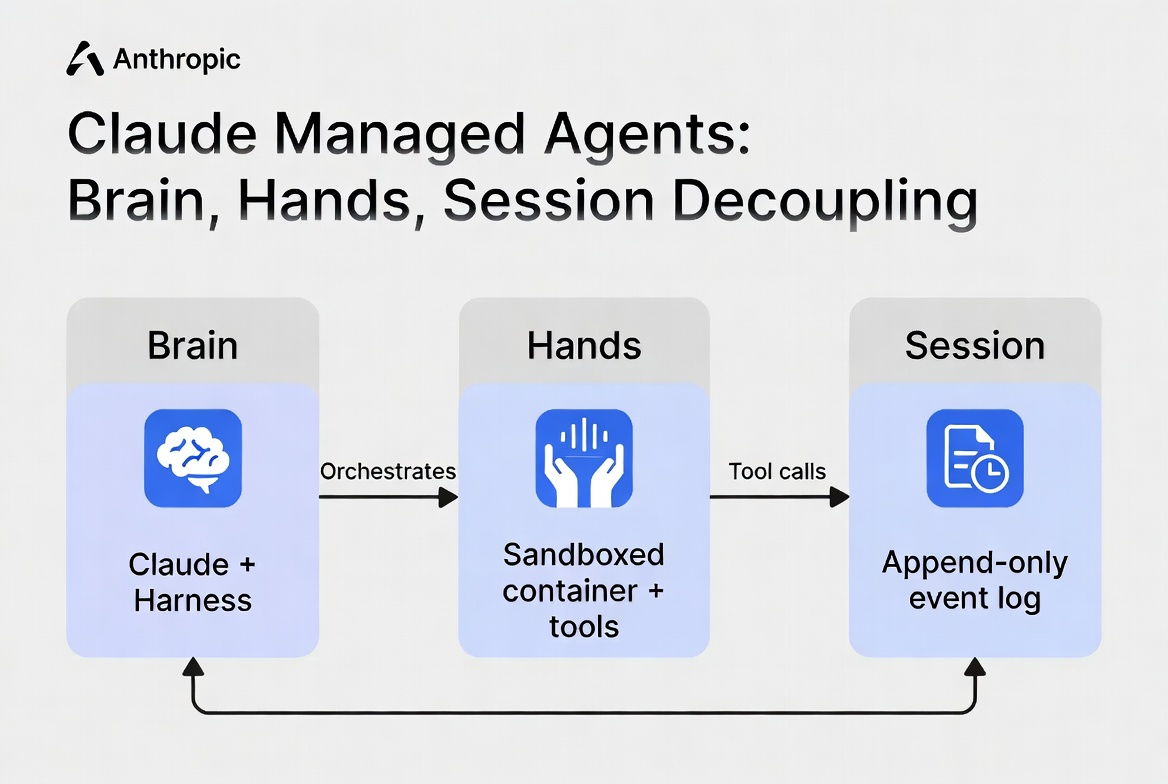

Wie Claude Managed Agents berechnet wird

Zweidimensionale Abrechnung: Tokens + Session-Laufzeit

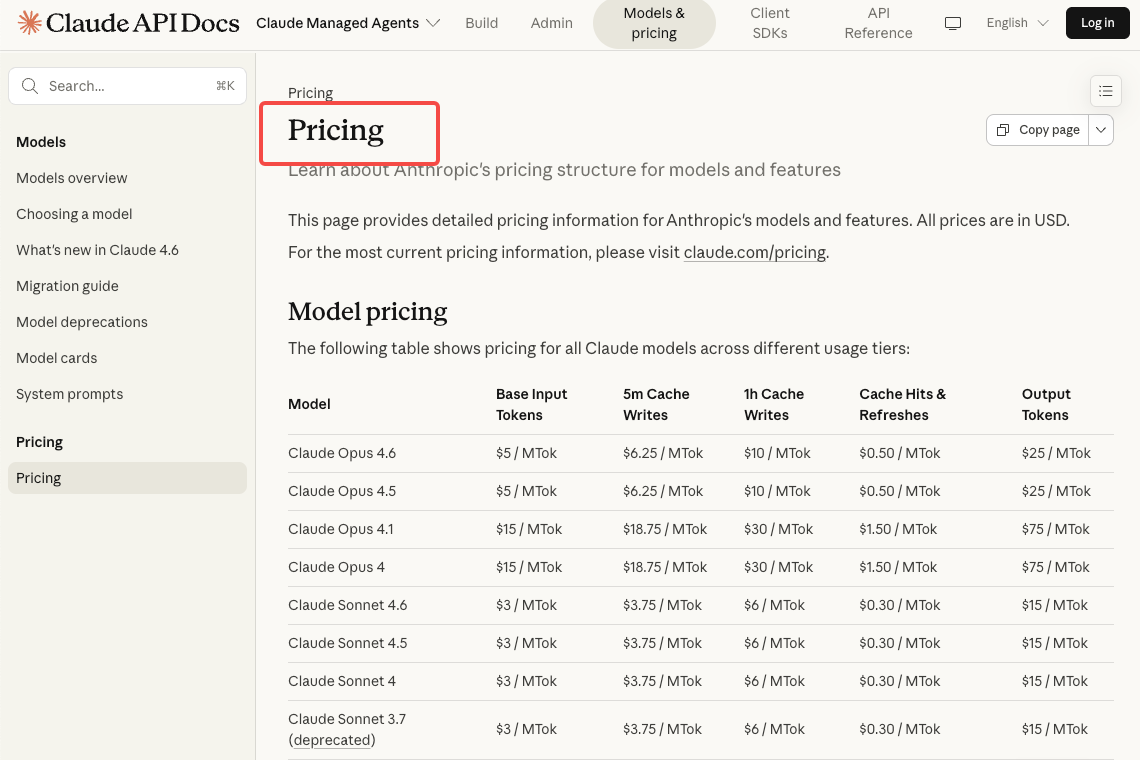

Die Abrechnung für Managed Agents hat zwei Dimensionen: Tokens und Session-Laufzeit. Tokens werden zu Standard-Claude-API-Modellpreisen berechnet — dieselben Preise pro Million Tokens, die Sie über die Messages API zahlen würden. Opus 4.6 kostet $5 Input / $25 Output pro MTok. Sonnet 4.6 ist $3 / $15. Die Prompt-Caching-Multiplikatoren gelten identisch: Cache-Lesevorgänge kosten 10 % des Basis-Inputpreises.

Die zweite Dimension ist die Infrastrukturgebühr für den verwalteten Container.

Session-Laufzeit: $0,08 pro Session-Stunde

Die Laufzeitgebühr beträgt $0,08 pro Session-Stunde für aktive Laufzeit, verbrauchsbasiert abgerechnet. Das sind die Infrastrukturkosten des Sandbox-Containers, in dem Ihr Agent läuft.

Ein Detail, das es wert ist, erwähnt zu werden: Die Session-Laufzeit ersetzt das Code-Execution-Container-Stunden-Abrechnungsmodell bei Verwendung von Managed Agents — es wird keine Doppelberechnung vorgenommen.

Web-Suche: $10 pro 1.000 Suchanfragen

Eine innerhalb einer Managed-Agents-Session ausgelöste Web-Suche kostet den Standard-$10 pro 1.000 Suchanfragen. Dieselbe Rate wie bei der eigenständigen API. Ein Recherche-Agent, der pro Session Dutzende von Web-Suchanfragen abfeuert, wird diesen Posten deutlich spüren.

Nur direkt über die Claude API verfügbar

Managed Agents wird direkt über die Claude Platform abgerechnet. Preise von Drittanbieter-Plattformen — Bedrock, Vertex AI, Foundry — gelten hier nicht. Wenn Sie Agents über einen dieser Anbieter betreiben, ist dies eine separate Abrechnungsbeziehung.

Session-Laufzeitkosten: Was das in der Praxis bedeutet

Was als Session-Laufzeit zählt

Die Laufzeit wird auf die Millisekunde genau gemessen und läuft nur auf, während der Status der Session running ist. Leerlaufzeit — Warten auf Ihre nächste Nachricht, eine Tool-Bestätigung oder ein beendetes System — zählt nicht. Der Zähler pausiert, wenn der Agent nichts zu tun hat.

Das ist wichtiger, als es klingt. Ein Agent, der eine Aufgabe beendet und 20 Minuten auf eine Benutzereingabe wartet, verbraucht während dieser 20 Minuten keine $0,08/Std.

Langläufer- vs. Kurzaufgaben-Agents

Ein 10-minütiger Dateiverarbeitungsauftrag auf Sonnet 4.6 kostet etwa $0,013 an Laufzeit. Kaum spürbar. Die Token-Kosten dominieren.

Eine 4-stündige Recherche-Agent-Session auf Opus 4.6 ist anders. Das sind $0,32 an Laufzeit, aber wenn der Agent aktiv durch komplexe Tool-Ketten arbeitet, könnten Sie 200.000+ Input-Tokens und 50.000+ Output-Tokens verbrauchen. Allein die Token-Rechnung könnte $1,25 übersteigen, bevor Caching greift.

Beispielkostenschätzung

Hier ist das ausgearbeitete Beispiel aus Anthropics Preisdokumentation: Eine einstündige Coding-Session auf Opus 4.6 mit 50.000 Input-Tokens und 15.000 Output-Tokens kostet insgesamt etwa $0,70. Mit aktivem Prompt-Caching und 40.000 dieser Inputs, die den Cache treffen, sinkt es deutlich. Die Laufzeit macht $0,08 dieses Gesamtbetrags aus.

Die eigentliche Frage lautet nicht „Ist $0,08/Stunde teuer?” Sie lautet: „Wie token-hungrig ist die Tool-Loop meines Agents?” Jeder Bash-Befehl, jedes Dateilesen, jeder Web-Fetch und jede Web-Suche trägt Tokens bei. Eine stark agentische Session mit Dutzenden von Tool-Aufrufen verbraucht den Kontext schnell.

Rate Limits und Kontingente

Create-Endpunkte: 60 Anfragen pro Minute

Managed-Agents-Endpunkte sind pro Organisation rate-limitiert, und diese Limits sind von den Rate Limits der Messages API getrennt. Create-Endpunkte erlauben 60 RPM auf Org-Ebene.

Read-Endpunkte: 600 Anfragen pro Minute

Read-Endpunkte sind auf 600 RPM auf Org-Ebene begrenzt. Wenn Sie den Session-Status häufig über viele gleichzeitige Agents hinweg abfragen, ist dies die Grenze, die Sie zuerst erreichen werden.

Ausgabenlimits auf Org-Ebene und tier-basierte Rate Limits gelten ebenfalls

Standard-tier-basierte Rate Limits kommen hinzu. Token-pro-Minute- und Anfrage-pro-Minute-Limits aus Ihrem API-Tier gelten weiterhin für die zugrunde liegenden Modellaufrufe Ihrer Agents.

So beantragen Sie höhere Limits

Für Produktionsworkloads, die mehr Spielraum benötigen, bietet Anthropic den Priority Tier mit festen Ausgaben an. Wenden Sie sich über die Claude Console an das Vertriebsteam für individuelle Rate-Limit-Vereinbarungen. Die Rate-Limit-Diagramme in der Console zeigen den Echtzeit-Spielraum — nutzen Sie sie, um zu sehen, wann Sie sich den Limits nähern, bevor Sie 429-Fehler erhalten.

Beta-Header und was sich bei GA ändert

managed-agents-2026-04-01: bei jeder Anfrage erforderlich

Alle Managed-Agents-Endpunkte erfordern den managed-agents-2026-04-01 Beta-Header. Das SDK setzt ihn automatisch. Wenn Sie rohes cURL oder einen benutzerdefinierten HTTP-Client verwenden, fügen Sie ihn manuell zu jeder Anfrage hinzu.

Unsicherheit in der Beta-Phase

Die offizielle Dokumentation besagt, dass Verhaltensweisen zwischen Releases verfeinert werden können, um Ausgaben zu verbessern. Das ist ein standardmäßiger Beta-Vorbehalt.

Ich möchte präzise sein, was das für die Preisgestaltung bedeutet. Es ist keine Ankündigung, dass Anthropic plant, die Preise bei GA zu ändern. Es bedeutet, dass die aktuellen Zahlen keine dauerhafte vertragliche Verpflichtung sind — was für jede Beta-Phase-Preisgestaltung gilt, überall. Bauen Sie Ihre Kostenmodelle mit dieser Unsicherheit ein, aber lesen Sie es nicht als Signal für bevorstehende Preisänderungen.

Research-Preview-Features bleiben gesperrt

Bestimmte Features — Outcomes, Multi-Agent-Koordination und Memory — befinden sich in der Research Preview und erfordern separate Zugriffsanfragen. Diese könnten zusätzliche Kostenimplikationen haben, wenn sie die Preview verlassen. Ich weiß es noch nicht. Niemand außerhalb von Anthropic auch.

Batch-API- und Caching-Interaktionen

Batch-API: nicht für Managed Agents verfügbar

Das ist der Punkt, der die Leute stolpern lässt. Die Messages-API-Modifikatoren einschließlich der Batch-API gelten nicht für Claude-Managed-Agents-Sessions. Wenn Sie sich auf den 50%-Rabatt für die Massenverarbeitung verlassen haben, können Sie diese Kostenstruktur mit Managed Agents nicht replizieren. Dies ist eine bestätigte Einschränkung, kein Roadmap-Punkt.

Prompt-Caching: eingebaut

Prompt-Caching ist in den Managed-Agents-Harness eingebaut. Standard-Multiplikatoren gelten — Cache-Schreibvorgänge bei 1,25x Basis-Input für 5-Minuten-TTL, Cache-Lesevorgänge bei 0,1x. Bei langläufigen Sessions, bei denen der System-Prompt und früher Kontext über viele Tool-Aufrufe hinweg wiederverwendet werden, kann Caching die Token-Rechnung merklich reduzieren.

Compaction: eingebaut

Der Harness unterstützt eingebaute Compaction und andere Leistungsoptimierungen für effiziente Agent-Ausgaben. Für Sessions, die lang genug laufen, um sich dem Kontextfensterlimit zu nähern, fasst Compaction frühere Gesprächsrunden automatisch zusammen. Dies hilft, die Token-Akkumulation zu verwalten, ohne dass Sie eine benutzerdefinierte Trunkierungsstrategie entwickeln müssen.

Versteckte Kostenüberlegungen

Tool-Ausführungs-Overhead

Jeder Tool-Aufruf erzeugt Tokens. Bash-Befehle, Dateilesevorgänge, Web-Fetches — jeder einzelne fügt Input- und Output-Tokens zu Ihrem Session-Gesamtbetrag hinzu. Ein Recherche-Agent, der 30+ Tool-Aufrufe in einer einzigen Session verkettet, wird Token-Kosten anhäufen, die die $0,08/Stunden-Laufzeitgebühr übersteigen.

Web-Suche zu $10/1.000 Aufrufen ist der sichtbarste Kosten-pro-Aufruf-Posten. Aber der weniger sichtbare ist der Token-Overhead von Tool-Ergebnissen, die in den Kontext zurückfließen. Ein Web-Fetch, der eine lange Seite zurückgibt, schüttet Tausende von Tokens in Ihre Session.

Research-Preview-Features: potenzieller Kostenmultiplikator

Multi-Agent-Koordination — bei der Agents andere Agents starten und steuern können — ist in der Research Preview verfügbar. Jeder Sub-Agent betreibt seine eigene Session mit eigenem Token-Verbrauch und eigenem Laufzeitmesser. Der Kostenmultiplikator hängt davon ab, wie viele Sub-Agents gestartet werden und wie lange jeder läuft. Ich konnte nicht verifizieren, ob Sub-Agent-Sessions separate Laufzeitgebühren tragen oder die des übergeordneten teilen. Das ist einer, den man im Auge behalten sollte.

FAQ

Ist Claude Managed Agents während der Beta kostenlos?

Nein. Die verbrauchsbasierte Preisgestaltung ist jetzt aktiv — Standard-Token-Preise plus $0,08 pro Session-Stunde für aktive Laufzeit. Es gibt keinen kostenlosen Tarif speziell für Managed Agents. Neue API-Benutzer erhalten eine kleine Menge kostenloser Credits für erste Tests, aber das sind die Standard-API-Onboarding-Credits, kein Managed-Agents-Vorteil.

Wie funktioniert die Session-Laufzeitabrechnung für asynchrone Agents?

Die Laufzeit läuft nur auf, während der Session-Status running ist. Wenn ein Agent eine Aufgabe beendet und in den Leerlauf geht — auf die nächste Benutzernachricht oder eine Tool-Bestätigung wartet — kostet diese Leerlaufzeit nichts. Der Zähler pausiert und wird wieder gestartet, wenn die Verarbeitung neu beginnt. Die Messung erfolgt auf die Millisekunde genau.

Kann ich den Batch-API-Rabatt mit Managed Agents nutzen?

Nein. Der 50%-Batch-API-Rabatt gilt nicht. Wenn Batch-Level-Einsparungen entscheidend für Ihren Workflow sind, bewerten Sie, ob die Infrastruktureinsparungen durch verwaltetes Hosting den Verlust des Batch-Rabatts ausgleichen. Für einige Workloads wird das Betreiben Ihrer eigenen Agent-Loop auf der Messages API mit Batch-Verarbeitung immer noch günstiger sein.

Was passiert mit der Abrechnung, wenn die Beta endet?

Anthropic hat sich nicht auf spezifische GA-Preise festgelegt. Die aktuellen $0,08/Session-Stunde und Standard-Token-Preise sind Beta-Phase-Zahlen. Das Abrechnungsmodell wird wahrscheinlich in irgendeiner Form bestehen bleiben, aber spezifische Zahlen könnten sich ändern. Berücksichtigen Sie diese Unsicherheit bei langfristigen Kostenprojektionen.

Gibt es einen kostenlosen Tarif oder eine Testversion?

Es gibt keine dedizierte Managed-Agents-Testversion. Standard-API-Freiguthaben gelten. Für die Unternehmensbewertung kann das Vertriebsteam von Anthropic erweiterte Testvereinbarungen besprechen — erreichen Sie sie über die Claude Console oder unter sales@anthropic.com.

Das ist, was ich zum 9. April 2026 bestätigen kann. Die Preisstruktur ist unkompliziert, sobald man die beiden Abrechnungsdimensionen trennt, aber die echte Variable ist die Tool-Aufruf-Token-Akkumulation — dort werden Ihre Schätzungen von der Realität abweichen. Ich führe noch Testsessions durch, um ein besseres Bild davon zu bekommen, wie Compaction und Caching ab der 2-Stunden-Marke interagieren. Mehr dazu folgt.

Frühere Beiträge: