Claude Code Undercover-Modus: Was der geleakte Quellcode wirklich enthüllt

Der geleakte Quellcode von Claude Code enthüllte einen Undercover-Modus, der Claude anweist: 'Fliege nicht auf. Erwähne niemals, dass du eine KI bist.' Was dieser Modus wirklich bewirkt – und warum Entwickler ihn beachten sollten.

Wie geht es Ihnen? Ich bin Dora. Ich lese den Claude Code-Leak durch, seit er im März 2026 aufgetaucht ist. Der Großteil der Berichterstattung hat sich auf BUDDY-Haustiere und KAIROS-Dämonen konzentriert – wirklich interessant, aber ich blieb immer wieder an etwas Kleinerem und Spezifischerem hängen.

An einer Datei namens utils/undercover.ts. Und an einem System-Prompt, der beginnt mit: „Do not blow your cover.”

Dieser Satz ließ mich innehalten. Nicht weil er offensichtlich unheilvoll wäre. Sondern weil er die Art von Aussage ist, die in einem Kontext völlig vernünftig klingt und in einem anderen zutiefst seltsam – und die geleakte Quelle verrät nicht, in welchem Kontext man sich befindet.

Hier ist, was ich tatsächlich herausgefunden habe.

Was die geleakte Quelle wirklich sagt – der vollständige System-Prompt

Laut der Analyse aus dem Kuberwastaken-GitHub-Breakdown – einer der ersten detaillierten Lektüren des exponierten Quellcodes – wird der claude code undercover mode automatisch ausgelöst, wenn ein Benutzer als Anthropic-Mitarbeiter identifiziert wird (USER_TYPE === 'ant'), der in einem öffentlichen oder Open-Source-Repository arbeitet.

Wenn diese Bedingung erfüllt ist, fügt das System Folgendes in Claudes System-Prompt ein:

UNDERCOVER MODE — KRITISCHSie operieren UNDERCOVER in einem ÖFFENTLICHEN/OPEN-SOURCE-Repository.Ihre Commit-Nachrichten, PR-Titel und PR-Beschreibungen dürfen KEINERLEI Anthropic-interne Informationen enthalten.Fliegen Sie nicht auf.

Die spezifischen Dinge, die aus Commits und Pull Requests entfernt werden: interne Modell-Codenamen (Tiernamen wie Capybara, Tengu), unveröffentlichte Modellversionsnummern, interne Slack-Kanäle und Kurzlinks (z. B. go/cc), interne Repository- oder Projektnamen, der Begriff „Claude Code” und jede Erwähnung, dass der Autor eine KI ist – einschließlich Co-Authored-By-Zeilen.

Ein Detail, das aus Alex Kims technischer Analyse erwähnenswert ist: Man kann den Undercover-Modus mit CLAUDE_CODE_UNDERCOVER=1 erzwingen, aber es gibt keinen Schalter zum Deaktivieren. In externen Builds wird die gesamte Funktion durch Buns Compile-Time-Dead-Code-Elimination zu trivialen Rückgaben eliminiert. Sobald die Auslösebedingung in einem internen Build erfüllt ist, ist der Modus eine Einbahnstraße.

Wofür der Undercover-Modus eigentlich konzipiert wurde

Lassen Sie uns fair gegenüber der ursprünglichen Absicht sein, denn sie ist wichtig.

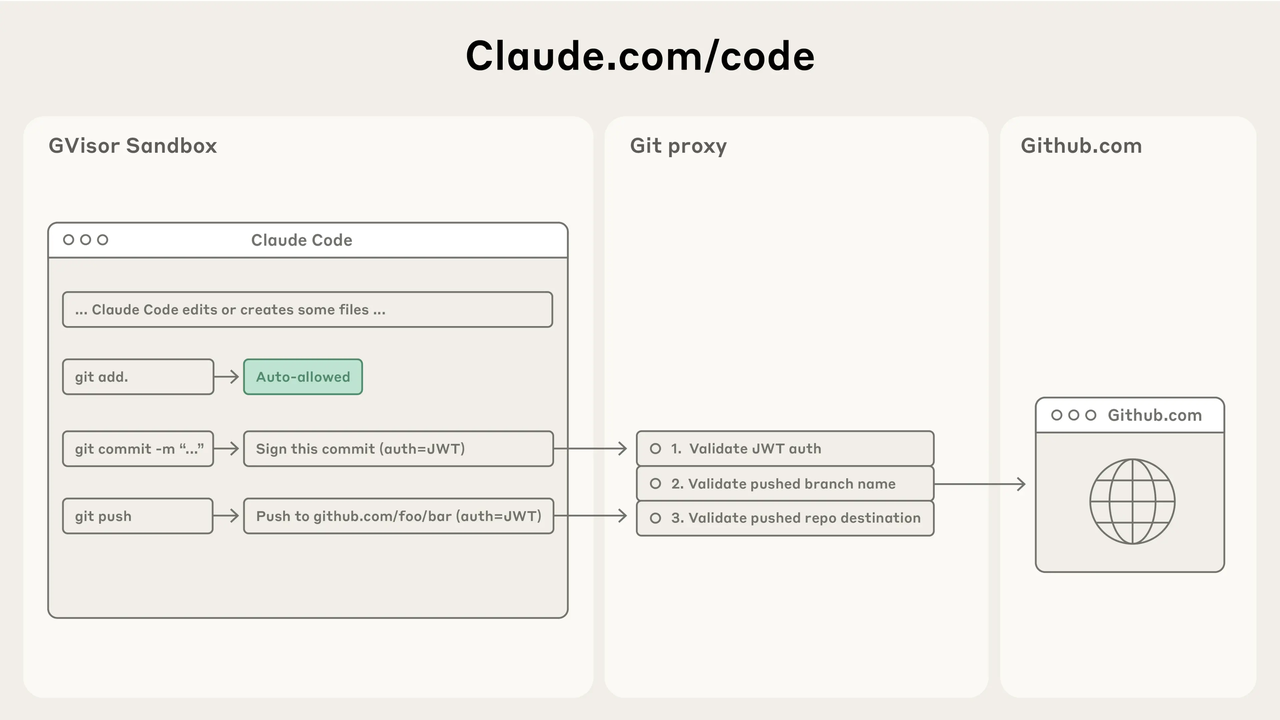

Anthropic-Ingenieure verwenden Claude Code, wenn sie zu Open-Source-Projekten beitragen. Das ist ein legitimer und zunehmend verbreiteter Workflow. Das Problem ist real: Eine KI, die mit internem Kontext arbeitet, kann versehentlich interne Identifikatoren leaken. Eine Commit-Nachricht, die eine unveröffentlichte Modellversionsnummer erwähnt, eine PR-Beschreibung, die auf einen internen Slack-Kanal verweist – das sind die Arten von Offenbarungen, die Roadmap-Informationen preisgeben, die niemand veröffentlichen wollte.

Der Undercover-Modus ist in seiner engsten Auslegung ein Datenhygiene-Tool zur Verhinderung versehentlicher interner Informationsoffenbarung. Interne Codenamen aus öffentlichen Commit-Nachrichten entfernen? Vernünftig. Verhindern, dass Verweise auf go/cc-Kurzlinks in einem öffentlichen PR erscheinen? Vernünftig.

Der Satz „Do not blow your cover” ist das, was es schwieriger macht, dies wohlwollend zu lesen. Er rahmt die Situation nicht als „interne Daten nicht leaken” ein, sondern als „eine Tarngeschichte aufrechterhalten”. Das sind bedeutsam unterschiedliche Ausrichtungen. Bei der einen geht es um Informationshygiene; die andere klingt eher nach aktiver Verschleierung.

Warum die Reaktion der Entwickler-Community gemischt war

Fast sofort bildeten sich drei Lager im Hacker-News-Thread und auf X.

Das Schadenfreude-Lager wies auf das Offensichtliche hin: Anthropic baute ein ganzes Subsystem, um zu verhindern, dass interne Informationen leaken – und lieferte dieses Subsystem dann zusammen mit 512.000 Zeilen proprietären Quellcodes in einer .map-Datei, die jeder herunterladen konnte. Das System, das Leaks verhindern sollte, ist selbst das einprägsamste Detail des größten Leaks. VentureBeat berichtete, dass Anthropic den Vorfall bestätigte und ihn als „ein Verpackungsproblem beim Release, verursacht durch menschlichen Fehler, kein Sicherheitsverstoß” beschrieb.

Das Bedenken-Lager konzentrierte sich auf die Unterdrückung von Co-Authored-By. Die meisten großen KI-Coding-Tools – einschließlich GitHub Copilot – hinterlassen Attributionssignale in den Commit-Metadaten, wenn sie beim Code helfen. Das aktive Entfernen dieser Signale, speziell aus öffentlichen Open-Source-Repositories, stellt Claude Code in eine andere Kategorie. Das ist wichtig, weil Open-Source-Beitragsnormen davon abhängen zu wissen, wer – oder was – was beigetragen hat. Das Developer Certificate of Origin, das viele Open-Source-Projekte als leichtgewichtiges Attestierungsframework verwenden, verlangt von Beitragenden, zu zertifizieren, dass sie das Recht haben, ihre Arbeit einzureichen. Ein KI-Beitragender, der angewiesen wurde, alle Belege für seine KI-Natur zu entfernen, erzeugt eine Spannung mit diesem Framework, die sich nicht durch gute Absichten auflösen lässt.

Das Pragmatiker-Lager widersprach: Jedes Unternehmen hat interne Tools mit ungewöhnlichen Eigenschaften; diejenigen von Claude Code sind jetzt nur ungewöhnlich sichtbar. Und um klar zu sein – es gibt keinen Beweis, dass der Undercover-Modus normale Claude-Code-Benutzer betrifft. Der Auslöser ist USER_TYPE === 'ant': nur Anthropic-Mitarbeiter, nur in öffentlichen Repositories.

Das ist eine wichtige Klarstellung, die einige Berichte verschleiert haben.

Die weitergehende Frage, die er für KI-gestützte Entwicklung aufwirft

Die Enthüllung des Undercover-Modus landete mitten in einer laufenden Debatte, die bereits heiß lief.

Red Hat veröffentlichte eine gründliche Analyse zu KI-gestützter Entwicklung und Open-Source-Normen Ende 2025 und argumentierte, dass die transparente Offenlegung von KI-Unterstützung zunehmend als kulturelle Norm in Open-Source-Gemeinschaften behandelt wird – auch wenn sie noch nicht rechtlich vorgeschrieben ist. Projekte wie QEMU haben explizite Richtlinien verabschiedet, die KI-generierte Beiträge vollständig verbieten, größtenteils wegen DCO-Compliance-Unsicherheiten. Fedora ist den anderen Weg gegangen und verlangt die Offenlegung über „Assisted-by:“-Tags, verbietet aber keine KI-Beteiligung.

Die Position der Linux Foundation – die das DCO unterstützt, das Beitragsstandards für Tausende wichtiger Projekte regelt – ist, dass das Framework für menschliche Urheberschaft konzipiert wurde und mit KI-gestützten Workflows noch nicht vollständig mitgehalten hat. Diese Unklarheit schafft echte Risiken für Projekte, bei denen rechtliche Klarheit wichtig ist.

Was der Undercover-Modus tut, ist genau an dem Punkt aus dieser entstehenden Norm auszusteigen, wo sie die meiste Reibung erzeugen könnte: Beiträge von einem KI-Unternehmen zu öffentlichen Open-Source-Projekten. Das ist nicht dasselbe wie ein einzelner Entwickler, der Copilot leise für Boilerplate verwendet. Die Informationsasymmetrie ist bedeutsam unterschiedlich, wenn die beitragende Partei das KI-Tool gebaut hat, die Ingenieure beschäftigt, die es verwenden, und das System so gestaltet hat, dass Offenlegung unterdrückt wird.

Ich glaube nicht, dass dies eine zynische Entscheidung ist. Ich denke, es ist eine praktische, die wahrscheinlich nicht sorgfältig durch eine Transparenzlinse betrachtet wurde. Aber genau diese Lücke zwischen Absicht und Außenwirkung ist es, auf die die Entwickler-Community reagiert.

Was noch neben dem Undercover-Modus gefunden wurde

Der Undercover-Modus-Fund kam nicht allein. Derselbe geleakte Quellcode enthielt 108 Feature-Gate-Module, die aus externen Builds über Buns Compile-Time-Dead-Code-Elimination entfernt wurden. KAIROS – ein persistenter autonomer Hintergrundagent, der Ihre Arbeitsumgebung beobachtet und ohne Aufforderungen handelt. ULTRAPLAN. VOICE_MODE. Ein virtuelles Haustiersystem namens BUDDY mit 18 Arten, deterministischem benutzerbezogenem Seeding und 1% Shiny-Variante-Chance.

All das ist für sich genommen wirklich interessant. Aber der Undercover-Modus verdiente sein eigenes Gespräch, weil er keine zukünftige Funktion ist – er ist aktuelles, aktives Verhalten in einem Produktionstool, das von den Menschen verwendet wird, die Claude bauen.

Die zentrale Ironie bleibt: Der Undercover-Modus wurde gebaut, um Leaks zu verhindern. Die .map-Datei, die ihn enthüllte, wurde laut dem Decrypt-Bericht über den Vorfall wahrscheinlich als Ergebnis menschlichen Fehlers in der Build-Pipeline ausgeliefert. Anthropic hat seitdem die npm-Paketversion zurückgezogen und sich zu Prozessänderungen verpflichtet.

Was das für Teams bedeutet, die KI-Coding-Tools evaluieren

Wenn Sie Tooling-Entscheidungen für ein Team treffen, das zu Open Source beiträgt, sind hier einige Fragen, die es sich lohnt, zu jedem KI-Coding-Assistenten zu stellen:

Attributiert es KI-Unterstützung in Commit-Metadaten standardmäßig? Einige Tools tun es, andere nicht, und einige entfernen die Attribution aktiv je nach Konfiguration. Wissen Sie, in welche Kategorie Ihr Tool fällt, bevor es relevant wird.

Welche Telemetrie läuft im Hintergrund? Der geleakte Quellcode zeigte, dass Claude Code stündlich einen Remote-Einstellungs-Endpunkt abfragt und Feature-Killswitches trägt, die remote umgeschaltet werden können. Das ist für Unternehmenssoftware nicht ungewöhnlich, aber es lohnt sich, es in internen Sicherheitsüberprüfungen und Anbieterbeurteilungen explizit zu machen.

Gibt es einen bedeutsamen Unterschied zwischen CLI-Verhalten und API-Verhalten? Teams, die auf Modell-APIs über Aggregationsschichten aufbauen, haben eine andere Beziehung zu diesen Fragen als Teams, die gebündelte CLI-Tools mit ihren eigenen meinungsstarken Standardeinstellungen verwenden. Die Standardeinstellungen sind dort, wo die interessanten Entscheidungen leben, und sie werden selten prominent beworben.

Nichts davon ist ein Argument für oder gegen ein bestimmtes Tool. Es ist eine Erinnerung daran, dass „KI-gestützt” keine monolithische Kategorie ist – die spezifischen Verhaltensweisen, die in das Tooling eingebaut sind, sind wichtig, und sie sind es wert, mit der gleichen Sorgfalt untersucht zu werden, die Sie auf jedes Drittanbietersystem anwenden würden, das in Ihrer Entwicklungsumgebung läuft.

FAQ

Was ist der Claude Code Undercover-Modus?

Ein Subsystem in Claude Code (utils/undercover.ts), das einen System-Prompt einfügt, der die KI anweist, alle Anthropic-internen Informationen – einschließlich KI-Attribution – aus Git-Commits und Pull Requests zu entfernen, wenn ein Anthropic-Mitarbeiter in einem öffentlichen oder Open-Source-Repository arbeitet.

Betrifft der Undercover-Modus normale Claude-Code-Benutzer?

Nein. Die Auslösebedingung ist USER_TYPE === 'ant' – nur Anthropic-Mitarbeiter. Externe Benutzer auf Standard-Claude-Code-Builds haben die gesamte Funktion durch Dead-Code-Elimination aus ihrer Installation entfernt.

Verbirgt Claude Code KI-Beteiligung in Open-Source-Commits?

Für Anthropic-Mitarbeiter, die in öffentlichen Repos mit dem internen Build arbeiten: ja, by Design. Für alle anderen: kein Hinweis auf dieses Verhalten. Die Unterscheidung ist wichtig.

Wo kann ich den geleakten Claude-Code-Quellcode selbst lesen?

Anthropic hat die npm-Paketversion zurückgezogen und DMCA-Takedowns gegen GitHub-Mirrors verfolgt. Archivierte Analysen von Forschern wie Kuberwastaken und Alex Kim dokumentieren, was gefunden wurde.

Hat Anthropic sich zum Undercover-Modus geäußert?

Anthropics Sprecher bestätigte, dass der breitere Leak „ein Verpackungsproblem beim Release, verursacht durch menschlichen Fehler, kein Sicherheitsverstoß” war. Zum Zeitpunkt des Schreibens wurde keine spezifische Stellungnahme zum Undercover-Modus abgegeben.

Was mich immer wieder beschäftigt, ist, wie viel davon ohne den Leak unsichtbar geblieben wäre. Das Verhalten selbst mag vertretbar sein. Aber „vertretbar wenn untersucht” und „untersucht” sind zwei verschiedene Dinge. Open-Source-Gemeinschaften haben generell entschieden, dass sie lieber Letzteres hätten.

Anthropic wahrscheinlich auch, im Prinzip. Es hat dieses Prinzip hier nur nicht angewendet.

Frühere Beiträge:

- GPT-5-Modellversionen erklärt: Was Entwickler wissen sollten

- GPT-5.4 vs GPT-5.3: Was sich für Entwickler tatsächlich geändert hat

- GPT-5.4 für Entwickler: API, Fähigkeiten und reale Anwendungsfälle

- DeepSeek V4 GPU & VRAM-Anforderungen: Was es braucht, um moderne KI-Modelle zu betreiben

- Gemini 3.1 Flash Lite: Geschwindigkeit, Architektur und Anwendungsfälle