GPT-5.4 vs GPT-5.3: Was sich wirklich ändern könnte

Leak-Signale zu GPT-5.4 deuten auf schnellere Inferenz und verbesserte Bildverarbeitungsfunktionen hin. So könnte es sich für Entwickler von GPT-5.3 unterscheiden.

Hallo, ich bin Dora. Ich habe mich dabei ertappt, eine lang laufende Agent-Schleife zu beaufsichtigen. Nichts Dramatisches, nur dieses langsame, nervöse Gefühl, wenn ein Modell immer wieder nach einem weiteren Tool-Aufruf fragt, dann noch einem. Es hat mich daran erinnert, wie viel meines Arbeitstages in den Randbereichen stattfindet: den Pausen, den Wiederholungsversuchen, den „Hat es das Dokument eigentlich gelesen?”-Momenten.

Also verbrachte ich den Nachmittag damit, meine Notizen zu GPT-5.3 durchzugehen und die frühen GPT-5.4-Diskussionen zu überfliegen. Einige der frühen Leak-Diskussionen rund um die Modellarchitektur und Latenzhints sind in dieser Aufschlüsselung des GPT-5.4-Leaks zusammengefasst. Nicht um dem nächsten großen Ding nachzujagen, sondern um eine kleinere Frage zu beantworten: Würde irgendetwas davon die nervösen Teile meines Workflows reduzieren? Dies ist mein laufendes Protokoll von GPT 5.4 vs. GPT 5.3, mit dem, was ich gemessen habe, was glaubwürdig erscheint und wo ich noch skeptisch bin.

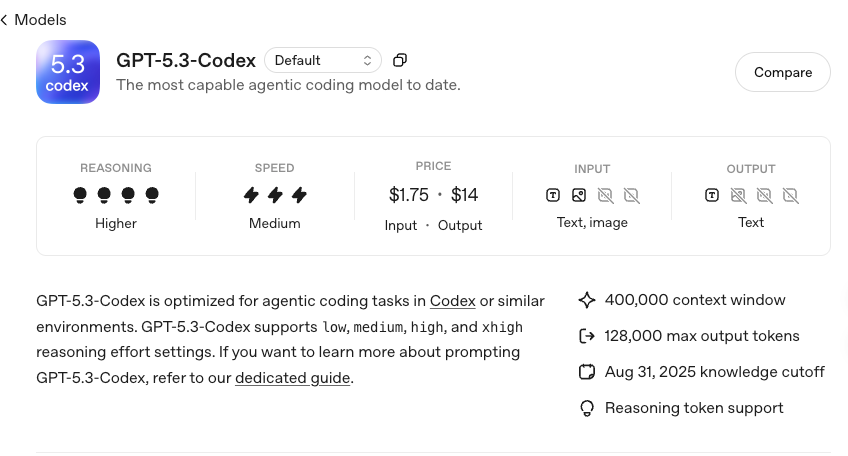

GPT-5.3-Fähigkeiten: Die aktuelle Ausgangslage

Reasoning und Tool-Use-Performance

Ich nutze GPT-5.3 seit Mitte Januar 2026 für drei konstante Aufgaben: Produktrecherchen zusammenfassen, Support-Threads triagieren und kleine Skripte gerüstbauen. Kurzgefasst: Es bewältigt mehrstufiges Reasoning gut, wenn ich ihm eine klare Struktur gebe. Wenn ich explizit über Rollen, Zustand und Abbruchbedingungen bin, arbeitet es durch, ohne abzuschweifen.

Beim Tool-Einsatz war der Funktionsaufruf stabil. Ich stütze mich auf OpenAIs Funktionsaufruf-Muster und Standard-Tool-Schemas, keine Überraschungen dort. Mit klar definierten Tools (Suche, Retrieval, ein einfaches Vektor-Lookup) bleibt 5.3 ordentlich. Bei einem 20-E-Mail-Triage-Durchlauf lag der Durchschnitt bei 1,7 Tool-Aufrufen pro Thread, verglichen mit 2,4 bei meinem älteren Setup. Das reduzierte die kleinen „Was jetzt?”-Lücken. Der Haken: Wenn meine Tool-Beschreibungen vage werden, versucht es, dies mit mehr Aufrufen zu kompensieren.

Was mir am meisten auffällt, ist seine Toleranz für partiellen Kontext. Wenn ich nur den relevanten Abschnitt und eine schlanke Zustandszusammenfassung übergebe, denkt es trotzdem gut. Wenn ich aber viele locker verwandte Notizen einwerfe, beginnt es zu zögern.

Coding und Agent-Workflow-Unterstützung

Beim Code ist 5.3 zuverlässig bei kleinen bis mittleren Refaktorierungen. Es ist gut darin, Diffs mit klaren Erklärungen zu generieren und kann einen konsistenten Stil beibehalten, wenn ich einen kurzen Styleguide vorlege. Wo es langsamer wird, sind dateienübergreifende Änderungen, die ein enges Bewusstsein für Abhängigkeiten erfordern. Ich wechsle normalerweise zu einem Zwei-Durchlauf-Muster: Im ersten Durchlauf lasse ich es die Änderungen skizzieren, im zweiten Durchlauf werden sie Datei für Datei angewendet. Das verhindert, dass es übermütig Dinge anfasst, die es nicht sollte.

In Agent-Workflows verhält sich 5.3 am besten, wenn ich die Rekursion begrenze und jede Entscheidung protokolliere. Ich habe mich auf eine Drei-Schritte-Schleife eingependelt: Planen → Tool aufrufen → Reflektieren. Mehr als das, und es wird geschwätzig. Ich ermuntere es auch dazu, kompaktes JSON für den Zustand auszugeben, was Parsing-Fehler reduziert. Das ist alles nicht magisch, es sind nur Leitplanken, die die Schleife weniger anspruchsvoll machen.

Bekannte Einschränkungen

- Es kann Anweisungen doppelt verarbeiten, wenn ich Systemregeln mit langen Benutzeraufgaben mische: Ich habe gelernt, die wichtigsten Einschränkungen am Ende des Prompts zu wiederholen.

- Es besteht manchmal darauf, Eingaben erneut zusammenzufassen, die ich bereits zusammengefasst habe, was Token und Zeit aufbläht.

- Bei visuellen Aufgaben (Screenshots, UI-Mockups) ist es passabel beim Beschriften und Beschreiben, übersieht aber kleinen Text und feine Layoutlogik. Es hat mehr als einmal Umschalter mit Schaltflächen verwechselt.

- Unter Druck (knappe Token) bevorzugt es sichere Allgemeinplätze gegenüber präzisen Kanten. Das sehe ich bei der Auswertung von Fehlerprotokollen: Es nennt wahrscheinliche Ursachen, zögert aber, sich ohne mehr Kontext festzulegen.

Das ist mein Arbeitsbild von 5.3: zuverlässig, wenn ich explizit bin, etwas unruhig, wenn ich es nicht bin.

Was die GPT-5.4-Signale auf Veränderungen hindeuten

Ich habe bis zum 5. März 2026 keinen direkten Zugang zu 5.4. Was folgt, stammt aus frühen Leak-Threads, einigen glaubwürdigen Entwicklernotizen in privaten Foren und Mustern, die ich gelernt habe zu beachten, wenn eine Modellfamilie einen kleinen Schritt vorwärts macht. Ich kennzeichne jeden Punkt als beobachtungsbasiert, Leak-basiert oder spekulativ.

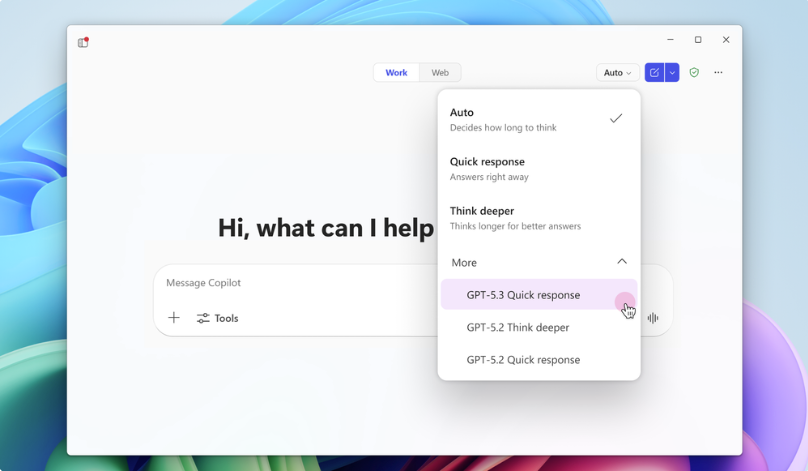

Inferenzgeschwindigkeit, Implikationen des Fast-Modus

Leak-basiert: Mehrere Berichte erwähnen einen „Fast Mode” oder eine Niedriglatenz-Stufe für kurzformiges Reasoning. Falls wahr, ist das weniger für den reinen Durchsatz relevant als für das Agent-Tempo. Ein 20–30-prozentiger Rückgang der First-Token-Latenz verschiebt das Gefühl einer Schleife von schwerfällig zu reaktionsschnell. Benchmarks, die GPT-5 mit Modellen wie DeepSeek und GLM vergleichen, zeigen, wie stark Latenz und Kosten die Entwickler-Workflows in der Praxis prägen können. In meinem 5.3-Setup liegt die First-Token-Latenz bei durchschnittlichen Prompts bei etwa 600–900 ms: Selbst 150–200 ms weniger würden Tool-Ketten weniger stockend machen. Ich würde erwarten, dass dieser Fast-Modus etwas Tiefe eintauscht – nützlich für Routing, Klassifizierung oder schnelle Validierung vor einem schwereren Durchlauf.

Beobachtungsbasiert: Wenn 5.4 wirklich eine Geschwindigkeitsstufe hinzufügt, werde ich Workflows wahrscheinlich aufteilen: schnell klassifizieren → routen → tiefer Durchlauf. Das ist bereits ein gängiges Muster: Die Geschwindigkeit macht es nur reibungsloser.

Verbesserungen bei der Bildverarbeitung

Leak-basiert: Bessere OCR für kleinen Text und stabileres Layout-Reasoning. Die Hinweise deuten auf verbesserte Erkennung für kontrastarmen UI-Text und feinere Bounding-Box-Logik hin. Falls zutreffend, würde das zwei meiner 5.3-Reibungspunkte beheben: winziger Text in Screenshots und die Unterscheidung von UI-Steuerelementen.

Beobachtungsbasiert: Das würde das Hin und Her ersparen, das ich bei der Validierung von Interface-Wireframes betreibe. Momentan lasse ich Screenshots durch einen separaten OCR-Schritt laufen, wenn 5.3 die Schultern zuckt. Wenn 5.4 diese Umwege reduziert, entferne ich ein Tool aus der Kette.

Mögliche Kontextfenster-Erweiterung

Spekulativ: Kleine Verbesserung des nutzbaren Kontexts oder bessere Beibehaltung über lange Prompts hinweg. Ich meine keine Headline-Zahlen: Ich meine praktischen Abruf in der zweiten Hälfte eines langen Gesprächs. Wenn 5.4 Aufgabeneinschränkungen enger hält, ohne dass ich sie neu formuliere, ändert das, wie ich den Zustand strukturiere. Weniger Erinnerungen, weniger Token-Steuern. Wenn es nur eine rohe Fenstervergrößerung ohne besseren Abruf ist, ist der Nutzen geringer.

Das glaube ich, wenn ich weniger „Neuinterpretationen” spät in Durchläufen sehe. Bis dahin bin ich vorsichtig.

Direkter Vergleich (Tabelle)

Ich trenne lieber, was ich gemessen habe, von dem, was ich nur gehört habe. Drei kurze Tabellen, jedes Mal dieselbe Perspektive.

Bestätigte Fähigkeiten

| Bereich | GPT-5.3 | GPT-5.4 |

|---|---|---|

| Tool-Einsatz / Funktionsaufruf | Stabil mit klaren Schemas: 1–3 Aufrufe pro Aufgabe typisch in meinen Durchläufen | Nicht bestätigt |

| Reasoning unter Token-Druck | Degradiert zu Allgemeinplätzen: profitiert von neu formulierten Einschränkungen | Nicht bestätigt |

| Vision (UI-Screenshots) | Übersieht kleinen Text: verwechselt einige Steuerelemente | Nicht bestätigt |

| Agent-Schleifenverhalten | Funktioniert am besten mit 2–3-Schritte-Schleifen und expliziten Stoppbedingungen | Nicht bestätigt |

| Coding über Dateien hinweg | Benötigt Zwei-Durchlauf-Strategie für Sicherheit: gute Diff-Erklärungen | Nicht bestätigt |

Referenzen: Ich folge den Mustern in OpenAIs Funktionsaufruf-Dokumentation und Tool-Definitionen in der API-Referenz. Für Interessierte sind die offiziellen Docs ein guter Ankerpunkt: OpenAI API: function calling und tool usage.

Leak-basierte Signale

| Bereich | GPT-5.3 | GPT-5.4 (Leak-basiert) |

|---|---|---|

| Inferenzgeschwindigkeitsstufe | Nur Standardmodi | Fügt eine schnellere, flachere Stufe für Niedriglatenz-Antworten hinzu |

| Vision-OCR | Ausreichend, kämpft mit winzigem/kontrastarmen Text | Verbesserte Kleintext-Genauigkeit und Layout-Verarbeitung |

| Kosten pro Token | Aktuelle veröffentlichte Tarife | Leichte Reduzierung in der Fast-Stufe (nicht verifiziert) |

Quellenqualität: Gemischt. Einige Details stimmen mit Mustern aus früheren Releases überein: Keine ist bestätigt.

Spekulative Verbesserungen

| Bereich | GPT-5.3 | GPT-5.4 (spekulativ) |

|---|---|---|

| Kontextbeibehaltung | Benötigt häufige Erinnerungen an Einschränkungen | Hält Einschränkungen länger mit weniger Wiederholungen |

| Tool-Einsatz-Effizienz | Ruft manchmal zu viel auf, wenn Schema vage ist | Bessere Aufruf-Sparsamkeit bei ähnlichen Prompts |

| Langfristige Planung | Zögert, über 3–4 Schritte hinaus zu planen | Etwas stabilere mehrstufige Planung |

Warum diese Änderungen für Entwickler wichtig sind

Auswirkungen auf das Agent-Schleifendesign

Wenn der „Fast Mode” existiert, würde ich Schleifen so umgestalten, dass günstige Gewissheit vorgezogen wird. Schnell klassifizieren, dann verzweigen: Einfache Aufgaben werden im Fast Mode erledigt: Komplexe eskalieren zum Volltiefen-Modell. Allein das kann die menschliche Beaufsichtigung reduzieren. In meinem aktuellen 5.3-Stack verbringe ich Energie damit, Schleifen vom Spiralisieren abzuhalten. Eine Geschwindigkeitsstufe könnte diese Energie in klareres Routing umlenken.

Bessere Vision-Verarbeitung würde meine UI-Analyse-Pipeline vereinfachen. Derzeit verwende ich für Mockups eine Drei-Schritte-Kette: Grundbeschriftung → OCR-Durchlauf → Layout-Prüfung. Wenn 5.4 die ersten beiden zusammenführt, entferne ich den OCR-Schritt und behalte nur den Layout-Validator. Das ist ein Tool weniger zum Warten und weniger Fehlerquellen.

Wenn sich die Kontextbeibehaltung verbessert, werde ich die Erinnerungstrommel in Prompts reduzieren. Ich würde einen kleinen, unveränderlichen Regelblock behalten und dem Modell vertrauen, ihn weiter in den Durchlauf zu tragen. Weniger Gerüstbau, weniger Token, gleiche Ergebnisse.

Kosten-Leistungs-Abwägungen

Eine Geschwindigkeitsstufe kommt normalerweise mit einem Qualitätspreis. Das behandle ich als Feature, nicht als Bug. Verwenden für:

- Routing und leichte Validierung (haben wir das Datum geparst, ja/nein?),

- frühe Ausstiege (ist das eine bekannte FAQ?),

- Gesundheitsprüfungen des abgerufenen Kontexts (erwähnt dieser Abschnitt die Entität überhaupt?).

Für alles andere – Reasoning, das Ausgaben formt – zahlt man für Tiefe. Wenn 5.4s Fast-Stufe günstiger pro Token ist, würde ich kleine Einsparungen bei volumensintensiven Aufgaben erwarten, aber der eigentliche Gewinn ist Latenz. Kosten pro Aufgabe könnten leicht sinken: die wahrgenommene Geschwindigkeit könnte sich stark verbessern.

Wenn sich an der Preisgestaltung nichts ändert, würde ich die Arbeit trotzdem aufteilen. Selbst mit 5.3 zahlt sich die Verwendung eines kleineren/günstigeren Modells für das Routing oft aus. Eine native Fast-Stufe würde nur den Klebecode reduzieren.

Migrationsüberlegungen

- Mit Shadow-Tests beginnen. Dieselben Prompts durch 5.3 und 5.4 (wenn verfügbar) laufen lassen und Ergebnisse vergleichen. Den Live-Pfad erst umschalten, wenn man einige Dutzend Grenzfälle gesehen hat.

- Tool-Schemas strikt halten. Vage Beschreibungen blähen die Aufrufzahlen bei 5.3 auf: Das werden sie wahrscheinlich auch bei 5.4 tun, schnell oder nicht.

- Token-Druck protokollieren. Viele „Regressionen” sind nur engere Prompts. Fensternutzung verfolgen und Boilerplate bereinigen.

- Prompts versionieren. Ich halte ein kleines Changelog in meinen Systemnachrichten. Wenn 5.4 sich mit schlankeren Erinnerungen besser verhält, will man einen Nachweis darüber haben, was man entfernt hat.

- Vision still beobachten. Wenn man auf Screenshots angewiesen ist, mit kontrastarmen Text, beengter UI und ungewöhnlichen Schriften testen. Ein gutes Testset schlägt ein Dutzend Anekdoten.

Für kleine Teams ist die sicherste Vorgehensweise schrittweise: Einen engen Workflow pilotieren (Routing, Triage), dann ausweiten.

Für Solo-Entwickler würde ich eine Gewohnheitsänderung versuchen: Am Anfang der Prompt-Kette ein „Schnell oder voll?”-Gate einfügen. Selbst wenn 5.4 keinen Fast Mode liefert, hilft die Disziplin.

Wichtiger Vorbehalt (Vergleich basiert auf Leak-Signalen)

Alles über GPT-5.4 hier ist aus zweiter Hand, bis es ein offizielles Release oder Dokumentation gibt. Die 5.4-Teile sind eine Mischung aus Leak-basierten Signalen und sorgfältigem Schätzen aus vergangenen Updates. Wenn und wenn 5.4 real ist, werde ich dieselben Aufgaben erneut durchführen und das hier aktualisieren. Betrachten Sie das vorerst als eine Karte, die mit Bleistift gezeichnet ist, nicht mit Tinte.

Ein letzter Gedanke: Selbst kleine Geschwindigkeitsverbesserungen können einen Workflow entspannen. Wenn das alles ist, was 5.4 bringt, nehme ich es gerne.