SeedVR2 線上版:如何使用

了解 SeedVR2 線上版的運作方式、支援的工作流程,以及在使用它進行放大任務前的注意事項。

嗨,我是 Dora。有人在我追蹤的一個 Discord 討論串裡提到了 SeedVR2,說他們「在線上用過」。於是我去搜尋,然後立刻撞上了一堵牆——Gradio demo、第三方封裝、API 測試平台,以及至少一個看起來很可疑、肯定和 ByteDance 研究團隊毫無關係的網站。

有件事沒有人一開始就說清楚:根本沒有一個叫做 「SeedVR2 Online」 的單一產品。這個詞彙至少有三種不同的含義,取決於你最終落腳在哪裡。如果你不知道自己實際上在用哪一個,你得到的結果——以及你的期望——都會偏差。

讓我來把這件事釐清。

「SeedVR2 Online」通常指的是什麼

SeedVR2 是由 ByteDance Seed 團隊開發的影片修復模型。 它已獲 ICLR 2026 接受,研究程式碼公開可用。這是一個專為通用影片修復設計的單步擴散 Transformer,能夠透過自適應視窗注意力機制處理高解析度輸入。這才是這個模型本身。

但把「SeedVR2 online」當作搜尋詞,搜出來的結果和模型本身截然不同。類似的混淆也發生在較新的 AI 影片生成模型如 Seedance 2.0 上,人們常常搜尋「線上版本」而非底層模型。搜尋結果顯示的是存取模型的入口點,而非模型本身。兩者並不相同。

託管 Demo、封裝工具或工作流程服務

當有人說他們「在線上用了 SeedVR2」,他們可能指的是以下其中一種:

託管的 Gradio demo。 ByteDance 在 Hugging Face Spaces 上發布了官方 demo。它運行 SeedVR2-3B 模型,並透過類似 API 的介面支援圖片和影片輸入。這是最接近「官方」線上版本的東西——但它是研究 demo,不是產品。排隊等待時間可能很長,可用性也無法保證。

第三方封裝工具。 開發者們圍繞同一底層模型建立了 ComfyUI 節點、Replicate 部署以及獨立工具。這些運行在別人的基礎設施上,有時免費,有時需要點數或付費。它們可能看起來很精緻,但它們不是 ByteDance 的產品。

平台整合。 部分 AI 生成平台已將 SeedVR2 加入其模型目錄作為選項之一。你運行的是相同的模型權重,但透過他人的介面和計費系統。

為什麼使用者對「什麼是官方」感到困惑

這種困惑是可以理解的。類似的不確定性也出現在人們閱讀**現代 AI 影片模型的比較**時,並假設每個模型都有單一的官方介面。該模型以 Apache 2.0 授權開源。 這意味著任何人都可以託管它、封裝它,並稱其為 SeedVR2。沒有商標把關或認證流程。

因此,當你搜尋「SeedVR2 online」時,你可能會找到:

- ByteDance-Seed 運營的真正 Hugging Face Space

- 社群的 ComfyUI 部署

- 恰好使用 SeedVR2 作為引擎的第三方影片升頻服務

- 名稱中含有 SeedVR2 但毫不相關的東西

在你上傳影片素材之前,值得花 30 秒確認一下你實際上在哪個平台上。

SeedVR2 Online 值得嘗試的情況

我直說吧。在特定情況下,線上存取 SeedVR2 是合理的。在這些情況之外,它帶來的挫折感可能多於幫助。

快速測試

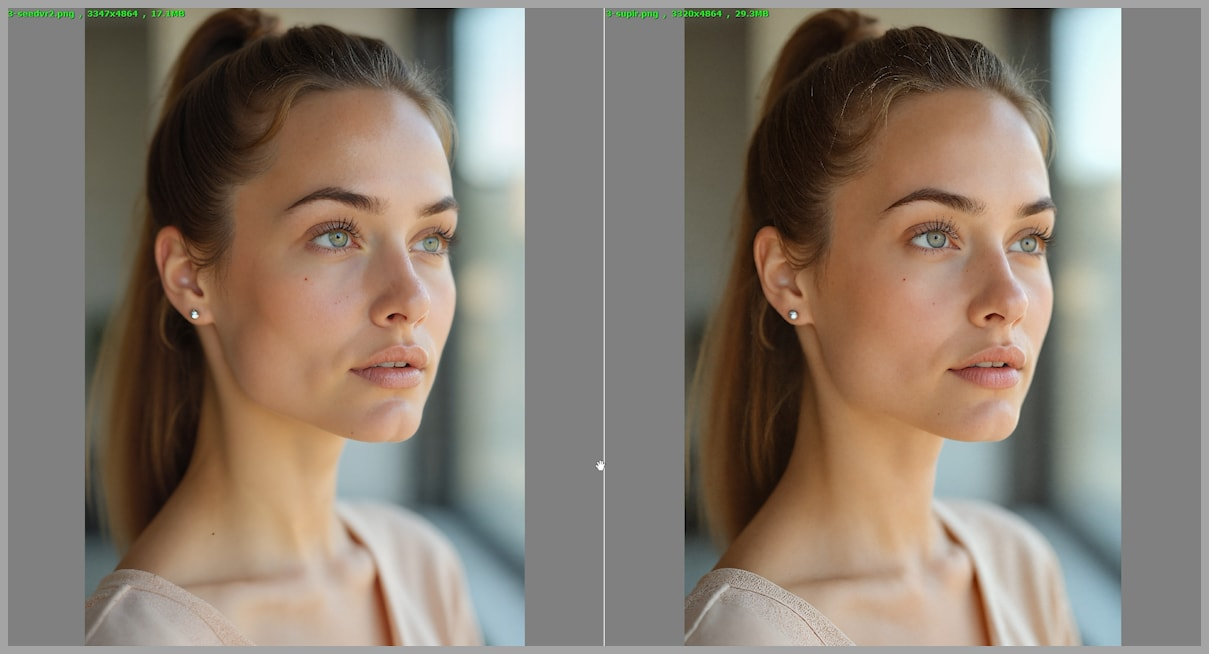

如果你看過輸出範例,想知道模型的風格是否適合你的素材——先在線上試試。你不需要安裝任何東西,不需要 GPU。你可以上傳一段短片,看看返回的結果。

這真的很有用。我在 Hugging Face demo 上測試了一段我一直想清理的劣化素材。周轉時間很慢,但結果在我決定是否建立本地環境之前,告訴了我一切我需要知道的事情。

無需本地環境

在本地運行 SeedVR2 需要相當嚴格的硬體要求。 官方文件指出,單張 H100-80GB GPU 可以處理最多 100 幀的 720p 影片,而 1080p 或 2K 解析度則需要四張 H100-80GB 顯卡。大多數人沒有這些設備。線上存取填補了這個空缺——代價是彈性、速度和控制權。

如果你是一位偶爾需要清理影片的創作者,不想建立本地處理流程,線上選項值得探索。

如何使用 SeedVR2 Online

輸入與輸出基礎

大多數線上存取入口遵循相同的基本模式:

- 上傳你的源影片(通常是 MP4,有時是影格)

- 設定目標解析度或升頻倍數

- 提交並等待

輸出是你片段的修復版本——更清晰,雜訊和壓縮瑕疵減少,並縮放至你的目標解析度。

你在線上可能無法控制的:批次大小、注意力視窗大小、模型變體(3B 對比 7B),或小波色彩校正等後處理選項。這些設定存在於本地工具中。

值得注意的設定

如果介面提供選項,有幾個值得了解:

目標解析度。 該模型專為高解析度輸出設計。不要輸入低於源影片的目標解析度——這只會帶來不必要的處理而沒有任何視覺提升。

色彩校正模式。 部分封裝工具會提供此選項。ComfyUI 實作提供幾種色彩匹配選項,包括描述為「完整感知色彩匹配以達到最高保真度」的「lab」模式,以及「基於頻率的自然色彩」的「wavelet」模式。如果你看到這些選項,對於不熟悉的素材,「wavelet」通常是更安全的選擇。

片段長度。 盡量保持測試片段簡短——如果可以的話,控制在 30 秒以內。長片段會拖慢所有人的排隊速度,如果出現問題也更難排查。

你能期待什麼,以及不能期待什麼

效能限制

線上工具會進行限流,尤其是免費的那些。如果你使用的是在有限算力上託管的共享 demo,預期會有:

- 尖峰時段的排隊等待

- 即使是短片也需要數分鐘的處理時間

- 偶爾的逾時或任務中斷

這是排隊和基礎設施問題,不是模型問題。

品質預期

模型本身是有能力的。ByteDance-Seed 自己的模型說明指出,對於劣化程度很輕的輸入——例如 720p AIGC 影片——模型有時會過度生成細節,偶爾導致過度銳化的結果。在生成式影片流程中也可能出現動態瑕疵,這就是為什麼許多創作者在使用修復模型時要學習**如何修復 AI 生成影片中的閃爍和抖動**。這是一個真實的限制,在你處理任何重要素材之前值得了解。

對於確實存在劣化的素材——雜訊、模糊、壓縮瑕疵——結果通常會有明顯改善。對於已經很乾淨的素材,模型實際上可能讓畫面看起來不那麼自然。

為什麼線上使用不等同於完整工作流程使用

差距是顯著的。例如,透過 ComfyUI 的本地部署讓你可以控制批次大小、在 3B 和 7B 模型變體之間切換、啟用 GGUF 量化以降低 VRAM 使用,並將 SeedVR2 與其他節點串聯成處理流程。這種程度的控制在大多數線上介面中並不存在。

如果你正在建立一個可重複的流程——比如說,定期處理拍攝素材——線上存取很快就會碰到天花板。

SeedVR2 Online 對比 API 對比工作流程設定

| 類別 | 線上 Demo | API / 平台 | 本地工作流程 |

|---|---|---|---|

| 所需設定 | 無 | 極少 | 大量 |

| 速度 | 慢(共享) | 中等 | 快(使用你的 GPU) |

| 控制程度 | 低 | 中等 | 高 |

| 費用 | 免費 / 點數 | 按使用付費 | 硬體成本 |

| 可靠性 | 不穩定 | 較穩定 | 穩定 |

| 批次處理 | 否 | 有時支援 | 是 |

最適合快速使用

線上 demo 和託管平台適合一次性測試、快速比較,以及沒有本地高效能機器的情況。由 ByteDance-Seed 託管的 SeedVR2-3B Hugging Face Space 是最接近官方接觸點的選項,如果你想不做任何承諾地試用模型的話。

最適合可重複的生產使用

如果你需要定期處理素材,ComfyUI-SeedVR2_VideoUpscaler 節點是大多數創作者最終採用的工具。它由社群建立,但持續維護,並支援 GGUF 量化,使其在消費級 GPU 上也能使用。供參考,官方模型權重和架構細節記錄在 GitHub 上的 ByteDance-Seed/SeedVR 儲存庫中。

第一手評價

我透過 Hugging Face demo 和本地 ComfyUI 都運行過 SeedVR2。兩者體驗並不相同。

線上 demo 只適合做一件事:判斷 SeedVR2 是否值得你花時間。它在一次測試中就回答了我的這個問題。但我不會用它來處理任何我真正需要交付的東西。

誰應該嘗試

如果你符合以下情況:

- 你想在安裝任何東西之前測試模型是否適合你的素材

- 你偶爾需要修復一段影片,不需要可重複的處理流程

- 你沒有本地 GPU 資源,能接受較慢的周轉時間

誰應該跳過

如果你符合以下情況:

- 你每週需要處理超過少量的片段

- 你需要可重現的一致結果

- 你在意控制輸出銳度、色彩匹配或模型大小

對於任何對這個模型在研究領域所處位置認真感興趣的人,arXiv 上的原始 SeedVR2 論文(2506.05301)值得一讀——它比大多數學術論文更易讀,並清晰地解釋了單步修復方法。

「SeedVR2 online」這個詞彙可能還會讓人困惑一段時間。沒有單一的產品可以指向。有一個模型、幾個官方 demo,以及越來越多圍繞它建立的社群工具。這不是壞事——只是意味著在你決定是否值得花時間之前,你需要知道自己究竟在走哪扇門。再見,親愛的朋友們~