視頻換臉技術詳解:原理與 API 指南

深入了解視頻換臉的底層原理——以及如何透過 API 調用。涵蓋完整流程、輸入要求與常見失敗模式。

嗨,我是 Dora。說實話——我第一次嘗試呼叫影片換臉 API 時,收到的回應看起來幾乎是對的。臉確實換上去了。時間差了半秒。光線讓主角看起來略微從內部發光,像個打折的幽靈。

這就是影片換臉技術的本質。從外觀看來似乎很簡單——**把臉 A 換到身體 B 上,**就搞定了——但當你超越示範片段、嘗試建立真正能用的東西時,你就會發現底層實際上有多少環節在運作。理解這些環節,才是輸出結果看起來精緻還是讓用戶皺眉的關鍵差異。

本指南涵蓋影片換臉的實際運作原理、各種不同的技術方法、API 在能做任何有用的事之前需要什麼,以及如何處理那些遲早會找上你的失敗情況。

影片換臉實際上做了什麼

讓我把這個說清楚,因為很多說明文章都跳過了真正重要的部分。

影片換臉不是濾鏡。 它不是疊加在畫面上的遮罩。它在相當深層的技術層面所做的是:偵測影片每一幀中的人臉,映射其幾何結構,提取來源人臉的身份特徵,然後將來源身份混合到目標的臉部結構上,同時保留目標的動作、光線和表情。

這是三個不同的問題依序發生。

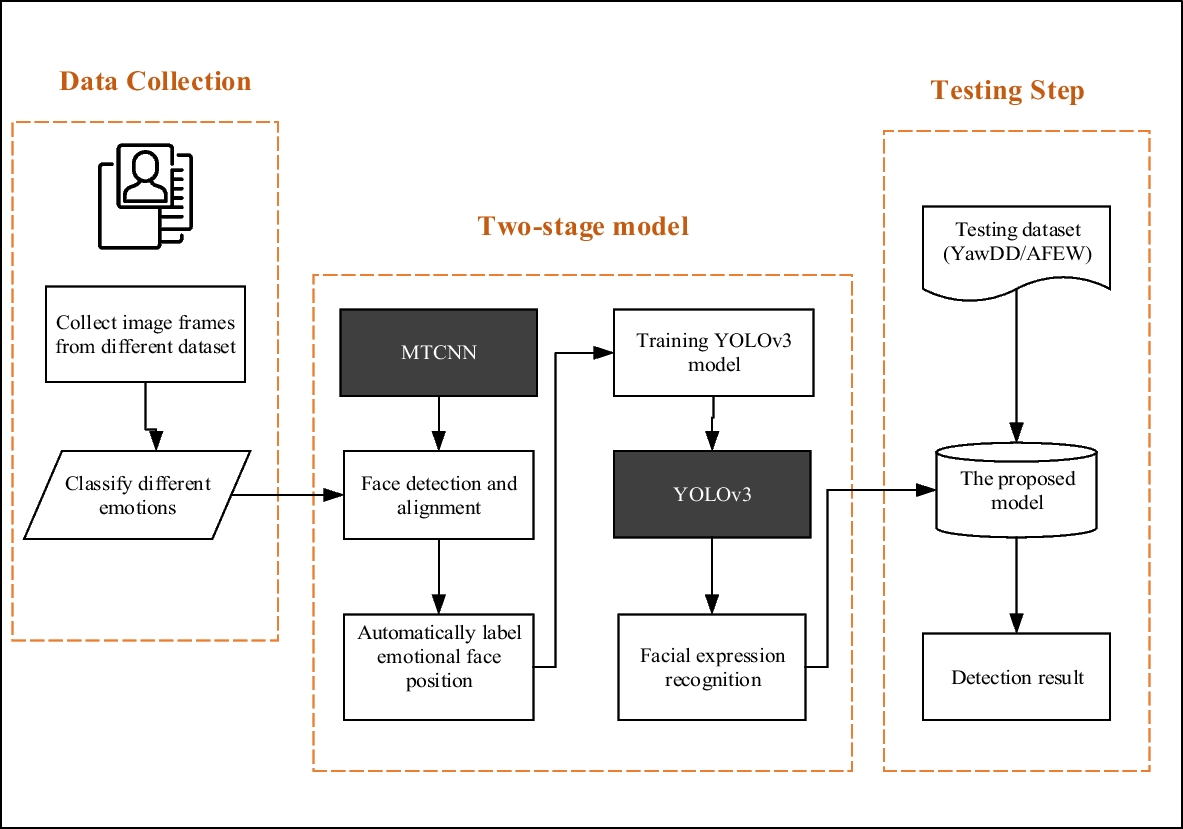

偵測 → 對齊 → 混合流程

偵測是模型在幀中找到人臉的步驟。聽起來簡單,實則不然。部分遮擋的臉、大角度側轉的臉,或快速移動的臉,都會造成偵測失敗。大多數生產系統使用多任務級聯卷積網路的變體——你可以在這份人臉偵測深度學習指南中了解基礎的 MTCNN 方法——不過更新的架構已經在早期基準測試上有了顯著進步。

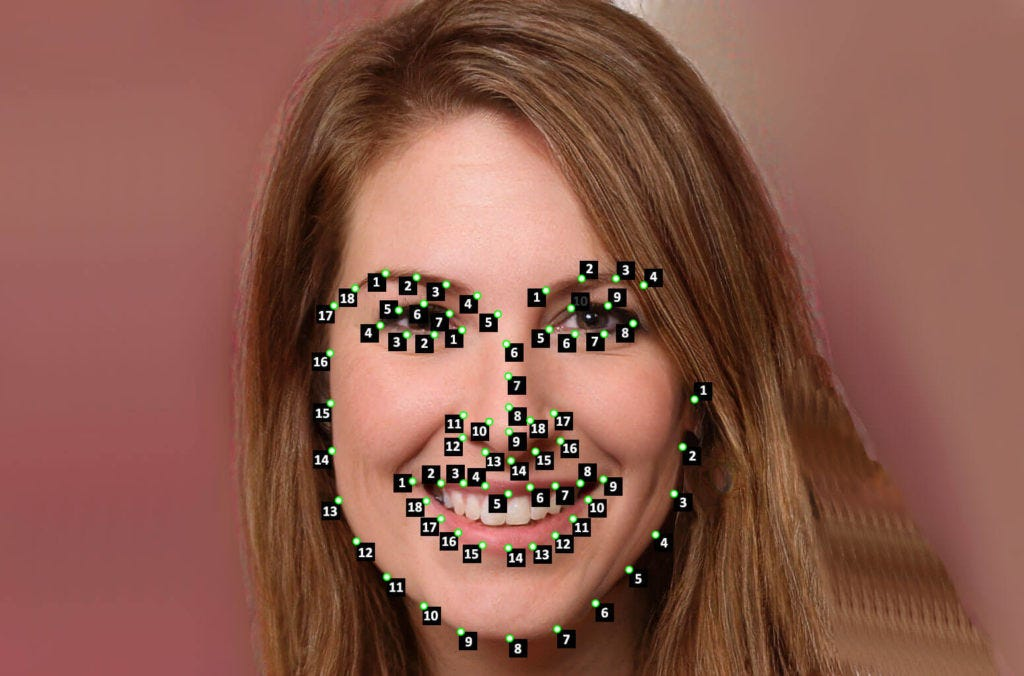

對齊是大多數人不會想到、但真的非常關鍵的步驟。一旦偵測到人臉,模型會識別臉部特徵點——眼睛、鼻尖、嘴角——並用它們將臉部標準化到正規的位置和比例。若沒有這個步驟,換臉結果就像有人把臉以略微錯誤的角度貼上去,然後希望沒人注意到。大家總是會注意到的。

混合是實際發生身份轉換的步驟。模型提取來源人臉的身份特徵,將其投影到目標臉部幾何結構上,然後將結果合成回幀中。現代方法使用生成對抗網路(GAN)來完成這個步驟——一個生成混合臉部的生成器,以及一個評估真實感的判別器——這就是為什麼在開始除錯輸出之前,了解基於 GAN 的 deepfake 生成原理是非常有用的背景知識。

輸出品質的真正含義

有件事讓我早期感到困惑:換臉輸出的「品質」不是一個單一數字。 它至少涉及三個獨立的面向。

身份保留——輸出結果是否真的看起來像來源人臉,而不只是兩張臉的模糊平均值?

時間一致性——臉部在各幀之間看起來是否相同,還是有細微的閃爍?

照片真實感——結果看起來是否屬於場景,還是像是後期合成的?

你可以有出色的身份保留,同時有糟糕的時間一致性。你可以有精美的照片真實感,同時身份轉換效果欠佳。大多數 API 提供設定或品質等級,在這些面向之間進行取捨。知道哪一個對你的使用場景最重要,可以幫你省下很多困惑。

影片換臉的技術方法類型

並非所有影片換臉模型的運作方式都相同。類似的架構差異存在於現代 AI 影片生成模型如 Seedance 2.0 之中,不同方法對時間一致性和動作建模的處理方式大相徑庭。在選擇工具或 API 之前,有兩個重要的維度需要理解。

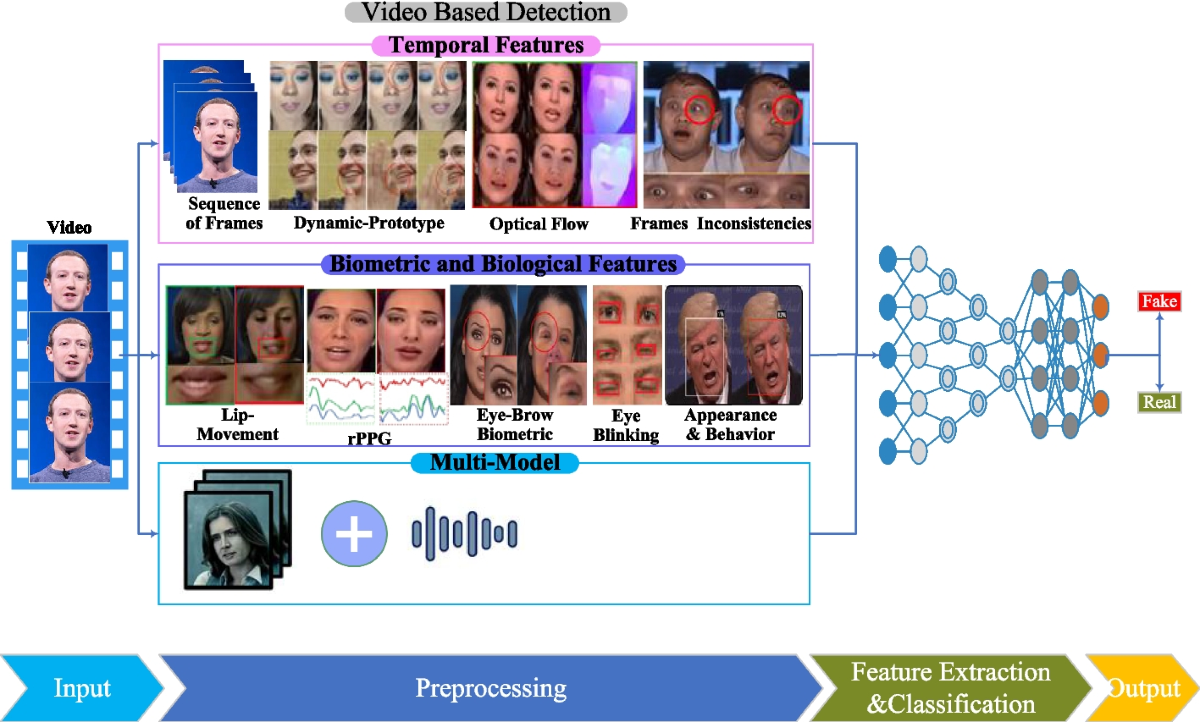

逐幀處理 vs. 時序感知模型

逐幀處理模型獨立處理影片的每一幀。它們通常速度更快、實作更簡單,但它們不考慮影片是一系列相關圖像這個事實。結果:幀之間出現細微的閃爍,特別是在臉部邊緣或低光環境中。

時序感知模型在處理每一幀時,會考慮前後幀的內容——本質上是理解動作並在片段中保持一致性。類似的取捨也出現在領先 AI 影片模型的比較中,穩定性和動作真實感是主要的差異化因素——本質上就是理解動作並在片段中保持一致性。輸出結果更流暢、更穩定,但這些模型更重、更慢。對於超過幾秒鐘或打算在大螢幕上近距離觀看的任何內容,時序感知模型的延遲代價是值得的。

我的真實體驗:如果你在做原型或生成縮圖,逐幀處理就夠了。如果你在建立讓人們在全尺寸螢幕上觀看的內容,你會後悔那些閃爍問題。

單臉 vs. 多臉

單臉模型更簡單,對其特定任務通常品質更高。如果你的使用場景涉及畫面中一張清晰可見的臉——這涵蓋了大多數生產場景——這是正確的起點。

多臉模型可以偵測並替換單一幀中的多張臉。它們對於合奏鏡頭、團體畫面,或者你無法完全控制輸入影片的場景很有用。取捨是它們計算成本更高,也更容易發生錯誤的臉部分配——也就是說,模型把錯誤的臉換到了錯誤的身體上。在你發送一個四人片段卻得到無意間超現實的結果之前,這一點值得了解。

呼叫 API 之前:你需要準備什麼

這是大多數人浪費時間的地方。不是因為 API 很難,而是因為輸入要求比文件通常說明的更為具體。

輸入要求(格式、解析度、片段長度)

大多數影片換臉 API 期望:

- 影片格式:H.264 編碼的 MP4 是最安全的預設選擇。有些 API 也接受 WebM 或 MOV,但 H.264/MP4 是最廣泛支援的格式。

- 解析度:720p 是獲得可接受換臉品質的實際最低要求。1080p 為模型提供更多臉部細節。低於 480p,大多數模型會開始產生明顯的偽影——臉部區域的像素數量根本不足以進行乾淨的混合。

- 片段長度:許多 API 將同步處理上限設為 30–60 秒。較長的片段需要透過 webhook 回調提交非同步任務。在設計請求處理架構之前,先了解你的片段屬於哪個類別。

- 來源圖片:對於你要換入的臉,通常一張光線良好的正面照片就足夠了。有些模型也接受影片來源,但光線均勻的清晰靜態圖片通常能產生更一致的身份轉換效果。

臉部角度和光線限制

在此做個現實確認:這些模型並不神奇。

臉部角度:大多數模型在偏離正面視角約 30–35 度以內能正常運作。超過這個範圍,特徵點精確度開始下降,進而導致對齊錯誤,最終產生混合偽影。側臉通常不被支援或產生無法使用的輸出。如果你的來源畫面中的人物經常看向鏡頭之外,請相應降低你的品質預期。

光線:強烈的定向光線——側面打光的臉、造成深眼影的強烈頭頂光線——是混合步驟更難以令人信服地處理的情況。模型需要調和來源人臉中的光線與目標幀中的光線,兩者差異越大,接縫就越明顯。

我不是說要避免昏暗的畫面。我是說:如果你在生成來源素材且有任何控制空間,均勻的光線將有意義地改善你的輸出品質。

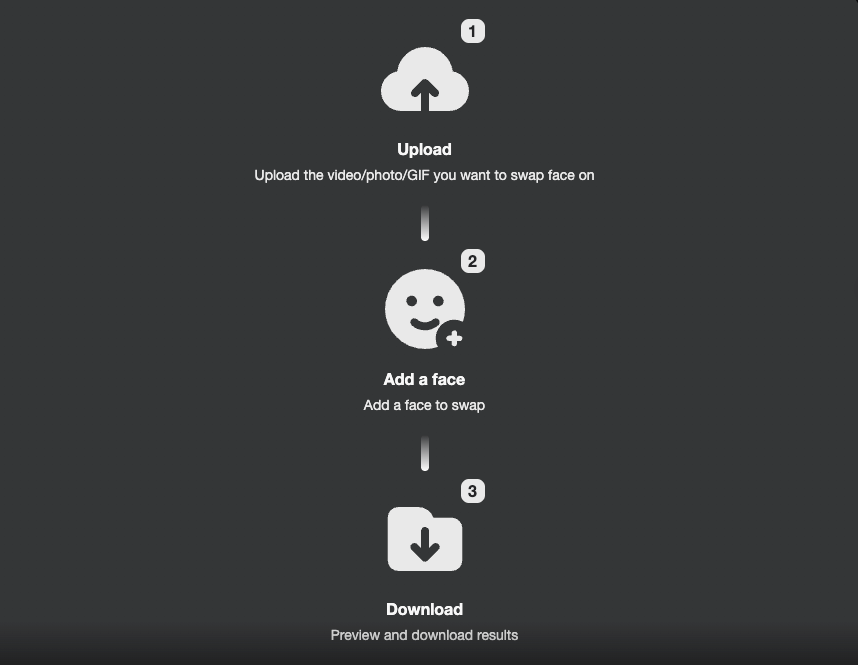

API 工作流程逐步說明

讓我們進入實際操作。以下是影片換臉 API 呼叫的典型流程。

身份驗證

幾乎每個生產 API 都使用 Bearer Token 身份驗證。你在註冊時會收到一個 API 金鑰,並將其作為標頭傳遞:

Authorization: Bearer YOUR_API_KEY這是標準做法,符合 OWASP REST 安全備忘單等資源的安全指引。以下幾件事值得在一開始就做好:

- 將 API 金鑰儲存為環境變數,絕不硬編碼在程式碼庫中

- 設定金鑰輪換——大多數 API 允許你在不失去帳戶存取權的情況下重新生成金鑰

- 如果可用,使用範圍限定的金鑰,只賦予你的整合實際需要的權限

發送請求

典型的請求主體大致如下:

{

"source_image_url": "https://your-storage.com/source-face.jpg",

"target_video_url": "https://your-storage.com/target-video.mp4",

"output_format": "mp4",

"quality": "high"

}有些 API 直接透過 multipart form-data 接受二進位檔案上傳。其他的只接受指向公開可存取檔案的 URL。請仔細查閱你的 API 文件——這是靜默失敗的常見來源,API 回傳 200 但什麼都沒處理,因為檔案 URL 無法存取。

對於較長的片段,你通常會收到一個任務 ID 而不是直接得到輸出:

{

"job_id": "fswap_a3b92f",

"status": "processing",

"estimated_time_seconds": 45

}輸出處理

輪詢任務狀態端點,或配置 webhook 在處理完成時接收結果。回應將包含處理後影片的下載 URL。這些 URL 通常有時效限制——請在到期時間窗口內(通常是 1–24 小時,視提供商而定)將輸出下載並儲存到你自己的儲存空間。

不要因為狀態是已完成就假設輸出是完美的。務必抽查幾幀。狀態已完成意味著流程執行時沒有崩潰,並不意味著換臉效果很好。

對於生產系統,圍繞這些非同步模式建立穩固的 REST API 整合——適當的錯誤處理、重試邏輯、webhook 驗證——將讓你避免日後一次痛苦的除錯工作。

常見失敗模式與修復方法

這裡是事情變得真實的地方。以下三種情況我都遇到過。

動作故障

表現形式: 換上的臉在幀之間抖動或「跳動」,這個問題與創作者如何修復 AI 生成影片中的閃爍和抖動指南中討論的問題非常相似。

發生原因:沒有時間平滑的逐幀處理。每一幀都被獨立求解,因此特徵點偵測中的細微差異會造成不一致。

修復方法:如果可用,切換到時序感知模型。如果你被鎖定在逐幀 API 中,有些提供商提供後處理穩定化功能——在你的選項中找找看。或者,在將輸入影片發送到 API 之前進行動作穩定化預處理也有幫助。

身份漂移

表現形式:輸出的臉逐漸看起來越來越不像來源,更像是來源和目標的混合——或者只是一張普通人的臉。

發生原因:通常是來源圖片品質問題。如果來源人臉照片解析度低、光線不佳,或以非正面角度拍攝,模型就無法提取可靠的身份特徵。它用能推斷的任何東西來填補空缺,這往往會偏向目標人臉。

修復方法:使用更高品質的來源圖片。正面、均勻光線、臉部區域至少 512×512px。根據我的經驗,這一個改變就能解決大約 80% 的身份漂移情況。

光線不匹配

表現形式:換上的臉看起來像是「貼上去的」——臉部的光線方向或色溫與周圍場景不符。

發生原因:混合模型嘗試協調光線,但能做的有限。來源圖片和目標影片中光線的巨大差異會挑戰合成步驟。

修復方法:

- 如果你能控制來源圖片,在與目標畫面相似的光線條件下拍攝

- 有些 API 提供明確的光線標準化作為參數——將其開啟

- 對於嚴重的不匹配,對輸出進行調色後處理可以幫助將臉部更令人信服地融入場景

那麼結論是什麼?

當你理解影片換臉需要什麼才能成功時,它確實是一項強大的技術。大多數品質問題並不神秘——它們可以追溯到輸入品質、針對使用場景的模型選擇,以及對流程能做到和不能做到什麼的合理預期。把這些搞定,你在除錯那些示範時看起來不錯、生產中卻崩潰的輸出上,花費的時間就會少得多。