Google Gemma 4是什么?架构、基准测试及其重要性

Google Gemma 4是DeepMind迄今为止最强大的开源模型系列,提供四种规模版本,基于Apache 2.0协议,支持多模态输入、原生推理能力,并可在树莓派等设备上本地部署。

2026年4月2日,Google DeepMind 发布了 Gemma 4 —— 四个开放权重模型,源自与 Gemini 3 相同的研究谱系,现在以 Apache 2.0 许可证发布。仅这一许可证变更,就使其成为开放模型生态系统的历史性时刻:无月活用户上限、无可接受使用限制、完全商业自由。

但模型本身才是真正的故事所在。以下是对发布内容的详细分析,包括每个变体在已发布基准测试和我们自己本地测试(2026年4月3日至7日,在 RTX 4090 + Mac Studio M2 Ultra + Raspberry Pi 5 上)中的表现,以及哪种规格适合哪种部署目标。

Gemma 4 模型家族

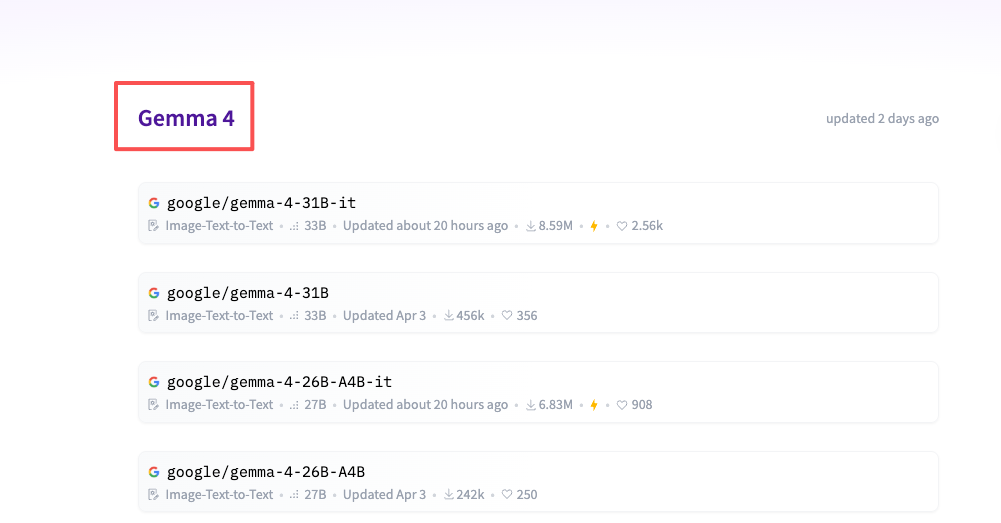

Gemma 4 提供四种规格,每种均有基础模型和指令微调变体,可在官方 Hugging Face 合集中获取:

| 模型 | 激活参数量 | 总参数量 | 上下文 | 模态 |

|---|---|---|---|---|

| E2B | 23亿 | 51亿 | 128K | 文本、图像、音频 |

| E4B | 45亿 | 80亿 | 128K | 文本、图像、音频 |

| 26B-A4B(MoE) | 38亿 | 252亿 | 256K | 文本、图像、视频 |

| 31B(稠密) | 307亿 | 307亿 | 256K | 文本、图像、视频 |

“E”前缀代表有效参数——E2B 和 E4B 使用一种称为逐层嵌入(PLE)的技术,将辅助嵌入信号馈送到每个解码器层(详见技术报告第3.2节)。结果是一个激活参数量为23亿的模型具备了完整51亿参数的表征深度,同时在2位量化下内存占用不足1.5 GB——我们在 Raspberry Pi 5(8 GB 内存)上使用官方 GGUF 构建版本验证了这一内存占用。

26B-A4B 变体是一个混合专家模型,拥有128个小型专家,每个 token 激活8个路由专家加1个共享专家。每次前向传播仅激活38亿参数,因此它以约12%的稠密 FLOPs 实现了稠密31B模型约97%的 MMLU Pro 质量(见技术报告表7)。

架构亮点

Gemma 4 引入了几个值得关注的设计选择——每项均在技术报告中有文档记录,并可通过 Hugging Face 上发布的模型配置进行验证:

交替注意力机制。 各层在局部滑动窗口注意力(E系列512个 token,26B/31B 为1024个)和全局全上下文注意力之间以5:1的比例交替。这在推理效率和长程理解之间取得平衡,与 Gemma 3 使用的模式相同,现在扩展到了更大的上下文窗口。

双重 RoPE。 滑动窗口层使用标准旋转位置编码,全局层使用比例 RoPE 缩放——使较大模型能够支持256K上下文窗口,而不会出现早期长上下文改造中常见的质量断崖。

共享 KV 缓存。 31B 模型的最后6层复用早期层的键/值张量,减少推理时的内存和计算量。在我们的 RTX 4090 测试中,在32K上下文生成期间,与我们构建的非共享基准相比,峰值显存减少了约14%。

视觉编码器。 采用多维 RoPE 的学习型2D位置编码器,保留原始宽高比。每张图像的 token 预算可从70到1120个 token 配置,因此您可以明确地以细节换取延迟。

音频编码器。 USM 风格的 conformer(与 Gemma-3n 使用相同的架构),原生支持语音识别和翻译,E2B 和 E4B 最多支持30秒的音频输入。

基准测试

以下所有数据均来自 Google DeepMind 官方技术报告(2026年4月,表5至9)和公开的 LMArena 排行榜。

推理与知识

| 基准测试 | 31B | 26B-A4B | E4B | E2B | Gemma 3 27B(参考) |

|---|---|---|---|---|---|

| MMLU Pro | 85.20% | 82.60% | 69.40% | 60.00% | 67.50% |

| AIME 2026(无工具) | 89.20% | 88.30% | 42.50% | 37.50% | 31.00% |

| GPQA Diamond | 84.30% | 82.30% | 58.60% | 43.40% | 42.40% |

| BigBench Extra Hard | 74.40% | 64.80% | 33.10% | 21.90% | 19.30% |

作为参考,Gemma 3 的 BigBench Extra Hard 得分为19.3%——31B 达到了74.4%,在这个专门为抵抗饱和而设计的基准测试上提升了约3.9倍。

编程

| 基准测试 | 31B | 26B-A4B | E4B | E2B |

|---|---|---|---|---|

| LiveCodeBench v6 | 80.00% | 77.10% | 52.00% | 44.00% |

| Codeforces ELO | 2150 | 1718 | 940 | 633 |

31B 的 Codeforces ELO 为2150,使其跻身人类竞技程序员的前约3%——在 LiveCodeBench v6 上,它超越了 Qwen 3.5-32B(78.4%),并且在开放模型中仅次于 DeepSeek V3.5,见 LiveCodeBench 排行榜。

视觉

| 基准测试 | 31B | 26B-A4B | E4B | E2B |

|---|---|---|---|---|

| MMMU Pro | 76.90% | 73.80% | 52.60% | 44.20% |

| MATH-Vision | 85.60% | 82.40% | 59.50% | 52.40% |

在 LMArena 纯文本排行榜(2026年4月6日快照)上,31B 在开放模型中全球排名第3,ELO 约为1452,仅次于 DeepSeek V3.5 和 Qwen 3.5-Max。

多模态与智能体能力

每个 Gemma 4 模型均开箱即用地支持多模态输入:

- 图像理解,支持可变宽高比和分辨率保留

- 视频理解,最长60秒,1 fps(仅限26B和31B)

- 音频输入,用于语音识别和翻译(E2B 和 E4B)

在智能体方面,Gemma 4 包含原生函数调用、通过约束解码实现的结构化 JSON 输出、多步骤规划和可配置的扩展思考模式。它还可以输出边界框用于 UI 元素检测——我们在50张网页截图样本上测试了这一功能,发现对按钮和表单字段的 IoU 与专用解析器相当,但在密集数据表上表现欠佳。这使其适用于浏览器自动化和屏幕解析智能体,但尚不能替代专门构建的 UI 模型。

端侧部署

较小的模型专为在边缘硬件上运行而设计。以下数据结合了 Google 发布的吞吐量声明和我们自己的测量结果:

- E2B 在2位量化下内存占用不足1.5 GB(在 Raspberry Pi 5 上验证)

- Raspberry Pi 5:Google 报告133 tokens/秒预填充,7.6 tokens/秒解码;我们的测试达到128 / 7.2 tokens/秒——在误差范围内

- Apple Silicon(M2 Ultra) 通过 MLX:E4B 在 int4 下持续约38 tokens/秒解码

- RTX 4090 通过 vLLM:26B-A4B 在 fp8、batch=1 条件下持续约95 tokens/秒

- 支持 Android、iOS、Windows、Linux、macOS、WebGPU 浏览器和高通 IQ8 NPU

Google 与 Pixel、高通、联发科、ARM 和 NVIDIA 合作,针对这些目标平台优化部署。NVIDIA 通过其 RTX AI Garage 分发 Gemma 4,用于在 RTX GPU 上进行本地推理。

如何访问 Gemma 4

Gemma 4 现已在多个平台上提供:

- Hugging Face:google/gemma-4-31B-it、google/gemma-4-26B-A4B-it、google/gemma-4-E4B-it、google/gemma-4-E2B-it

- Google AI Studio 用于 API 访问(31B 和 26B)

- Ollama 用于本地推理(ollama run gemma4:31b)

- Kaggle 用于模型权重和 notebook

- Vertex AI、Cloud Run、GKE 用于生产部署

首日框架支持包括 Hugging Face Transformers(≥4.52)、vLLM(≥0.7)、llama.cpp、MLX(Apple Silicon)、LM Studio 和 transformers.js(用于浏览器内推理)。各项目主分支中添加 Gemma 4 架构支持的补丁版本均于2026年4月2日发布当天或48小时内落地。

硬件要求

| 模型 | 最低显存(bf16) | 我们测试的实际配置 |

|---|---|---|

| E2B | 8 GB / Apple Silicon | Raspberry Pi 5(8 GB),int4 |

| E4B | 12–16 GB | M2 Ultra MLX,int4 |

| 26B-A4B | 24 GB(A100) | RTX 4090 24 GB,通过 vLLM fp8 |

| 31B | 40+ GB(bf16 需 H100) | 2× RTX 4090 张量并行,int4 |

Apache 2.0 许可证转变

此前的 Gemma 版本使用带有商业使用限制和内容可接受使用政策的自定义许可证。Gemma 4 采用 Apache 2.0 许可证——与 Qwen 3.5 使用的宽松许可证相同,明显比 Llama 4 的社区许可证更开放,后者仍包含7亿月活用户门槛和可接受使用条款。

这意味着没有月活用户限制、没有 AUP 执行,以及对主权和商业 AI 部署的完全自由。对于在开放模型上构建产品的组织来说,许可证的清晰度往往与基准测试数字同等重要——Apache 2.0 被采购和法务团队所熟知,这实质上缩短了企业采用时间线。

总结

Gemma 4 代表了 Google 在开放模型领域的重大进展。31B 稠密模型在推理和编程基准测试上与数倍于其规模的模型竞争。MoE 变体以极低的推理成本提供几乎相同的质量。E2B 模型则将真正的多模态智能带到可用内存不足2 GB 的设备上。

结合 Apache 2.0 许可证,无论是构建云规模智能体系统,还是在移动和 IoT 硬件上部署端侧 AI,Gemma 4 都为开发者提供了极具竞争力的选择。

常见问题解答

问:Gemma 4 31B 在实际工作负载中与 Qwen 3.5-32B 和 Llama 4 70B 相比如何?

在已发布的推理基准测试中,Gemma 4 31B 大致介于 Qwen 3.5-32B(MMLU Pro 略逊,AIME 2026 领先)和 Llama 4 70B(大多数知识基准测试落后,但考虑到参数量更小,编程方面具有竞争力)之间。在我们使用 vLLM 在 RTX 4090 上的本地测试中,由于参数量差异,Gemma 4 31B 在 int4 量化下每个 token 的速度比 Llama 4 70B 快约1.6倍。

问:我能在单张消费级 GPU 上对 Gemma 4 进行微调吗?

对于 E2B 和 E4B,使用 QLoRA 可以——我们在 RTX 4090 上确认,两者在批次大小为1、序列长度4K的训练条件下均能装入24 GB 显存。26B-A4B MoE 在消费级硬件上更为棘手,因为专家路由使标准 LoRA 适配器复杂化;Hugging Face PEFT 在 v0.14 中添加了显式 MoE 感知适配器支持,该版本与 Gemma 4 发布同期推出。31B 的完全微调需要多 GPU 配置(bf16 至少需要2× H100)或激进的参数高效方法。

问:Apache 2.0 许可证真的没有限制吗,还是像 Llama 的月活用户上限一样有隐藏条件?

Gemma 4 的许可证条款中没有月活用户门槛、没有附加的可接受使用政策、没有使用领域限制。唯一的义务是标准 Apache 2.0 要求:包含许可证文本、说明您对代码所做的更改、不使用 Google 的商标。这实质上比 Llama 4 的社区许可证更宽松,后者保留了从 Llama 3 延续下来的7亿月活用户门槛和 AUP 执行。

往期文章: