WAN 2.7: Novos Recursos, Acesso à API e Caminho de Atualização

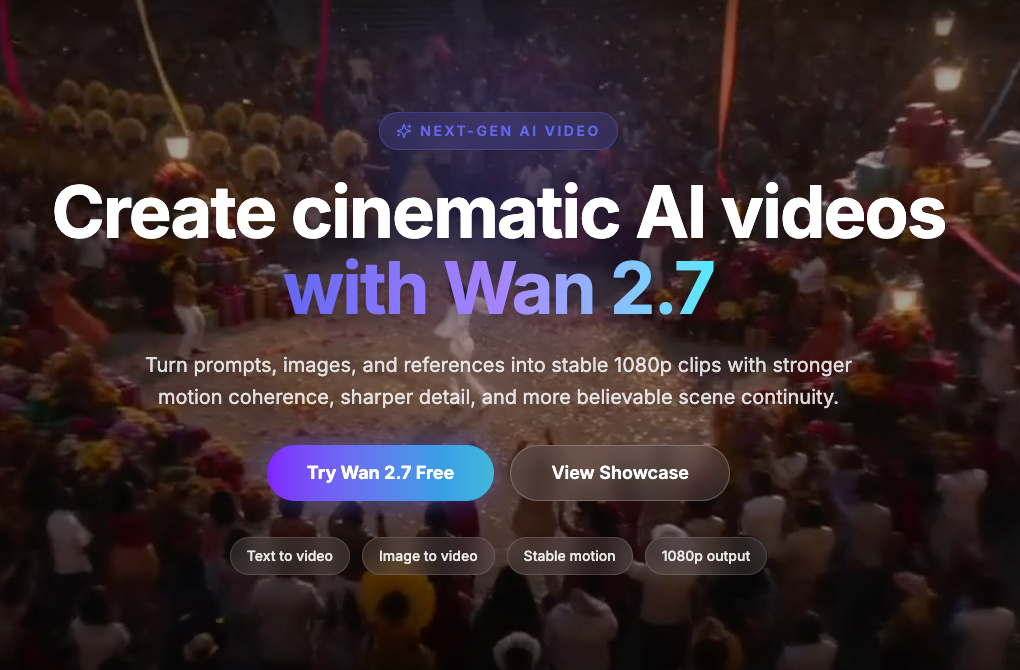

WAN 2.7 é a grande atualização da Alibaba: controle de primeiro/último quadro, I2V em grade 9, referência de voz e edição por instrução. O que os desenvolvedores precisam saber.

Olá a todos. Aqui é a Dora! Tenho acompanhado de perto a família de modelos Wan desde a versão 2.1, principalmente porque, quando um modelo começa a ganhar tração open-source em pipelines de produção, ele tende a evoluir mais rápido do que a cobertura consegue acompanhar. O WAN 2.7 ainda está chegando — com lançamento planejado para março de 2026 — portanto, este não é um review de lançamento. É uma lista de verificação pré-voo para equipes que já estão usando a versão 2.5 e precisam decidir se devem redirecionar a infraestrutura ou aguardar.

Sem hype. Apenas o que está confirmado, o que ainda é incerto, e …o que isso significa para a sua fila de build. Se você ainda está mapeando onde modelos como o Wan se encaixam em uma stack de produção, este guia sobre como ferramentas de geração de vídeo com IA são usadas em fluxos de trabalho reais ajuda a fundamentar a decisão antes de você se aprofundar nas especificações.

WAN 2.7 em 60 Segundos (A Versão Resumida)

Se você está avaliando do ponto de vista de produto ou engenharia: o WAN 2.7 está se configurando como uma expansão funcional mais do que um salto puro de qualidade. O destaque não é “vídeo melhor” — é “mais superfícies de controle.” As melhorias abrangem qualidade visual, geração de áudio e dinâmica de movimento, mas as adições mais interessantes são estruturais: controle de primeiro/último frame, I2V multi-input em grade 9 células, referência de sujeito + voz, e edição baseada em instruções.

O delta em relação à versão 2.5 não é uma resolução primária. É o número de entradas de ancoragem que o modelo agora aceita em uma única chamada.

O Que Há de Novo no WAN 2.7

Controle de Vídeo por Primeiro e Último Frame

A abordagem de primeiro e último frame permite que os usuários definam tanto o início quanto o fim de um vídeo usando duas imagens, com o modelo gerando automaticamente o conteúdo intermediário. Isso já existia como um modelo independente em versões anteriores da série Wan (veja o Wan2.1-FLF2V-14B), mas o 2.7 traz isso dentro do próprio modelo, em vez de ser um checkpoint separado.

Para equipes de produção: isso é mais relevante quando você tem keyframes definidos — um produto em repouso, um produto em movimento — e deseja que o modelo interpole a transição sem uma passagem completa de animação manual. É determinístico nos pontos finais. O que acontece no meio ainda é estocástico, mas suas grades de composição estão lá.

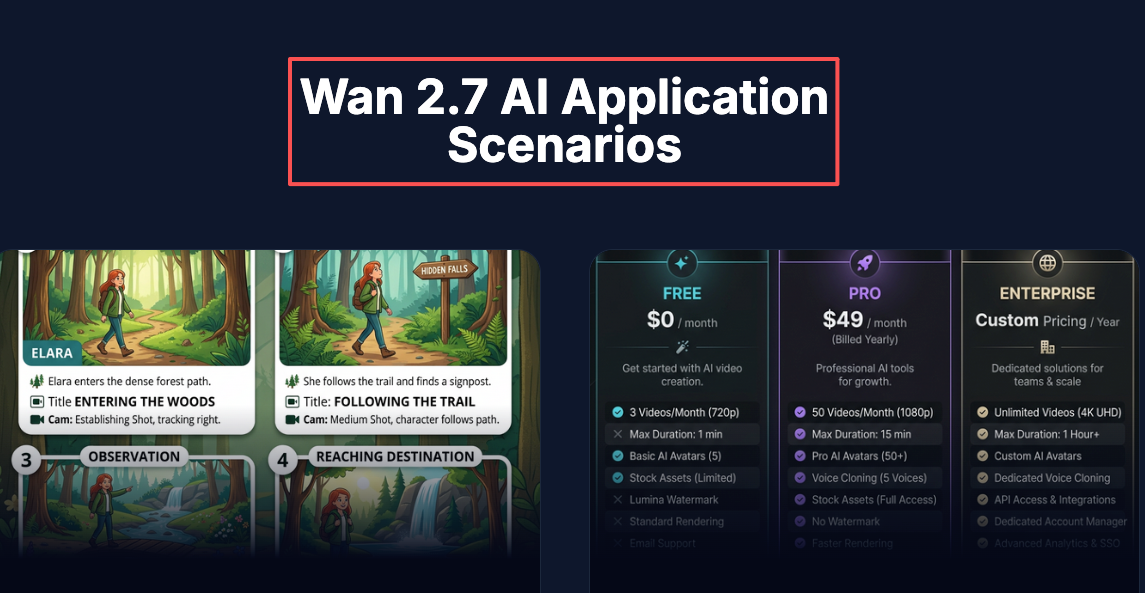

I2V em Grade 9 Células (Multi-Input 3×3)

O WAN 2.7 suporta uma abordagem de síntese em grade 3×3, o que significa que até nove imagens de referência podem ser submetidas como entrada estruturada para uma única tarefa de geração de vídeo. Isso é significativamente diferente do I2V de frame único.

A aplicação prática: se você está gerando conteúdo com consistência de personagem em ângulos ou condições de iluminação variados, agora pode fornecer uma grade de referência …em vez de uma única âncora. Se você está comparando como diferentes ferramentas lidam com a consistência de múltiplas referências, este guia sobre melhores ferramentas de troca de rosto em vídeo com suporte multi-face e multi-input mostra onde as soluções atuais ainda enfrentam dificuldades. Isso reduz o fator sorte de uma única tentativa que torna os jobs em lote de I2V caros de verificar em termos de qualidade. Confirme a estrutura exata dos parâmetros da API no lançamento — o esquema de endpoint para inputs em grade não foi publicado formalmente até o momento desta escrita.

Referência de Sujeito + Voz

O WAN 2.7 permite combinar uma referência visual de sujeito com uma referência de voz para gerar vídeos onde tanto a aparência quanto a voz do personagem são consistentes com seus inputs. Esta é uma extensão do que o Wan 2.6 introduziu com seu modelo R2V — que permitia aos usuários enviar um vídeo de referência de personagem com aparência e voz, utilizando prompts de texto para gerar novas cenas vibrantes com esse mesmo personagem.

No 2.7, a expectativa é que isso se torne mais integrado, em vez de ser um endpoint de modelo separado. Para equipes criando conteúdo curto orientado a personagens ou pipelines de localização, …este é o recurso com o ROI de produção mais claro — desde que o tratamento de referência de voz seja estável sob chamadas em lote repetidas. Para contexto, é também aqui que os pipelines de troca de rosto em vídeo com IA começam a falhar em escala, especialmente quando a consistência de identidade e voz são ambas necessárias.

Edição de Vídeo Baseada em Instruções

O WAN 2.7 suporta edição de vídeos existentes usando instruções em linguagem natural — mudando fundos, modificando iluminação ou alterando a roupa de um personagem ao descrever a mudança e deixar o modelo fazer o resto.

Esta é uma mudança significativa de geração para edição. Para equipes de produto que executam loops de correção pós-produção, isso abre uma alternativa mais leve ao trabalho manual de rotoscopia e composição para pequenas alterações. A principal incógnita é como o modelo lida com a consistência temporal em clipes mais longos quando as edições afetam elementos adjacentes ao movimento (roupas em um sujeito em movimento, por exemplo). É onde ferramentas similares historicamente degradaram.

A documentação oficial do Alibaba Cloud Model Studio já cobre endpoints de edição relacionados na linha atual do Wan, o que fornece uma base para o padrão de API que você provavelmente verá no 2.7.

Recriação / Replicação de Vídeo [Necessita Verificação]

Este recurso — recriar ou replicar vídeos existentes com mudanças de estilo ou sujeito enquanto preserva a estrutura de movimento — apareceu em resumos de terceiros sobre o WAN 2.7. Ele não foi confirmado de forma independente na documentação oficial da Alibaba até o momento desta escrita. Não crie dependências de fluxo de trabalho nessa capacidade até que as notas de lançamento formais da Alibaba o confirmem. Marque-o como exploratório se você estiver definindo o escopo de um projeto de atualização agora.

O Que Permanece Igual (Continuidade de Arquitetura desde a versão 2.6)

A arquitetura DiT (Diffusion Transformer) subjacente continua. A série Wan usa um componente Transformer baseado na arquitetura mainstream de vídeo DiT, empregando um mecanismo de Full Attention para capturar com precisão dependências espaço-temporais de longo alcance, garantindo alta consistência temporal e espacial.

Isso importa para equipes que executam inferência local: o perfil de memória GPU e a abordagem de quantização não vão mudar drasticamente. Se sua stack de inferência 2.6 está otimizada (operações FP8, sharding multi-GPU), esse investimento se mantém. Não espere uma arquitetura de implantação completamente nova.

Acesso via API e Disponibilidade — O Que Está Confirmado, O Que É TBD

Canais de Acesso Oficiais (DashScope / Wan.video)

Os dois canais oficiais confirmados para versões anteriores do Wan foram a plataforma DashScope da Alibaba Cloud — que gerencia o provisionamento de chaves de API e acesso ao modelo — e o Wan.video para fluxos de trabalho voltados a criadores. Ambos devem incluir o 2.7 no lançamento, embora a disponibilidade regional (particularmente para contas internacionais vs. China continental) deva ser confirmada no lançamento.

A chave de API do DashScope é carregada da variável de ambiente DASHSCOPE_API_KEY, com usuários internacionais apontando para dashscope-intl.aliyuncs.com — o mesmo padrão quase certamente se aplicará ao 2.7 dada a infraestrutura estabelecida.

Disponibilidade em APIs de Terceiros

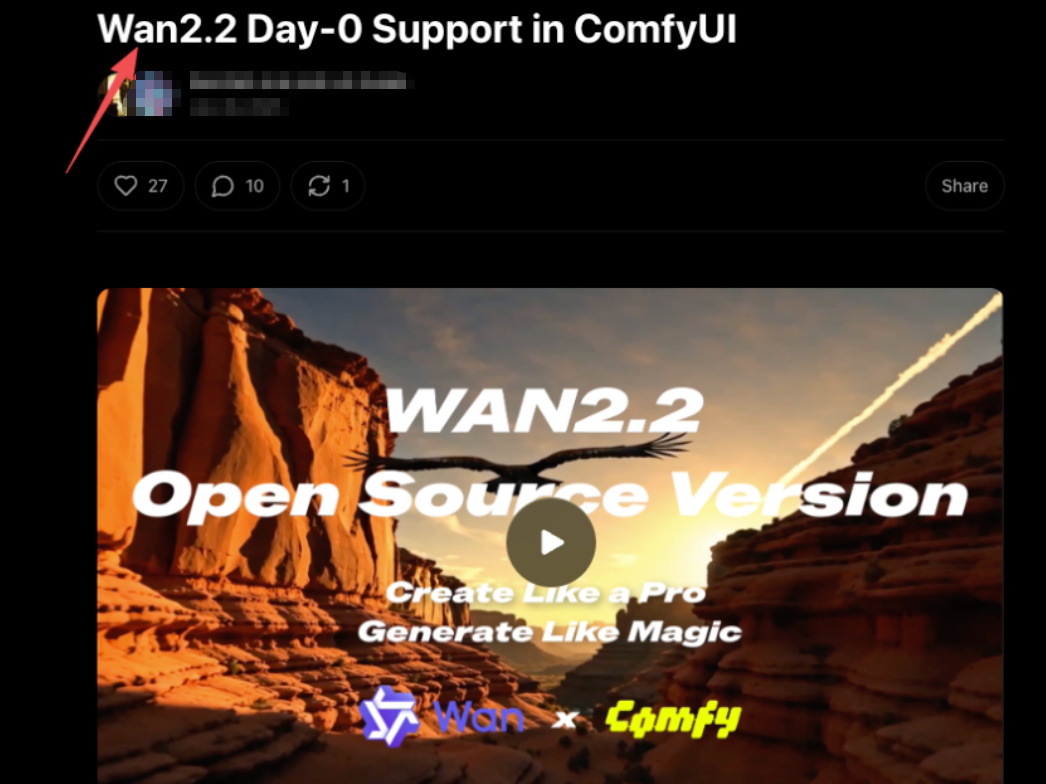

No momento desta escrita, o WAN 2.7 ainda não está confirmado em agregadores de API de terceiros. Com base no padrão a partir da versão 2.2 — onde o suporte nativo ao ComfyUI chegou no dia de lançamento para os pesos do modelo open-source — espere que as integrações da comunidade sigam rapidamente se o 2.7 for lançado com pesos públicos.

Se o 2.7 será lançado como open-source em si não está confirmado. Veja as perguntas frequentes abaixo.

Quem Deve Priorizar o WAN 2.7 Agora

Equipes com Produção de Vídeo com Muitas Referências

Se seu pipeline já depende de consistência de personagem entre cenas — e você tem compensado com múltiplas passagens de geração ou workarounds com ControlNet — a referência de sujeito + voz e o input em grade multi-frame são os dois recursos que mais diretamente reduzem essa sobrecarga. Vale a pena definir o escopo de uma atualização.

Desenvolvedores que Precisam de I2V Multi-Input

O I2V de imagem única funciona até você precisar de consistência. O input em grade de 9 células muda a área de superfície de referência significativamente. Se você tem usado workarounds em lote para simular isso, o 2.7 pode consolidar múltiplas chamadas de API em uma única.

Equipes Criativas que Podem Aguardar com o WAN 2.5

Se seus fluxos de trabalho com a versão 2.5 estão estáveis e os novos recursos não se mapeiam para gargalos de produção ativos, não há urgência. O modelo ainda está sendo lançado. Deixe as primeiras duas semanas de feedback da comunidade revelar os casos extremos antes de replanejar qualquer coisa.

Perguntas Frequentes

- Quando o WAN 2.7 estará oficialmente disponível via API? O lançamento está planejado para março de 2026. Data exata de disponibilidade de API por região: ainda não confirmada.

- O WAN 2.7 é open-source como o WAN 2.2? Não confirmado. O Wan 2.2 foi lançado sob a licença Apache 2.0, que habilitou uso comercial e integração com o ComfyUI. Se o 2.7 seguirá a mesma licença não foi declarado nos materiais de pré-lançamento.

- O WAN 2.7 suporta ComfyUI? Nenhuma integração confirmada ainda. Dado os lançamentos anteriores — Wan 2.1 e 2.2 tiveram suporte ao ComfyUI no ou próximo ao dia de lançamento — assuma que os nós da comunidade seguirão rapidamente se os pesos do modelo forem públicos.

- Qual é o preço comparado ao WAN 2.5? Nenhum preço foi anunciado. A série de modelos Wan tipicamente tem sido cobrada por segundo ou por vídeo através do DashScope. Verifique os preços do Alibaba Cloud Model Studio no lançamento para as tarifas atualizadas.

- Posso acessar o WAN 2.7 de provedores de API de terceiros hoje? Ainda não. O modelo não foi lançado. Monitore o GitHub oficial do Wan e os documentos do DashScope para confirmação do lançamento, e então verifique o suporte da plataforma a partir daí.

O Que Observar Após o Lançamento

Algumas coisas que vale a pena acompanhar à medida que o 2.7 se estabiliza nas primeiras semanas:

— Consistência temporal nas edições por instrução: A edição baseada em instruções é o recurso com maior probabilidade de se comportar de forma diferente na prática em comparação com a apresentação prévia. Acompanhe de perto os outputs da comunidade.

— Lançamento dos pesos open-source: Se os pesos forem lançados publicamente, espere fluxos de trabalho no ComfyUI, integração com Diffusers e variantes quantizadas em dias. Se não, a API do DashScope permanece o principal caminho de acesso — e a latência regional se torna uma variável real no fluxo de trabalho.

— Status do recurso de recriação de vídeo: Este precisa de uma fonte oficial. Não o inclua em nenhuma especificação até que a Alibaba o confirme explicitamente.