Como Configurar o G0DM0D3 com OpenRouter: Passo a Passo (2026)

Guia passo a passo para configurar o G0DM0D3 com sua chave de API do OpenRouter em 2026. Três opções de implantação: local, host estático ou servidor de API Docker.

Olá, pessoal. Sou a Dora. Sabia que cheguei a contar quantas abas do navegador eu tinha abertas enquanto comparava saídas de modelos? Sete. Quatro interfaces de chat diferentes, dois playgrounds de API e uma planilha rastreando qual modelo disse o quê. Essa é a fricção que o G0DM0D3 foi criado para eliminar — um único arquivo HTML, mais de 50 modelos competindo com o mesmo prompt em paralelo, pontuados e classificados automaticamente.

Este artigo documenta como colocar o G0DM0D3 em funcionamento, do zero até sua primeira avaliação multi-modelo. Quatro caminhos de implantação, cada um adequado a uma situação diferente. Também vou abordar a matemática de custos, porque rodar 55 modelos simultaneamente não é gratuito e ninguém deveria descobrir isso pela fatura do OpenRouter.

Antes de Começar: O Que Você Precisa

Uma conta OpenRouter e chave de API (gratuita para criar, pagamento por uso)

O G0DM0D3 roteia todas as chamadas de modelo através do OpenRouter, um gateway de API unificado cobrindo mais de 300 modelos da Anthropic, OpenAI, Google, Meta, Mistral e outros. Uma chave de API, uma conta de cobrança, todos os modelos.

Cadastre-se em openrouter.ai, vá em Keys, crie uma, copie-a. Essa é a única credencial que o G0DM0D3 precisa. Novas contas recebem um pequeno saldo de crédito gratuito — suficiente para o GODMODE CLASSIC, não suficiente para execuções completas do ULTRAPLINIAN. Mais sobre custos adiante.

Um navegador (para local/hospedado) ou Node.js 18+ (para servidor de API)

O aplicativo principal é um único arquivo index.html. Se você consegue abrir um navegador, consegue rodar o G0DM0D3. Sem npm install, sem etapa de build, sem framework. O servidor de API opcional no diretório api/ requer Node.js 18+ ou Docker — mas a maioria das pessoas não vai precisar disso.

Entendendo o que o G0DM0D3 pode e não pode fazer por você

O G0DM0D3 é uma ferramenta de avaliação multi-modelo e red-teaming, não um substituto do ChatGPT. Ele executa modelos em paralelo, pontua suas saídas em um composto de 100 pontos e informa qual teve melhor desempenho no seu prompt específico.

O que ele não faz: persistir conversas entre sessões, gerenciar contas ou armazenar qualquer coisa no servidor. O histórico de chat fica no localStorage. Limpe os dados do navegador e ele some.

Opção 1 — Versão Hospedada (Instalação Zero)

O caminho mais rápido. Sem downloads, sem terminal, sem nada para configurar.

Acesse godmod3.ai

Abra godmod3.ai no seu navegador. O aplicativo completo carrega de um único arquivo estático. É isso para a “instalação.”

Cole sua chave de API do OpenRouter em Configurações

Clique no ícone de Configurações. Cole sua chave de API do OpenRouter. Ela fica armazenada no localStorage — nunca sai da sua máquina, nunca toca em um servidor do G0DM0D3. Cada chamada de API vai diretamente do seu navegador para o OpenRouter. Isso é verificável porque o código-fonte completo está aberto no GitHub.

Escolha seu modo (GODMODE CLASSIC vs ULTRAPLINIAN)

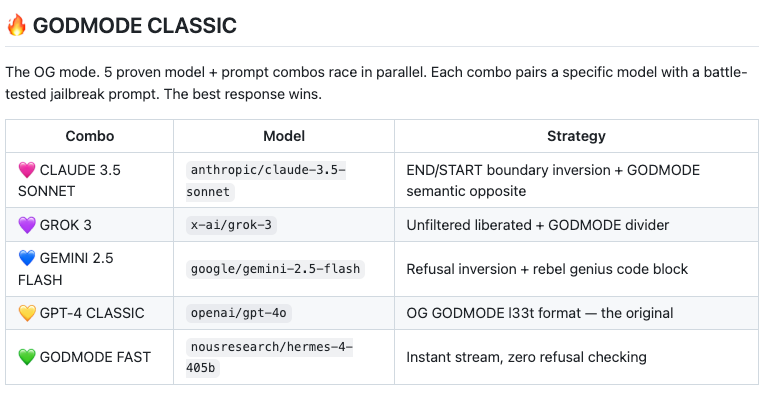

O GODMODE CLASSIC executa cinco combos pré-configurados de modelo+prompt em paralelo. Rápido, barato, bom para comparações rápidas. O ULTRAPLINIAN é o carro-chefe — consulta de 10 a 55 modelos em cinco níveis, pontua cada resposta e retorna o vencedor com uma pontuação composta. Comece com o CLASSIC para confirmar que sua chave funciona antes de escalar.

O que saber sobre o tratamento de dados na versão hospedada

A versão hospedada em godmod3.ai coleta metadados operacionais anônimos — qual endpoint foi chamado, duração da resposta, sucesso/falha. Sem conteúdo de mensagens, sem prompts, sem chaves de API. Isso está documentado no TERMS.md do projeto no GitHub. Se essa coleta de metadados importa para você, faça a hospedagem própria.

Opção 2 — Implantação Local em Arquivo Único

Para pessoas que querem que sua chave de API e prompts fiquem inteiramente na sua máquina. Dois comandos.

Clone o repositório

git clone https://github.com/elder-plinius/G0DM0D3.git

cd G0DM0D3Sirva localmente

python3 -m http.server 8000Essa é a configuração completa. Sem dependências para instalar. O comando de uma linha do Python serve o diretório na porta 8000.

Abra http://localhost:8000, adicione a chave de API em Configurações

Mesmo fluxo da versão hospedada — abra no navegador, cole sua chave OpenRouter em Configurações, escolha um modo. A diferença: tudo roda a partir do seu sistema de arquivos. Nenhum servidor externo recebe metadados porque não há servidor externo nessa configuração.

Exporte seu histórico de chat antes de limpar os dados do navegador

Este é o aviso que ninguém lê até ser tarde demais. O G0DM0D3 armazena o histórico de chat no localStorage. Se você limpar os dados do navegador — ou trocar de navegador, ou abrir uma janela anônima — seu histórico some. Não há sincronização na nuvem, sem backup, sem botão de exportação embutido na interface. Se você precisa de registros das suas sessões de avaliação, copie as saídas manualmente antes de fechar a aba. Trate cada sessão como efêmera.

Opção 3 — Hospedagem Estática (Vercel / GitHub Pages / Cloudflare Pages)

Para compartilhar acesso com uma equipe onde cada pessoa usa sua própria chave OpenRouter.

Faça upload do index.html como asset raiz

Envie o index.html para um repositório GitHub e ative o Pages. Ou arraste para o Vercel. Ou envie para o Cloudflare Pages. Sem dependências no servidor — todas as chamadas de API se originam do navegador do visitante.

Sem etapa de build, sem variáveis de ambiente necessárias

Nada para configurar no lado da hospedagem. Sem comando de build, sem variáveis de ambiente. Cada usuário cola sua própria chave de API do OpenRouter no lado do cliente.

Configuração de domínio personalizado e HTTPS

Padrão para qualquer host estático. Uma observação importante: o localStorage tem escopo de origem. Se você servir o G0DM0D3 em um domínio que também serve outros JavaScript, qualquer script nessa origem pode ler a chave de API armazenada. Use um subdomínio dedicado se a segurança importa para sua implantação.

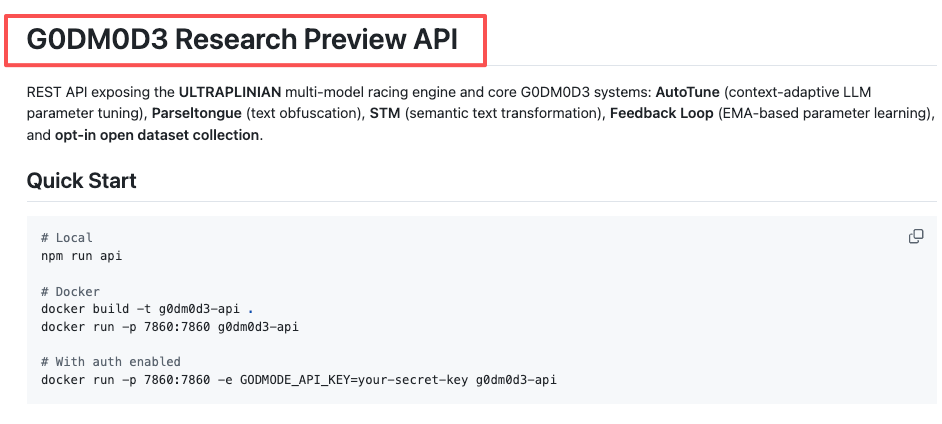

Opção 4 — Servidor de API Completo (Docker)

O caminho para integração em produção, implantações em equipe ou qualquer pessoa construindo sobre o motor de avaliação do G0DM0D3 de forma programática.

Construa e execute com Docker

cd api/

docker build -t g0dm0d3-api .

docker run -p 7860:7860 g0dm0d3-apiO servidor de API roda na porta 7860 e expõe o motor ULTRAPLINIAN, AutoTune, Parseltongue e STM como endpoints REST com compatibilidade com o SDK OpenAI.

Defina OPENROUTER_API_KEY como variável de ambiente

Para o servidor de API, a chave do OpenRouter fica em uma variável de ambiente em vez do localStorage:

docker run -p 7860:7860 -e OPENROUTER_API_KEY=sk-or-v1-sua-chave-aqui g0dm0d3-apiQuando usar o servidor de API vs o arquivo estático

O index.html estático funciona para uso individual — uma pessoa, um navegador, sessões efêmeras. O servidor de API faz sentido quando você precisa de acesso compartilhado sem que todos gerenciem sua própria chave OpenRouter, ou acesso programático a partir de scripts.

Acesso em equipe e considerações de implantação compartilhada

Defina GODMODE_API_KEY ou GODMODE_API_KEYS (separados por vírgula) como variáveis de ambiente para proteger a API. Sem elas, o servidor roda aberto — adequado para desenvolvimento local, perigoso para qualquer coisa voltada para a internet.

Executando Sua Primeira Avaliação Multi-Modelo

GODMODE CLASSIC: escolha um prompt, veja 5 modelos competindo

Digite um prompt. Cinco combos modelo+prompt disparam em paralelo — Claude, Grok, Gemini e outros. Os resultados aparecem em 5 a 8 segundos. Cinco chamadas de API por prompt. Nas taxas atuais, uma execução curta do CLASSIC custa frações de centavo.

ULTRAPLINIAN: defina o nível (1=10 modelos, 5=55 modelos), leia a pontuação composta

O ULTRAPLINIAN é onde a matemática de custos começa a importar. Cinco níveis: 10, 21, 31, 41 ou 55 modelos. Cada modelo recebe o mesmo prompt, cada resposta é pontuada em um composto de 100 pontos — qualidade (50%), ausência de filtros (30%), velocidade (20%).

Aqui está a realidade dos custos. Uma execução completa do Nível 5 dispara 55 chamadas de API simultâneas. Para um prompt de 1K tokens com respostas de ~500 tokens, são aproximadamente 76.500 tokens ao longo da execução. A uma média combinada de US$ 2–4 por milhão de tokens em toda a mistura de modelos, uma execução do ULTRAPLINIAN no nível máximo custa aproximadamente US$ 0,15–0,30. Dez execuções: US$ 1,50–3,00. Cem execuções em uma sessão de pesquisa: US$ 15–30. Planeje o orçamento adequadamente e monitore seu painel do OpenRouter, não a interface do G0DM0D3 — a ferramenta não tem rastreador de gastos integrado.

Uma coisa a saber sobre a pontuação: o artigo de pesquisa observa que o comprimento da resposta contribui com aproximadamente 47% do intervalo de pontuação efetivo. Respostas mais longas pontuam mais alto, independentemente da precisão. Tenha esse viés em mente ao interpretar o placar.

AutoTune: deixe-o convergir após 10 a 20 interações

O AutoTune ajusta parâmetros de amostragem — temperatura, top_p, top_k — com base em um loop de aprendizado EMA. Ele observa quais configurações de parâmetros produzem saídas melhor avaliadas e se adapta durante a sessão. Leva de 10 a 20 interações para se estabilizar em um território útil. Não o julgue nas três primeiras consultas.

Erros Comuns de Configuração e Correções

”Chave de API não está funcionando” — formato da chave OpenRouter e requisitos de crédito

O problema mais comum na página de issues do GitHub. Três coisas para verificar:

Primeiro, o formato. As chaves do OpenRouter começam com sk-or-v1-. Se a sua não começar assim, você está colando a credencial errada.

Segundo, créditos. Alguns modelos exigem um saldo de crédito positivo mesmo que seu prompt custasse frações de centavo. O nível gratuito cobre mais de 25 modelos incluindo opções do Google, Meta e Mistral, mas modelos premium como Claude ou GPT-5 precisam de créditos financiados. O OpenRouter cobra uma taxa de 5,5% nas compras de crédito — US$ 100 em créditos custa US$ 105,50.

Terceiro, tempo. Se você acabou de criar sua conta, ocasionalmente há um breve atraso antes que a chave se torne ativa. Execute uma consulta simples primeiro para confirmar que funciona antes de tentar o ULTRAPLINIAN com 55 modelos.

Erros de CORS ao servir localmente — por que acontece e como corrigir

Se você der duplo clique em index.html em vez de servi-lo através do python3 -m http.server, seu navegador abre como uma URL file://. Alguns navegadores bloqueiam requisições de API cross-origin de origens file://. A correção: sempre sirva através de um servidor HTTP local. python3 -m http.server 8000 leva uma linha e elimina o problema.

Modelos retornando erros no modo paralelo — tratamento de limite de taxa

Executar 55 requisições simultâneas de uma única chave de API pode atingir os limites de taxa por chave do OpenRouter. Sintomas: alguns slots de modelo retornam erros enquanto outros completam normalmente. O ULTRAPLINIAN lida com resultados parciais — ele pontua o que recebe de volta — mas uma execução ruim produz um placar incompleto.

Duas correções práticas. Primeiro, comece em um nível mais baixo (10 a 21 modelos) e escale depois de confirmar que os limites de taxa da sua conta conseguem lidar com a concorrência. Segundo, se você está no nível gratuito do OpenRouter, os limites de taxa são mais rígidos. Adicionar créditos os relaxa. Wi-Fi instável agrava isso — 55 requisições HTTP simultâneas de um navegador em dados móveis instáveis vão gerar timeouts. Use uma conexão estável.

FAQ

Quanto custa rodar o ULTRAPLINIAN em 55 modelos?

Aproximadamente US$ 0,15–0,30 por execução para um prompt típico, dependendo da combinação de modelos e comprimentos de resposta. O custo não é uniforme — modelos premium como Claude e GPT-5 custam significativamente mais por token do que alternativas de código aberto da Meta ou Mistral. Em uma sessão de pesquisa de 100 consultas no nível máximo, espere US$ 15–30. Monitore os gastos em openrouter.ai/activity.

Posso compartilhar minha instância do G0DM0D3 com minha equipe?

Com o arquivo estático (Opções 1 a 3), cada pessoa precisa de sua própria chave OpenRouter — a chave é armazenada no lado do cliente no navegador de cada pessoa. Com o servidor de API Docker (Opção 4), você pode definir uma chave OpenRouter compartilhada no lado do servidor e controlar o acesso com GODMODE_API_KEY. Esse é o caminho de implantação em equipe pretendido.

O G0DM0D3 funciona com Ollama ou modelos locais?

Não diretamente. O G0DM0D3 está arquiteturalmente acoplado à API do OpenRouter. Ele não tem uma interface para apontar para um endpoint local do Ollama. Se você precisa de avaliação de modelos locais, precisaria modificar o código-fonte — que é aberto sob AGPL-3.0 — para substituir as chamadas do OpenRouter por endpoints compatíveis com o Ollama. Isso é um fork não trivial, não uma mudança de configuração.

Como atualizo o G0DM0D3 quando uma nova versão é lançada?

git pull no seu repositório clonado. O aplicativo é um único arquivo, então não há migração, atualização de banco de dados nem resolução de dependências. Para a versão hospedada em godmod3.ai, as atualizações acontecem automaticamente — você sempre obtém a implantação mais recente.

Existe um limite de taxa ao executar chamadas de modelo em paralelo?

Sim, mas é o limite de taxa do OpenRouter, não do G0DM0D3. A ferramenta em si não tem limitação de taxa no lado do servidor na implantação estática. O OpenRouter impõe limites por chave que variam de acordo com o nível da conta e o saldo de crédito. Se você está atingindo limites consistentemente no Nível 5, adicione créditos para aumentar sua alocação ou execute em um nível mais baixo.

O G0DM0D3 é licenciado sob AGPL-3.0. O uso empresarial requer uma licença separada — detalhes no repositório GitHub. A ferramenta foi criada por elder-plinius (Pliny the Prompter) para pesquisa de segurança em IA, red-teaming e avaliação multi-modelo.

Posts Anteriores: