Vazamento do GPT-5.4: O Que os Desenvolvedores Devem Saber

O GPT-5.4 apareceu brevemente nos repositórios do OpenAI Codex antes de ser removido. Veja o que os sinais do vazamento podem significar para os desenvolvedores.

Olá, sou a Dora. Não estava procurando um novo modelo. Estava apenas organizando um pipeline de build quando vi um thread circulando screenshots de um commit que mencionava “GPT 5.4.” Sem fanfarra, apenas uma pequena linha em um pull request. Pausei, não porque precisasse de mais um acrônimo no meu dia, mas porque pistas acidentais e silenciosas costumam dizer mais do que lançamentos chamativos.

Disponível na WaveSpeedAI — preços transparentes por token, endpoint compatível com OpenAI. GPT-5.4 API → · GPT-5.5 API → · Abrir Playground →

Durante a primeira semana de março de 2026, segui as migalhas: diffs em cache, conversas de desenvolvedores e um PR que pareceu aparecer e sumir. Não testei o GPT 5.4 (não há nada oficial para testar), mas analisei de perto o que o código parecia referenciar e como foi tratado. O tom do rastro importava quase tanto quanto o conteúdo.

Como o GPT-5.4 Surgiu na Natureza

As referências no PR do Codex

Percebi pela primeira vez menções ao GPT 5.4 vinculadas a uma mudança de curta duração em um repositório que parecia tocar contextos do “Codex”, seja nomenclatura legada ou um caminho interno que ainda usa “codex” como um bucket para fluxos de codificação. O trecho que circulava mostrava algumas coisas esperadas em torno de roteamento de modelos e feature flags, nada que gritasse “lançamento”, mais como encanamento. Se você já trabalhou com trocas de modelos, sabe que essas linhas costumam ser chatas e importantes.

Duas coisas se destacaram nesses trechos: uma referência a um switch “/fast” em uma camada de comando de chat ou agente, e um rótulo de capacidade que soava como visão em resolução completa. Estou sendo específica aqui porque importa. Rótulos nem sempre correspondem à realidade, mas raramente são aleatórios.

Por que o código foi removido rapidamente

O commit não durou. Pelo que vi, o branch foi reescrito e o diff do PR foi apagado. Isso é comum quando uma equipe inclui uma referência cedo demais ou mistura configurações internas e externas por engano. Em outras palavras: parecia uma manutenção rotineira sob pressão, não uma derrubada.

Já fiz a mesma coisa em equipes menores — percebo uma flag que não deveria ter exposto, faço um force-push e sigo em frente. A velocidade da correção sugeriu que alguém upstream notou o alvoroço e decidiu fechar o loop. Não foi escândalo. Apenas contenção.

O que force-push e deleções geralmente sinalizam

Um force-push não prova nada glamouroso. Geralmente sinaliza urgência e o desejo de restaurar o repositório a um estado conhecido. Você pode ler a própria posição do Git sobre reescrita de histórico na documentação — ferramenta útil e precisa, fácil de se machucar se não tiver cuidado. Se você vê um force-push no meio de um vazamento, geralmente significa que a equipe trata o vazamento como ruído, não como uma revelação coordenada.

Para contexto (não prova), aqui está uma referência neutra: as notas do Git sobre force pushing e reescrita de histórico. Mundo diferente, mesmo padrão.

O Que o Código Vazado Realmente Mostra

Comando de modo rápido (/fast)

A linha que mencionava um comando “/fast” pareceu, para mim, como uma substituição em nível de usuário ou agente. Em termos práticos, sugere um modo que troca alguma profundidade por velocidade — um controle familiar em roteadores de modelos. Se estiver vinculado ao GPT 5.4, esperaria tokens iniciais mais rápidos, talvez cache mais agressivo, talvez limites mais flexíveis para chamadas de ferramentas. Nada chamativo, mas útil quando você está dentro de um loop executando dezenas de pequenas verificações.

Isso não soou como um recurso que ganha demonstrações. Soou como algo que você ativaria durante implantações ou etapas de CI quando se preocupa mais com latência do que com eloquência — por exemplo, normalização de docstrings, pequenas refatorações ou diffs de esquema que não precisam de prosa perfeita.

Referência à visão em resolução completa

“Visão em resolução completa” é uma expressão carregada. Na prática, isso poderia significar limites de entrada mais altos, melhor tratamento de screenshots de UI densas ou menos redimensionamento agressivo antes que o modelo veja os pixels. Se preciso, isso se inclina para fluxos de trabalho onde a fidelidade importa — ler código real em screenshots, revisar estados de UI ou extrair estrutura de diagramas sem borrar os detalhes.

Trabalho com muitas notas de produto compactadas em imagens — mocks com pequenas anotações, redlines, esse tipo de coisa. Se o GPT 5.4 lidar com essas nativamente em maior resolução, removeria um imposto silencioso mas constante: a etapa de preparação onde recorto ou recodifico imagens para que o modelo veja o que eu vejo.

Sinais de agente de codificação no contexto do Codex

As referências ao Codex pareciam andaimes para agentes de codificação. Não “escreva um aplicativo para mim” mágico, mais como os pequenos músculos: seleção de ferramentas, chamadas de funções, políticas de repetição e fallbacks quando uma chamada retorna algo inesperado. As pistas que vi apontavam para essa camada, não para o destaque.

Se essa leitura estiver correta, o GPT 5.4 pode estar ajustado para fluxos de codificação agêntica que sobrevivem à bagunça de repositórios reais: testes parciais, ambientes instáveis, gerenciadores de dependências mistos. Menos “programador genial”, mais “colega de trabalho confiável que não desiste após o segundo erro.” Consigo trabalhar com isso.

Para Que o GPT-5.4 Provavelmente Foi Construído

Fluxos de trabalho de codificação com IA

Não acho que o GPT 5.4 está perseguindo novidade. O rastro sugere mãos mais firmes em loops comuns: ler código, fazer pequenas edições, validar e tentar novamente sem drama. Se você entrega recursos em torno de restrições reais, esse ritmo importa mais do que brilhantismo pontual.

Uma suposição, fundamentada no que vi e no que continua aparecendo em equipes com as quais trabalho: o GPT 5.4 provavelmente foi pensado para ficar mais perto do código, não do slide deck. Provavelmente visa diffs razoavelmente rápidos, atualizações de documentação consistentes, refatorações mais seguras e sugestões pragmáticas que sobrevivem à fase de execução.

Otimização de loop de agente

Loops de agentes são frágeis por razões chatas — timeouts, erros de ferramentas, desvio de contexto e tentativas que nunca convergem. A dica “/fast” parece uma forma de manter os loops ágeis, enquanto a referência à visão sugere que o agente pode ler o que humanos realmente passam adiante (screenshots, logs, fotos de terminais) sem complicação extra.

Se verdade, duas melhorias de qualidade de vida poderiam aparecer:

- Menos tentativas manuais: tipagem de erros mais clara e lógica de recuo mais calma reduzem o estresse.

- Chamadas de ferramentas mais precisas: saltos mais baratos e rápidos quando uma etapa não precisa de raciocínio completo.

Isso não me economizou tempo de imediato — rastrear um vazamento nunca economiza — mas a forma disso pareceu esforço mental reduzido para equipes que automatizam as partes monótonas da manutenção de código.

Integrações de ferramentas para desenvolvedores

A forma como as referências estavam inseridas nas dicas de roteamento me diz que o GPT 5.4 pode ser empacotado para se encaixar em stacks de desenvolvedores existentes. Pense em:

- Hooks de CI/CD que escolhem velocidade ou profundidade por etapa.

- Extensões de editor que podem ler imagens com maior fidelidade sem pré-processamento externo.

- Frameworks de agentes que dependem menos de código de cola personalizado.

Se é para lá que o GPT 5.4 está indo, o valor não estará em uma demonstração: estará em menos adaptadores frágeis. Esse é o tipo de atualização que você percebe três semanas depois, quando nada quebra e você percebe que não precisou babysitar o agente numa sexta-feira.

O Que Ainda Não Sabemos

Nenhum benchmark confirmado

Não vi benchmarks confiáveis vinculados ao GPT 5.4. Nenhuma folha de avaliação, nenhuma tarefa padronizada, nenhuma comparação direta com modelos atuais. Sem números, tudo o que temos são impressões e rótulos. Se e quando isso chegar, procurarei primeiro testes pequenos e práticos: tempo para corrigir um teste com falha, precisão ao ler screenshots densas ou número de tentativas por problema resolvido.

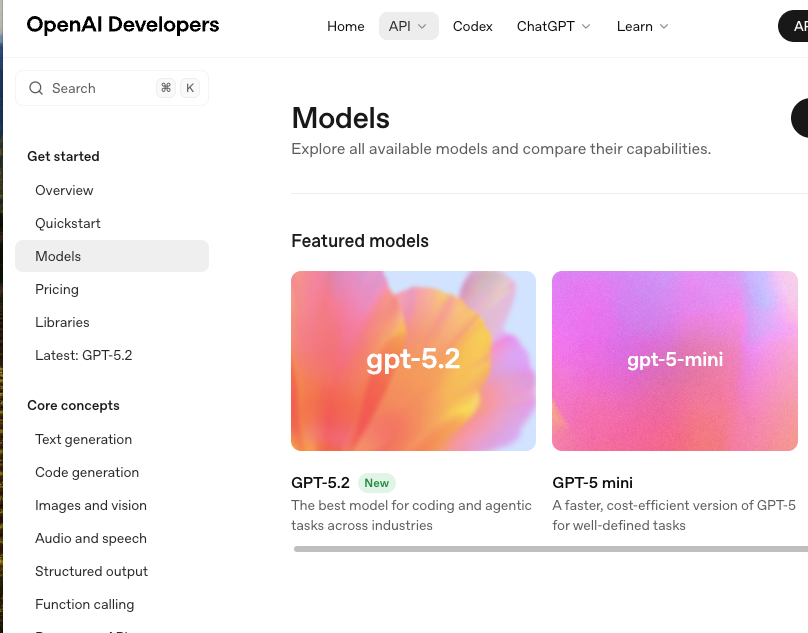

Nenhum detalhe de preços ou API

Não há nada público sobre preços ou cotas. Para planejamento, isso importa mais do que hype. Um modelo excelente que é difícil de orçar não chega à produção. Se você está mapeando cenários hoje, mantenha espaços reservados em suas planilhas e faça uma verificação de sanidade com a documentação de modelos da OpenAI atual, em vez de rótulos vazados.

Cronograma de lançamento incerto

Não tenho uma data, um trimestre ou nem mesmo uma estação. A remoção rápida sugere movimento interno, não timing de mercado. Se o GPT 5.4 aparecer, pode surgir silenciosamente em tabelas de roteamento ou como uma flag em frameworks de agentes antes de qualquer grande banner. Ou pode mudar de nome e nunca ser chamado de “GPT 5.4” em público.

Status Atual e Aviso Legal (modelo não lançado oficialmente)

No início de março de 2026, o GPT 5.4 não foi anunciado ou documentado. Estou compartilhando observações de referências de código de curta duração e a forma como foram tratadas — nada mais. Isso não é conselho para rearquitetar nada. Se você está curioso, fique de olho em documentação estável, não em screenshots. E se você encontrar outra referência perdida, respire fundo. A maioria dos vazamentos é mais silenciosa e mais útil do que as manchetes sugerem.

Vou deixar assim: a parte que me prendeu não foi o número da versão. Foram os pequenos sinais de cuidado em torno de loops e latência. Se é para lá que as coisas estão indo, estou bem com menos espetáculo.