GPT-5.4 para Desenvolvedores: O Que os Sinais Vazados Significam para Fluxos de Trabalho de IA

Modo rápido, melhorias de visão e sinais de agente de codificação — veja o que os vazamentos do GPT-5.4 podem significar para construtores de infraestrutura de IA.

Olá, sou a Dora. Não planejei acompanhar o GPT‑5.4. Simplesmente fui esbarrando em pequenos obstáculos nos meus fluxos de trabalho com agentes — pausas longas o suficiente para eu mudar de aba para o e-mail e esquecer o que estava fazendo. Quando um modelo promete “Modo Rápido” e visão em resolução completa, meus ouvidos ficam atentos — não porque quero a novidade, mas porque quero menos dessas pequenas interrupções.

Este artigo é para desenvolvedores do gpt 5.4, ou, mais precisamente, desenvolvedores que estão decidindo se e como construir com ele. Não estou aqui para vender o modelo. Estou aqui para compartilhar onde ele pode reduzir fricção, onde provavelmente não vai, e o que construir para que o trabalho de hoje sobreviva às notas de lançamento de amanhã.

Por Que Desenvolvedores Estão Observando o GPT-5.4 de Perto

A mudança em direção ao modelo-como-infraestrutura

Percebi uma mudança lenta mas real: os modelos são menos como “produtos” e mais como utilitários pelos quais você roteia tarefas. Um ano atrás, eu tratava cada modelo como uma personalidade. Agora os trato como faixas em uma rodovia: faixas de alta precisão, rápidas e baratas, e tento alternar entre elas com fluidez.

Se o GPT‑5.4 estabilizar um padrão de dupla faixa (rápido/lento ou rápido/reflexivo), ele nos induz a projetar agentes em torno de roteamento, não de apostas únicas. Isso soa abstrato até que você esteja depurando uma tarefa com 12 etapas e perceba que a etapa 3 precisa apenas de uma classificação rápida, mas a etapa 8 precisa de uma cadeia de raciocínio cuidadosa. Costurei essa lógica à mão nos sistemas atuais. É frágil. Se a infraestrutura incorporar isso, teremos menos pontos de tropeço.

Não me impressiono com versões: importa se um lançamento me permite colapsar etapas ou remover código de cola. O GPT‑5.4, se estiver indo para onde as pistas apontam, pode ser um desses.

Por que lançamentos incrementais importam

Pequenos incrementos de versão parecem entediantes, mas salvam equipes de reconstruções. Quando os modelos mantêm interfaces estáveis enquanto melhoram latência ou fidelidade visual, não preciso retreinar usuários (nem a mim mesma). O valor aparece em lugares como: menos tentativas repetidas, prompts mais precisos, timeouts mais curtos.

Fico de olho na documentação da API da OpenAI e nas páginas de modelos para mudanças de forma, não de slogans. Se o GPT‑5.4 se encaixar nos endpoints existentes com padrões mais sensatos e comportamento de sistema mais claro, isso é uma vitória. Menos agitação no código, logs mais previsíveis. E para quem mantém agentes em produção, previsibilidade supera novidade todos os dias.

Modo Rápido — O Que Muda nos Fluxos de Trabalho com Agentes

Custo atual de raciocínio em agentes de múltiplas etapas

Nas minhas execuções do último mês com modelos da geração atual, um agente típico de múltiplas etapas (planejar → recuperar → chamar ferramentas → resumir) realiza de 8 a 15 chamadas ao modelo. Cada chamada custa duas coisas: tokens e atenção. Os tokens você consegue orçar. A atenção é o que te esgota — as pequenas esperas, as tentativas parciais, os momentos em que você se pergunta se travou.

Para mim, uma tarefa comum de resolução de ferramenta interna leva em média de 20 a 45 segundos de ponta a ponta. A maior parte disso não é raciocínio pesado: são verificações leves e formatação. Se o Modo Rápido do GPT‑5.4 reduzir a latência nessas etapas leves mantendo precisão suficiente, isso muda a forma de toda a execução. A longa cauda de pequenas esperas fica aparada. Isso não parece dramático no papel, mas se sente melhor no trabalho diário.

Inferência de modo duplo e lógica de roteamento

O que estou observando é se o “Modo Rápido” é apenas um modelo menor, ou verdadeiramente um modelo emparelhado com um pensador dentro de um mesmo limite. Se a API expuser uma dica clara — digamos, um parâmetro ou uma regra de roteamento por ferramenta — posso centralizar a decisão: rápido para classificação, completo para síntese. Sem mais ramificações específicas em cada etapa do agente.

Em testes com os modelos atuais, prototipei comportamento de dupla rota verificando intenção e confiança da etapa. É desajeitado, mas funciona: rota rápida para padrões conhecidos, rota profunda quando a incerteza é alta. O GPT-5.4 provavelmente fará o mesmo se a API não fizer roteamento automático. Se fizer roteamento automático, o trabalho muda para escrever proteções sensatas e logging, para que você possa ver quando o modelo usa excessivamente a faixa lenta.

De qualquer forma, a lógica é o ponto. Um recurso chamado “Rápido” não ajuda se você não consegue dizer quando está sendo usado. Prefiro um parâmetro simples e um bom rastreamento a magia.

Implicações do loop de chamada de ferramentas

É aqui que importa no dia a dia: loops de ferramentas. Quando um agente chama sua calculadora, banco de dados ou navegador três vezes seguidas, o overhead se acumula. Se o Modo Rápido reduz o custo de ida e volta para análise de intenção e construção de argumentos de função, você encolhe o loop. Isso libera orçamento para as etapas que realmente precisam de raciocínio.

Mas há uma ressalva: se o passe rápido direcionar mal mesmo 5 a 10% das chamadas, você paga de volta em tentativas repetidas e proteções. Minha regra prática é simples: meça loops totais concluídos por minuto, não latência por chamada. Se esse número aumentar com o Modo Rápido ativado, mantenha. Se diminuir (mais tentativas repetidas, mais correções), desligue para esse fluxo. Não é sobre velocidade, é sobre throughput confiável.

Visão em Resolução Completa — Casos de Uso no Mundo Real

Pipelines de captura de tela para código

Mantenho um pequeno pipeline de captura de tela para componente para ferramentas internas. Hoje, a visão em baixa resolução perde pequenos espaçamentos ou dicas de estado (hover vs. ativo). Visão em resolução completa, se real e acessível com custos razoáveis de tokens, muda isso. O modelo consegue ver a borda de 1 pixel e a sombra sutil que sinaliza elevação.

Na prática, eu conectaria assim: passe em alta resolução para rotular elementos atômicos de UI, depois um passe rápido somente de texto para montar código usando um mapa de biblioteca. Dois passes, cada um bom no que faz. O ganho não é a magia de “design para código”, são menos correções manuais. Em um painel simples, isso pode me poupar 10 a 15 minutos e algumas viagens de volta ao Figma.

Fluxos de trabalho de depuração de UI

Um caso quieto mas útil: reproduções de bugs. Frequentemente recebo capturas de tela com toasts de erro cortados pela metade ou sobreposições modais. A visão em alta resolução ajuda o modelo a raciocinar sobre z-index e empilhamento de layout sem eu precisar descrever em palavras. O modelo pode notar: o botão de fechar do toast sobrepõe a navegação — provável problema de empilhamento CSS. Ainda verifico, mas começar mais perto da correção é um alívio.

Para equipes, poderia se encaixar na triagem: cole uma captura de tela, obtenha uma lista de causas prováveis, mais seletores para inspecionar. Nada mágico, apenas um loop mais apertado.

Interpretação de assets de design

Designers me entregam exportações com convenções de nomenclatura que derivam sob pressão de prazo — acontece. Visão em alta resolução mais contexto sobre o sistema de design pode restaurar a ordem. O modelo pode mapear tokens visuais (espaçamento, raio, contraste de cor) para as variáveis de sistema de design mais próximas.

Os limites ainda se aplicam. O modelo não saberá o gosto da sua equipe. Mas pode fazer a parte entediante: “esses 12 ícones são 20px, esses 3 são 16px — provável incompatibilidade.” Isso não é digno de manchete, mas é o tipo de pequena correção que se acumula ao longo de um sprint.

Sinais do Agente de Codificação em Contexto

Por que vazamentos apareceram em repositórios Codex

Você provavelmente viu dicas — commits referenciando sinais de agente, ou configurações com flags de roteamento inexplicadas. Não leio muito em vazamentos, mas eles acompanham o que desenvolvedores precisam: sinais mais claros sobre quando o modelo está planejando, agindo ou refletindo. Repositórios mais antigos da era Codex frequentemente falsificavam isso com heurísticas no cliente. É por isso que as configurações vazaram: a lógica tinha que viver fora do modelo.

Se o GPT‑5.4 expuser sinais de estado mais firmes (mesmo simples como “planejando” vs “executando”), programadores podem sincronizar UI e logging sem analisar vibrações do texto.

Potencial de edição de múltiplos arquivos

Edições de múltiplos arquivos são onde agentes de codificação falham. Hoje, divido o contexto, peço um plano, depois aplico diffs com um linter no loop. Funciona até que não funciona — geralmente quando o agente esquece um arquivo pequeno ou renomeia algo no meio do caminho. Melhor suporte nativo pareceria assim: propor um commit com um mapa de arquivos, incluir justificativa por arquivo e me deixar aceitar mudanças por arquivo.

Mesmo sem novos primitivos, o raciocínio aprimorado do GPT‑5.4 (se chegar) mais mensagens mais estritas — “me mostre um conjunto de patches, não prosa” — poderia reduzir os erros. Tive algum sucesso forçando um formato de patch e rejeitando qualquer outra coisa. É entediante. Ajuda.

Melhorias na navegação de repositórios

As janelas de contexto ficaram maiores, mas a navegação ainda importa. As melhores execuções de codificação que tive em 2026 usam um indexador rápido que constrói um mapa de símbolos e um grafo de dependências, depois alimenta apenas os fatias relevantes. Se o GPT‑5.4 for melhor em ler esses mapas — tabelas de referência cruzada, resumos de símbolos — podemos passar contexto mais fino e preciso.

Um sinal prático para observar: com que frequência o agente pede um arquivo que já viu. Menos repetições geralmente significa que está construindo um conjunto de trabalho melhor. Registro isso. Se você não faz, comece agora: é uma métrica fácil de acompanhar ao longo dos lançamentos.

O Que Desenvolvedores Devem Construir Agora

Padrões de arquitetura agnósticos ao modelo

Tento manter os modelos atrás de uma porta estreita. Um broker decide o roteamento: ferramentas permanecem sem estado e visíveis em logs; prompts vivem em arquivos versionados com testes. Dessa forma, se o GPT‑5.4 tornar o Modo Rápido válido, posso mudar de faixa sem reconectar tudo.

Dois padrões que envelheceram bem para mim:

- Esquemas de ferramentas tipados com validadores estritos. Menos suposições, menos chamadas ruins.

- Design com rastreamento em primeiro lugar. Cada etapa do agente escreve um rastreamento compacto que posso reproduzir. Quando uma atualização de modelo muda o comportamento, posso comparar execuções antigas e novas.

Nenhum deles é brilhante. Ambos são o que mantém o lançamento fluindo quando os modelos mudam.

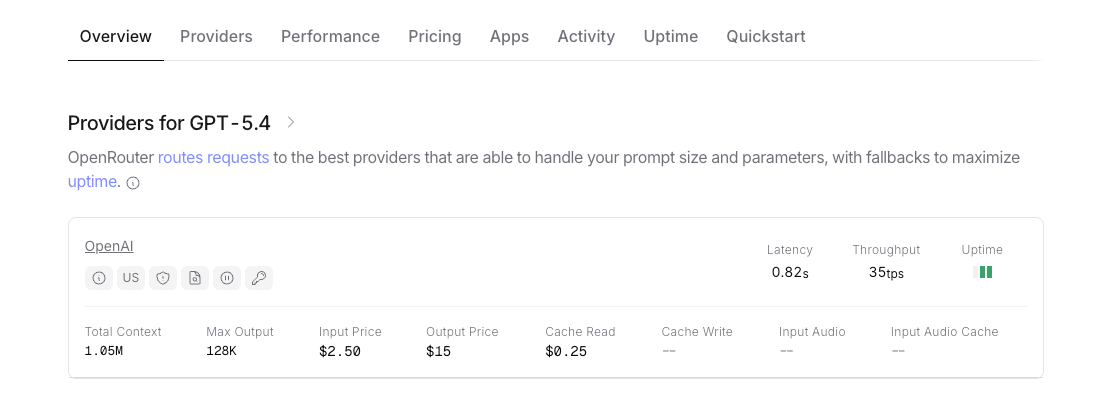

Monitorando canais de lançamento de modelos

Mesmo que você não se mova rápido, observe os canais. Assino páginas de modelos e percorro a lista de modelos e notas de lançamento. Marco três coisas por atualização: dicas de latência, precificação de tokens e quaisquer novos interruptores de nível de sistema (modos, roteamento, comportamento de segurança). Então reexecuto um pequeno conjunto de benchmarks — 10 a 20 rastreamentos que representam meus fluxos de trabalho reais.

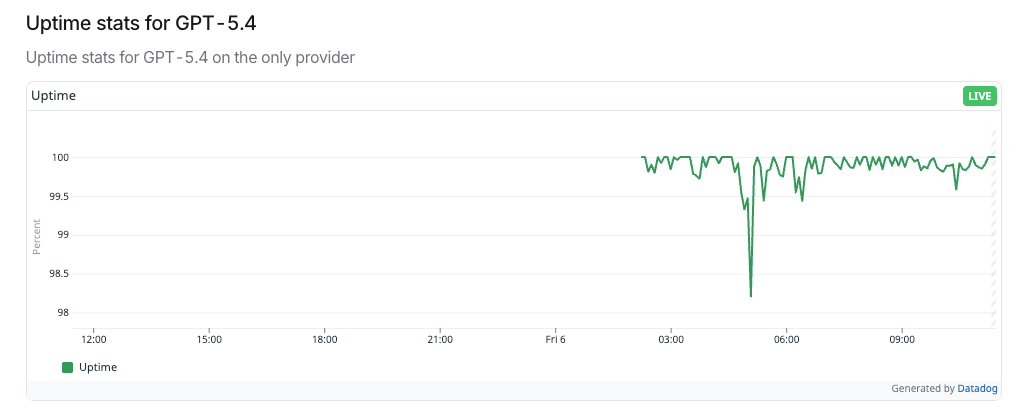

Leva uma hora. Economiza dias depois. Se o GPT‑5.4 for lançado em fases (geralmente é), você verá os casos extremos primeiro nos rastreamentos, não nos tickets de suporte. Esse é o ponto do monitoramento: capturar deriva com calma, antes que se torne um incêndio.

Aviso de Status

Não fui patrocinada para escrever isso. Também ainda não fiz apostas de produção no GPT‑5.4. Minhas notas aqui vêm de experimentos adjacentes e padrões que se mantiveram em atualizações anteriores de modelos. Se e quando a documentação oficial esclarecer modos ou detalhes de visão, vou linká-los e ajustar. Até lá, trate isso como notas de campo — úteis, espero, mas provisórias.

Uma última coisa que ainda estou ruminando: se o Modo Rápido tornar as partes silenciosas mais rápidas, notamos menos, ou apenas nos preocupamos menos? Estou bem com qualquer um dos dois.