SeedVR2 オンライン:使い方ガイド

SeedVR2 オンラインの仕組み、対応するワークフロー、アップスケーリング作業に使用する前に知っておくべきことを解説します。

こんにちは、Doraです。フォローしていたDiscordのスレッドで誰かがSeedVR2について言及していました。「オンラインで使った」と言っていたので、検索してみました。するとすぐに、Gradioデモ、サードパーティのラッパー、APIプレイグラウンド、そしてByteDanceの研究チームとは明らかに無関係に見える怪しいサイトが壁のように立ちはだかりました。

誰もはっきり言わないことがあります:「SeedVR2 Online」という単一のプロダクトは存在しません。このフレーズは、どこにたどり着くかによって少なくとも3つの異なる意味を持ちます。そして、実際にどれを使っているかわからなければ、結果も期待値もずれてしまいます。

整理してみましょう。

「SeedVR2 Online」が通常意味するもの

SeedVR2はByteDance Seedチームが開発したビデオ復元モデルです。 ICLR 2026に採択され、研究コードは公開されています。汎用的なビデオ復元のために設計されたワンステップのDiffusion Transformerで、適応的なウィンドウアテンション機構によって高解像度入力を処理できます。それが実体です。

しかし検索フレーズとしての「SeedVR2 online」は、モデル自体とは異なるものを引っ張り出します。Seedance 2.0のような新しいAIビデオ生成モデルでも同様の混乱が起きており、人々は基盤となるモデルではなく「オンライン版」を検索しがちです。表示されるのはモデルへのアクセスポイントです。それらは同じではありません。

ホスト型デモ、ラッパー、またはワークフローサービス

誰かがSeedVR2をオンラインで使ったと言う場合、おそらく以下のいずれかを指しています:

ホスト型のGradioデモ。 ByteDanceはHugging Face Spacesに公式デモを公開しています。SeedVR2-3Bモデルをサポートしており、APIスタイルのインターフェースで画像と動画の両方を入力できます。これが「公式」オンライン版に最も近いものです——ただし研究デモであり、プロダクトではありません。キュー待ちが長くなることがあります。可用性は保証されていません。

サードパーティのラッパー。 開発者たちが同じ基盤モデルを使ってComfyUIノード、Replicateデプロイメント、スタンドアロンツールを構築しています。これらは誰かのインフラ上で動作し、無料のこともあれば、クレジットや有料制のこともあります。洗練されて見えるかもしれませんが、ByteDanceのプロダクトではありません。

プラットフォーム統合。 一部のAI生成プラットフォームがSeedVR2をモデルカタログの一オプションとして追加しています。同じモデルウェイトを実行していますが、他者のインターフェースと課金システムを通じてのことです。

何が「公式」かについてユーザーが混乱する理由

混乱は理解できます。現代のAIビデオモデルの比較を読んだ人が、それぞれに単一の公式インターフェースがあると思い込む場合と同様の不確かさです。モデルはApache 2.0のオープンソースです。 つまり誰でもホストし、ラップし、SeedVR2と呼ぶことができます。商標のゲートや認証プロセスはありません。

そのため「SeedVR2 online」を検索すると、以下にたどり着く可能性があります:

- ByteDance-Seedが運営する本物のHugging Face Space

- コミュニティのComfyUIデプロイメント

- たまたまSeedVR2をエンジンとして使っているサードパーティのビデオアップスケーリングサービス

- 名前にSeedVR2が含まれているが無関係なもの

映像をアップロードする前に、実際にどれを使っているか30秒確認する価値があります。

SeedVR2 Onlineを試す価値がある場合

率直に言います。SeedVR2へのオンラインアクセスは特定の状況では意味があります。それ以外では、役立つより frustrating なことの方が多いです。

素早いテスト

出力例を見て、そのモデルのスタイルが自分の映像に合うかどうか知りたい場合——まずオンラインで試してみましょう。何もインストールする必要はありません。GPUも不要です。短いクリップをアップロードして、何が返ってくるか確認できます。

これは本当に役立ちます。私はHugging Faceデモで、ずっとクリーンアップしたかった劣化した映像の短いクリップをテストしました。処理は遅かったですが、ローカル環境のセットアップにコミットする前に知りたいことがすべてわかりました。

ローカルセットアップ不要

SeedVR2をローカルで実行するには高性能なハードウェアが必要です。 公式ドキュメントによると、H100-80GB GPU 1枚で720p・最大100フレームの動画を処理でき、1080pまたは2K解像度にはH100-80GBカード4枚が必要です。ほとんどの人はそれを持っていません。オンラインアクセスはそのギャップを埋めますが、柔軟性、速度、制御のコストがかかります。

ローカルパイプラインを構築せずに時々ビデオクリーンアップが必要なクリエイターなら、オンラインオプションを探ってみるのは合理的です。

SeedVR2 Onlineの使い方

入出力の基本

ほとんどのオンラインアクセスポイントは同じ一般的なパターンに従います:

- ソース動画をアップロード(通常はMP4、場合によってはフレーム)

- ターゲット解像度またはアップスケール倍率を設定

- 送信して待つ

出力はクリップの復元版——よりシャープで、ノイズや圧縮アーティファクトが軽減され、ターゲット解像度にスケーリングされたものです。

オンラインでおそらく制御できないもの:バッチサイズ、アテンションウィンドウサイズ、モデルバリアント(3Bと7B)、またはウェーブレットカラー補正などの後処理オプション。これらの設定はローカルツールにあります。

注目すべき設定

インターフェースにオプションがある場合、いくつか理解しておく価値があります:

解像度ターゲット。 モデルは高解像度出力向けに設計されています。ソースより低いターゲットを入力しないでください——視覚的なメリットなしに不要な処理が行われます。

カラー補正モード。 一部のラッパーはこれを公開しています。ComfyUIの実装では、最高の忠実度を実現するフル知覚カラーマッチングのための「lab」モード、周波数ベースのナチュラルカラーのための「wavelet」モードなど、いくつかのカラーマッチングオプションが提供されています。これらが表示された場合、「wavelet」は見慣れない映像に対して通常より安全な選択肢です。

クリップの長さ。 テストクリップは短くしておきましょう——できれば30秒以下。長いクリップは全員のキューを遅くし、何かおかしい場合のトラブルシューティングも難しくなります。

期待できることとできないこと

パフォーマンスの限界

オンラインツールはスロットリングします。特に無料のものは。限られたコンピューティング上でホストされている共有デモを使う場合、以下を想定してください:

- ピーク時のキュー待ち

- 短いクリップでも数分の処理時間

- 時折のタイムアウトやジョブの失敗

これはキューとインフラの問題であり、モデルの問題ではありません。

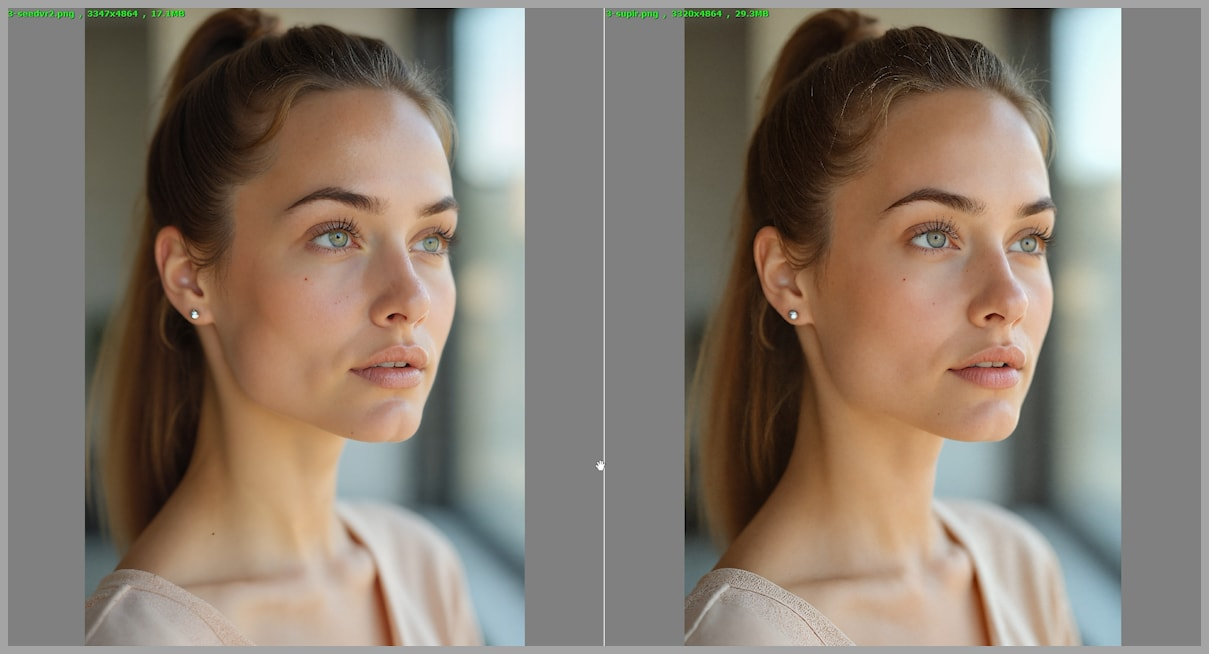

品質への期待

モデル自体は有能です。ByteDance-Seed自身のモデルカードによると、720p AIGCビデオなど非常に軽微な劣化のある入力に対して詳細を過剰に生成し、時折過度にシャープ化された結果をもたらすことがあるとされています。生成ビデオパイプラインではモーションアーティファクトも発生する可能性があります。そのため多くのクリエイターが復元モデルを使う際にAIビデオのフリッカーとジッターの修正方法を学んでいます。これは、大切なものを処理する前に知っておく価値のある実際の制限です。

本物の劣化——ノイズ、ブラー、圧縮アーティファクト——のある映像では、結果は目に見えて良くなることが多いです。すでにクリーンな映像の場合、モデルが実際に物事をより不自然に見せてしまうかもしれません。

オンライン使用がフルワークフロー使用と同じではない理由

ギャップは大きいです。例えばComfyUIを通じたローカルデプロイメントでは、バッチサイズの制御、3Bと7Bモデルバリアントの切り替え、低VRAMのためのGGUF量子化の有効化、パイプライン内でのSeedVR2と他のノードの連携が可能です。そのレベルの制御は、ほとんどのオンラインインターフェースには存在しません。

繰り返し可能なプロセスを構築している場合——例えば定期的な撮影からの映像を処理する場合——オンラインアクセスはすぐに限界に達するでしょう。

SeedVR2 Online vs API vs ワークフロー設定

| カテゴリ | オンラインデモ | API / プラットフォーム | ローカルワークフロー |

|---|---|---|---|

| 必要なセットアップ | なし | 最小限 | 大幅 |

| 速度 | 遅い(共有) | 中程度 | 速い(自分のGPU) |

| 制御 | 低 | 中程度 | 高 |

| コスト | 無料 / クレジット | 使用量に応じた課金 | ハードウェアコスト |

| 信頼性 | 変動あり | より安定 | 安定 |

| バッチ処理 | なし | 場合による | あり |

クイック使用に最適

オンラインデモやホスト型プラットフォームは、一回限りのテスト、素早い比較、そして有能なローカルマシンへのアクセスがない状況に適しています。ByteDance-SeedがホストするSeedVR2-3B Hugging Face Spaceが、何にもコミットせずにモデルを試したい場合の公式タッチポイントに最も近いものです。

繰り返し可能な本番使用に最適

定期的に映像を処理する場合、ComfyUI-SeedVR2_VideoUpscalerノードが多くのクリエイターが行き着いたツールです。コミュニティ製ですが活発にメンテナンスされており、コンシューマーGPUでもアクセスしやすくするGGUF量子化サポートがあります。参考として、公式モデルウェイトとアーキテクチャの詳細はGitHub上のByteDance-Seed/SeedVRリポジトリに文書化されています。

実際に使ってみた感想

Hugging FaceデモとComfyUIを通じたローカルの両方でSeedVR2を実行しました。同じ体験ではありません。

オンラインデモはただ一つのことに役立ちます:SeedVR2が自分の時間を割く価値があるかどうかを判断すること。一回のセッションでその答えが出ました。しかし実際に納品が必要なものには使いません。

試すべき人

以下に当てはまる方:

- 何もインストールする前にモデルが自分の映像に合うかテストしたい

- 時々クリップを復元するが、繰り返し可能なパイプラインは不要

- ローカルGPUリソースがなく、遅い処理でも構わない

スキップすべき人

以下に当てはまる方:

- 週に数クリップ以上を処理している

- 再現可能な一貫した結果が必要

- 出力のシャープネス、カラーマッチング、またはモデルサイズの制御にこだわる

このモデルが研究の景観においてどこに位置するか真剣に興味がある方には、arXiv上のオリジナルSeedVR2論文(2506.05301)を読む価値があります——ほとんどの学術論文より読みやすく、ワンステップ復元アプローチをわかりやすく説明しています。

「SeedVR2 online」というフレーズはしばらくの間、人々を混乱させ続けるでしょう。指し示す単一のプロダクトはありません。モデルがあり、いくつかの公式デモがあり、それを中心に構築されたコミュニティツールが増え続けています。それは悪いことではありません——ただ、それが自分の時間を割く価値があるかどうか判断する前に、実際にどのドアをくぐろうとしているかを知る必要があるということです。皆さん、またね〜