HappyHorse-1.0はオープンソースか?検証できること

HappyHorse-1.0はオープンソースを謳っているが、GitHubとHuggingFaceのリンクは現在利用できない。検証済みの情報と今後の注目点を解説する。

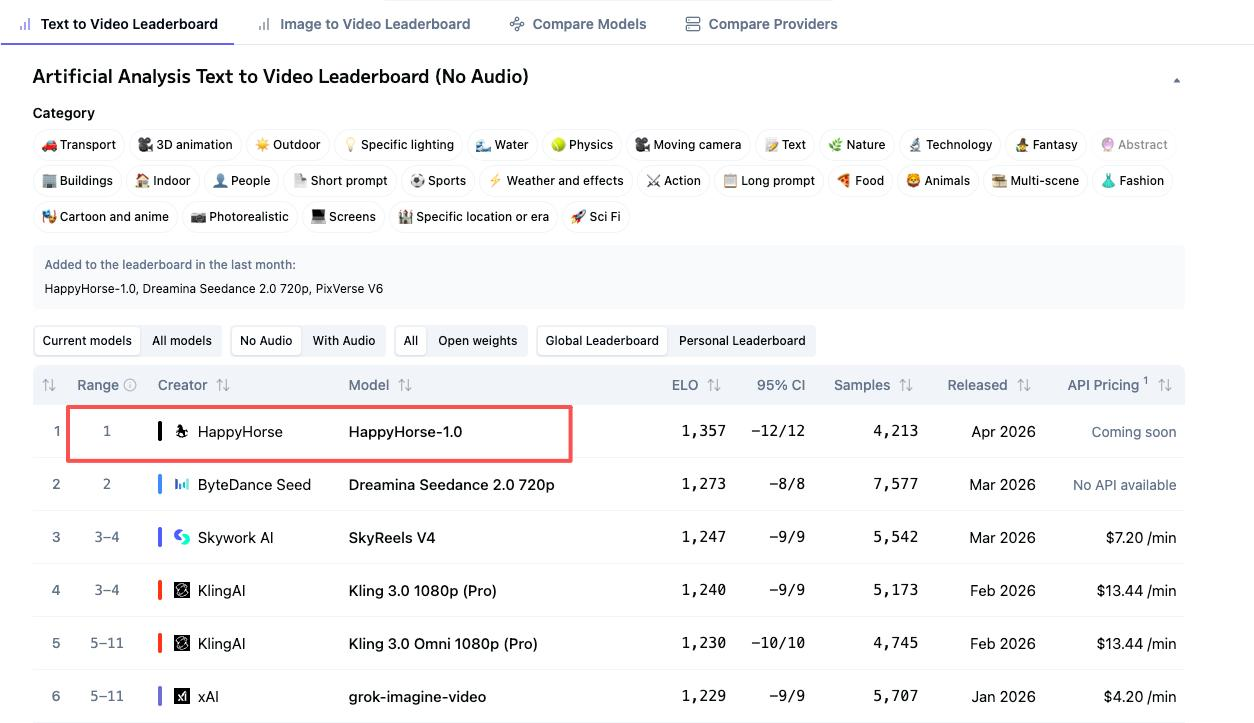

先週の火曜日、ローカルのWAN 2.2パイプラインのセットアップを半分終えたところで、見知らぬ名前がArtificial Analysis Video Arenaのトップに躍り出た。HappyHorse-1.0。Elo 1333。Seedance 2.0を上回り、Kling 3.0を上回り、この一ヶ月間テストし続けていたすべてのモデルを上回っていた。

最初に思ったのは「すごい」ではなかった。「リポジトリはどこだ?」だった。

私がフォローしているDiscordチャンネルの誰かが私にタグ付けした――「Dora、これ見た?」――公式サイトのリンクと一緒に。クリックしてみると、「完全オープンソース」という文字が太字で書かれていた。「GitHub — 近日公開」という文字も見えた。その主張とリンクの間にある小さなギャップが、どうしても気になってしまう。存在しないダウンロードボタンを追いかける時間を十分過ごしてきた私には、使えるモデルと読むだけのモデルの違いがわかる。

それから数時間、いつものことをした。スレッドを引っ張り、HuggingFaceを確認し、実際にローカルマシンにウェイトを載せた人をXで探した。

以下が、2026年4月8日時点で確認できること――そしてできないこと――だ。

HappyHorse-1.0のオープンソースに関する主張

happyhorses.ioの言葉は自信に満ちている。サイトはこのモデルを「完全オープン」と説明し、ベースモデル、蒸留モデル、超解像モデル、推論コードがすべてリリース済みと述べている。主張されているアーキテクチャは150億パラメータの統合40層自己注意Transformer――クロスアテンションなし――で、テキストからビデオと音声を同時生成できるとのこと。リップシンク用に7言語をサポートし、DMD-2蒸留によってデノイジングを8ステップに抑えているらしい。

強い主張だ。しかし問題がある。主張と利用可能性は全く別の話だ。そしてその二つの間のギャップこそが、開発者が痛い目を見る場所だ。

また、HappyHorse-1.0を誰が作ったのか、公式に確認した人はいない。Artificial Analysis自体、アリーナに追加する際にこれを”pseudonymous”(匿名)モデルと説明していた。X上でのコミュニティの推測は、WANのバリアントからSeedanceの競合まで様々だが、何も検証されていない。関連サイトの一つがByteDanceのインフラに言及しているが、私は独自に確認できなかった。

現時点で実際に検証できること

ここからが話の薄い部分だ。

GitHub: happyhorses.ioのサイトにはGitHubリンクがある。「近日公開」と書かれている。今日現在、公開リポジトリは存在しない――コードも、READMEも、ライセンスファイルも。関連する組織やフォークをGitHubで検索した。何もない。

HuggingFace: 同じ状況だ。サイトの「Model Hub」リンクも「近日公開」と表示されている。HuggingFaceにモデルカードは存在せず、ウェイトファイルも、コミュニティのディスカッションスレッドも一切ない。

デモ: ウェブサイトからライブデモが利用可能だ。テキストプロンプトからビデオクリップを生成する。見たアウトプットは本当に印象的だった――クリーンなモーション、まずまずのコヒーレンス。しかしデモはモデルが動くことを示すだけだ。自分で実行できるか、ファインチューニングできるか、その上に何かを構築できるかはわからない。

結論: この記事を書いている時点では、HappyHorse-1.0はダウンロードできない。ウェイトを調べることも、ライセンスを読むことも、ローカルで実行することもできない。「完全オープンソース」というラベルは現在、宣言された意図としてのみ存在している。

このギャップが開発者にとって重要な理由

オープンモデルを本番パイプラインに統合するかどうかを評価している開発者なら、ラベルよりも成果物の方が重要だ。そしてこの分野では常に混同される3つの用語がある。

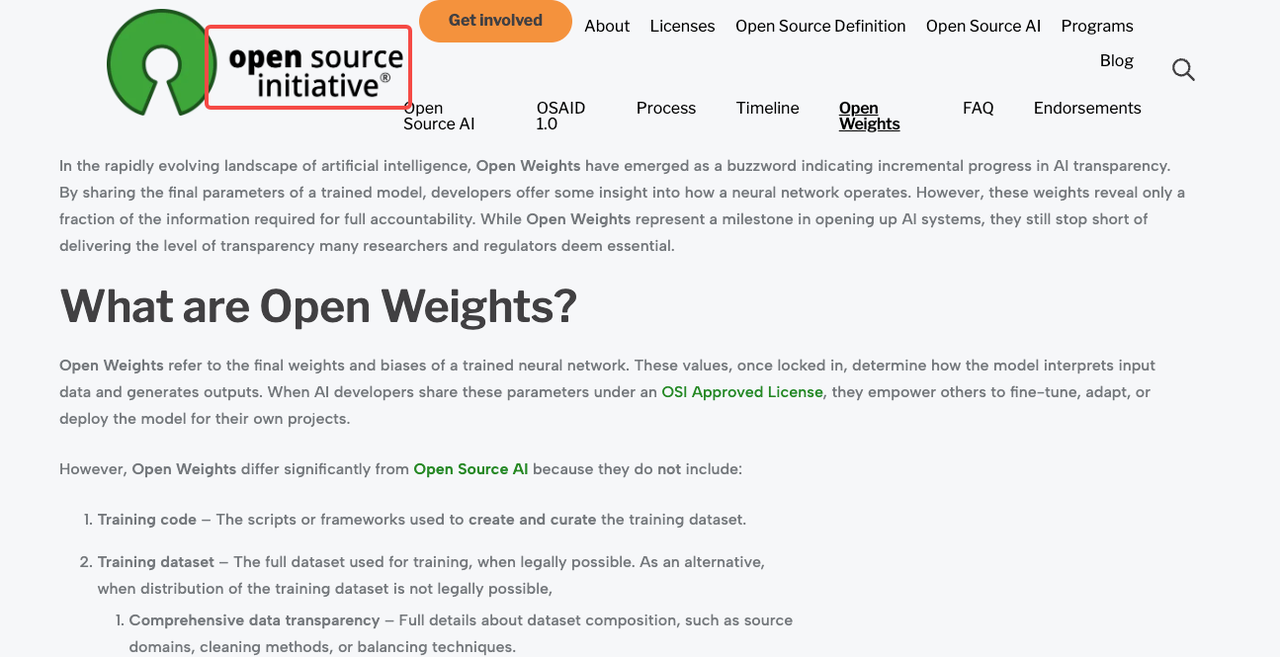

オープンソースはフルパッケージを意味する――ウェイト、トレーニングコード、アーキテクチャの詳細、そして改変と再配布を許可するライセンス。Open Source Initiativeはこの区別について明確に主張している: ウェイトだけをリリースしても該当しない。

オープンウェイトは、トレーニングされたパラメータがダウンロード可能で使用可能だが、トレーニングデータ、コード、手法は非公開のままである可能性を意味する。推論とファインチューニングはできるが、モデルを完全に再現したり監査したりはできない。

オープンアクセスは、APIやデモを通じてモデルを使用できるが、ダウンロードできるものは何もないことを意味する。あなたはテナントであり、所有者ではない。

現時点では、HappyHorse-1.0は3番目のカテゴリに入る。明日変わるかもしれない。しかし未リリースのモデルを中心にワークフローを構築することはリスクだ。特にタイムラインがローカルデプロイメントやカスタムファインチューニングに依存している場合は。

リリース状況の追跡方法

この分野を注視しているなら――そして注目する価値はあると思う――以下を確認すべき場所だ。

GitHub: 新しい組織ページに注目してほしい。コードが公開されたとき(もしくはされるとすれば)、そこに置かれるはずだ。現在リポジトリは存在しないが、サイトは計画があることを示唆している。

HuggingFaceとモデルハブ: モデルカードが最も明確なシグナルになる。ライセンスファイルとともにウェイトが公開されれば、本格的な評価を始められる。HuggingFaceのモデルカードドキュメントは適切なリリースがどのようなものかを概説している。

コミュニティシグナル: Xでの議論は活発だ。研究者やAIビデオクリエイターがすでにHappyHorseのアウトプットを他のアリーナエントリーと比較している。AIビデオ生成に関するRedditとDiscordチャンネルは、フォークや非公式アップロードが現れると素早く表面化させる傾向がある。

Artificial Analysis: 彼らのビデオリーダーボードは、時間をかけてパフォーマンスを追跡するのに最も客観的な場所だろう。Eloスコアはより多くの票が集まるにつれて変動するので、今日のランキングが維持されるとは限らない。

AIビデオにおけるオープンソースの実績: 参照フレーム

オープンウェイトの約束を実際に果たしたモデルと比較するのが参考になる。「本物」がどのようなものかの基準を示してくれる。

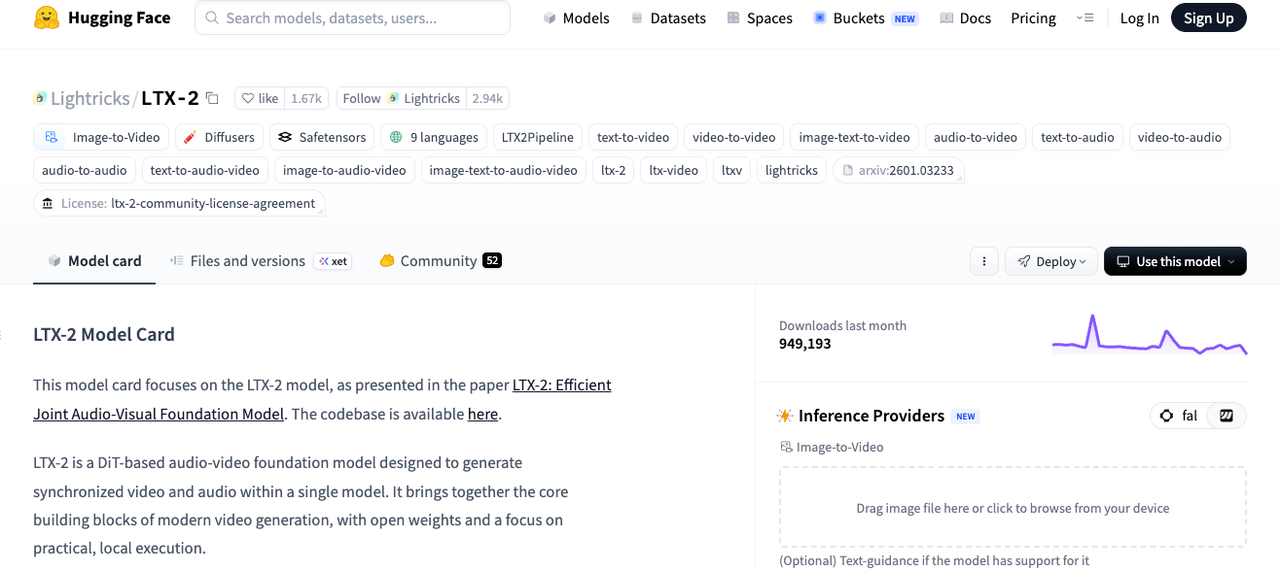

LightricksのLTX-2は確かな参照例だ。彼らはオープンソースを宣言し、その後実行に移した: HuggingFaceでの完全なウェイト、推論コード付きのGitHubリポジトリ、ComfyUIインテグレーション、トレーニングフレームワーク、明確なライセンス。ダウンロードして、ローカルで実行して、LoRAでファインチューニングして、本番ワークフローを構築することができる。実際に信頼できるオープンウェイトリリースはこのようなものだ。

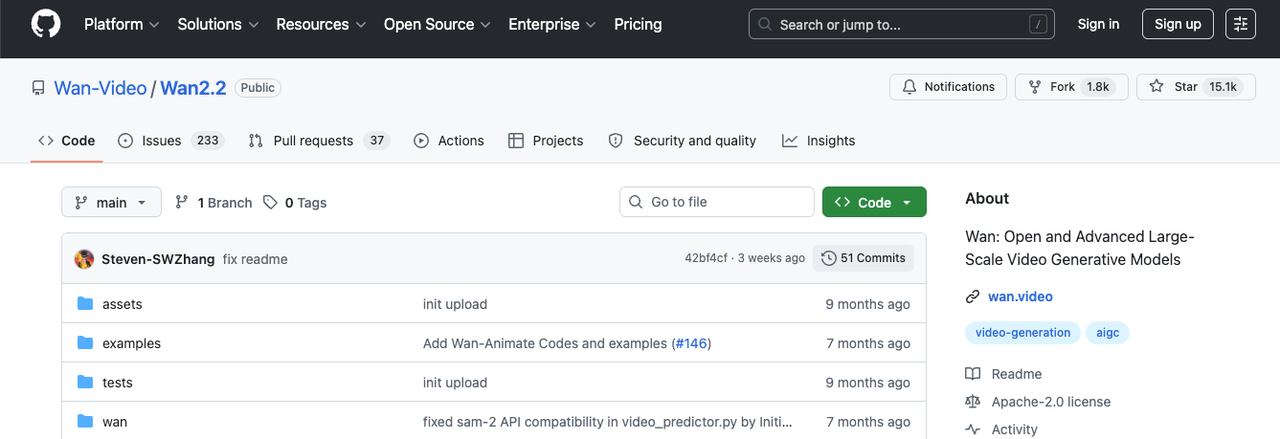

WAN 2.2もそうだ。AlibabaのチームはHuggingFaceで複数のモデルバリアントをリリースした――テキスト対ビデオ、画像対ビデオ、軽量5Bバージョン――GitHubでの完全な推論コード、Diffusersインテグレーション、Apache 2.0ライセンスとともに。コミュニティへの貢献はすぐに続いた: ComfyUIラッパー、量子化バージョン、蒸留実験。

任意のリリースが実際に使用可能であることを確認するために確認すべきこと:

- ダウンロード可能なウェイト (ウェイトリストや「近日公開」ページの後ろに隠れていない)

- ライセンスファイル ― Apache 2.0は商業利用のための最も明確なゴーサインだが、カスタムライセンスでさえ何もないよりはまし

- 推論コード が独自依存関係なしで動作する

- モデルカード にアーキテクチャの詳細、制限事項、意図された使用方法がある

HappyHorse-1.0は今日現在、これらのどれも持っていない。それはモデルの品質に対する判断ではない――アリーナの結果はそれが本当に優れていることを示している。現在のアクセス可能性に対する判断だ。

よくある質問

今すぐHappyHorse-1.0のウェイトをダウンロードできますか?

いいえ。2026年4月8日現在、公開されているウェイトはありません。公式サイトのGitHubとModel Hubのリンクはどちらも「近日公開」と表示されています。私が見つけられたサードパーティのアップロードやコミュニティフォークはありません。

HappyHorse-1.0はHuggingFaceにありますか?

まだです。HappyHorseに関連するモデルカード、ウェイトファイル、HuggingFaceの組織ページはありません。これはいつでも変わる可能性があるので、定期的に確認する価値はあります。

HappyHorse-1.0はどのライセンスを使用しますか?

不明です。関連サイトにはホストされたプラットフォームの文脈で「商業利用権」への言及がありますが、単独のモデルライセンスは公開されていません。ウェイトとともにライセンスファイルが提供されるまで、セルフホストや商業デプロイメントの条件を評価する方法はありません。

今すぐHappyHorse-1.0を中心に商業ワークフローを構築するのは安全ですか?

待った方がいいでしょう。ダウンロード可能なウェイト、公開されたライセンス、確認された開発者の身元さえない状況では、本番利用には不確実性が多すぎます。今すぐ商業的なビデオ生成に使えるオープンモデルが必要なら、LTX-2とWAN 2.2はどちらも明確なライセンスとともに利用可能です。

オープン性という観点でHappyHorse-1.0はLTX-2やWAN 2.2とどう比較されますか?

アウトプット品質の面では、HappyHorseは競争力があり――一部のアリーナ指標では上回っているかもしれない。オープン性の面では、現時点では同じカテゴリにありません。LTX-2とWAN 2.2はどちらも公開されたウェイト、公開リポジトリ、推論コード、定義されたライセンスを持っています。HappyHorseにはデモと約束があります。そのギャップは縮まるかもしれませんが、まだ縮まっていません。

GitHubリポジトリが公開されたとき(もしくはされるなら)に、おそらく再び取り上げるつもりだ。モデル自体は興味深く見える――アリーナのパフォーマンスは無視できない。しかし、印象的なデモとダウンロード可能なウェイトが全く別物であることを、十分な経験から知っている。

今は様子を見ている。まだその上には構築しない。

WaveSpeedAIでHappyHorse-1.0を試す

HappyHorse-1.0はWaveSpeedAIで利用可能になった:

関連記事: