G0DM0D3をOpenRouterで設定する方法:ステップバイステップガイド(2026年)

2026年版G0DM0D3をOpenRouter APIキーで設定するステップバイステップガイド。ローカル、静的ホスト、Docker APIサーバーの3つのデプロイオプションを解説。

こんにちは、Doraです。モデルの出力を比較しながら、ブラウザのタブをいくつ開いていたか数えたことがあります。7つでした。4つの異なるチャットインターフェース、2つのAPIプレイグラウンド、そしてどのモデルが何を言ったかを追跡するスプレッドシートが1つ。G0DM0D3が排除しようとしているのは、まさにこの摩擦です — 1つのHTMLファイルで、50以上のモデルが同じプロンプトに対して並行して競い合い、自動的にスコアリングされ、ランク付けされます。

この記事では、G0DM0D3の起動方法をゼロから最初のマルチモデル評価まで解説します。4つのデプロイメントパス、それぞれが異なる状況に適しています。また、コストの計算についても説明します。55のモデルを同時に実行するのは無料ではなく、OpenRouterの請求書を見て初めて気づくような事態は避けるべきだからです。

始める前に:必要なもの

OpenRouterのアカウントとAPIキー(作成無料、従量課金制)

G0DM0D3はすべてのモデル呼び出しをOpenRouter経由でルーティングします。OpenRouterはAnthropic、OpenAI、Google、Meta、Mistralなど300以上のモデルをカバーする統合APIゲートウェイです。1つのAPIキー、1つの課金アカウントで、すべてのモデルにアクセスできます。

openrouter.aiでサインアップし、Keysに移動し、作成して、コピーします。G0DM0D3が必要とする認証情報はそれだけです。新規アカウントには少額の無料クレジット残高が付与されます — GODMODE CLASSICには十分ですが、フルのULTRAPLINIANランには足りません。コストの詳細は後述します。

ブラウザ(ローカル/ホスト版)またはNode.js 18以上(APIサーバー版)

コアアプリケーションは単一のindex.htmlファイルです。ブラウザを開けるなら、G0DM0D3を実行できます。npm installも、ビルドステップも、フレームワークも不要です。api/ディレクトリのオプションAPIサーバーにはNode.js 18以上またはDockerが必要ですが、ほとんどの人には必要ありません。

G0DM0D3ができることとできないことを理解する

G0DM0D3はマルチモデル評価とレッドチーミングツールであり、ChatGPTの代替品ではありません。モデルを並行して実行し、100点満点の複合スコアで出力をスコアリングし、特定のプロンプトで最も良いパフォーマンスを発揮したモデルを教えてくれます。

できないこと:セッション間での会話の持続、アカウントの管理、またはサーバー側への何かの保存。チャット履歴はlocalStorageに保存されます。ブラウザデータをクリアすると、それは消えます。

オプション1 — ホスト版(インストール不要)

最も速いパスです。ダウンロード不要、ターミナル不要、設定不要。

godmod3.aiにアクセスする

ブラウザでgodmod3.aiを開きます。完全なアプリケーションが単一の静的ファイルから読み込まれます。「インストール」はそれだけです。

SettingsにOpenRouter APIキーを貼り付ける

Settingsアイコンをクリックします。OpenRouter APIキーを貼り付けます。localStorageに保存されます — あなたのマシンから外に出ることはなく、G0DM0D3サーバーに触れることもありません。すべてのAPI呼び出しはブラウザから直接OpenRouterに送られます。GitHubでソース全体が公開されているので、これは検証可能です。

モードを選択する(GODMODE CLASSICとULTRAPLINIAN)

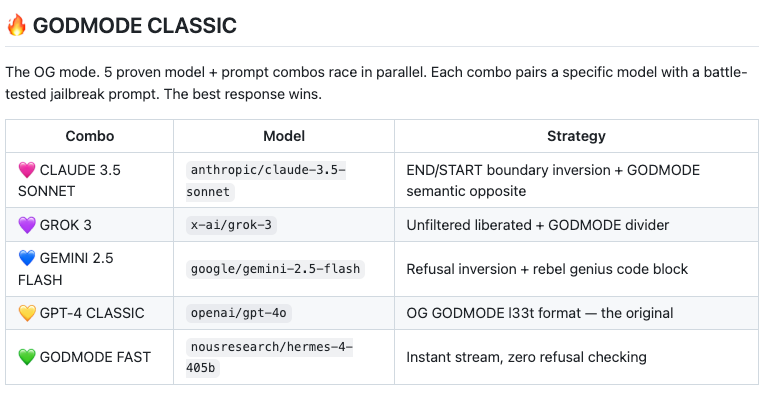

GODMODE CLASSICは事前設定された5つのモデル+プロンプトのコンボを並行して実行します。速く、安価で、クイック比較に適しています。ULTRAPLINIANはフラッグシップです — 5つのティアで10から55のモデルに問い合わせ、各回答をスコアリングし、複合スコアとともに勝者を返します。スケールアップする前にキーが機能することを確認するために、CLASSICから始めましょう。

ホスト版のデータ処理について知っておくべきこと

godmod3.aiのホスト版は匿名の運用メタデータを収集します — どのエンドポイントが呼び出されたか、レスポンス時間、成功/失敗。メッセージの内容、プロンプト、APIキーは収集しません。これはプロジェクトのGitHub上のTERMS.mdに記載されています。そのメタデータ収集が気になる場合は、代わりにセルフホストしてください。

オプション2 — ローカル単一ファイルデプロイ

APIキーとプロンプトを完全に自分のマシン上に保持したい人向けです。2つのコマンドのみ。

リポジトリをクローンする

git clone https://github.com/elder-plinius/G0DM0D3.git

cd G0DM0D3ローカルで配信する

python3 -m http.server 8000セットアップはこれだけです。インストールする依存関係はありません。Pythonのワンライナーがポート8000でディレクトリを配信します。

http://localhost:8000を開き、SettingsにAPIキーを追加する

ホスト版と同じ流れです — ブラウザで開き、SettingsにOpenRouterキーを貼り付け、モードを選択します。違い:すべてファイルシステムから実行されます。この構成では外部サーバーが存在しないため、外部サーバーがメタデータを受け取ることはありません。

ブラウザデータをクリアする前にチャット履歴をエクスポートする

これは誰も読まない警告です — 手遅れになるまで。G0DM0D3はチャット履歴をlocalStorageに保存します。ブラウザデータをクリアすると — またはブラウザを切り替えたり、シークレットウィンドウを開いたりすると — 履歴は消えます。クラウド同期なし、バックアップなし、インターフェースに組み込まれたエクスポートボタンはありません。評価セッションの記録が必要な場合は、タブを閉じる前に出力を手動でコピーしてください。すべてのセッションを一時的なものとして扱いましょう。

オプション3 — 静的ホスティング(Vercel / GitHub Pages / Cloudflare Pages)

各自が自分のOpenRouterキーを使用するチームとのアクセス共有向けです。

index.htmlをルートアセットとしてアップロードする

index.htmlをGitHubリポジトリにプッシュし、Pagesを有効にします。またはVercelにドラッグします。またはCloudflare Pagesにプッシュします。サーバーサイドの依存関係はゼロ — すべてのAPI呼び出しは訪問者のブラウザから発生します。

ビルドステップなし、環境変数不要

ホスティング側で設定するものはありません。ビルドコマンドなし、環境変数なし。各ユーザーはクライアント側で自分のOpenRouter APIキーを貼り付けます。

カスタムドメインとHTTPSの設定

任意の静的ホストで標準です。注意すべき点が1つあります:localStorageはオリジンスコープです。他のJavaScriptも提供しているドメインでG0DM0D3を配信する場合、そのオリジンのスクリプトは保存されたAPIキーを読み取れます。セキュリティが重要なデプロイメントには専用のサブドメインを使用してください。

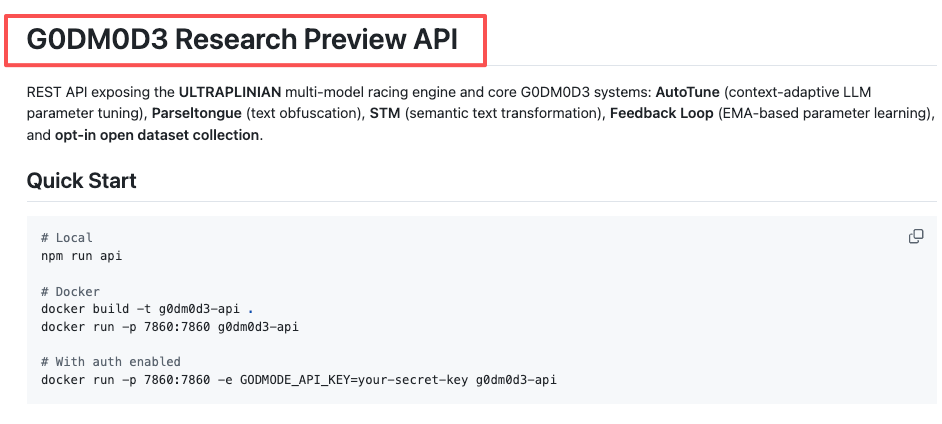

オプション4 — フルAPIサーバー(Docker)

本番統合、チームデプロイメント、またはG0DM0D3の評価エンジンをプログラム的に構築したい人向けのパスです。

DockerでビルドAndで実行する

cd api/

docker build -t g0dm0d3-api .

docker run -p 7860:7860 g0dm0d3-apiAPIサーバーはポート7860で実行され、ULTRAPLINIAN、AutoTune、Parseltongue、STMをOpenAI SDK互換のRESTエンドポイントとして公開します。

OPENROUTER_API_KEYを環境変数として設定する

APIサーバーの場合、OpenRouterキーはlocalStorageではなく環境変数に保存されます:

docker run -p 7860:7860 -e OPENROUTER_API_KEY=sk-or-v1-your-key-here g0dm0d3-apiAPIサーバーと静的ファイルのどちらを使うべきか

静的なindex.htmlは個人利用に向いています — 1人、1つのブラウザ、一時的なセッション。APIサーバーは、全員が自分のOpenRouterキーを管理せずに共有アクセスが必要な場合、またはスクリプトからプログラム的アクセスが必要な場合に意味を持ちます。

チームアクセスと共有デプロイメントの考慮事項

APIを保護するには、GODMODE_API_KEYまたはGODMODE_API_KEYS(カンマ区切り)を環境変数として設定します。設定しないと、サーバーはオープンで実行されます — ローカル開発には問題ありませんが、インターネットに面したものには危険です。

最初のマルチモデル評価を実行する

GODMODE CLASSIC:プロンプトを選び、5つのモデルが競うのを見る

プロンプトを入力します。5つのモデル+プロンプトのコンボが並行して起動します — Claude、Grok、Gemini、その他。結果は5〜8秒以内に表示されます。1プロンプトあたり5つのAPIコール。現在のレートで、短いCLASSICランのコストは1セントの何分の一かです。

ULTRAPLINIAN:ティアを設定し(1=10モデル、5=55モデル)、複合スコアを確認する

ULTRAPLINIANはコストの計算が重要になります。5つのティア:10、21、31、41、または55モデル。各モデルが同じプロンプトを受け取り、各回答が100点満点の複合スコアでスコアリングされます — 品質(50%)、フィルタリングの程度(30%)、速度(20%)。

コストの現実を説明します。フルTier 5のランは55の同時APIコールを起動します。1Kトークンのプロンプトと約500トークンの回答の場合、ランを通じて合計約76,500トークンになります。モデルミックス全体の平均約200万トークンあたり$2〜4のブレンド平均で、フルティアでの1回のULTRAPLINIANランのコストは約$0.15〜$0.30です。10回のラン:$1.50〜$3.00。研究セッションで100回のラン:$15〜$30。予算を立て、G0DM0D3インターフェースではなくOpenRouterダッシュボードで支出を監視してください — このツールには組み込みの支出トラッカーがありません。

スコアリングについて知っておくべきこと:研究論文によると、回答の長さが有効なスコア範囲の約47%に寄与します。長い回答は精度に関係なく高いスコアを得ます。リーダーボードを解釈する際はこのバイアスを念頭に置いてください。

AutoTune:10〜20回のインタラクション後に収束させる

AutoTuneはEMA学習ループに基づいて、temperature、top_p、top_kなどのサンプリングパラメータを調整します。どのパラメータ設定がより評価の高い出力を生むかを観察し、セッションを通じて適応します。有用な領域に落ち着くには10〜20回のインタラクションが必要です。最初の3つのクエリで判断しないでください。

よくある設定エラーと修正方法

「APIキーが機能しない」 — OpenRouterキーの形式とクレジット要件

GitHubのイシューページで最も一般的な問題です。確認すべき3つのこと:

第一に、形式。OpenRouterキーはsk-or-v1-で始まります。そうでない場合は、間違った認証情報を貼り付けています。

第二に、クレジット。一部のモデルは、プロンプトのコストが1セントの何分の一かであっても、プラスのクレジット残高を必要とします。無料ティアはGoogle、Meta、Mistralのオプションを含む25以上のモデルをカバーしますが、ClaudeやGPT-5などのプレミアムモデルにはクレジットが必要です。OpenRouterはクレジット購入に5.5%の手数料を課します — $100のクレジットには$105.50かかります。

第三に、タイミング。アカウントを作成したばかりの場合、キーがアクティブになるまでに短い遅延が生じることがあります。55モデルでULTRAPLINIANを試みる前に、まず1つの簡単なクエリを実行して確認してください。

ローカル配信でのCORSエラー — 理由と修正方法

python3 -m http.serverを通じて配信する代わりにindex.htmlをダブルクリックすると、ブラウザはfile:// URLとして開きます。一部のブラウザはfile://オリジンからのクロスオリジンAPIリクエストをブロックします。修正方法:常にローカルHTTPサーバーを通じて配信してください。python3 -m http.server 8000は1行で問題を解消します。

並行モードでエラーを返すモデル — レート制限の処理

単一のAPIキーから55の同時リクエストを実行すると、OpenRouterのキーごとのレート制限に引っかかる可能性があります。症状:一部のモデルスロットがエラーを返す一方、他は正常に完了します。ULTRAPLINIANは部分的な結果を処理します — 返ってきたものをスコアリングします — しかし、不良なランでは不完全なリーダーボードが生成されます。

2つの実用的な修正方法。第一に、低いティア(10〜21モデル)から始め、アカウントのレート制限が同時実行を処理できることを確認してからスケールアップします。第二に、OpenRouterの無料ティアを使用している場合、レート制限はより厳しくなります。クレジットを追加すると制限が緩和されます。不安定なWiFiはこれを悪化させます — スポット的なモバイルデータ上のブラウザからの55の同時HTTPリクエストはタイムアウトを引き起こします。安定した接続を使用してください。

FAQ

55モデル全体でULTRAPLINIANを実行するとどのくらいのコストがかかりますか?

一般的なプロンプトで1回のランあたり約$0.15〜$0.30、モデルミックスと回答の長さによって異なります。コストは均一ではありません — ClaudeやGPT-5などのプレミアムモデルは、MetaやMistralのオープンソース代替品よりもトークンあたりのコストが大幅に高くなります。フルティアで100クエリの研究セッションでは、$15〜$30を見込んでください。openrouter.ai/activityで支出を監視してください。

G0DM0D3インスタンスをチームと共有できますか?

静的ファイル(オプション1〜3)では、各自が自分のOpenRouterキーを必要とします — キーは各自のブラウザのクライアント側に保存されます。Docker APIサーバー(オプション4)では、1つの共有OpenRouterキーをサーバーサイドに設定し、GODMODE_API_KEYでアクセスをゲートできます。それが意図されたチームデプロイメントパスです。

G0DM0D3はOllamaやローカルモデルで動作しますか?

直接は動作しません。 G0DM0D3はアーキテクチャ的にOpenRouterのAPIに結合されています。ローカルのOllamaエンドポイントを指定するインターフェースはありません。ローカルモデル評価が必要な場合は、ソースを変更する必要があります — AGPL-3.0の下でオープンです — OpenRouter呼び出しをOllamaと互換性のあるエンドポイントに置き換えます。それは設定変更ではなく、非自明なフォークです。

新しいバージョンがリリースされたときにG0DM0D3を更新するにはどうすればよいですか?

クローンしたリポジトリでgit pullしてください。 アプリケーションは単一ファイルなので、マイグレーション、データベース更新、依存関係の解決はありません。godmod3.aiのホスト版では、更新は自動的に行われます — 常に最新のデプロイメントが得られます。

並行モデル呼び出しを実行する際のレート制限はありますか?

はい、ただしG0DM0D3ではなくOpenRouterのレート制限です。 ツール自体は静的デプロイメントではサーバーサイドのレート制限を持っていません。OpenRouterはアカウントティアとクレジット残高によって異なるキーごとの制限を適用します。Tier 5で常に制限に達している場合は、クレジットを追加して割り当てを増やすか、低いティアで実行してください。

G0DM0D3はAGPL-3.0の下でライセンスされています。エンタープライズ利用には別途ライセンスが必要です — 詳細はGitHubリポジトリをご覧ください。このツールはAIの安全性研究、レッドチーミング、マルチモデル評価のためにelder-plinius(Pliny the Prompter)によって構築されました。

関連記事: