Claude Mythosのサイバーセキュリティ機能:開発者とセキュリティチームが知っておくべきこと

Claude Mythosは深刻なサイバーセキュリティ上の懸念を引き起こしています。リークされた主張が、このモデルを評価する開発者とセキュリティチームにとって何を意味するのかを解説します。

「これは心配すべきことでしょうか?」クライアントのセキュリティチームからSlackにメッセージが届いたのは、社内のAIツールの選定を検討していた最中で、Anthropicのリーク報道がフィードに流れてきたときのことだった。

その後48時間にわたって、同じ質問が繰り返し上がってきた。AIの熱狂的なファンからではなく、CISO、セキュリティリード、そしてAIインフラ上にシステムを構築する開発者たちから——突然、準備ができていなかった会話に引き込まれた人々から。

Mythosの話は単なるAI製品発表ではない。脅威環境がどこへ向かっているかを示すシグナルだ。新モデルが登場するときよりも、実際に確認されていることと憶測に過ぎないことを区別することがいっそう重要になる。この記事では、その答えをともに探っていこう。

リークされた草稿が明かしたMythosのサイバーセキュリティ能力

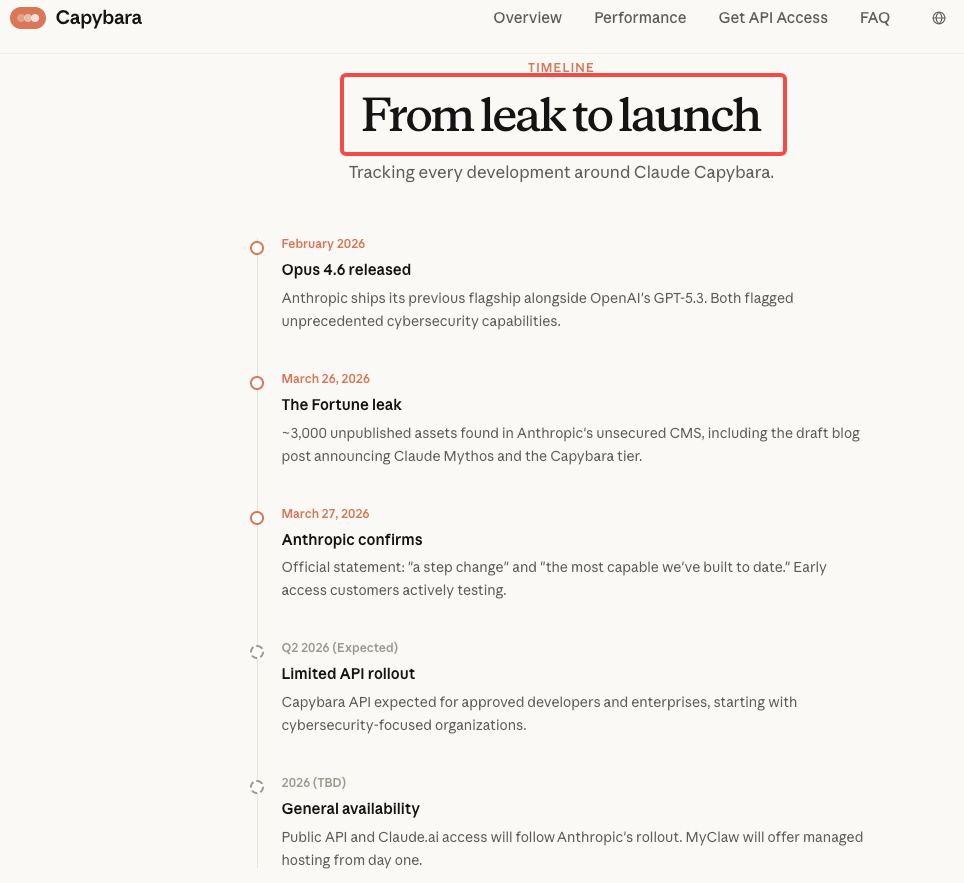

リークされたブログ投稿の草稿——約3,000件に上る流出した内部資産の一部——には、広く引用されてきたサイバーセキュリティに関する2つの注目すべき主張が含まれていた。公式発表前に社内で書かれたAnthropicの言葉は、未リリースのモデル(内部的に「Capybara」ティアと結びつけられ、Claude Mythosと呼ばれている)を「サイバー能力において現在他のあらゆるAIモデルを大きく凌駕している」と表現していた。さらに、このモデルは「防御側の取り組みをはるかに上回るペースで脆弱性を悪用できるモデルの波が来ることを予告している」と警告していた。

2つ目の重要な箇所では、異例の慎重さが示されていた。「Claude Mythosのリリースを準備するにあたり、私たちは特別な注意を払い、そのリスクを——自社のテストで学ぶことを超えても——理解したいと考えています。特に、サイバーセキュリティの領域におけるこのモデルの潜在的な短期的リスクを理解し、サイバー防御者が準備できるよう結果を共有したいと思います。」

このアプローチは、サイバーセキュリティリスクを管理可能な制限としてではなく、防御者との積極的な情報共有を必要とする重大な外部影響として捉えている。Anthropicのこれまでのリリースとは明らかに異なるスタンスだ。

リークから何が欠けているか?具体的なベンチマーク数値、悪用カテゴリ、詳細な方法論だ。「サイバーセキュリティのテストで劇的に高いスコア」という主張が、開示された能力の全容だ。オンラインで出回っているそれ以上に具体的な情報は推測に過ぎない。

Anthropicがこれをなぜかつてないリスクとして扱っているか

「サイバー能力において他のあらゆるAIモデルを大きく凌駕している」とは実際に何を意味するのか

この主張は、現在のベースラインである Opus 4.6 がすでに何を達成できるかを理解した上で読むと、意味合いが変わってくる。Mythosは低いハードルを超えているわけではない。

Claude Opus 4.6 を使って、AnthropicのFrontier Red Teamは本番環境のオープンソースコードベースで500件以上の高深刻度の脆弱性を発見・検証した——専門家によるレビューが何年も続けられたにもかかわらず、数十年間見逃されてきたバグだ。チームは専門的な指示やカスタムハーネスを使用せず、モデルの標準的な能力だけに頼った。

特筆すべきケースとして、Opus 4.6はGhost CMS(GitHubスターが50,000以上、これまで問題のないセキュリティ記録を持つプラットフォーム)のブラインドSQLインジェクションを約90分で特定した。

AIを活用した脆弱性発見と従来のファジングの構造的な違いは、重要な背景として理解しておく必要がある。ファザーは何かが壊れるまでコードに入力を送り込む。Claudeはコードを推論する——コンポーネント間でロジックをたどり、修正済みバグの未パッチ版を見つけるためにコミット履歴を読み、すべての可能な入力を調べるのではなく、本質的にリスクがあるコードパスを評価する。Anthropic自身の社内評価によれば、Mythosはこれを現在利用可能なあらゆるものよりも——大きな差をつけて——うまく行う。

防御者格差の問題:攻撃が防御を上回る可能性があるのはなぜか

草稿の最も重要な洞察は、新たな攻撃タイプのカタログ作成ではなかった。それは、攻撃者と防御者の非対称性がそもそもなぜ存在するかを明確に説明したことだ。攻撃者は一つの弱点を見つければよい。防御者はすべてをカバーしなければならない。コードを推論し、潜在的な脆弱性パターンを特定し、エクスプロイトの洗練を支援できるAIモデルは、「アイデア」から「機能する攻撃」までの時間を圧縮する。

Anthropicは政府高官に対し、Mythosが高度に洗練された自律的エージェントを可能にすることで2026年に大規模なサイバー攻撃をより起こりやすくする可能性があると警告したと報じられている。2026年初頭のDark Readingの調査では、サイバーセキュリティの専門家の48%が今年の最大の攻撃ベクターとしてエージェンティックAIを挙げており——ディープフェイクやソーシャルエンジニアリングを上回っていた。

これはMythosがゼロから作り出す問題ではなく、加速器だ。敵対者はためらいなく、コンプライアンスの摩擦もなくAIを使用する。フロンティアモデルへのアクセスを自己制限する防御者は、重要な地盤を明け渡すリスクがある。

防御的・攻撃的な用途:境界線はどこか

正当な使用例:脆弱性スキャン、レッドチーミング、コード堅牢化

Mythosの能力の防御的な用途は本当に重要であり、Anthropicがこれを構築してリリースしている主な理由でもある。

Claude Code Security——Claude Codeに組み込まれた新機能——はコードベースのセキュリティ脆弱性をスキャンし、人間によるレビューのための的を絞ったソフトウェアパッチを提案することで、従来の方法では見落とされがちなセキュリティ問題をチームが発見・修正できるようにする。人間の承認なしには何も適用されない:Claude Code Securityは問題を特定し解決策を提案するが、最終的な決定は常に開発者が行う。

このワークフローにMythosレベルの能力を適用すると、Opus 4.6でさえ見落とすような脆弱性クラスを発見できることになる——ビジネスロジックにおけるコンテキスト依存の欠陥、複数コンポーネントのインタラクションパターン、コードパターンではなくシステムアーキテクチャの理解を必要とする認証バイパスなど。四半期ごとの手動侵入テストに費用を支払っているセキュリティチームにとって、Mythosレベルの推論品質によるAI駆動の継続的スキャンは、運用上達成可能なことに意味のある変化をもたらす。

レッドチームにとっては、同じ能力が厳格なスコープ設定と認可を必要とする。モデル自体は認可されたテストと悪意のある使用を区別しない——その責任はプロセスとガードレールにある。

Anthropicが誤用を制限するために行っていること

Opus 4.6と並行して、Anthropicはサイバー誤用をリアルタイムで検出・ブロックするアクティベーションレベルのプローブを展開した。正当なセキュリティ研究への摩擦が生じる可能性を認め、「これは正当な研究と一部の防御的な作業に摩擦を生じさせるでしょう。生じた場合にはセキュリティ研究コミュニティと協力してその対処法を見つけたい」と同社は警告した。

Mythos固有のコントロールは、単に技術的なものではなく構造的なものだ。リークされた文書とAnthropicの公式声明に基づくと、初期アクセスは審査済みのセキュリティ研究者と防御者に限定されている——目標は、攻撃的な能力が広く利用可能になる前に防御ツールを構築することだ。これはAnthropicの過去のハイリスクリリースの扱いを反映しており、デュアルユースAIシステムの継続的な監視を伴う段階的な展開を提唱するNISTのAIリスク管理フレームワークが推奨するプラクティスと一致している。

ここで脅威面をモデル化しようとしているセキュリティチームにとって、MITRE ATT&CKフレームワークの敵対的AI戦術セクションは一読の価値がある。そこに記録された戦術は、Mythosが代表するものよりも大幅に低い能力のモデルを前提としている。

早期アクセスのセキュリティ顧客が評価していること

リークされた草稿は、Anthropicのロールアウト優先事項について明確だった。「今後数週間でClaude APIを使用するより多くの顧客にClaude Mythosへのアクセスをゆっくりと拡大していきます。サイバーセキュリティの用途に特に関心があるため、そこからEAPを最初に拡大することを目指しています。」

早期アクセスコホートは、モデルが対処するよう設計された具体的な問題——既存のツールよりも速く包括的に、堅牢な本番環境コードベースの脆弱性を見つけること——に対してMythosを評価している。アナリストは、これが両方向で攻防ギャップを縮める可能性があると指摘する——より速い脆弱性発見、継続的なレッドチーミング、脅威ハンティングを可能にする一方で、悪用された場合は洗練された攻撃のハードルを下げる可能性もある。

評価期間中にいるセキュリティ顧客にとって、実際的な問題は3つの領域に集中している:Mythosが既存のSIEMと脆弱性管理ワークフローとどのように統合するか、モデルの所見を既存のチケットシステムと互換性のある形式で提示できるか、そして大規模な場合に人間によるレビューの要件がどうなるか。

40以上の業界のCISOへのインタビューで、VentureBeatは推論ベースのスキャンツールに対する正式なガバナンスフレームワークは例外であり、標準ではないことを発見した。最も一般的な回答は、この分野があまりにも新興であるため、多くのCISOはこの能力が2026年こんなに早く到来するとは思っていなかったというものだった。早期アクセスプログラム内のチームは、ある意味で、業界の他の部分が続くことになるガバナンスのプレイブックを書いている。

AIインフラ上に構築する開発者チームへの示唆

チームがClaudeや任意のフロンティアAIモデルの上に製品を構築している場合、Mythosの状況は2つの異なるカテゴリの懸念を生み出す。

1つ目は直接的なもの:あなたはAI支援攻撃の潜在的なターゲットであり、それらの攻撃はより高度になっている。

2つ目はアーキテクチャ的な懸念:AIインフラがプロンプトインジェクション、不正なツールアクセス、エージェントの誤用に対してどのように保護されているか。組織はすべてのエージェント、ボット、AIサービスをアイデンティティとして扱い、人間ユーザーと同じレベルのコントロール、権限、監視を非人間アイデンティティにも適用する必要がある——アクセスのインベントリを必要とし、不安全なボットを作り出すハードコードされた資格情報を排除すること。

実際には、これは今日Claudeの上に構築するチームにとっていくつかのことを意味する:

MCPサーバーアクセスを厳密にスコープする。 Claudeエージェントに接続するすべてのMCPサーバーは潜在的な攻撃面だ。Claude Codeを強力にするエージェンティックな能力の拡大は、適切にスコープされていないエージェント権限を意味のあるリスクベクターにもする。

CLAUDE.mdをセキュリティドキュメントとして扱う。 エージェントが使用できるツール、読めるファイル、実行できる操作を定義するCLAUDE.mdの指示はセキュリティコントロールであり、単なる生産性ヘルパーではない。広範なファイルアクセスやツール権限を付与する不十分に書かれたCLAUDE.mdはリスクを増大させる。

AIが生成したコードだけでなく、AIが生成したパッチにも人間によるレビューを適用する。 AI生成コードは、人間が書いたコードと比較してXSS脆弱性を導入する可能性が2.74倍高く、安全でないオブジェクト参照を導入する可能性が1.91倍高い。脆弱性を発見するのと同じ推論能力が、脆弱性を導入することもある。セキュリティ関連の変更に対する人間によるレビューはオプションではない。

FAQ

セキュリティチームは今Claude Mythosにアクセスできますか?

公開チャンネルを通じてはアクセスできない。モデルのロールアウト計画はサイバーセキュリティへの懸念を反映している:早期アクセスは審査済みの防御的サイバーセキュリティ組織に限定されている。準備を整えたいセキュリティチームにとって、Claude Code Security——Opus 4.6上に構築され、EnterpriseおよびTeamカスタマー向けの限定研究プレビューで現在利用可能——が最も公開されているアクセス可能なツールであり、Mythosレベルの能力が何を拡張するかを理解するための有用なベースラインだ。

Anthropicはどのようなセーフガードを構築していますか?

確認された対策には、リアルタイムの誤用検出プローブ、防御者を優先した段階的ロールアウト、パッチの人間参加型要件が含まれる。Mythosに対しては、展開ガバナンス、ツール境界、監査証跡に重点が置かれている。

Claude Mythosは商業的なレッドチーミングに利用できますか?

確認されていない。早期アクセスコホートは防御的なセキュリティユースケースに焦点を当てている。商業的なレッドチーミング——組織がセキュリティ会社を雇ってシステムを積極的に調べる——は曖昧な領域に位置する:それは認可されたオフェンスだ。攻撃的な誤用に対する会社の懸念を考えると、レッドチーミングのユースケースにはオープンなAPIアクセスではなく、意味のあるアクセス制御が設けられると予想される。

前の投稿: