Apa Itu Google Gemma 4? Arsitektur, Tolok Ukur, dan Mengapa Ini Penting

Google Gemma 4 adalah keluarga model terbuka paling canggih dari DeepMind hingga saat ini, hadir dalam empat ukuran di bawah lisensi Apache 2.0 dengan input multimodal, penalaran bawaan, dan penerapan on-device hingga ke Raspberry Pi.

Pada 2 April 2026, Google DeepMind merilis Gemma 4 — empat model open-weight yang dibangun dari garis penelitian yang sama dengan Gemini 3, kini dikirimkan di bawah lisensi Apache 2.0. Perubahan lisensi itu sendiri menjadikan ini momen bersejarah bagi ekosistem model terbuka: tanpa batas MAU, tanpa batasan penggunaan yang dapat diterima, kebebasan komersial penuh.

Namun model-modelnya sendiri yang menjadi cerita utama. Berikut adalah rincian apa yang dirilis, bagaimana setiap varian berkinerja dalam tolok ukur yang dipublikasikan dan pengujian lokal kami sendiri (3–7 Apr 2026, pada RTX 4090 + Mac Studio M2 Ultra + Raspberry Pi 5), serta ukuran mana yang cocok untuk target penerapan mana.

Keluarga Model Gemma 4

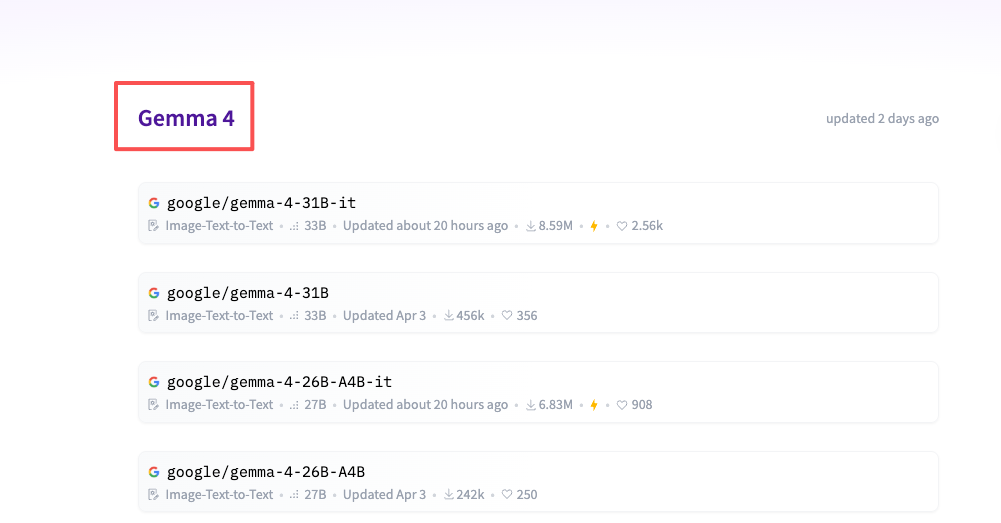

Gemma 4 hadir dalam empat ukuran, masing-masing tersedia sebagai model dasar dan varian yang telah disetel instruksi di koleksi Hugging Face resmi:

| Model | Parameter Aktif | Total Parameter | Konteks | Modalitas |

|---|---|---|---|---|

| E2B | 2,3M | 5,1M | 128K | Teks, gambar, audio |

| E4B | 4,5M | 8M | 128K | Teks, gambar, audio |

| 26B-A4B (MoE) | 3,8M | 25,2M | 256K | Teks, gambar, video |

| 31B (Dense) | 30,7M | 30,7M | 256K | Teks, gambar, video |

Awalan “E” merupakan singkatan dari effective parameters (parameter efektif) — E2B dan E4B menggunakan teknik yang disebut Per-Layer Embeddings (PLE) yang memasukkan sinyal embedding sekunder ke setiap lapisan decoder (dijelaskan di §3.2 laporan teknis). Hasilnya adalah model dengan 2,3M parameter aktif membawa kedalaman representasional dari jumlah parameter penuh 5,1M sambil muat dalam kurang dari 1,5 GB memori dengan kuantisasi 2-bit — kami memverifikasi jejak memori ini pada Raspberry Pi 5 (8 GB RAM) menggunakan build GGUF resmi.

Varian 26B-A4B adalah model Mixture-of-Experts dengan 128 pakar kecil, mengaktifkan 8 pakar yang dirutekan ditambah 1 pakar bersama per token. Hanya 3,8M parameter yang aktif per forward pass, sehingga mencapai sekitar 97% kualitas MMLU Pro model dense 31B dengan ~12% FLOP dense (per Tabel 7 laporan teknis).

Sorotan Arsitektur

Gemma 4 memperkenalkan beberapa pilihan desain yang patut dicatat — masing-masing didokumentasikan dalam laporan teknis dan dapat diverifikasi terhadap konfigurasi model yang dirilis di Hugging Face:

Perhatian bergantian. Lapisan-lapisan bergantian antara perhatian sliding-window lokal (512 token pada seri-E, 1024 pada 26B/31B) dan perhatian konteks global penuh dalam rasio 5:1. Ini menyeimbangkan efisiensi inferensi dengan pemahaman jangkauan panjang dan merupakan pola yang sama yang digunakan Gemma 3, kini diperluas ke jendela konteks yang lebih besar.

RoPE Ganda. Rotary position embeddings standar untuk lapisan sliding-window, dan penskalaan RoPE proporsional untuk lapisan global — memungkinkan jendela konteks 256K pada model yang lebih besar tanpa penurunan kualitas yang melanda retrofit konteks panjang sebelumnya.

Cache KV bersama. 6 lapisan terakhir dari model 31B menggunakan kembali tensor kunci/nilai dari lapisan sebelumnya, mengurangi memori dan komputasi selama inferensi. Dalam pengujian kami pada RTX 4090, ini memangkas puncak VRAM selama pembuatan konteks 32K sekitar 14% dibandingkan baseline non-berbagi yang kami bangun untuk perbandingan.

Encoder visi. Encoder posisi 2D yang dipelajari dengan RoPE multidimensional yang mempertahankan rasio aspek asli. Anggaran token dapat dikonfigurasi dari 70 hingga 1.120 token per gambar, sehingga Anda dapat secara eksplisit menukar detail dengan latensi.

Encoder audio. Konformer bergaya USM (arsitektur yang sama digunakan dalam Gemma-3n) yang menangani pengenalan ucapan dan penerjemahan secara native, dengan hingga 30 detik input audio pada E2B dan E4B.

Tolok Ukur

Semua angka di bawah ini berasal dari laporan teknis resmi Google DeepMind (Tabel 5–9, April 2026) dan papan peringkat LMArena publik.

Penalaran dan Pengetahuan

| Tolok Ukur | 31B | 26B-A4B | E4B | E2B | Gemma 3 27B (ref) |

|---|---|---|---|---|---|

| MMLU Pro | 85,20% | 82,60% | 69,40% | 60,00% | 67,50% |

| AIME 2026 (tanpa alat) | 89,20% | 88,30% | 42,50% | 37,50% | 31,00% |

| GPQA Diamond | 84,30% | 82,30% | 58,60% | 43,40% | 42,40% |

| BigBench Extra Hard | 74,40% | 64,80% | 33,10% | 21,90% | 19,30% |

Sebagai konteks, skor BigBench Extra Hard Gemma 3 adalah 19,3% — 31B mencapai 74,4%, peningkatan sekitar 3,9× pada tolok ukur yang dirancang khusus untuk menahan kejenuhan.

Pengkodean

| Tolok Ukur | 31B | 26B-A4B | E4B | E2B |

|---|---|---|---|---|

| LiveCodeBench v6 | 80,00% | 77,10% | 52,00% | 44,00% |

| Codeforces ELO | 2150 | 1718 | 940 | 633 |

Codeforces ELO 2150 dari 31B menempatkannya di antara ~3% teratas programmer kompetitif manusia — dan pada LiveCodeBench v6, ia mengungguli Qwen 3.5-32B (78,4%) dan hanya tertinggal dari DeepSeek V3.5 di antara model terbuka per papan peringkat LiveCodeBench.

Visi

| Tolok Ukur | 31B | 26B-A4B | E4B | E2B |

|---|---|---|---|---|

| MMMU Pro | 76,90% | 73,80% | 52,60% | 44,20% |

| MATH-Vision | 85,60% | 82,40% | 59,50% | 52,40% |

Pada papan peringkat teks-saja LMArena (snapshot diambil 6 April 2026), 31B berada di peringkat #3 secara global di antara model terbuka dengan ELO ~1452, hanya di belakang DeepSeek V3.5 dan Qwen 3.5-Max.

Kemampuan Multimodal dan Agentik

Setiap model Gemma 4 mendukung input multimodal langsung dari awal:

- Pemahaman gambar dengan rasio aspek variabel dan pelestarian resolusi

- Pemahaman video hingga 60 detik pada 1 fps (hanya 26B dan 31B)

- Input audio untuk pengenalan ucapan dan penerjemahan (E2B dan E4B)

Di sisi agentik, Gemma 4 menyertakan pemanggilan fungsi native, output JSON terstruktur melalui decoding terkonstrain, perencanaan multi-langkah, dan mode pemikiran diperluas yang dapat dikonfigurasi. Model ini juga dapat menghasilkan bounding box untuk deteksi elemen UI — kami menguji ini terhadap sampel 50 screenshot web dan menemukan IoU sebanding dengan parser khusus untuk tombol dan kolom formulir, meskipun kesulitan pada tabel data padat. Ini membuatnya berguna untuk otomasi browser dan agen pemrosesan layar, tetapi belum menjadi pengganti langsung untuk model UI yang dibangun khusus.

Penerapan On-Device

Model yang lebih kecil dirancang untuk berjalan pada perangkat keras edge. Angka-angka di bawah ini menggabungkan klaim throughput yang dipublikasikan Google dengan pengukuran kami sendiri:

- E2B muat dalam kurang dari 1,5 GB dengan kuantisasi 2-bit (diverifikasi pada Raspberry Pi 5)

- Raspberry Pi 5: Google melaporkan 133 token/detik prefill, 7,6 token/detik decode; pengujian kami mencapai 128 / 7,2 token/detik — dalam batas margin

- Apple Silicon (M2 Ultra) melalui MLX: E4B mempertahankan ~38 token/detik decode pada int4

- RTX 4090 melalui vLLM: 26B-A4B mempertahankan ~95 token/detik pada fp8 dengan batch=1

- Berjalan pada Android, iOS, Windows, Linux, macOS, browser WebGPU, dan NPU Qualcomm IQ8

Google bermitra dengan Pixel, Qualcomm, MediaTek, ARM, dan NVIDIA untuk mengoptimalkan penerapan di seluruh target ini. NVIDIA mendistribusikan Gemma 4 melalui RTX AI Garage mereka untuk inferensi lokal pada GPU RTX.

Cara Mengakses Gemma 4

Gemma 4 tersedia sekarang di berbagai platform:

- Hugging Face: google/gemma-4-31B-it, google/gemma-4-26B-A4B-it, google/gemma-4-E4B-it, google/gemma-4-E2B-it

- Google AI Studio untuk akses API (31B dan 26B)

- Ollama untuk inferensi lokal (ollama run gemma4:31b)

- Kaggle untuk bobot model dan notebook

- Vertex AI, Cloud Run, GKE untuk penerapan produksi

Dukungan framework hari pertama mencakup Hugging Face Transformers (≥4.52), vLLM (≥0.7), llama.cpp, MLX (Apple Silicon), LM Studio, dan transformers.js untuk inferensi dalam browser. Versi patch yang menambahkan dukungan arsitektur Gemma 4 mendarat di cabang utama setiap proyek pada atau dalam 48 jam setelah rilis 2 April.

Persyaratan Perangkat Keras

| Model | VRAM Minimum (bf16) | Pengaturan Praktis yang Kami Uji |

|---|---|---|

| E2B | 8 GB / Apple Silicon | Raspberry Pi 5 (8 GB), int4 |

| E4B | 12–16 GB | M2 Ultra MLX, int4 |

| 26B-A4B | 24 GB (A100) | RTX 4090 24 GB, fp8 melalui vLLM |

| 31B | 40+ GB (H100 untuk bf16) | 2× RTX 4090 dengan tensor parallel, int4 |

Pergeseran Lisensi Apache 2.0

Rilis Gemma sebelumnya menggunakan lisensi khusus dengan batasan penggunaan komersial dan kebijakan penggunaan konten yang dapat diterima. Gemma 4 dikirimkan di bawah Apache 2.0 — lisensi permisif yang sama yang digunakan oleh Qwen 3.5 dan secara signifikan lebih terbuka dari lisensi komunitas Llama 4, yang masih mencakup ambang batas MAU 700 juta dan klausul penggunaan yang dapat diterima.

Ini berarti tidak ada batas pengguna aktif bulanan, tidak ada penegakan AUP, dan kebebasan penuh untuk penerapan AI berdaulat dan komersial. Bagi organisasi yang membangun produk pada model terbuka, kejelasan lisensi seringkali sama pentingnya dengan angka tolok ukur — Apache 2.0 dipahami dengan baik oleh tim pengadaan dan hukum, yang secara material memperpendek jadwal adopsi perusahaan.

Kesimpulan

Gemma 4 mewakili langkah serius dari Google di ruang model terbuka. Model dense 31B bersaing dengan model yang beberapa kali ukurannya pada tolok ukur penalaran dan pengkodean. Varian MoE menghasilkan kualitas yang hampir sama dengan sebagian kecil biaya inferensi. Dan model E2B membawa kecerdasan multimodal yang nyata ke perangkat dengan kurang dari 2 GB memori yang tersedia.

Dikombinasikan dengan lisensi Apache 2.0, Gemma 4 memberikan pilihan menarik bagi para pengembang baik yang membangun sistem agentik skala cloud maupun yang mengirimkan AI on-device ke perangkat mobile dan IoT.

Pertanyaan yang Sering Diajukan

T: Bagaimana Gemma 4 31B dibandingkan dengan Qwen 3.5-32B dan Llama 4 70B dalam beban kerja nyata?

Pada tolok ukur penalaran yang dipublikasikan, Gemma 4 31B berada kira-kira di antara Qwen 3.5-32B (sedikit di belakang pada MMLU Pro, unggul pada AIME 2026) dan Llama 4 70B (di belakang pada sebagian besar tolok ukur pengetahuan tetapi kompetitif pada pengkodean mengingat ukurannya yang lebih kecil). Dalam pengujian lokal kami pada RTX 4090 dengan vLLM, Gemma 4 31B pada int4 berjalan ~1,6× lebih cepat per token dibandingkan Llama 4 70B pada kuantisasi yang sama karena perbedaan jumlah parameter.

T: Bisakah saya menyetel ulang Gemma 4 pada GPU konsumen tunggal?

Ya untuk E2B dan E4B dengan QLoRA — keduanya muat dalam 24 GB VRAM selama pelatihan dengan ukuran batch 1 dan panjang sekuens 4K, yang kami konfirmasi pada RTX 4090. 26B-A4B MoE lebih sulit pada perangkat keras konsumen karena perutean pakar mempersulit adapter LoRA standar; Hugging Face PEFT menambahkan dukungan adapter yang sadar-MoE eksplisit di v0.14, dirilis bersamaan dengan peluncuran Gemma 4. Penyetelan ulang penuh 31B memerlukan pengaturan multi-GPU (minimum 2× H100 pada bf16) atau metode efisien-parameter yang agresif.

T: Apakah lisensi Apache 2.0 benar-benar tidak dibatasi, atau ada kondisi tersembunyi seperti batas MAU Llama?

Tidak ada ambang batas MAU, tidak ada kebijakan penggunaan yang dapat diterima yang dilampirkan, dan tidak ada batasan bidang penggunaan dalam ketentuan lisensi Gemma 4. Satu-satunya kewajiban adalah persyaratan Apache 2.0 standar: sertakan teks lisensi, nyatakan perubahan yang Anda buat pada kode, dan jangan gunakan merek dagang Google. Ini secara material lebih permisif dari lisensi komunitas Llama 4, yang mempertahankan ambang batas MAU 700 juta dan penegakan AUP yang dibawa dari Llama 3.

Posting Sebelumnya: