Panduan Pengeditan Video Berbasis Instruksi WAN 2.7

WAN 2.7 menghadirkan pengeditan video berbasis instruksi. Apa itu, apa yang bisa diedit, bagaimana integrasinya dalam pipeline produksi, dan apa yang perlu diketahui para pengembang.

Halo semuanya. Saya Dora. Saya sudah bekerja dengan alat video AI cukup lama, dan ketika pertama kali mendengar tentang fitur pengeditan berbasis instruksi milik WAN 2.7, saya tidak langsung yakin bahwa fitur ini akan mengubah banyak hal. Mengedit video dengan perintah teks terdengar seperti salah satu fitur yang terlihat bagus dalam demo tapi berantakan ketika benar-benar digunakan.

Saya akui saya sedikit salah.

Apa Itu Pengeditan Video Berbasis Instruksi di WAN 2.7

Anda mengambil klip video yang sudah ada, menulis apa yang ingin diubah, dan model menyesuaikan elemen spesifik tersebut sambil menjaga semua yang lain tetap utuh. Bukan regenerasi. Sebuah pengeditan.

Perbedaannya dengan generasi teks-ke-video standar

Teks-ke-video dimulai dari nol. Anda menulis prompt dan mendapatkan apa pun yang keluar.

Pengeditan berbasis instruksi dimulai dari sesuatu yang sudah ada. Klipnya sudah ada. Timingnya sudah diatur. Anda meminta model untuk mengubah satu bagian—mengganti latar belakang, menggeser pencahayaan, mewarnai ulang pakaian—tanpa menyentuh sisanya.

Analisis WaveSpeedAI mencatat hal ini penting secara operasional: siklus iterasi yang sebelumnya mengharuskan regenerasi klip dari awal kini bisa ditangani sebagai pengeditan ringan. Meregenerasi hanya karena warna jaket salah terasa boros. Mengedit hanya jaketnya terasa tepat.

Perbedaannya dengan Rekonstruksi Video

Rekonstruksi mengambil struktur gerak video referensi dan menerapkannya pada subjek atau gaya baru. Transfer gerakan.

Pengeditan berbasis instruksi memodifikasi. Klip asli tetap ada; hanya elemen yang Anda tentukan yang berubah.

Apa yang diterima model sebagai input

Dua hal: video sumber (hingga 15 detik pada 1080P) dan instruksi dalam bahasa alami.

Yang mengejutkan saya: tidak ada masking, tidak ada isolasi layer. Hanya klip dan kalimatnya.

Apa yang Bisa dan Tidak Bisa Diedit dengan Instruksi

Kategori pengeditan yang didukung

Dari pengujian dan dokumentasi platform Dzine, pengeditan berbasis instruksi dapat menangani:

- Penggantian latar belakang (dalam ruangan ke luar ruangan, cerah ke hujan)

- Pergeseran pencahayaan (golden hour ke blue hour)

- Penyesuaian tingkat objek (ubah warna kemeja, tambah properti)

- Modifikasi gaya (realistis ke ilustrasi)

Ini berhasil karena merupakan perubahan yang terbatas. Model mengetahui apa itu latar belakang, apa yang dilakukan pencahayaan.

Apa yang sulit diedit dengan instruksi

Penataan ulang spasial yang kompleks tidak bekerja dengan baik. “Pindahkan karakter ke kiri” tidak menghasilkan hasil yang bersih. Karakter tetap di tempat atau komposisi bergeser secara canggung.

Adegan yang sarat identitas—ekspresi wajah tertentu, detail logo yang halus—sulit diedit. Model dapat mengubah pencahayaan tetapi kesulitan mempertahankan fitur yang tepat saat mengubah ekspresi atau usia.

Perubahan fisika hasilnya tidak konsisten. “Buat air mengalir lebih cepat” kadang berhasil, kadang terlihat glitch.

Granularitas pengeditan

Semua pengeditan berada di tingkat prompt. Anda mendeskripsikan apa yang berubah; model menyimpulkan bagian mana yang berlaku. Belum ada penargetan tingkat objek.

Saya belajar untuk menulis instruksi yang sangat spesifik. “Ubah jaket menjadi merah” bekerja lebih baik daripada “buat pakaiannya bernuansa lebih hangat.”

Merancang Instruksi Pengeditan yang Efektif

Apa yang membuat instruksi pengeditan menjadi baik

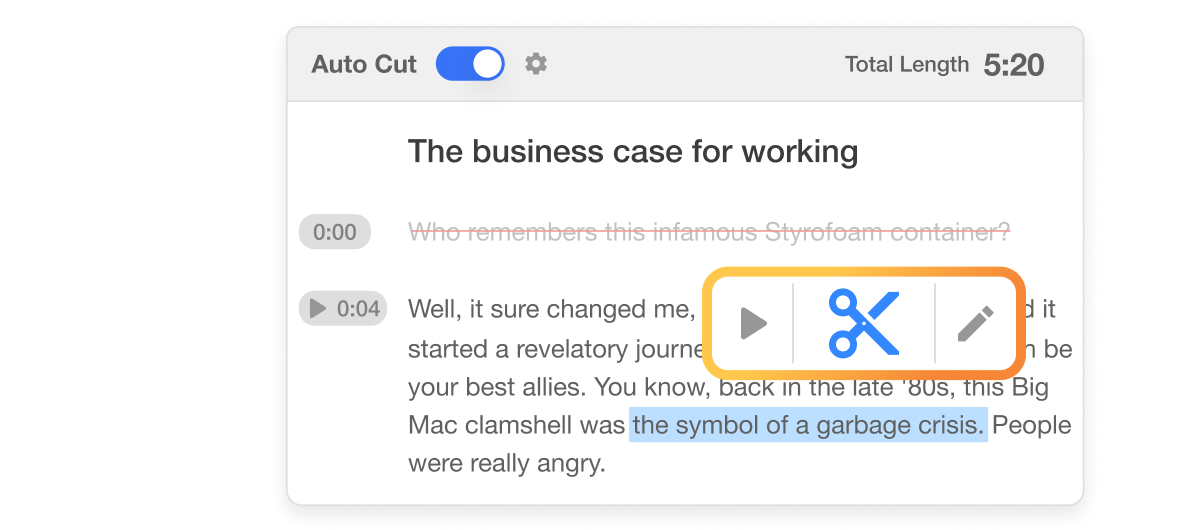

Instruksi yang baik bersifat spesifik, terarah, dan terbatas. Pendekatan ini mencerminkan filosofi di balik alat seperti Descript, di mana Anda dapat mengedit video hanya dengan mengedit teks tanpa masking atau isolasi layer apa pun.

“Ubah langit menjadi mendung dengan awan gelap” berhasil secara konsisten. Ini menentukan apa yang berubah, apa yang menjadi hasilnya, dan menambahkan detail.

“Buatnya terlihat lebih dramatis” tidak berhasil. Terlalu samar. Model menginterpretasikannya secara berbeda setiap kali.

Apa yang membuat instruksi menjadi buruk

Instruksi yang bertentangan dengan klip sumber gagal secara diam-diam. “Hapus orang dari adegan” pada pengambilan gambar yang berfokus pada karakter baik diabaikan atau menghasilkan frame yang rusak.

Instruksi dengan beberapa elemen yang saling bertentangan kesulitan. “Ubah jaket menjadi biru dan latar belakang menjadi hutan dan tambahkan hujan” mencoba tiga pengeditan sekaligus. Satu pengeditan per instruksi bekerja lebih baik. Pola prompting yang jelas ini—nyatakan apa yang berubah dan deskripsikan keadaan target—sejalan dengan praktik terbaik yang terlihat dalam pengeditan video berbasis teks Visla, di mana Anda menyempurnakan footage dengan langsung mengedit transkripnya.

Pola prompting

Pola yang berhasil:

- Nyatakan apa yang berubah

- Deskripsikan keadaan target

- Buat di bawah 15 kata

“Ganti latar belakang perkotaan dengan lanskap pegunungan” — subjek jelas, target jelas, hasil bersih.

Persyaratan Input

Spesifikasi video sumber

Video sumber: 2 hingga 15 detik, hingga 1080P. Saya menguji klip 5 detik pada 1080P dan klip 10 detik pada 720P. Keduanya berhasil.

Keselarasan referensi

Jika sumber Anda memiliki motion blur berat, potongan cepat, atau eksposur ekstrem, hasil pengeditan akan menurun. Model membutuhkan frame yang jelas.

Pengambilan gambar dengan pan cepat menghasilkan penggantian latar belakang yang kabur. Pengambilan gambar statis atau bergerak lambat menghasilkan pengeditan yang bersih.

Di Mana Pengeditan Berbasis Instruksi Cocok dalam Pipeline Produksi

Saya tidak menyangka akan menggunakannya sebagai alat utama. Saya mengira itu hanya sebuah kebaruan. Ternyata bukan.

Loop pemolesan pasca-generasi

Setelah menghasilkan klip dengan teks-ke-video standar, saya sering mendapatkan 80% dari yang saya inginkan. Gerakannya benar, pembingkaiannya benar, tetapi gradasi warnanya terasa tidak tepat atau latar belakangnya tidak sesuai brief.

Sebelum pengeditan berbasis instruksi, itu berarti meregenerasi dengan prompt yang disesuaikan dan berharap. Tingkat keberhasilan: mungkin 40%. Setiap regenerasi membutuhkan 60-90 detik, dan saya sering menghabiskan tiga atau empat percobaan sebelum mendapatkan sesuatu yang bisa digunakan.

Sekarang saya menghasilkan sekali, lalu mengedit elemen spesifik yang salah. Tingkat keberhasilan mendekati 70%, dan iterasinya lebih cepat. Alih-alih tiga regenerasi penuh selama 90 detik masing-masing (total 4,5 menit), saya melakukan satu generasi ditambah satu pengeditan (sekitar 2,5 menit total). Penghematan waktu bertambah di berbagai proyek.

Iterasi gaya tanpa regenerasi penuh

Saya menguji ini dengan menghasilkan satu klip dasar dari karakter yang berjalan melalui jalan kota, lalu membuat tiga varian gaya dengan pengeditan instruksi:

- “Ubah ke estetika neon cyberpunk”

- “Ubah ke gaya lukisan cat air”

- “Jadikan hitam putih film noir”

Ketiga pengeditan tersebut mempertahankan gerakan dan komposisi asli. Hanya gaya visualnya yang berubah. Siklus jalan karakter tetap identik. Pergerakan kamera tidak bergeser.

Itu berguna untuk presentasi klien di mana Anda ingin menampilkan pilihan konsep tanpa meregenerasi seluruh adegan tiga kali. Juga berguna untuk pengujian A/B kreasi iklan tanpa menghabiskan kredit generasi.

Saya mencoba alur kerja yang sama dengan regenerasi alih-alih pengeditan—menulis tiga prompt berbeda dengan kata kunci gaya yang sudah disematkan. Dua dari tiga kembali dengan timing gerakan yang sedikit berbeda, yang merusak perbandingan. Pengeditan menjaga semua hal sebanding kecuali variabel gaya yang saya uji.

Perbandingan biaya: edit vs regenerasi

Berdasarkan analisis biaya WaveSpeedAI, pengeditan berbasis instruksi kemungkinan akan memiliki profil biaya yang berbeda dari generasi standar, tetapi harga pastinya belum dipublikasikan.

Dari perspektif alur kerja, meskipun biaya pengeditan sama per detik dengan generasi, tetap lebih murah dalam praktiknya karena Anda tidak membuang percobaan yang gagal. Satu generasi ditambah satu pengeditan terarah mengalahkan tiga regenerasi penuh.

Perhitungannya: Jika generasi berharga $0,12/detik untuk 1080P (harga WAN 2.6 dari PiAPI), klip 5 detik berharga $0,60. Tiga regenerasi berharga $1,80. Satu generasi ditambah satu pengeditan—bahkan jika pengeditan berharga sama $0,60—hanya berharga $1,20. Itu penghematan 33% hanya dari mengurangi pemborosan.

Jika pengeditan ternyata lebih murah dari generasi (yang tampaknya mungkin mengingat itu memodifikasi frame yang sudah ada alih-alih membuat yang baru dari awal), penghematannya berlipat ganda.

Implikasi Akses API

Endpoint terpisah atau flag parameter?

Analisis WaveSpeedAI menyarankan pengeditan berbasis instruksi akan memerlukan field payload baru—kemungkinan parameter edit_instruction dan mungkin endpoint yang berbeda.

Saya menunggu dokumentasi API resmi sebelum integrasi produksi.

Biaya token dan komputasi

Inferensi multi-input lebih berat dari generasi single-input. Pengeditan berbasis instruksi memproses baik video sumber maupun instruksi pengeditan, yang berarti biaya komputasi lebih tinggi.

Anggarkan sesuai, tetapi jangan finalisasi proyeksi sampai harga mulai berlaku.

Pertimbangan async job

Semua operasi WAN berjalan secara asinkron. Kirim permintaan, dapatkan task ID, polling sampai selesai.

Waktu tunggu yang diperkirakan dari pengujian saya: 30 detik hingga 2 menit untuk pengeditan 1080P 5 detik.

FAQ

Apakah pengeditan berbasis instruksi tersedia melalui WaveSpeed API saat peluncuran?

WAN 2.7 diluncurkan dalam bulan Maret 2026. Ketersediaan API untuk pengeditan berbasis instruksi belum dikonfirmasi. WaveSpeedAI biasanya menambahkan endpoint baru dalam beberapa hari setelah rilis resmi.

Berapa lama video sumber yang bisa diedit?

Hingga 15 detik pada 1080P. Klip yang lebih pendek (2-5 detik) diproses lebih cepat dan menghasilkan pengeditan yang lebih bersih.

Apakah pengeditan mempertahankan audio asli? Tergantung pengeditannya. Perubahan latar belakang mempertahankan audio. Pergeseran gaya yang mengubah estetika visual terkadang memengaruhi sinkronisasi. Perlu diuji kasus per kasus.

Postingan Sebelumnya:

- Temukan cara kerja pengeditan instruksi bahasa alami di WAN 2.7

- Lihat perbedaan utama antara WAN 2.7 dan WAN 2.6, terutama untuk pengeditan berbasis instruksi yang ringan

- Pelajari cara praktis menggabungkan pengeditan berbasis instruksi dengan kontrol frame pertama/terakhir

- Jelajahi fitur baru WAN 2.7 termasuk pengeditan video berbasis instruksi dan jalur peningkatan API

- Pahami kasus penggunaan produksi dunia nyata dan manfaat iterasi dari pengeditan berbasis instruksi di WAN 2.7