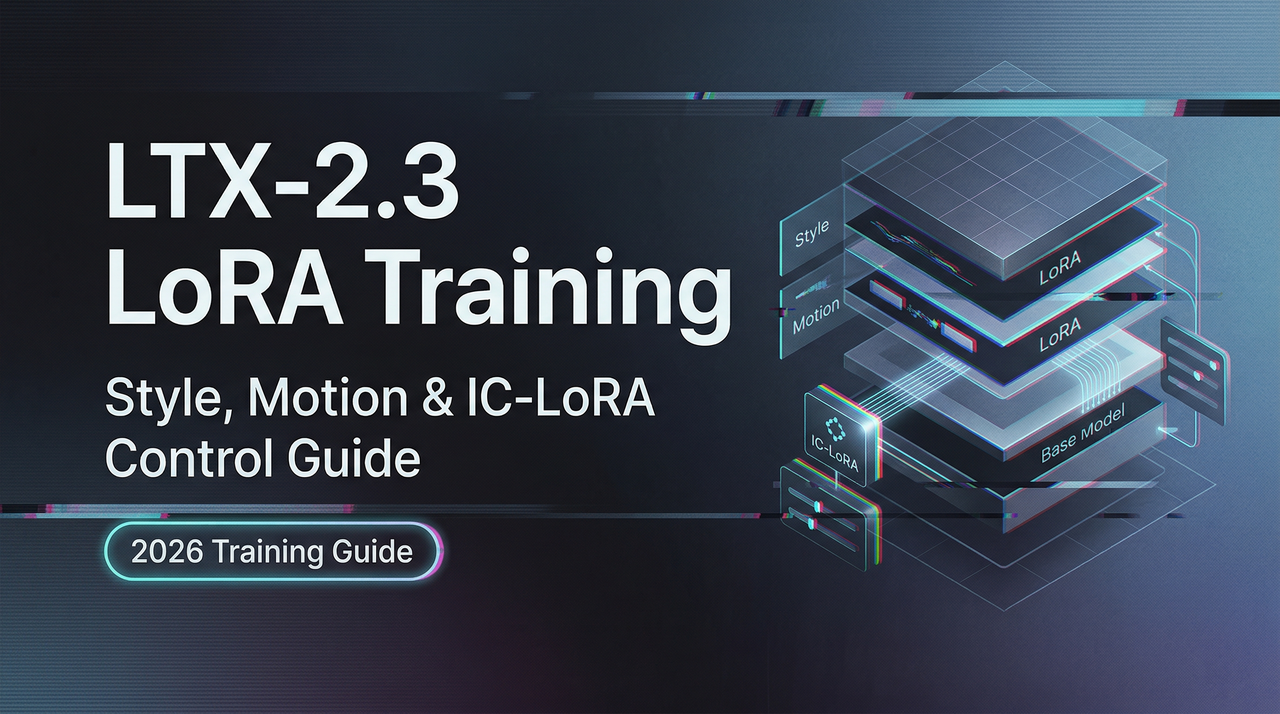

Panduan Pelatihan LoRA LTX-2.3: Kontrol Gaya, Gerakan & IC-LoRA (2026)

Latih LoRA kustom pada LTX-2.3 menggunakan ltx-trainer resmi. Mencakup LoRA gaya, kontrol struktural IC-LoRA, pengaturan rank, persiapan dataset, dan kegagalan pelatihan umum.

Hei, sobat. Ini Dora.

Aku tidak berencana menghabiskan seminggu untuk melatih LoRA. Aku hanya butuh demo produk yang mengikuti pola gerak tertentu, dan prompt teks saja tidak cukup. Gesekan kecil itu membawaku menyusuri jalur pelatihan LTX-2.3, dan apa yang aku temukan cukup mengejutkan — bukan karena revolusioner, tapi karena ternyata sangat praktis begitu kamu tahu pengaturan mana yang benar-benar penting.

Ini bukan referensi lengkap. Ini adalah hal-hal yang aku pelajari saat menguji alur kerja style, motion, dan kontrol IC-LoRA pada Maret 2026.

Apa yang Disertakan dalam Trainer Resmi LTX-2.3

Repositori GitHub LTX-2 diorganisir sebagai monorepo dengan tiga paket: ltx-core untuk implementasi model, ltx-pipelines untuk alur kerja generasi, dan ltx-trainer untuk fine-tuning LoRA dan IC-LoRA. Pengaturan lebar dan tinggi harus habis dibagi 32, dan jumlah frame harus mengikuti aturan 8n+1 — yaitu 1, 9, 17, 25 frame, dan seterusnya.

Aku mengabaikan ini di sesi pelatihan pertamaku. Trainer mengalami error, aku menambahkan frame secara manual, dan akhirnya berhasil. Batasan kecil, tapi patut diketahui sejak awal.

Tiga Jenis LoRA dan Kapan Menggunakannya

Style LoRA (tampilan, tekstur, warna)

Style LoRA mengajarkan estetika visual kepada LTX-2.3 — gradasi warna, perlakuan tekstur, suasana pencahayaan. Aku melatih satu LoRA untuk fotografi produk dengan latar putih yang konsisten dan bayangan lembut. Untuk LoRA karakter atau style, 20-50 gambar biasanya sudah cukup untuk mendapatkan hasil yang solid, meskipun untuk subjek yang sangat spesifik aku pernah mendorong hingga 80-120 gambar.

Dataset berisi gambar saja sudah cukup di sini. Untuk beberapa LoRA pertamaku, aku menggunakan still frame daripada klip video — lebih mudah dikurasi, dan model mempelajari identitas tanpa perlu memproses gerakan.

Motion / Effect LoRA (gerakan, transformasi)

Motion LoRA berfokus pada cara benda bergerak daripada penampilannya. Pergerakan kamera, rotasi objek, urutan transformasi. Ini membutuhkan klip video pendek yang koheren, bukan gambar diam. Aku menguji motion LoRA dolly-in dengan klip 15 detik pada framing yang konsisten, dan model berhasil menangkap pola gerakan di berbagai subjek yang berbeda.

Melatih motion terasa kurang stabil dibandingkan style. Lebih banyak percobaan ulang, hasil lebih bervariasi.

IC-LoRA (kontrol struktural: depth, pose, canny edge)

IC-LoRA berbeda. Alih-alih mengajarkan estetika baru atau gerakan pada model, IC-LoRA mengondisikan generasi berdasarkan sinyal referensi — depth map, pose skeleton, deteksi tepi. IC-LoRA memungkinkan pengondisian generasi video pada frame video referensi saat inferensi, memungkinkan kontrol video-ke-video yang presisi di atas model dasar text-to-video.

Aku menggunakan depth IC-LoRA untuk mengunci pergerakan kamera sambil mengubah konten visual sepenuhnya. Panduan IC-LoRA resmi menjelaskan tiga mode kontrol dengan baik: Canny untuk preservasi tepi, Depth untuk kamera dan geometri spasial, Pose untuk transfer gerakan manusia.

Aturan Persiapan Dataset

Batasan Jumlah Frame (aturan 8n+1)

Jumlah frame harus habis dibagi 8 + 1. Ini bukan panduan yang bisa diabaikan — jika klipmu memiliki 10 frame atau 15 frame, trainer akan error atau mengisinya secara internal. Aku memproses datasetku secara batch menjadi 17 frame (2 × 8 + 1) sebelum mengunggah, dan pelatihan berjalan lancar.

Pembagian Resolusi (aturan 32px)

Lebar dan tinggi harus habis dibagi 32. Aku mengetahui ini setelah mengubah ukuran batch menjadi 1024×576 dan melihat trainer secara diam-diam mengisinya menjadi 1024×608. Lebih baik mengubah ukuran dengan benar sejak awal.

Dataset Video vs Gambar: Kapan Menggunakan Masing-masing

Dataset berisi gambar saja valid untuk pelatihan LoRA LTX-2.3. Ini jauh lebih mudah daripada memaksa pembelajaran gerakan terlalu awal, terutama untuk LoRA identitas atau style. Aku memulai setiap proyek dengan still frame, memvalidasi tampilan, kemudian menambahkan klip video pendek jika gerakan diperlukan.

Untuk pekerjaan yang berfokus pada motion, klip pendek yang koheren tetap lebih baik dari segmen panjang multi-adegan.

Pengaturan Pelatihan Dasar

Rank 32 sebagai Default yang Tepat dan Kapan Menggunakan yang Lebih Tinggi

Untuk LTX-2.3, rank 32 adalah default yang tepat. Biasanya memberikan kapasitas yang cukup tanpa membuat LoRA terlalu kaku terlalu awal. Aku menguji rank 64 pada style LoRA yang kompleks dan melihat peningkatan minimal — kapasitas ekstra tidak membantu karena dataset saya tidak cukup besar atau beragam untuk mengisinya.

Titik Awal Learning Rate dan Kapan Mengubahnya

Untuk pelatihan LoRA LTX-2.3, 1e-4 adalah tempat yang tepat untuk memulai. Ini adalah salah satu kasus di mana jawaban yang membosankan adalah jawaban yang benar. Aku tidak menyentuh learning rate pada empat LoRA pertamaku, dan semuanya konvergen dengan bersih.

Jumlah Step: Cara Mengetahui Kapan Harus Berhenti Lebih Awal

Banyak pengguna membuang waktu dengan langsung melompat ke jumlah step yang tinggi sebelum memeriksa apakah checkpoint 250, 500, atau 750 sudah terlihat bagus. Aku mengambil sampel di checkpoint 500, dan jika LoRA sudah terlihat kuat, aku berhenti di sana. Jika LoRA sudah terlihat kuat di checkpoint 750 atau 1000, mendorongnya lebih jauh hanya bisa membuatnya lebih rapuh.

Overfitting terlihat ketika model menghafal data pelatihan daripada melakukan generalisasi. Sampel validasi mulai terlihat identik dengan frame pelatihan.

IC-LoRA: Kontrol Depth, Pose, dan Edge

Perbedaan IC-LoRA dari Style LoRA Standar

IC-LoRA memisahkan gerakan dari gaya visual. Kamu mengarahkan tampilan dengan teks dan style LoRA, dan mengarahkan gerakan dengan panduan terstruktur. Model kontrol union IC-LoRA LTX-2.3 mendukung beberapa sinyal kontrol — depth, pose, edge — dalam satu adapter.

Aku menjalankan depth IC-LoRA pada urutan turntable produk. Jalur kamera tetap terkunci pada depth map referensi, tetapi konten visual berubah sepenuhnya berdasarkan promptku.

Integrasi Alur Kerja IC-LoRA di ComfyUI

Alur kerja RunComfy LTX 2.3 IC-LoRA menangani ekstraksi depth, pose, dan edge secara otomatis. Muat klip referensi, pilih mode kontrol, tulis prompt yang berfokus pada gaya, dan model menangani gerakan secara terpisah.

Satu detail yang aku lewatkan pada awalnya: buat prompt terfokus pada penampilan karena IC-LoRA menangani gerakan dan struktur. Mencoba mendeskripsikan gerakan kamera dalam prompt sementara IC-LoRA sedang mengontrolnya akan menciptakan konflik.

Kegagalan Pelatihan Umum dan Solusinya

LoRA yang Merembes ke Mana-mana (Solusi DOP)

DOP (Dropout of Prompts) adalah opsi lanjutan pertama yang layak dicoba ketika LoRA mulai merembes ke mana-mana. Aku melatih style LoRA produk yang bekerja baik pada item serupa tetapi mulai mempengaruhi subjek yang tidak terkait. Menambahkan caption dropout membantu LoRA melakukan generalisasi.

Overfitting pada Jumlah Step Tinggi

Jangan anggap lebih banyak step sebagai peningkatan kualitas universal. Aku menjalankan motion LoRA hingga 2.000 step dan melihatnya mulai mereproduksi frame pelatihan yang persis daripada mempelajari pola yang mendasarinya. Kembali ke checkpoint 750.

Konflik Caption Dropout dan Cache Text Embeddings

Jika caption dropout digunakan, Cache Text Embeddings harus tetap NONAKTIF. Ini adalah salah satu dari sedikit pengaturan kecil yang bisa diam-diam memperburuk perilaku pelatihan jika digunakan secara tidak benar. Aku pernah mengaktifkan keduanya sekaligus dan mendapatkan hasil yang tidak konsisten — model tidak bisa memutuskan apakah harus mengandalkan embedding yang di-cache atau menangani caption yang hilang.

Memverifikasi LoRA Sebelum Deployment

Aku menjalankan tiga tes validasi sebelum menyatakan LoRA selesai: prompt yang sama dengan dan tanpa LoRA untuk mengonfirmasi bahwa ia menambahkan apa yang aku harapkan, prompt yang bervariasi untuk memeriksa generalisasi, dan kasus-kasus tepi yang tidak ada dalam set pelatihan. Jika LoRA hanya bekerja pada prompt yang sangat mirip dengan caption pelatihan, berarti ia overfit.

FAQ

Bisakah aku melatih LoRA di GPU A100 atau lebih kecil?

Pelatihan LTX-2.3 secara resmi menargetkan GPU Nvidia H100 dengan VRAM 80GB+, meskipun pengaturan VRAM yang lebih rendah bisa bekerja dengan gradient checkpointing dan resolusi yang dikurangi. Aku belum menguji pelatihan A100 sendiri, tetapi dokumentasi trainer resmi menyebutkan ini sebagai baseline hardware yang direkomendasikan.

Berapa lama pelatihan style LoRA di H100?

Sekitar 3-5 jam per LoRA pada satu GPU 4090 untuk dataset berukuran sedang, termasuk validasi dan restart kecil, menurut laporan dari lapangan. H100 seharusnya lebih cepat, meskipun aku tidak punya angka langsung.

Apakah LoRA LTX-2 bekerja di LTX-2.3 tanpa pelatihan ulang?

Tidak. LTX-2.3 hadir dengan VAE yang dirancang ulang sepenuhnya yang dilatih pada data berkualitas lebih tinggi, dan arsitektur text connector berubah. LoRA lama dari LTX-2 tidak dapat ditransfer dengan bersih — aku menguji ini dan mendapatkan artefak visual.

Bisakah IC-LoRA digabungkan dengan style LoRA?

Ya. Kamu bisa menumpuk hingga tiga adapter LoRA secara bersamaan, memadukan estetika kustom dengan kontrol struktural. Aku menjalankan style LoRA sebelum loader IC-LoRA dan menjaga bobotnya tetap moderat agar IC-LoRA dapat mempertahankan geometri dan timing.

Apakah pelatihan LoRA tersedia melalui platform cloud?

Ya. RunComfy AI Toolkit dan fal.ai keduanya menawarkan pelatihan berbasis browser tanpa perlu mengelola infrastruktur GPU. Unggah datasetmu, konfigurasikan parameter, unduh LoRA ketika selesai.

Melatih LoRA untuk LTX-2.3 bukanlah sihir. Ini adalah persiapan dataset, pengaturan dasar, dan mengetahui kapan harus berhenti lebih awal. Aturan frame 8n+1 dan batasan pembagian 32px terasa sewenang-wenang pada awalnya, tetapi itu hanyalah persyaratan geometri model. Bekerjalah bersama mereka, bukan mengelaknya.

Yang mengejutkanku bukan kompleksitasnya — melainkan betapa banyak waktu yang aku hemat dengan tetap menggunakan rank 32 dan learning rate 1e-4 daripada mengubah setiap parameter di run pertama.

Postingan Sebelumnya: