Panduan LTX-2.3 di ComfyUI: Pipeline Dua Tahap, Solusi VRAM & Encoder Gemma

Cara mengatur LTX-2.3 di ComfyUI: penempatan checkpoint, konfigurasi encoder Gemma 3 12B, pipeline pembuatan dua tahap, dan strategi VRAM rendah untuk GPU konsumen.

Hei, teman-teman. Saya Dora. Jujur saja, saya tidak berencana untuk beralih. Setup LTX-2 saya di ComfyUI berjalan dengan baik, dan saya bukan tipe orang yang suka ganti hanya karena ada yang baru. Tapi minggu lalu (Maret 2026), saya terus melihat catatan-catatan kecil tentang LTX-2.3: koherensi yang lebih baik, text encoder baru (Gemma 3 12B), dan jalur dua tahap yang menjanjikan gambar lebih tajam tanpa merusak VRAM.

Saya membuka pagi yang tenang dan memindahkan workflow saya. Ini yang benar-benar berubah bagi saya, di mana saya menemui kendala, dan bagian-bagian yang membuat pekerjaan terasa lebih ringan. Jika kamu langsung mencari langkah instalasi: semuanya ada di sini, tapi bagian yang paling berguna adalah trade-off yang saya perhatikan saat membangun workflow LTX-2.3 ComfyUI hari demi hari.

Apa yang Berbeda dari LTX-2.3 di ComfyUI (vs Setup LTX-2)

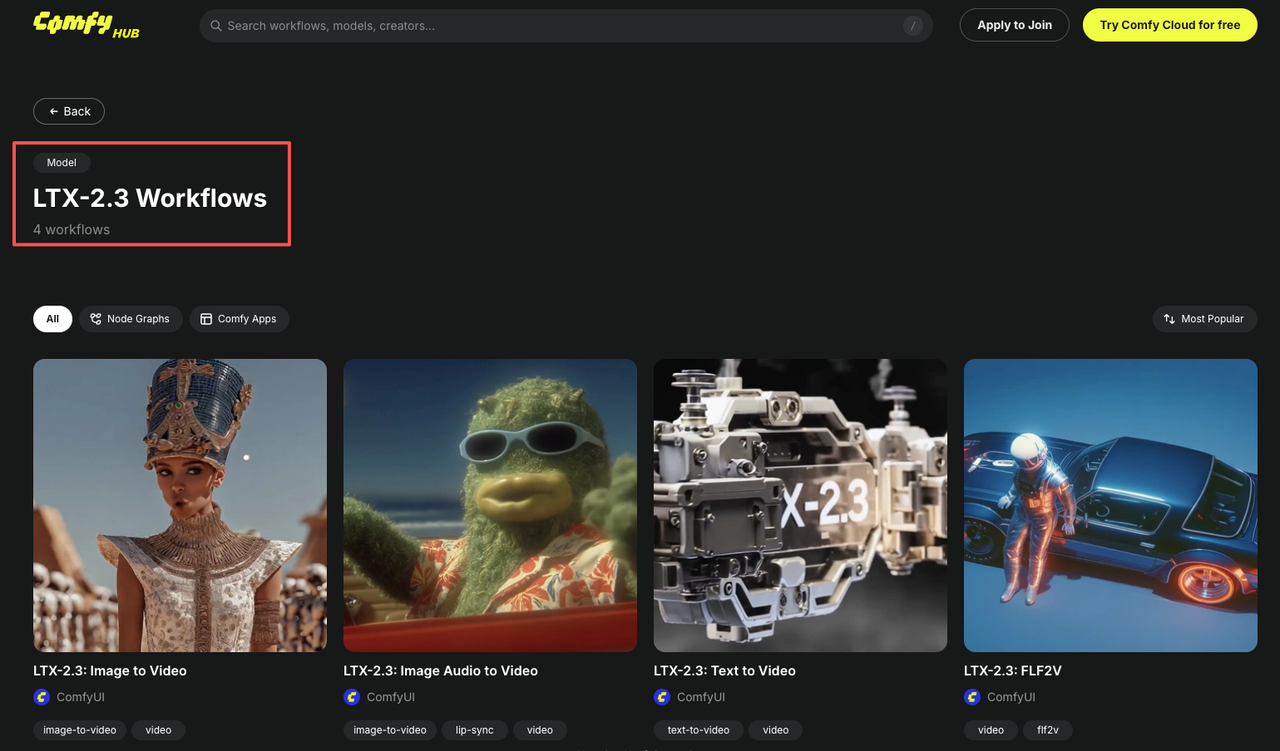

LTX-2.3 ComfyUI terasa seperti dorongan menuju keandalan daripada sebuah lompatan besar. Model ini mengharapkan Gemma 3 12B sebagai text encoder-nya, dan jalur yang direkomendasikan adalah pipeline dua tahap: generate di setengah resolusi untuk koherensi dasar, lalu upscale latent dengan upsampler khusus LTX. Dalam praktiknya, ini mengubah dua hal bagi saya:

- Prompt bertahan lebih baik pada jumlah langkah yang sedang. Saya melihat lebih sedikit detail yang “buram” saat tetap dalam 25–35 langkah di Stage 1.

- VRAM tidak seberbahaya yang saya khawatirkan, selama saya menghormati batas tahap dan tidak mencoba memaksakan full-res dalam satu kali proses.

Saya juga melihat bahwa node LTX-2 lama sebagian besar masih berfungsi, tapi LTX-2.3 lebih menyukai node sampler/latent upsampler miliknya sendiri. Hanya mengganti checkpoint saja tidak cukup. Di situlah saya pertama kali tersandung.

File yang Dibutuhkan dan Struktur Folder

Ini adalah setup yang saya dapatkan setelah beberapa kali gagal. Tidak rumit: ini adalah minimum yang menghentikan kotak error merah.

Opsi Checkpoint (dev / fp8 / distilled + distilled LoRA)

- dev: Bagus untuk bereksperimen. Sedikit lebih berat, tapi saya merasa lebih toleran ketika prompt melantur.

- fp8: Lebih ringan di VRAM. Pada kartu 12GB saya, fp8 memungkinkan saya menjaga batch size 1 tanpa OOM saat decode. Kualitas sedikit turun, tapi tidak dramatis untuk aset media sosial atau pemasaran.

- distilled + distilled LoRA: Output paling bersih untuk shot seperti produk dalam pengujian saya, tapi kamu perlu ingat untuk benar-benar memuat LoRA dan mengatur bobotnya (0.6–0.8 berhasil untuk saya). Tanpa LoRA aktif, hasilnya terlihat lebih mendekati dev.

Semua checkpoint disimpan di ComfyUI/models/checkpoints. Saya menyimpan LoRA di ComfyUI/models/loras dan menamainya dengan stem yang sama dengan checkpoint dasar agar saya bisa menemukan pasangannya dengan cepat.

Text Encoder Gemma 3 12B: Download dan Penempatan

LTX-2.3 membutuhkan text encoder Gemma 3 12B. Tergantung pada node stack kamu, kamu akan menggunakan bobot PyTorch atau file GGUF (untuk node berbasis llama.cpp). Saya mencoba keduanya.

- Jalur PyTorch: ditempatkan di ComfyUI/models/clip (beberapa node mendeteksi otomatis di sini). Jika node kamu meminta folder yang berbeda, ikuti dokumentasinya, jangan dilawan.

- Jalur GGUF: ditempatkan di ComfyUI/models/llm (atau folder text_encoders khusus node). Q4_K_M adalah titik manis bagi saya: Q3 menghemat lebih banyak memori tapi kehilangan beberapa nuansa pada prompt panjang.

Jika ragu, buka bantuan ”?” node atau README-nya. Nama folder itu penting.

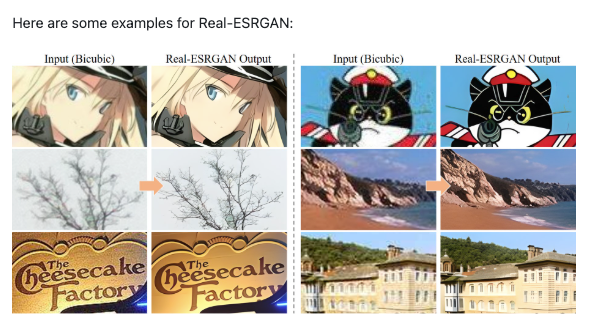

Model Upscaler: Kapan Harus Menyertakannya

Kamu tidak membutuhkan image upscaler eksternal jika kamu menggunakan latent upsampler LTX. Meski begitu, saya tetap menyimpan 4x ESRGAN dan latent upscaler SDXL x2 di ComfyUI/models/upscale_models untuk gambar non-LTX. Untuk LTX-2.3, LTXVLatentUpsampler bawaan bekerja lebih baik dari ESRGAN untuk tepi dan bentuk mirip teks.

Penjelasan Pipeline Dua Tahap

Saya terus mencoba melewati Stage 1. Itu adalah kesalahan. Jalur dua tahap ternyata lebih mudah dipahami dan lebih bersahabat dengan VRAM.

Stage 1, Koherensi Dasar di Setengah Resolusi

Saya generate di setengah ukuran target saya (misalnya, 640×384 untuk final 1280×768). Tahap ini menetapkan komposisi dan detail subjek. 25–35 langkah, CFG sedang (4–6), batch size 1. Jika ada yang salah, tangan, tata letak, pergeseran warna, lebih murah untuk diperbaiki di sini.

Yang saya perhatikan: lebih sedikit “penyimpangan” saat saya menyederhanakan prompt dan menggunakan maksimal satu atau dua style anchor. LTX-2.3 tampaknya memberikan hasil terbaik dengan bahasa yang terfokus.

Stage 2, Latent Upscaling untuk Ketajaman (LTXVLatentUpsampler)

Kemudian saya memasukkan latent Stage 1 ke dalam LTXVLatentUpsampler. Ini mempertajam tepi dan memulihkan detail halus tanpa mengulang komposisi. Saya biasanya menjalankan 15–20 langkah untuk upsampling. Ini bukan penghapus ajaib: jika dasarnya salah, upsampler hanya membuat kesalahan yang lebih tajam.

Dev + Distilled LoRA vs Full Distilled: Mana yang Digunakan

- Dev + Distilled LoRA: Default saya ketika saya sedang menjelajahi tampilan tertentu. Sedikit lebih fleksibel. Saya mengatur kekuatan LoRA sekitar 0.7 dan menyesuaikan jika tekstur terasa terlalu pas.

- Full Distilled: Ketika saya butuh output yang cepat dan konsisten untuk sebuah batch. Lebih pilih-pilih soal prompt tapi menghemat energi mental, lebih sedikit kejutan dari satu run ke run berikutnya.

Jika kamu merasa stuck, coba dev untuk Stage 1 (lebih longgar) dan distilled untuk Stage 2 (lebih ketat). Kombinasi itu menyelamatkan satu set potret bernuansa muram bagi saya.

Konfigurasi Encoder Gemma 3 12B: Manajemen VRAM

Gemma 3 12B adalah alasan utama saya mengantisipasi masalah. Ternyata tidak terlalu buruk, hanya perlu batasan yang jelas.

Offloading Encoder ke CPU/RAM Saat VRAM Terbatas

Pada kartu 12GB, saya melakukan offload encoder Gemma ke CPU untuk proses teks. Ini menambah beberapa detik per run tapi menghentikan OOM selama Stage 1. Jika node kamu mendukung mixed-device loading, atur layer attention ke GPU dan sisanya ke CPU. Rasanya: tidak lebih cepat, tapi lebih tenang, tidak ada crash keras di tengah ide.

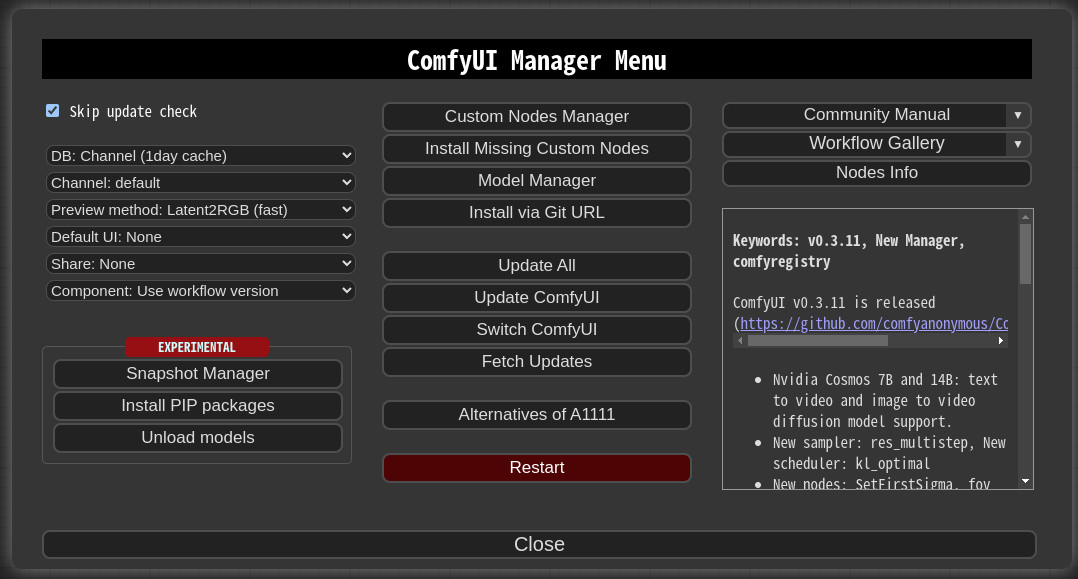

Flag —novram dan Perbaikan Startup Lainnya

Jika kamu menjalankan ComfyUI dengan flag perintah, —novram membantu memperhalus lonjakan memori saat penggantian model. Saya juga:

- Menonaktifkan “keep loaded” pada model besar di antara test run.

- Mengatur torch.set_grad_enabled(False) dalam custom init kecil (jika setup kamu mengizinkan) untuk menghindari gradient yang tidak perlu.

- Menggunakan jaring pengaman yang lebih kecil: checkpoint 16-bit atau fp8 saat saya tahu akan menumpuk LoRA.

Strategi VRAM Rendah untuk GPU Konsumen (12GB / 16GB / 24GB)

Yang berhasil di tiga mesin yang saya coba (RTX 3060 12GB, 4070 12GB, dan 4090 24GB):

Model Kuantisasi GGUF: Trade-off Q3 vs Q4

- Q3: Memori paling rendah, paling cepat dimuat, tapi saya kehilangan nuansa prompt dan melihat lebih banyak pengulangan dalam deskriptor.

- Q4: Sedikit lebih berat, koherensi yang jauh lebih baik. Pilihan saya untuk kartu 12–16GB. Untuk 24GB, saya melewati kuantisasi atau menggunakan Q5 jika tersedia.

VAE Offloading untuk Mengurangi Lonjakan Memori

Decode adalah tempat saya paling sering mengalami OOM. Melakukan offload VAE ke CPU atau menggunakan VAE yang lebih ringan mengurangi lonjakan di akhir Stage 2. Pada 12GB, saya juga mengatur decode akhir ke single image (tanpa batching) meskipun node sebelumnya melakukan batching, lebih sedikit drama.

Keuntungan kecil lainnya:

- Jaga resolusi tetap sederhana di Stage 1: upscale belakangan.

- Hindari menumpuk beberapa trik guidance. Satu CFG, satu LoRA dalam satu waktu.

Error Pertama Kali Berjalan yang Umum dan Solusinya

Saya menemui kotak merah biasa. Ini adalah solusi yang berhasil.

Error Node Tidak Ditemukan Setelah Load

Jika ComfyUI tidak dapat menemukan node LTX-2.3, perbarui repo custom-nodes kamu dan restart. Beberapa node LTX juga membutuhkan ComfyUI core yang lebih baru. Saya memperbaiki satu error yang membandel dengan menghapus folder cache node dan membiarkannya dibangun ulang saat launch.

OOM Saat Decode

Dua langkah ini langsung membantu: ganti checkpoint ke fp8 atau lakukan offload VAE ke CPU. Juga turunkan batch tahap terakhir ke 1. Jika masih crash, kurangi setengah resolusi target dan biarkan image upscaler eksternal menyelesaikan tugasnya.

Crash Encoder Gemma

Ini biasanya berarti ketidakcocokan folder atau file kuant yang tidak disukai node. Saya mengunduh ulang Gemma 3 12B dari sumber yang tercantum di README node, memverifikasi checksum, dan menempatkannya di mana yang diharapkan node (clip vs llm). Q4 berhasil: Q3 terkadang gagal dimuat di 4070 saya sampai saya memperbarui ke build berbasis llama.cpp terbaru.

FAQ

Apakah node ComfyUI LTX-2.3 perlu diinstal secara terpisah?

Biasanya ya. Memperbarui model saja tidak cukup. Tarik repo node LTX terbaru dan restart ComfyUI agar node sampler baru dan latent upsampler terdaftar.

Bisakah saya menggunakan workflow LTX-2 yang sudah ada dengan checkpoint LTX-2.3?

Sebagian. Saya bisa menggunakan kembali tata letaknya, tapi saya harus mengganti sampler LTX-2.3 dan LTXVLatentUpsampler, serta mengarahkan prompt ke Gemma 3 12B. Setelah itu, sebagian besar kontrol berperilaku normal.

Berapa VRAM minimum untuk menjalankan LTX-2.3 di ComfyUI?

Saya mendapatkan single-image run yang bisa digunakan pada 12GB dengan fp8 atau GGUF Q4 untuk encoder, Stage 1 di setengah resolusi, dan VAE di-offload. Lebih lancar di 16GB. Di 24GB, kamu bisa tetap di PyTorch dan bergerak lebih cepat.

Apakah pipeline dua tahap lebih cepat atau lebih lambat dari single-stage?

Waktu aktualnya bisa serupa, tapi terasa lebih ringan. Saya menghabiskan lebih sedikit waktu mengulang full-res yang meleset. Stage 1 menetapkan ide: Stage 2 merapikannya. Pada kartu 12GB, ini juga menjadi perbedaan antara berkreasi dan crash.

Saya tidak merasa “bersemangat” tentang LTX-2.3 ComfyUI. Lebih tepatnya lega. Gambar-gambar terlihat sesuai yang saya minta lebih cepat, dan workflow berhenti bertengkar dengan VRAM. Saya akan tetap menggunakan jalur dua tahap ini. Diam, dan bekerja dengan baik.

Postingan Sebelumnya: