Cara Menggunakan Seedance 2.0 via API: Async Jobs, Retry, dan Penanganan Hasil

Pola produksi untuk API Seedance 2.0: siklus hidup async job, retry, idempotency, observabilitas, dan pembatas biaya.

Ingin membuat video sinematik seperti Seedance 2.0? Coba WaveSpeed Cinematic Video Generator untuk membuat video sinematik berkualitas Seedance 2.0 sekarang juga.

Halo semuanya. Dora hadir. Begini ceritanya, saya terus-menerus memantau tugas yang berjalan lama di API Seedance 2.0 dan mendapati diri saya bolak-balik berpindah tab untuk memeriksa apakah sudah selesai. Bukan karena ada yang rusak, hanya terasa melelahkan. Selama beberapa hari, saya menjalankan sejumlah pekerjaan nyata (transformasi konten dan ekstraksi batch) dan memperhatikan bagian-bagian yang benar-benar mengubah cara kerja saya sehari-hari.

Berikut adalah sejumlah pola yang membuat pekerjaan terasa lebih stabil: cara saya mengirim, melacak, dan mengambil hasil; cara saya mengemas input; apa yang saya coba ulang (dan apa yang tidak); serta pagar pengaman dasar yang mencegah saya tersandung masalah kunci, biaya, dan log. Jika Anda sudah terbiasa bekerja dengan API, ini akan terasa familiar—memang disengaja demikian.

Siklus hidup job API (kirim → status → hasil)

Saya berusaha menyederhanakan API Seedance 2.0 dalam pikiran saya: tiga langkah, kirim, periksa status, ambil hasil. Ketika saya benar-benar memperlakukannya seperti itu, beban mental pun berkurang.

Kirim: Saya mengirim job dengan payload yang jelas dan berdiri sendiri, serta kunci idempotency yang dibuat oleh klien (lebih lanjut tentang itu nanti). Saya mencatat, dalam komentar kode untuk diri sendiri, apa yang saya anggap sebagai “selesai.” Bukan hal filosofis: hanya bentuk keberhasilan yang tepat (misalnya, JSON dengan field X, Y, Z; checksum yang cocok; tidak ada data parsial).

Status: Saya berhenti memikirkan status sebagai satu hal. Saya mengelompokkannya:

- Sedang berjalan (aman untuk di-poll)

- Terblokir (membutuhkan tindakan saya, biasanya input yang buruk)

- Terminal (berhasil atau gagal secara permanen)

Pemisahan kecil itu mengubah cara saya memeriksa. Jika sedang berjalan, saya mundur dan menunggu. Jika terblokir, saya perbaiki inputnya. Jika terminal, saya lanjutkan. Saya tidak menafsirkan berlebihan label-label perantara.

Hasil: Ketika sebuah job selesai, saya menarik output dalam format yang bisa saya percaya nantinya—biasanya JSON dengan skema yang stabil dan hash konten sederhana. Jika API mendukung webhook, saya tetap menggunakan polling sebagai cadangan. Webhook sangat bagus sampai ada aturan firewall atau gangguan antrean yang memakannya. Polling membosankan tapi andal.

Dua catatan lapangan kecil:

- Iterasi awal tidak menghemat waktu. Setelah beberapa iterasi, saya menyadari mereka menghemat perhatian. Lebih sedikit pemeriksaan “apakah itu sudah selesai?”, lebih banyak “saya akan melihatnya ketika benar-benar selesai.”

- Saya menghindari merangkai job di dalam API jika bisa dihindari. Satu job, satu hasil. Jika saya membutuhkan logika fan-out atau dependensi, saya simpan itu di sistem saya sendiri. Hal itu membuat pelacakan kesalahan dan percobaan ulang lebih bersih.

Jika Anda membangun di sekitar ini, state machine sederhana sangat membantu. Tidak perlu rumit, cukup beberapa status enum dan transisi yang jelas. Tidak mewah, tapi mampu menyerap kasus tepi tanpa menjadi kode spaghetti.

Desain payload (pengemasan teks + referensi)

Sebagian besar friksi saya berasal dari payload. Bukan kegagalan, hanya ketidakcocokan. Ketika saya sedikit mengangkat strukturnya, segalanya menjadi klik.

Saya berhenti mengirim blob teks raksasa secara inline jika tidak perlu. Sebagai gantinya, saya:

- Mengirim instruksi teks ringkas dan parameter secara inline.

- Meneruskan artefak besar (dokumen, media, output sebelumnya) melalui referensi, URL bertanda tangan atau kunci objek, dengan pengenal berversi.

Pemisahan ini membuat percobaan ulang lebih aman dan mengurangi churn unggahan. Ini juga membuat log lebih waras: saya bisa melihat apa yang berubah antar run tanpa menggulir megabyte konten. Jika API Seedance 2.0 membutuhkan teks dan referensi sekaligus, saya menyimpannya di bawah satu objek “input” dengan nama yang jelas. Diri saya di masa depan menghargai tidak harus berburu field yang terserak.

Memvalidasi input sebelum pengiriman

Sebelum mengirim apa pun, saya menjalankan tiga pemeriksaan secara lokal:

- Bentuk: Apakah payload cocok dengan skema saya sendiri? Field yang diperlukan ada, tipe benar, enum valid. Saya menggunakan validator JSON Schema untuk ini.

- Referensi: Apakah URL dapat diakses dan memenuhi aturan ukuran/tipe? Saya melakukan preflight HEAD request dan melampirkan content-length serta checksum jika tersedia.

- Ekspektasi: Apakah parameter konsisten dengan jenis job yang saya minta? Jika saya mengatakan “ringkas,” saya tidak juga meneruskan “full_transcript=true.” Terdengar konyol, tapi hal itu terjadi.

Pemeriksaan ini tidak membuat kesalahan menghilang: mereka memindahkannya ke tempat termurah untuk diperbaiki—sebelum jaringan, sebelum batas rate, sebelum saya membaca log tengah malam.

Pola keandalan

Setelah seminggu penggunaan yang stabil, sebagian besar sakit kepala saya berasal dari percobaan ulang yang tidak bisa saya nalarkan. Obatnya adalah pola sederhana yang bisa saya jelaskan kepada rekan tim dalam satu kalimat.

Saya membagi kegagalan menjadi dua kelompok:

- Aman untuk dicoba ulang (masalah jaringan sementara, 5xx, timeout sebelum pekerjaan server dimulai)

- Jangan coba ulang sembarangan (kesalahan validasi, kuota terlampaui, status yang tidak diketahui)

Setelah melakukan itu, sisanya menjadi lebih mudah.

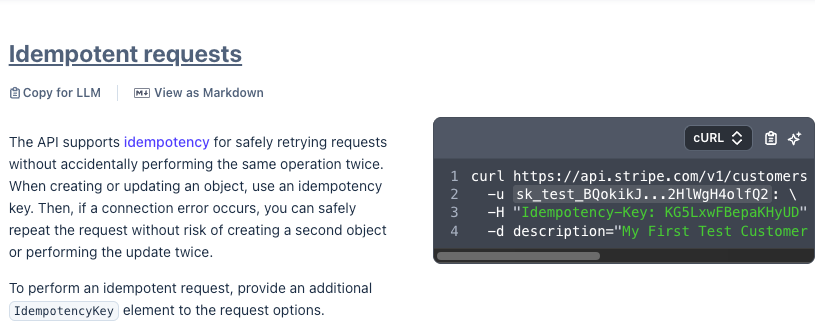

Kunci idempotency + percobaan ulang yang aman

Saya menambahkan kunci idempotency unik ke setiap pengiriman job. Server seharusnya memperlakukan pengulangan dengan kunci yang sama sebagai permintaan yang sama. Dalam praktiknya, saya mengasumsikan saya mungkin tidak tahu apakah permintaan berhasil mencapai server. Jadi saya membuat percobaan ulang aman secara desain.

Yang membantu:

- Turunkan kunci dari input yang stabil (misalnya, UUID ditambah hash dari payload yang dinormalisasi) sehingga duplikat yang tidak disengaja bertabrakan secara sengaja.

- Simpan kunci dan efek yang dimaksudkan dengan TTL singkat di sisi saya. Jika saya kehilangan respons, saya bisa melakukan percobaan ulang dengan percaya diri.

- Perlakukan operasi non-idempoten (seperti “mulai dan tagih”) sebagai idempoten di batas klien. Entah server yang memberlakukannya atau saya menghindari percobaan ulang otomatis.

Jika Anda menginginkan model mental yang solid, cara API pembayaran menangani ini sangat jelas. Dokumen idempotency keys Stripe ringkas dan layak dibaca sekilas, meskipun Anda tidak berurusan dengan uang.

Timeout, backoff, dan batas percobaan ulang

Saya menyimpan tiga angka di dekat saya: request timeout, initial backoff, dan max attempts.

Bentuk default saya terlihat seperti ini:

- Timeout: konservatif tapi tidak pelit. Cukup lama untuk pekerjaan server yang tipikal, cukup pendek untuk menghindari zombie socket. Jika sebuah job benar-benar berjalan lama, saya lebih memilih panggilan submit yang cepat dan polling terpisah.

- Backoff: eksponensial dengan jitter. Jitter itu penting. Tanpanya, percobaan ulang yang tersinkronisasi berperilaku seperti DDoS kecil.

- Batas: batas keras pada total percobaan ulang dan total waktu per job. Setelah mencapai batas, saya menampilkan kesalahan yang ramah pengguna dan berhenti. Tidak ada thrashing yang diam-diam.

Dalam praktiknya, angka-angka ini berubah dua kali: sekali setelah hari pertama (terlalu agresif), dan sekali setelah saya melihat pola lonjakan singkat sekitar jam penuh (saya menambahkan lebih banyak jitter). Tidak ada yang mewah. Hanya membuat sistem terasa lebih tenang.

Observabilitas (log, failure bucket, pemantauan biaya)

Saya tidak mengejar tracing penuh kecuali memang diperlukan. Untuk pekerjaan API Seedance 2.0, tiga tampilan sudah cukup:

- Log permintaan dengan correlation ID: Saya menandai setiap panggilan submit, status, dan hasil dengan correlation ID yang sama. Ketika sesuatu berjalan miring, saya bisa mengikuti satu job dari awal hingga akhir tanpa harus menebak-nebak. Konvensi semantik OpenTelemetry adalah panduan yang berguna jika Anda menyiapkan ini dari awal.

- Failure bucket: Saya mengelompokkan kegagalan berdasarkan penyebab (validasi, auth, kuota, timeout, 5xx, ketidakcocokan skema). Bucket membuat tren terlihat. Jika “kuota” tiba-tiba membengkak di hari Senin, saya merencanakan solusinya alih-alih memadamkan kebakaran.

- Lensa biaya: Saya mencatat estimasi biaya per job—input, output, percobaan ulang termasuk—dan merangkumnya setiap minggu. Tujuannya bukan presisi: melainkan merasakan kecenderungannya. Tampilan persentil sederhana (P50, P95) menunjukkan apakah beberapa outlier diam-diam menghabiskan anggaran.

Catatan kecil tentang peringatan: saya membuatnya membosankan. Tidak ada kembang api, hanya ambang batas yang terhubung ke tindakan: “failure bucket > X selama Y menit” atau “biaya P95 naik > Z% dari minggu ke minggu.” Saya lebih suka terlambat menyadari daripada hidup dalam false positive. Energi yang dihemat terbayar di tempat lain.

Dasar-dasar keamanan & kepatuhan (kunci, penanganan konten pengguna)

Tidak ada yang mewah di sini, dan itulah inti persoalannya. Hal-hal dasar melakukan sebagian besar pekerjaan.

- Kunci: Saya menyimpan kunci API di luar kode dan merotasinya secara terjadwal. Kunci per lingkungan, hak istimewa minimum jika scope tersedia, dan tidak dibagikan antar tim. Jika API mendukung token berumur pendek, saya menggunakannya.

- Konten pengguna: Saya tidak mencatat data pengguna mentah. Saya mencatat hash, ukuran, dan referensi. Jika saya membutuhkan sampel untuk debugging, saya scrub atau redaksi terlebih dahulu, dengan timer retensi yang jelas.

- Penanganan data: Saya menandai setiap job dengan ID tenant atau pengguna dan membawa tag itu ke log dan penyimpanan. Membosankan, tapi mencegah pemeriksaan akses berubah menjadi mitos tak tertulis.

- Penyimpanan: Hasil disimpan di bucket atau database dengan enkripsi sisi server dan ACL yang ketat. Jejak audit lebih penting daripada kecerdikan di sini.

- Postur kepatuhan: Jika sebuah tim membutuhkan kenyamanan SOC 2 atau GDPR, saya menuliskan dengan tepat apa yang pergi ke mana, siapa yang bisa melihatnya, dan untuk berapa lama. Tidak ada janji dalam kegelapan. Jika ragu, saya memeriksa halaman keamanan vendor dan persyaratan pemrosesan data alih-alih menebak.

Tes bagi saya sederhana: bisakah saya menjelaskan pengaturan ini kepada rekan yang peduli privasi tanpa berputar-putar? Jika tidak, saya belum menyederhanakannya cukup.

Satu catatan terakhir

Saya masuk dengan mencari kecepatan. Yang saya dapatkan adalah kestabilan. API Seedance 2.0 tidak menghilangkan langkah-langkah: ia membuatnya dapat diprediksi. Itu sudah cukup untuk membuat pekerjaan terasa lebih ringan. Saya masih memantau bagaimana biaya berkembang selama sebulan, dan apakah bucket saya bertahan di bawah jenis job baru. Pertanyaan yang tenang, tapi pertanyaan yang baik. Apakah Anda setuju?

Ingin membuat video sinematik seperti Seedance 2.0? Coba WaveSpeed Cinematic Video Generator untuk membuat video sinematik berkualitas Seedance 2.0 sekarang juga.