Guide d'édition vidéo par instructions avec WAN 2.7

WAN 2.7 ajoute l'édition vidéo basée sur des instructions. Ce que c'est, ce que vous pouvez modifier, comment l'intégrer dans un pipeline de production, et ce que les développeurs doivent savoir.

Bonjour à tous. Je m’appelle Dora. Je travaille avec des outils vidéo IA depuis un moment, et quand j’ai entendu parler pour la première fois de la fonctionnalité d’édition par instructions de WAN 2.7, je n’étais pas immédiatement convaincue que cela changerait grand-chose. Éditer une vidéo avec des commandes textuelles ressemblait à une de ces fonctionnalités qui impressionne en démo mais s’effondre dès qu’on en a vraiment besoin.

J’admets que j’avais partiellement tort.

Ce que Signifie l’Édition par Instructions dans WAN 2.7

On prend un clip vidéo existant, on écrit ce qu’on veut changer, et le modèle ajuste cet élément spécifique tout en conservant le reste intact. Pas une régénération. Une édition.

En quoi cela diffère de la génération texte-vers-vidéo standard

La génération texte-vers-vidéo part de zéro. On écrit un prompt et on obtient ce qui en ressort.

L’édition par instructions part de quelque chose qui existe déjà. Le clip est là. Le timing est défini. On demande au modèle de changer un élément — remplacer l’arrière-plan, modifier l’éclairage, recolorer une tenue — sans toucher au reste.

L’analyse de WaveSpeedAI souligne que cela a une importance opérationnelle : les cycles d’itération qui nécessitaient auparavant de régénérer des clips de zéro peuvent désormais être traités comme des éditions légères. Régénérer parce que la couleur de la veste était mauvaise semblait un gaspillage. Éditer uniquement la veste semblait juste.

En quoi cela diffère de la Récréation Vidéo

La récréation prend la structure de mouvement d’une vidéo de référence et l’applique à de nouveaux sujets ou styles. Un transfert de mouvement.

L’édition par instructions modifie. Le clip original reste ; seul l’élément que vous spécifiez change.

Ce que le modèle reçoit en entrée

Deux choses : la vidéo source (jusqu’à 15 secondes en 1080P) et une instruction en langage naturel.

Ce qui m’a surprise : pas de masquage, pas d’isolation de calques. Juste le clip et la phrase.

Ce que Vous Pouvez et Ne Pouvez Pas Éditer avec des Instructions

Catégories d’édition prises en charge

D’après les tests et la documentation de la plateforme Dzine, l’édition par instructions gère :

- Les échanges d’arrière-plan (intérieur vers extérieur, ensoleillé vers pluvieux)

- Les changements d’éclairage (heure dorée vers heure bleue)

- Les ajustements au niveau des objets (changer la couleur d’une chemise, ajouter des accessoires)

- Les modifications de style (réaliste vers illustré)

Cela fonctionne parce que ce sont des changements délimités. Le modèle sait ce qu’est un arrière-plan, ce que fait l’éclairage.

Ce qui résiste à l’édition par instructions

Les réarrangements spatiaux complexes ne fonctionnent pas bien. « Déplacer le personnage vers la gauche » n’a pas produit de résultats nets. Le personnage restait en place ou la composition se déplaçait de manière maladroite.

Les scènes à forte identité — expressions faciales spécifiques, détails fins de logo — résistent à l’édition. Le modèle peut changer l’éclairage mais a du mal à maintenir des traits exacts lors de la modification d’une expression ou de l’âge.

Les changements physiques sont aléatoires. « Faire couler l’eau plus vite » a parfois fonctionné, parfois semblait défaillant.

Granularité des éditions

Toutes les éditions se font au niveau du prompt. On décrit ce qui change ; le modèle infère à quelle partie cela s’applique. Pas encore de ciblage au niveau des objets.

J’ai appris à écrire des instructions très précises. « Changer la veste en rouge » fonctionnait mieux que « rendre la tenue dans des tons plus chauds ».

Concevoir des Instructions d’Édition Efficaces

Ce qui fait une bonne instruction d’édition

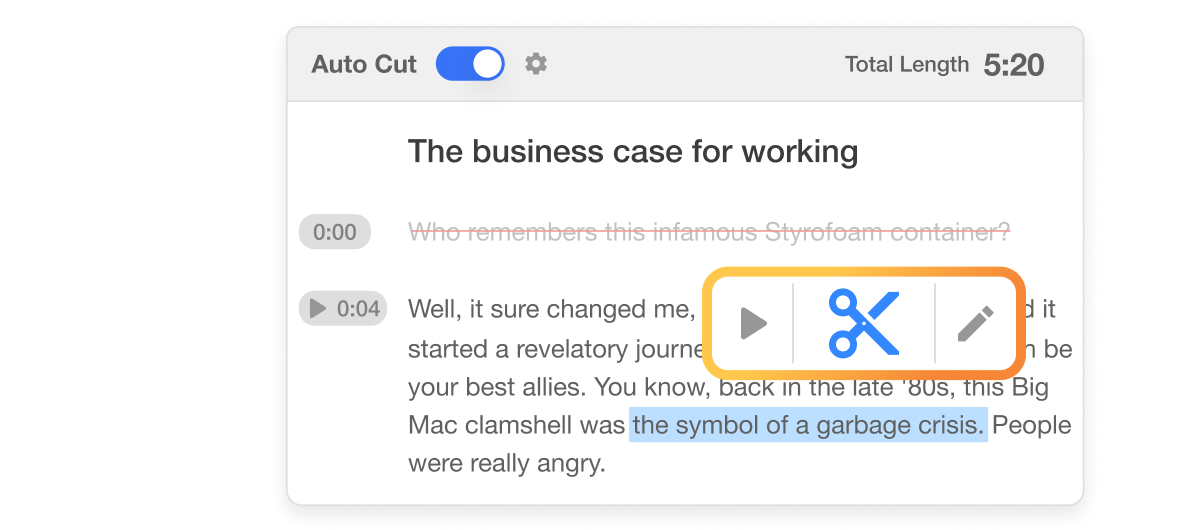

Les bonnes instructions sont spécifiques, directionnelles et délimitées. Cette approche reflète la philosophie derrière des outils comme Descript, où on peut éditer une vidéo simplement en éditant le texte sans masquage ni isolation de calques.

« Changer le ciel en ciel couvert avec des nuages sombres » fonctionnait de manière consistante. Cela spécifie ce qui change, ce vers quoi ça évolue, et ajoute des détails.

« Rendre ça plus dramatique » ne fonctionnait pas. Trop vague. Le modèle l’interprétait différemment à chaque fois.

Ce qui fait une mauvaise instruction

Les instructions qui contredisent le clip source échouent silencieusement. « Supprimer la personne de la scène » sur un plan centré sur un personnage était soit ignoré, soit produisait des images cassées.

Les instructions avec plusieurs éléments conflictuels peinent. « Changer la veste en bleu et l’arrière-plan en forêt et ajouter de la pluie » tentait trois éditions à la fois. Une édition par instruction fonctionnait mieux. Ce schéma de prompt clair — indiquer ce qui change et décrire l’état cible — s’aligne avec les meilleures pratiques observées dans l’édition vidéo basée sur le texte de Visla, où on affine les séquences en éditant directement la transcription.

Schéma de prompting

Le schéma qui a fonctionné :

- Indiquer ce qui change

- Décrire l’état cible

- Rester sous 15 mots

« Remplacer l’arrière-plan urbain par un paysage de montagne » — sujet clair, cible claire, résultats nets.

Exigences d’Entrée

Spécifications de la vidéo source

Vidéos sources : 2 à 15 secondes, jusqu’en 1080P. J’ai testé des clips de 5 secondes en 1080P et des clips de 10 secondes en 720P. Les deux ont fonctionné.

Alignement de la référence

Si votre source présente un flou de mouvement important, des coupes rapides ou une exposition extrême, les résultats d’édition se dégradent. Le modèle a besoin de plans nets.

Les plans avec panoramiques rapides ont produit des échanges d’arrière-plan flous. Les plans statiques ou à mouvement lent ont produit des éditions nettes.

Où l’Édition par Instructions S’intègre dans un Pipeline de Production

Je ne m’attendais pas à l’utiliser comme outil principal. Je pensais que ce serait une nouveauté. Ce n’est pas le cas.

Boucle de polish post-génération

Après avoir généré un clip avec la génération texte-vers-vidéo standard, j’obtenais souvent 80% de ce que je voulais. Le mouvement était bon, le cadrage était bon, mais l’étalonnage des couleurs semblait mauvais ou l’arrière-plan ne correspondait pas au brief.

Avant l’édition par instructions, cela signifiait régénérer avec des prompts ajustés en espérant. Taux de réussite : peut-être 40%. Chaque régénération prenait 60 à 90 secondes, et je brûlais souvent trois ou quatre tentatives avant d’obtenir quelque chose d’utilisable.

Maintenant, je génère une fois, puis j’édite l’élément spécifique qui ne va pas. Le taux de réussite est plus proche de 70%, et l’itération est plus rapide. Au lieu de trois régénérations complètes à 90 secondes chacune (4,5 minutes au total), je fais une génération plus une édition (environ 2,5 minutes au total). Les économies de temps s’accumulent sur plusieurs projets.

Itération de style sans régénération complète

J’ai testé cela en générant un clip de base d’un personnage marchant dans une rue de la ville, puis en créant trois variantes de style avec des éditions par instructions :

- « Passer à une esthétique néon cyberpunk »

- « Changer vers un style peinture aquarelle »

- « Rendre ça en film noir noir et blanc »

Les trois éditions ont préservé le mouvement et la composition originaux. Seul le style visuel a changé. Le cycle de marche du personnage est resté identique. Le mouvement de caméra n’a pas bougé.

C’est utile pour les présentations client où on veut montrer des options de concept sans régénérer toute la scène trois fois. Également utile pour les tests A/B de créatifs publicitaires sans épuiser les crédits de génération.

J’ai essayé le même workflow avec régénération au lieu d’édition — en écrivant trois prompts différents avec des mots-clés de style intégrés. Deux des trois sont revenus avec un timing de mouvement légèrement différent, ce qui a brisé la comparaison. L’édition a maintenu tout comparable sauf la variable de style que je testais.

Comparaison des coûts : édition vs régénération

D’après l’analyse des coûts de WaveSpeedAI, l’édition par instructions aura probablement un profil de coût différent de la génération standard, mais les tarifs exacts n’ont pas encore été publiés.

Du point de vue du workflow, même si l’édition coûte le même prix par seconde que la génération, elle reste moins chère en pratique parce qu’on ne jette pas les tentatives ratées. Une génération plus une édition ciblée bat trois régénérations complètes.

Le calcul : Si la génération coûte 0,12 $/seconde pour 1080P (tarification WAN 2.6 de PiAPI), un clip de 5 secondes coûte 0,60 $. Trois régénérations coûtent 1,80 $. Une génération plus une édition — même si l’édition coûte le même 0,60 $ — ne coûte que 1,20 $. C’est une économie de 33% rien qu’en réduisant le gaspillage.

Si l’édition s’avère moins chère que la génération (ce qui semble probable étant donné qu’elle modifie des images existantes plutôt que d’en créer de nouvelles de zéro), les économies se multiplient.

Implications de l’Accès API

Endpoint séparé ou indicateur de paramètre ?

L’analyse de WaveSpeedAI suggère que l’édition par instructions nécessitera de nouveaux champs de payload — probablement un paramètre edit_instruction et éventuellement un endpoint distinct.

J’attends la documentation API officielle avant l’intégration en production.

Coût en tokens et en calcul

L’inférence multi-entrées est plus lourde que la génération mono-entrée. L’édition par instructions traite à la fois la vidéo source et l’instruction d’édition, ce qui signifie un coût de calcul plus élevé.

Budgétisez en conséquence, mais ne finalisez pas les projections tant que les tarifs ne sont pas en vigueur.

Considérations sur les tâches asynchrones

Toutes les opérations WAN s’exécutent de manière asynchrone. On soumet la requête, on obtient un ID de tâche, on interroge jusqu’à la fin.

Temps d’attente estimé d’après mes tests : 30 secondes à 2 minutes pour une édition de 5 secondes en 1080P.

FAQ

L’édition par instructions est-elle disponible via l’API WaveSpeed au lancement ?

WAN 2.7 sera lancé avant fin mars 2026. La disponibilité de l’API pour l’édition par instructions n’a pas encore été confirmée. WaveSpeedAI ajoute généralement de nouveaux endpoints dans les jours suivant les sorties officielles.

Quelle est la durée maximale de la vidéo source pour l’édition ?

Jusqu’à 15 secondes en 1080P. Les clips plus courts (2-5 secondes) se traitent plus rapidement et produisent des éditions plus nettes.

L’édition préserve-t-elle l’audio original ? Cela dépend de l’édition. Les changements d’arrière-plan préservent l’audio. Les changements de style qui modifient l’esthétique visuelle affectent parfois la synchronisation. Cela vaut la peine de tester au cas par cas.

Articles Précédents :

- Découvrez comment fonctionne l’édition par instructions en langage naturel dans WAN 2.7

- Voyez les différences clés entre WAN 2.7 et WAN 2.6, notamment pour les éditions légères par instructions

- Apprenez des façons pratiques de combiner l’édition par instructions avec le contrôle de la première/dernière image

- Explorez les nouvelles fonctionnalités de WAN 2.7, notamment l’édition vidéo par instructions et la voie de mise à niveau de l’API

- Comprendre les cas d’usage en production et les avantages d’itération de l’édition par instructions dans WAN 2.7