WAN 2.7 : Nouvelles Fonctionnalités, Accès API et Chemin de Mise à Niveau

WAN 2.7 est la mise à niveau majeure d'Alibaba : contrôle de la première/dernière image, I2V en grille 9, référence vocale et édition par instructions. Ce que les développeurs doivent savoir.

Bonjour à tous. C’est Dora ! Je suis la famille de modèles Wan de près depuis la version 2.1, principalement parce que lorsqu’un modèle commence à gagner du terrain en open-source dans les pipelines de production, il évolue souvent plus vite que la couverture médiatique. WAN 2.7 est encore en cours de déploiement — prévu pour un lancement avant fin mars 2026 — ce n’est donc pas un avis de sortie. C’est une liste de contrôle pré-lancement pour les équipes qui utilisent déjà la version 2.5 et qui doivent décider s’il faut réorienter leur infrastructure ou attendre.

Pas de battage médiatique. Juste ce qui est confirmé, ce qui reste flou, et… ce que cela signifie pour votre file d’attente de builds. Si vous cherchez encore à positionner des modèles comme Wan dans une stack de production, cette analyse sur l’utilisation des outils de génération vidéo par IA dans des workflows réels aide à ancrer la décision avant d’entrer dans les détails techniques.

WAN 2.7 en 60 secondes (la version courte)

Si vous évaluez d’un point de vue produit ou ingénierie : WAN 2.7 s’annonce davantage comme une expansion fonctionnelle qu’un pur saut de qualité. Le titre n’est pas « une meilleure vidéo » — c’est « davantage de surfaces de contrôle. » Les améliorations couvrent la qualité visuelle, la génération audio et la dynamique de mouvement, mais les ajouts les plus intéressants sont structurels : contrôle de la première/dernière image, I2V multi-entrée en grille 9 cases, référence sujet+voix, et édition basée sur des instructions.

La différence par rapport à la version 2.5 n’est pas une résolution principale. C’est le nombre d’entrées d’ancrage que le modèle accepte désormais en un seul appel.

Les nouveautés de WAN 2.7

Contrôle vidéo par première et dernière image

L’approche première-et-dernière-image permet aux utilisateurs de définir à la fois le début et la fin d’une vidéo à l’aide de deux images, le modèle générant automatiquement le contenu intermédiaire. Cela existait déjà comme modèle autonome dans les versions précédentes de la série Wan (voir Wan2.1-FLF2V-14B), mais la version 2.7 l’intègre directement dans le modèle plutôt que comme un point de contrôle séparé.

Pour les équipes de production : cela est surtout utile lorsque vous avez des images-clés définies — un plan produit au repos, un plan produit en mouvement — et que vous souhaitez que le modèle interpole la transition sans passe d’animation manuelle complète. Les points d’ancrage sont déterministes. Ce qui se passe entre les deux reste stochastique, mais vos garde-fous de composition sont en place.

Image-vidéo en grille 9 cases (multi-entrée 3×3)

WAN 2.7 prend en charge une approche de synthèse en grille 3×3, ce qui signifie que jusqu’à neuf images de référence peuvent être soumises comme entrée structurée pour une seule tâche de génération vidéo. C’est fondamentalement différent de l’I2V à image unique.

L’application pratique : si vous générez du contenu cohérent avec un personnage sous des angles ou des conditions d’éclairage variés, vous pouvez désormais fournir une grille de référence… plutôt qu’une seule ancre. Si vous comparez comment différents outils gèrent la cohérence multi-référence, ce guide sur les meilleurs outils de face swap vidéo avec support multi-visages et multi-entrées montre où les solutions actuelles peinent encore. Cela réduit le facteur chance en un seul essai qui rend les lots I2V coûteux à contrôler qualitativement. Confirmez la structure exacte des paramètres API au lancement — le schéma d’endpoint pour les entrées en grille n’a pas été formellement publié au moment de la rédaction.

Référence sujet + voix

WAN 2.7 vous permet de combiner une référence visuelle de sujet avec une référence vocale pour générer des vidéos où l’apparence et la voix du personnage sont cohérentes avec vos entrées. Il s’agit d’une extension de ce que Wan 2.6 a introduit avec son modèle R2V — qui permettait aux utilisateurs de télécharger une vidéo de référence de personnage avec apparence et voix, en utilisant des invites textuelles pour générer de nouvelles scènes vivantes mettant en vedette ce même personnage.

Dans la version 2.7, on s’attend à ce que cela soit plus étroitement intégré plutôt qu’un endpoint de modèle séparé. Pour les équipes qui créent du contenu court axé sur des personnages ou des pipelines de localisation, …c’est la fonctionnalité avec le ROI de production le plus clair — à condition que la gestion des références vocales soit stable sous des appels de lots répétés. Pour contexte, c’est aussi là que les pipelines de face swap vidéo par IA commencent à se dégrader à grande échelle, surtout lorsque la cohérence d’identité et de voix sont toutes deux requises.

Édition vidéo basée sur des instructions

WAN 2.7 prend en charge l’édition de vidéos existantes à l’aide d’instructions en langage naturel — changer les arrière-plans, modifier l’éclairage ou altérer la tenue d’un personnage en décrivant le changement et en laissant le modèle s’occuper du reste.

Il s’agit d’un changement significatif de la génération vers l’édition. Pour les équipes produit qui gèrent des boucles de correction en post-production, cela ouvre une alternative plus légère au travail de rotoscopie et de compositing manuel pour les petites modifications. L’inconnue principale est la façon dont le modèle gère la cohérence temporelle sur des clips plus longs lorsque les modifications affectent des éléments adjacents au mouvement (des vêtements sur un sujet en mouvement, par exemple). C’est là que des outils similaires ont historiquement montré des dégradations.

La documentation officielle d’Alibaba Cloud Model Studio couvre déjà les endpoints d’édition associés dans la gamme Wan actuelle, ce qui donne une base pour le schéma API que vous verrez probablement dans la version 2.7.

Recréation / Réplication vidéo [Nécessite vérification]

Cette fonctionnalité — recréer ou répliquer des vidéos existantes avec des changements de style ou de sujet tout en préservant la structure de mouvement — est apparue dans des résumés tiers de WAN 2.7. Elle n’a pas été confirmée indépendamment dans la documentation officielle d’Alibaba au moment de la rédaction. Ne créez pas de dépendances de workflow sur cette capacité jusqu’à ce que les notes de version officielles d’Alibaba la confirment. Signalez-la comme exploratoire si vous êtes en train de planifier un projet de mise à niveau maintenant.

Ce qui reste identique (continuité architecturale depuis la version 2.6)

L’architecture DiT (Diffusion Transformer) sous-jacente est maintenue. La série Wan utilise un composant Transformer basé sur l’architecture DiT vidéo dominante, employant un mécanisme Full Attention pour capturer avec précision les dépendances spatiotemporelles à longue portée, assurant une cohérence temporelle et spatiale élevée.

Cela est important pour les équipes qui exécutent une inférence locale : le profil mémoire GPU et l’approche de quantification ne changeront pas radicalement. Si votre stack d’inférence 2.6 est optimisée (opérations FP8, sharding multi-GPU), cet investissement est reportable. N’attendez pas une architecture de déploiement complètement nouvelle.

Accès API et disponibilité — Ce qui est confirmé, ce qui reste à définir

Canaux d’accès officiels (DashScope / Wan.video)

Les deux canaux officiels confirmés pour les versions Wan précédentes ont été la plateforme DashScope d’Alibaba Cloud — qui gère le provisionnement des clés API et l’accès au modèle — et Wan.video pour les workflows orientés créateurs. Les deux devraient proposer la version 2.7 au lancement, bien que la disponibilité régionale (en particulier pour les comptes internationaux par rapport à la Chine continentale) devrait être confirmée à la sortie.

La clé API DashScope est chargée depuis la variable d’environnement DASHSCOPE_API_KEY, les utilisateurs internationaux pointant vers dashscope-intl.aliyuncs.com — le même schéma s’appliquera presque certainement pour la version 2.7 étant donné l’infrastructure établie.

Disponibilité via des fournisseurs API tiers

Au moment de la rédaction, WAN 2.7 n’est pas encore confirmé sur les agrégateurs d’API tiers. D’après le schéma observé depuis la version 2.2 — où le support natif ComfyUI est arrivé le jour du lancement pour les poids de modèle open-source — attendez-vous à ce que les intégrations communautaires suivent rapidement si la version 2.7 est livrée avec des poids publics.

La question de savoir si la version 2.7 sera open-source n’est elle-même pas confirmée. Voir la FAQ ci-dessous.

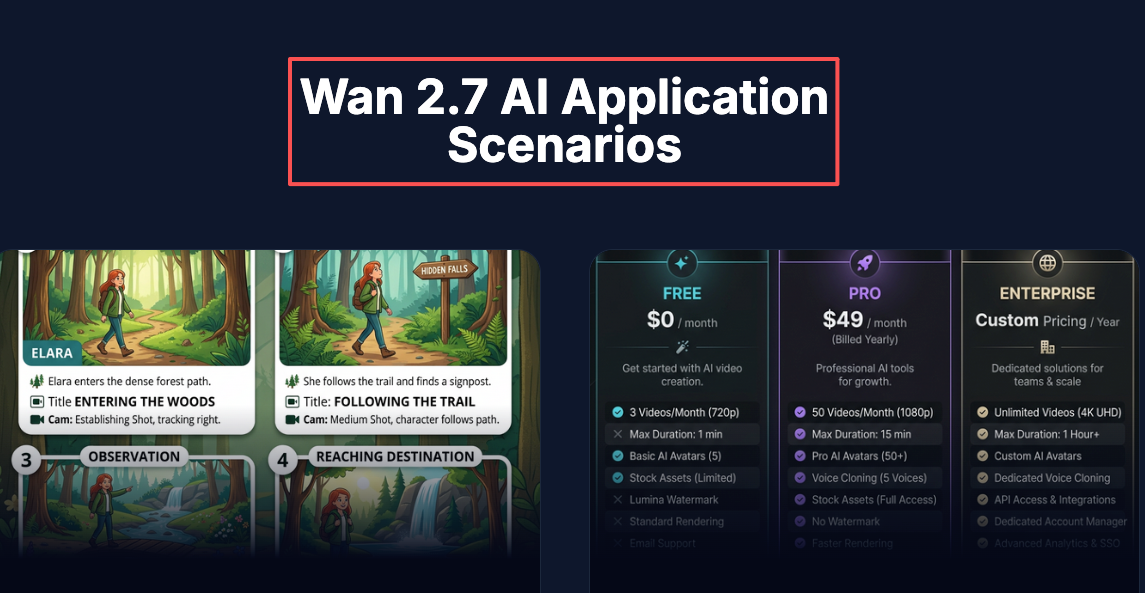

Qui devrait prioriser WAN 2.7 dès maintenant

Équipes produisant des vidéos à forte utilisation de références

Si votre pipeline repose déjà sur la cohérence des personnages entre les plans — et que vous avez compensé avec plusieurs passes de génération ou des contournements ControlNet — la référence sujet + voix et l’entrée en grille multi-images sont les deux fonctionnalités qui réduisent le plus directement cette surcharge. Cela vaut la peine de planifier une mise à niveau.

Développeurs ayant besoin d’I2V multi-entrées

L’I2V à image unique fonctionne jusqu’à ce que vous ayez besoin de cohérence. L’entrée en grille 9 cases change significativement la surface de référence. Si vous avez batché des contournements pour simuler cela, la version 2.7 pourrait consolider plusieurs appels API en un seul.

Équipes créatives pouvant attendre sur WAN 2.5

Si vos workflows avec la version 2.5 sont stables et que les nouvelles fonctionnalités ne correspondent pas à des goulots d’étranglement de production actifs, il n’y a pas d’urgence. Le modèle est encore en cours de lancement. Laissez les deux premières semaines de retours communautaires faire émerger les cas limites avant de reconfigurer quoi que ce soit.

FAQ

- Quand WAN 2.7 sera-t-il officiellement disponible via API ? Le lancement est prévu avant fin mars 2026. La date exacte de disponibilité de l’API par région : pas encore confirmée.

- WAN 2.7 est-il open-source comme WAN 2.2 ? Non confirmé. Wan 2.2 a été livré sous Apache 2.0, ce qui permettait l’utilisation commerciale et l’intégration ComfyUI. Si la version 2.7 suit la même licence n’a pas été indiqué dans les matériaux pré-lancement.

- WAN 2.7 prend-il en charge ComfyUI ? Aucune intégration confirmée pour l’instant. Étant donné les versions précédentes — Wan 2.1 et 2.2 avaient toutes deux le support ComfyUI le jour du lancement ou autour — supposez que les nœuds communautaires suivront rapidement si les poids du modèle sont publics.

- Quel est le prix par rapport à WAN 2.5 ? Aucune tarification n’a été annoncée. La série de modèles Wan a généralement été facturée à la seconde ou par vidéo via DashScope. Consultez la tarification d’Alibaba Cloud Model Studio au lancement pour les tarifs mis à jour.

- Puis-je accéder à WAN 2.7 via des fournisseurs API tiers aujourd’hui ? Pas encore. Le modèle n’est pas encore lancé. Surveillez le GitHub officiel de Wan et la documentation DashScope pour la confirmation de sortie, puis vérifiez le support de la plateforme à partir de là.

Ce qu’il faut surveiller après le lancement

Quelques points à suivre au fur et à mesure que la version 2.7 se stabilise dans les premières semaines :

— Cohérence temporelle sur les éditions par instructions : L’édition basée sur des instructions est la fonctionnalité la plus susceptible de se comporter différemment en pratique par rapport à la présentation de prévisualisation. Surveillez attentivement les sorties communautaires.

— Publication des poids open-source : Si les poids sont publiés publiquement, attendez-vous à des workflows ComfyUI, une intégration Diffusers et des variantes quantifiées en quelques jours. Sinon, l’API DashScope reste le chemin d’accès principal — et la latence régionale devient une variable de workflow réelle.

— Statut de la fonctionnalité de recréation vidéo : Celle-ci nécessite une source officielle. Ne l’intégrez à rien jusqu’à ce qu’Alibaba la confirme explicitement.