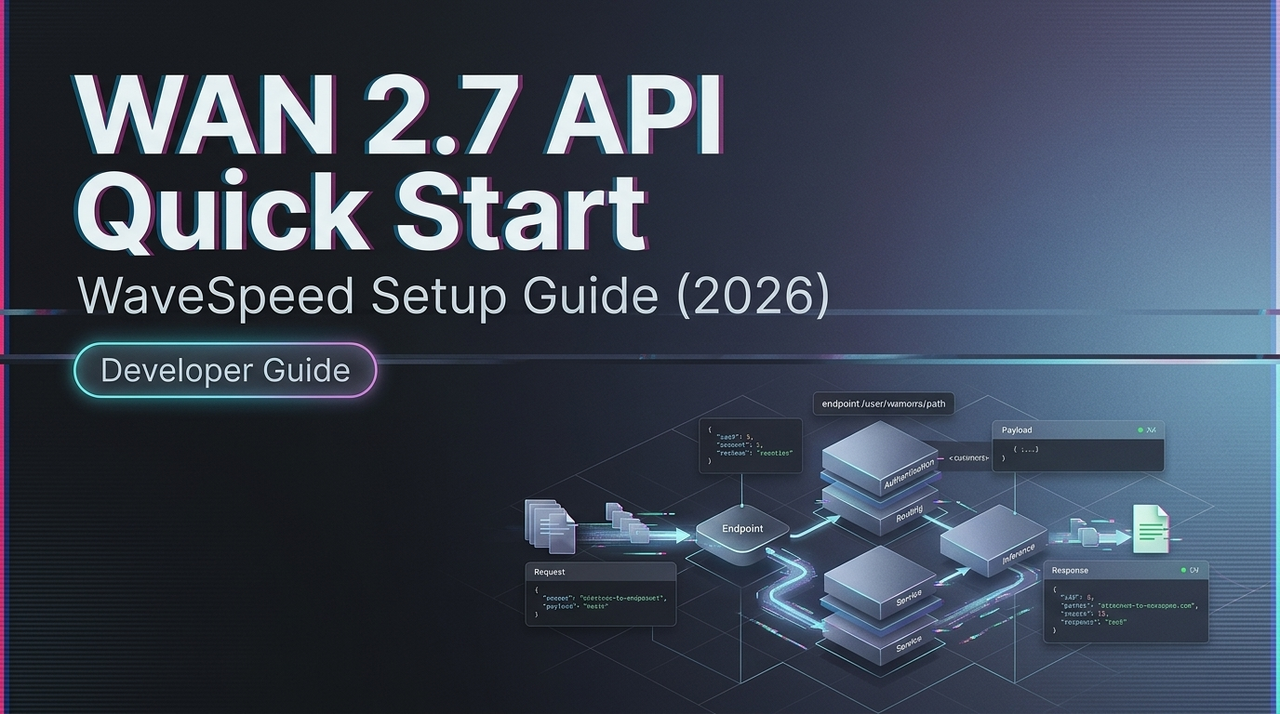

Démarrage rapide de l'API WAN 2.7 sur WaveSpeed (2026)

Lancez WAN 2.7 via l'API WaveSpeed : authentification, ID de modèle, paramètres essentiels et premiers appels pour les tâches T2V, I2V et image de début/fin.

Salut tout le monde. Je m’appelle Dora. J’ai longtemps repoussé ça. WAN 2.7 est sorti. J’avais un projet qui en avait besoin, et je me suis dit que je m’en occuperais “une fois que les choses se stabilisent.” C’est généralement le mauvais réflexe. La surface de l’API est simple une fois que vous avez dépassé le nommage des versions — et la plupart des frictions viennent d’une ou deux décisions prises tôt qui affectent silencieusement tout ce qui suit.

Ce n’est pas une présentation de fonctionnalités. C’est ce dont j’avais vraiment besoin le premier jour.

WAN 2.7 sur la plateforme : ID du modèle et disponibilité

Avant d’écrire une seule ligne de code, j’ai passé dix minutes à simplement confirmer la chaîne du modèle. Ça semble évident, mais WAN a un schéma de nommage qui perturbe les gens — wan2.5-i2v, wan2.6-i2v, wan2.7-flf2v — et utiliser un ID obsolète renvoie un 404 propre sans message d’erreur utile.

Le catalogue de modèles est le premier endroit à vérifier. Naviguez jusqu’à la section de génération vidéo, filtrez par version 2.7, et copiez la chaîne exacte de l’ID du modèle. Ne la tapez pas de mémoire.

Le timing de disponibilité compte aussi. WAN 2.7 a été lancé en mars 2026 avec un ensemble significatif de nouvelles capacités — contrôle de la première/dernière image, synthèse image-vers-vidéo en grille 3×3, jusqu’à cinq références vidéo, et édition basée sur des instructions. Selon l’aperçu de la génération vidéo d’Alibaba Cloud Model Studio, les points de terminaison d’inférence hébergés pour les nouvelles versions de WAN sont généralement mis en ligne dans les jours suivant une version officielle — mais pas toujours le même jour, donc vérifiez la page de statut de la plateforme avant de construire quoi que ce soit sensible au temps.

Authentification et configuration de la clé API

Cette partie est rapide. Votre clé API va dans l’en-tête Authorization en tant que jeton Bearer. L’URL de base suit la région que vous avez sélectionnée lors de la configuration du compte — Singapour, Virginie, ou Pékin pour le déploiement en Chine continentale. Les appels inter-régions échoueront, pas bruyamment, juste avec une erreur d’authentification qui fait perdre vingt minutes si vous ne vous y attendez pas.

Authorization: Bearer YOUR_API_KEY

Content-Type: application/jsonUne chose que je fais dès le début : stocker la clé API dans une variable d’environnement et ne jamais la coder en dur, même pas dans les scripts de test locaux. Une clé divulguée est une mauvaise surprise de facturation que vous ne voulez pas.

La structure de l’URL de base suit les conventions REST standard telles que définies dans IETF RFC 9110 (HTTP Semantics). Si vous avez travaillé avec une API d’IA moderne, cela vous semblera familier — JSON en entrée, JSON en sortie, codes de statut qui se comportent comme prévu.

Paramètres de requête principaux

C’est là que je vous encourage à ralentir un peu. Les paramètres requis sont peu nombreux — ID du modèle, prompt, type d’entrée — mais les paramètres optionnels influencent la qualité de sortie plus que vous ne le pensez.

Requis :

model— chaîne exacte du modèle, vérifiée dans le catalogueprompt— votre description textuelle ; pour la vidéo, la spécificité importe plus que la longueur- Entrée : soit

image_url(pour I2V) ou texte uniquement pour T2V

Optionnels mais pratiquement importants :

resolution— accepte"480P","720P","1080P"; WAN 2.7 prend en charge une sortie native 1080P jusqu’à 15 secondesduration— de 2 à 15 secondes ; les clips plus longs coûtent plus cher et prennent plus de temps à traiterseed— verrouillez-le une fois que vous trouvez une bonne sortie. C’est le paramètre qui rend vos résultats reproductibles d’une exécution à l’autrenegative_prompt— utile pour supprimer le scintillement, le flou et les artefacts de mouvement

Paramètres spécifiques à WAN 2.7 à vérifier lors de la publication de la documentation officielle :

first_frame_url+last_frame_url— pour le mode FLF2V (première-et-dernière-image)image_grid— la structure d’entrée en grille 9 pour une composition I2V plus richeedit_instruction— édition en langage naturel sur une vidéo existante

Les trois derniers sont nouveaux dans la version 2.7. Les noms de paramètres peuvent changer entre la préversion et la disponibilité générale. La référence API officielle est la source faisant autorité — construire sur des noms de paramètres provisoires est à vos risques et périls.

Premiers modèles de requêtes

Texte vers vidéo (minimal)

response = VideoSynthesis.async_call(

model="wan2.7-t2v", # vérifier la chaîne exacte au lancement

prompt="A slow dolly shot through a foggy pine forest at dawn.",

resolution="720P",

duration=5,

seed=42

)

task_id = response.output.task_idImage vers vidéo standard

response = VideoSynthesis.async_call(

model="wan2.7-i2v",

img_url="https://your-cdn.com/input.jpg",

prompt="Camera holds still. Subject turns slowly toward light.",

resolution="720P",

duration=5

)Première image + dernière image (FLF2V)

C’est là que WAN 2.7 fait quelque chose que les versions précédentes ne pouvaient pas faire proprement. Vous définissez l’image d’ouverture et de fermeture ; le modèle remplit le mouvement entre les deux. Ce n’est pas de l’animation au sens traditionnel — c’est une inférence structurée à partir de deux points d’ancrage sémantiques.

response = VideoSynthesis.async_call(

model="wan2.7-flf2v", # vérifier la chaîne exacte au lancement

first_frame_url="https://your-cdn.com/start.png",

last_frame_url="https://your-cdn.com/end.png",

prompt="Fixed camera. Smooth transition. Natural lighting.",

resolution="720P",

seed=99

)La qualité de votre paire d’images importe plus que le prompt. Une paire bien assortie avec une relation spatiale claire surpassera systématiquement un prompt soigné sur des images d’entrée mal assorties. J’ai fait suffisamment de tests pour l’affirmer avec une certaine confiance. Pour référence sur la façon dont la variante open-weight gère le conditionnement d’images, le dépôt du modèle WAN sur Hugging Face documente l’architecture en détail — utile même si vous n’appelez que l’API hébergée.

Image vers vidéo en grille 9

L’entrée en grille 9 vous permet de passer un arrangement 3×3 d’images fixes comme références de composition pour une seule génération. Vérifiez la structure exacte du payload au lancement — le paramètre accepte probablement un tableau de neuf URL d’images, mais traitez toute documentation préliminaire comme provisoire.

Gestion des tâches asynchrones : Soumettre → Interroger → Résultat

La génération vidéo n’est jamais synchrone. Même pour les clips courts, prévoyez 1 à 5 minutes par tâche. Le schéma est toujours le même : soumettre → obtenir un task_id → interroger → récupérer l’URL du résultat.

import time

def poll_for_result(task_id, interval=15, timeout=600):

elapsed = 0

while elapsed < timeout:

result = VideoSynthesis.fetch(task_id)

status = result.output.task_status

if status == "SUCCEEDED":

return result.output.video_url

if status == "FAILED":

raise Exception(f"Task failed: {result}")

time.sleep(interval)

elapsed += interval

raise TimeoutError("Job exceeded timeout")Intervalle d’interrogation : 15 secondes est la recommandation documentée de la propre référence API d’Alibaba pour le point de terminaison image-vers-vidéo de Wan. N’interrogez pas plus vite — cela n’accélérera rien et vous épuiserez vos limites de débit.

Transitions d’état des tâches : PENDING → RUNNING → SUCCEEDED ou FAILED. L’URL du résultat est valide pendant 24 heures après la génération. Téléchargez-la et stockez-la immédiatement — si vous manquez cette fenêtre, l’ID de tâche expire également après 24 heures et renvoie UNKNOWN lors des requêtes suivantes. Je l’ai appris à mes dépens lors de mon premier traitement par lots.

Gestion des erreurs

Les erreurs que vous rencontrerez le plus souvent :

| Erreur | Cause probable | Correction |

|---|---|---|

| 404 sur le modèle | ID de modèle incorrect ou obsolète | Vérifier la chaîne exacte dans le catalogue |

| 400 sur l’entrée | Format d’image rejeté ou URL inaccessible | Utiliser des URL HTTPS publiques ; vérifier le format |

| 429 Trop de requêtes | Limite de débit atteinte | Backoff exponentiel avec gigue |

| Statut de tâche UNKNOWN | ID de tâche expiré (fenêtre de 24h) | Interroger plus tôt ; télécharger le résultat immédiatement |

Pour les 429 : reculez, ajoutez de la gigue, ne réessayez pas en boucles serrées. La documentation MDN HTTP sur le comportement de l’en-tête Retry-After explique le schéma standard — les en-têtes de réponse vous indiquent souvent exactement quand réessayer.

Les limites de débit des tâches vidéo pour WAN 2.7 sont publiées séparément des limites de génération d’images. Les tâches à haute résolution ou de plus longue durée comptent généralement contre une limite de tâches simultanées, pas seulement une limite de requêtes par minute. Vérifiez selon la documentation de votre niveau de compte.

Estimation des coûts

La tarification de WAN 2.7 n’était pas finalisée au moment de la rédaction. D’après ce qui est cohérent dans la famille de modèles WAN, les coûts s’échelonnent selon trois dimensions :

- Résolution — 1080P coûte significativement plus que 720P par seconde de sortie

- Durée — facturée par seconde de vidéo générée

- Complexité de l’entrée — les entrées multi-références peuvent comporter un multiplicateur ; à confirmer au lancement

Une formule d’estimation approximative :

coût estimé = durée (secondes) × multiplicateur de résolution × prix unitaire par secondeAvant d’exécuter un traitement par lots, testez un clip pour chaque combinaison de résolution et de durée que vous prévoyez d’utiliser. L’aperçu de facturation Alibaba Cloud pour Model Studio aura les coûts unitaires par seconde une fois que les tarifs officiels de WAN 2.7 seront publiés. Les coûts de génération vidéo s’accumulent plus vite que la génération d’images — la résolution est le levier le plus important.

FAQ

WAN 2.7 est-il disponible le même jour que le lancement officiel d’Alibaba ?

Pas toujours. Les points de terminaison API hébergés sont généralement mis en ligne dans les jours suivant une version open-weight, parfois le même jour, parfois une semaine plus tard. Surveillez directement le journal des modifications de la plateforme. Le dépôt GitHub du modèle WAN est historiquement l’endroit où l’équipe d’Alibaba documente en premier les changements de schéma pour les nouvelles versions open-weight.

Les appels API WAN 2.5 sont-ils compatibles avec WAN 2.7 ?

Les payloads T2V standard et I2V à image unique devraient être structurellement compatibles — les nouvelles fonctionnalités de la version 2.7 semblent s’ajouter plutôt que de casser la compatibilité. Cela dit, vous devrez mettre à jour la chaîne de l’ID du modèle, et tout code utilisant des paramètres spécifiques à la version 2.5 devrait être testé avant d’être considéré comme un remplacement direct. Les modes grille 9 et FLF2V nécessitent entièrement de nouvelles structures de payload.

Quelle est la limite de débit pour les tâches vidéo WAN 2.7 ?

Vérifiez selon votre niveau de compte au moment de l’exécution. Par défaut opérationnel : mettez les tâches en file d’attente en flux régulier plutôt qu’en rafale. Gérez les 429 avec un backoff exponentiel. Enregistrez le request_id de chaque réponse — c’est le champ le plus utile quand quelque chose tourne mal et que vous devez le retracer.

La mécanique ici n’est pas compliquée. Ce qui prend vraiment du temps, c’est de construire de bons assets d’entrée — les paires d’images, les images de référence, les prompts qui restent spécifiques sans devenir rigides. Une fois ceux-ci stabilisés, le côté API devient routinier.

Je mettrai ceci à jour une fois que la documentation officielle des paramètres WAN 2.7 sera en ligne et que j’aurai eu l’occasion de tester le format en grille 9 de bout en bout. C’est la partie qui m’intéresse le plus.

Articles précédents :

- Découvrez comment fonctionne l’édition par instruction en langage naturel dans WAN 2.7

- Voyez les différences clés entre WAN 2.7 et WAN 2.6, notamment pour les éditions légères basées sur des instructions

- Apprenez des façons pratiques de combiner l’édition basée sur des instructions avec le contrôle de la première/dernière image

- Explorez les nouvelles fonctionnalités de WAN 2.7 incluant l’édition vidéo basée sur des instructions et le chemin de mise à niveau de l’API

- Comprenez les cas d’utilisation en production réels et les avantages d’itération de l’édition par instruction dans WAN 2.7