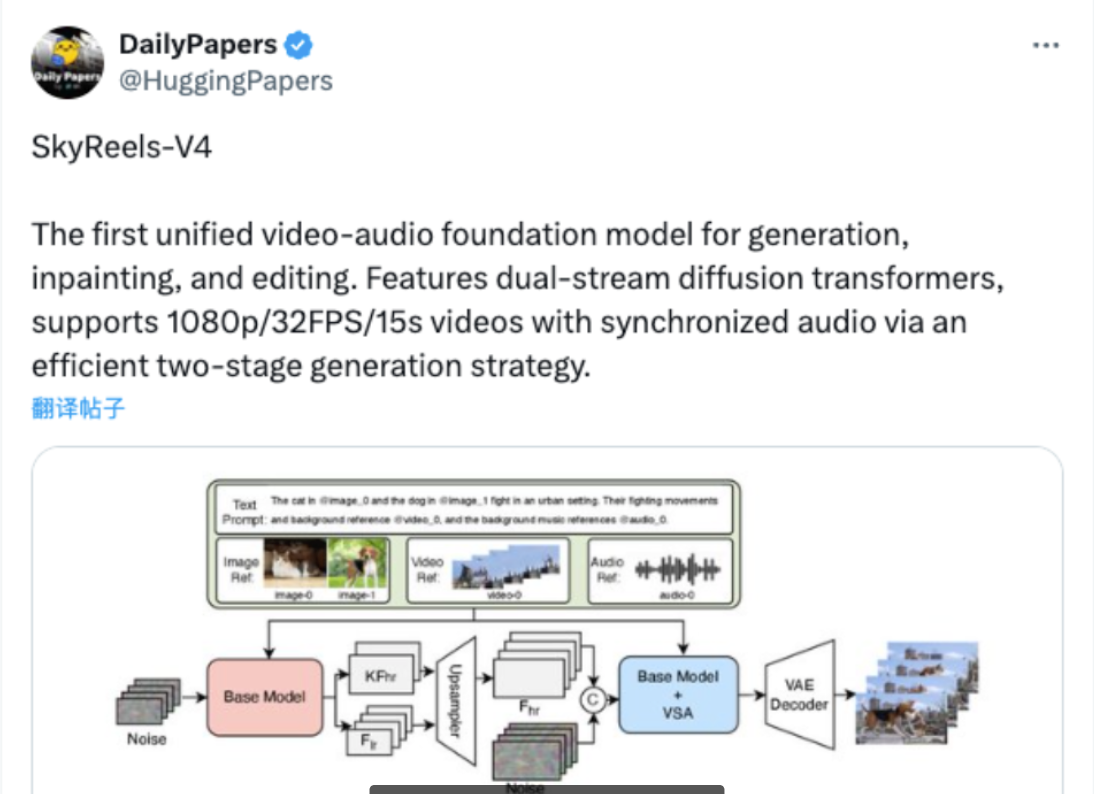

Cas d'usage de SkyReels V4 : 6 façons dont les créateurs peuvent l'utiliser dès maintenant

Des vidéos sociales avec audio naturel au montage de films IA — voici 6 cas d'usage pratiques de SkyReels V4, et à qui chacun convient le mieux.

Une petite chose m’a poussée vers SkyReels V4 : je n’arrêtais pas de traîner sur les courtes vidéos. Pas le montage, la préparation. Choisir de la musique, couper un clip, exporter, re-exporter. Trop de petits choix. Je voulais quelque chose qui ne me demande pas un moodboard à chaque fois. J’ai donc passé la semaine dernière à tester une poignée de cas d’usage de SkyReels V4 dont j’entendais souvent parler, en portant attention à ce qui allégeait vraiment le travail au quotidien.

Je suis Dora. Ce qui suit, ce sont les six cas d’usage qui ont retenu mon attention : là où l’outil a supprimé de petites frictions ou au contraire s’est mis en travers, et dans quelle mesure. Si vous travaillez avec la vidéo en marge de votre journée — posts sociaux, boucles produit, démos rapides — voici où SkyReels V4 s’est révélé utile, et où il ne l’était pas.

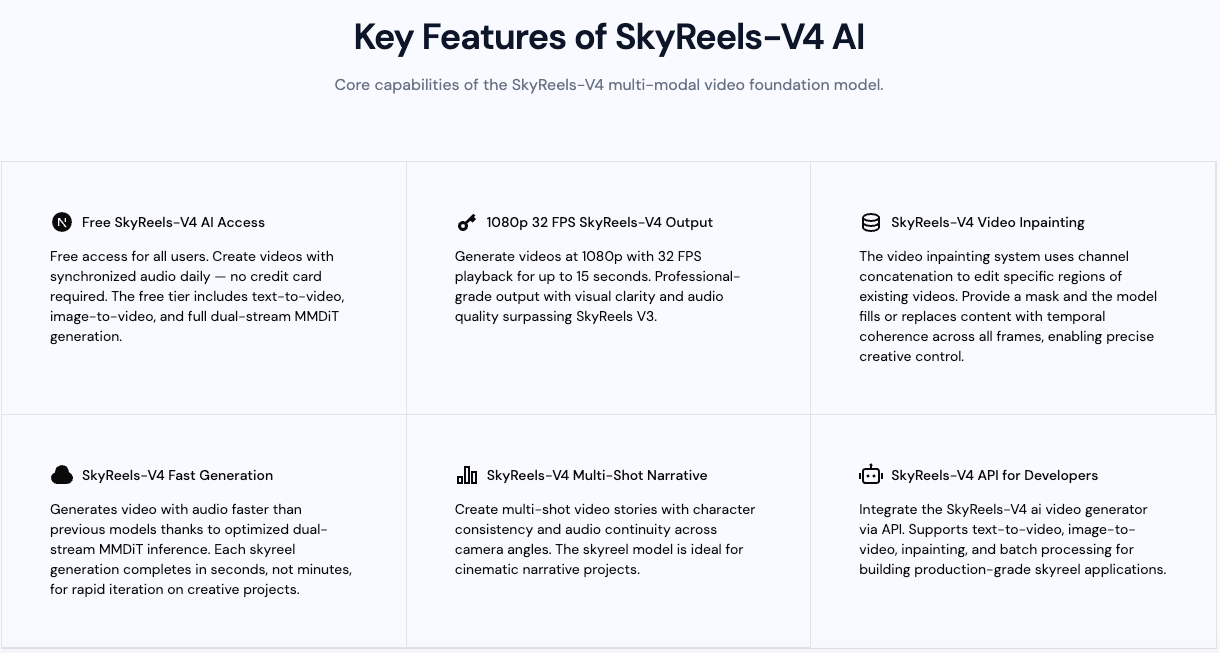

Cas d’usage 1 — Vidéo sociale avec audio ambiant

J’ai commencé par là parce que je fuis la sélection musicale comme les e-mails un dimanche. J’ai soumis à SkyReels un clip de 12 secondes montrant un bureau (vue du dessus, vapeur de café, un lent panoramique). Le prompt était simple : « garder ça calme, ajouter un audio ambiant subtil, correspondre au mouvement. »

Ma première réaction : du soulagement. Il a ajouté une douce ambiance de pièce avec un léger bourdonnement, plus de présence que le silence, moins distrayant que les pistes libres de droits. Je n’ai pas eu à toucher une timeline. L’export a pris ~18 secondes sur l’application web et ~7–9 secondes via API sur un GPU loué. L’audio semblait collé au mouvement sans coupures évidentes.

Deux limites sont apparues rapidement :

- SkyReels surajoute parfois de la réverbération, surtout sur les plans larges. J’ai diminué le « wetness » (leur terme) à 0,2 et ça a cessé de sonner comme une église vide.

- Sur les montages rapides, la boucle ambiante laissait apparaître une couture vers 10–12 secondes. Étendre à 20 secondes a réglé le problème, mais c’est un petit défaut visible si vous postez beaucoup de micro-coupes.

En pratique, j’ai utilisé ça pour poster deux courts clips sur LinkedIn avec presque aucune retouche. Ça ne m’a pas fait gagner de temps au premier passage (j’ai beaucoup vérifié les réglages), mais à la troisième utilisation, j’ai remarqué que mon esprit était plus tranquille — moins de choix à faire, moins d’interruptions.

Ce qu’il faut créer, ce à quoi s’attendre

- Fonctionne bien pour le B-roll, les coulisses, les plans de bureau ou d’atelier, les démos silencieuses et les timelapses.

- Attendez-vous à une texture ambiante régulière, pas des « chansons ». Pensez bruits de pas, clés, légère brise, nappes synthétiques douces. Si vous avez besoin d’un drop musical clair, ce n’est pas l’outil.

- Durée optimale dans mes tests : 10–30 secondes. Au-delà de 45 secondes, de petites boucles peuvent se répéter si vous ne stimulez pas la variété.

- Si les sous-titres vous importent, ajoutez-les ailleurs. Les sous-titres de SkyReels étaient suffisamment précis mais visuellement ternes par défaut.

Cas d’usage 2 — Image-to-Video pour le contenu produit

J’ai testé trois plans statiques : un chargeur, une tasse en céramique et une petite lumière LED, tous sur fond uni. Prompt : « mouvement subtil, 3–5 secondes, le produit reste net, parallaxe lente, légère variation d’ombre. »

La bonne nouvelle d’abord : le mouvement semblait crédible. La tasse a capté un petit balayage de lumière, et le câble du chargeur a eu un léger balancement qui paraissait filmé, pas simulé. Les exports étaient en 720p par défaut : j’ai mis à l’échelle en 1080p dans l’application. Délai de rendu : ~12–20 secondes chacun.

Là où ça a trébuché : les bords. Sur la lumière LED, la grille s’est brouillée pendant le parallaxe. J’ai corrigé ça en augmentant la valeur de « structure preservation » (de 0,6 à 0,85). Compromis : moins de liberté de mouvement, mais le produit est resté net. Le texte sur les emballages tenait bien si je le masquais comme « statique ». Sans ça, les lettres se déformaient aux coins.

Pour les créateurs solo et les petites boutiques, ça couvre beaucoup de besoins de type « montrer l’objet » : courtes boucles pour une page produit, bannières d’en-tête ou coupes sociales. Ça ne remplacera pas une table rotative bien éclairée, mais quand vous n’avez qu’une image fixe et une deadline, c’est… suffisant, dans le bon sens du terme.

Un conseil : photographiez ou exportez vos images sources légèrement plus larges que vous ne le pensez nécessaire. SkyReels utilise cet espace pour simuler un mouvement de caméra sans distordre les détails.

Cas d’usage 3 — Extension vidéo et continuation de scène

J’ai testé la continuation de scène sur un clip de 5 secondes montrant des mains ouvrant un carnet. J’ai demandé « continuer l’action pendant 3 secondes supplémentaires » et « même éclairage, même grain. »

La couture entre l’original et l’extension était propre au deuxième essai. Au premier, le papier avait pris un motif de fibre différent, à peine perceptible sauf si on fixe. Verrouiller « texture consistency » sur haute a réglé le problème. Le mouvement est resté crédible : le tour du poignet et le soulèvement de la page se sont poursuivis naturellement.

Ça m’a évité un petit désagrément réel : refaire une prise. J’ai généralement vécu avec des coupes dures parce que rééclairer un bureau pour un correctif de 2 secondes n’en vaut pas la peine. Ici, si. Les temps d’export étaient de 20–30 secondes pour du 1080p.

Limites :

- Si le clip source a un changement de perspective rapide (comme un whip pan), la continuation se trompe parfois et on obtient un micro-saut.

- La correspondance du grain est correcte, pas parfaite. Je préfère encore ajouter le grain final dans mon éditeur ensuite.

Utilisez ça quand un clip se termine trop tôt ou quand vous voulez un point de sortie plus doux pour les sous-titres ou les incrustations.

Cas d’usage 4 — Inpainting : nettoyer ou remplacer des éléments vidéo

C’était ma victoire la plus pratique. J’ai masqué un câble de chargeur égaré et un autocollant de logo sur un couvercle de laptop. Prompt : « texture de bureau naturelle, conserver les reflets. »

La suppression du câble a fonctionné au premier passage. Le logo en a nécessité deux. Au premier essai, le reflet spéculaire s’est brisé — un petit tremblement qui rendait la surface factice. J’ai ajouté une courte image de référence montrant le même couvercle sans logo (tirée d’une ancienne prise), et le deuxième passage s’est fondu de manière convaincante.

J’ai aussi essayé un remplacement de couleur : changer une tasse bleue en verte. Ça avait l’air bien en mouvement, mais une seule image figée révélait un bord flou autour de l’anse. Pour le défilement social, tout à fait acceptable. Pour une image hero produit, probablement pas.

Ce qui compte au quotidien : ça a éliminé les petites retouches que je continuais à reporter. J’ai passé ~4 minutes au total sur les masques et les prompts, contre 15–20 minutes dans un éditeur traditionnel avec les outils clone/heal. Si vous faites du contenu en lot, cette différence s’accumule vite.

Mises en garde :

- Les petits masques donnent les meilleurs résultats. Les masques larges et en mouvement peuvent trembler aux images 20–30. L’adoucissement des bords aide.

- Les reflets sont délicats. Fournissez une référence propre ou gardez les changements subtils.

- Exportez quelques images en statique pour vérifier les bords avant de valider un rendu complet.

Cas d’usage 5 — Correspondance audio référencée

J’ai soumis à SkyReels un enregistrement de terrain calme : clés, raclement de chaise, légère ventilation, environ 14 secondes. Je lui ai demandé de correspondre à l’ambiance sur un lent panoramique de mon étagère.

Il a fait quelque chose que j’ai aimé : plutôt que de plaquer exactement les sons par-dessus, il a généré un fond ambiant qui faisait écho au rythme et à la texture. L’étagère semblait vivre dans la même pièce que l’enregistrement, même si ce n’était pas le cas. C’est le bon type de triche.

Deux écueils :

- Si votre référence contient une attaque nette (un claquement, un stylo qui tombe), SkyReels essaie parfois de l’« expliquer » visuellement en poussant un micro-zoom ou une pulsation. J’ai désactivé le mouvement réactif pour éviter ça.

- Le niveau sonore arrivait fort. Je règle maintenant la sortie aux alentours de −16 LUFS pour le social. Facile à corriger, mais facile à manquer.

J’ai utilisé ça sur deux clips que j’aurais normalement mis en sourdine. Ça leur a donné assez de texture pour paraître intentionnels sans attirer l’attention sur eux-mêmes.

Fournissez un son de référence, correspondez à l’ambiance

- Bonnes sources : son de pièce, foley doux, ambiance extérieure calme, nappes synthétiques retenues.

- Éviter : stems musicaux chargés ou cafés bruyants — le modèle court après le chaos.

- Visez des clips de 10–20 secondes. En dessous de 6 secondes, ça se répète ; au-delà de 30, ça lisse trop.

- Si vous vous souciez des points de synchronisation (temps forts, coupes), faites-les dans votre éditeur d’abord, puis demandez à SkyReels de remplir les espaces entre.

Cas d’usage 6 — Intégration dans un pipeline développeur

Je suis passée de l’application web à l’API en milieu de semaine parce que je ne voulais pas d’une étape supplémentaire nécessitant de nombreux clics. La configuration sur ma machine (macOS 15, Python 3.12) a pris environ 10 minutes. J’ai câblé trois endpoints : image-to-video, continuation et audio-match. J’ai aussi ajouté un petit système de relance avec backoff exponentiel, utile quand les tâches se mettent en file d’attente aux heures de pointe.

Un flux simple qui a fonctionné :

- Surveiller un dossier « staging » dans le stockage cloud.

- Quand une image fixe arrive, lancer image-to-video avec un preset de mouvement léger et sauvegarder une boucle de 5 secondes.

- Si un court clip arrive, essayer la continuation pour atteindre 8 secondes pour le social.

- Si un extrait audio arrive, tenter la correspondance d’ambiance et attacher le résultat.

L’objectif n’était pas une automatisation complète. C’était de supprimer la pause devant la page blanche. Je pouvais déposer des assets dans un dossier et récupérer des brouillons utilisables en moins d’une minute. Ensuite, je décidais si quelque chose méritait une passe de finition.

Quelques notes de terrain :

- Les limites de débit étaient raisonnables dans mes tests (5–10 tâches simultanées tenaient bien). Au-delà, les temps de file d’attente augmentaient.

- Les tâches retournent des métadonnées utiles : seed, intensité du mouvement, préservation de la structure et un diff rapide des changements visuels. Je les ai sauvegardées dans un JSON sidecar pour pouvoir reproduire un rendu sans deviner.

- Les coûts varieront. J’ai gardé des runs courts et défini des valeurs par défaut raisonnables pour éviter de brûler des crédits sur des expériences 4K dont je n’avais pas besoin.

C’est le cas d’usage qui a fait que SkyReels m’a semblé être une pièce de système, pas une nouveauté. Je pourrais imaginer des équipes l’intégrer dans des workflows CMS ou des outils internes sans avoir à le surveiller en permanence.

Potentiel API / workflow open-source

- L’API est la porte stable. Si vous vivez dans des éditeurs (Premiere, Resolve), considérez SkyReels comme un préprocesseur qui vous fournit une matière première plus propre.

- Si vous préférez les outils ouverts, vous pouvez reproduire le flux avec FFMPEG pour l’ingestion/extraction et ne garder SkyReels que là où le modèle apporte réellement de la valeur (inférence de mouvement, inpainting).

- Pour le versionnage, traitez les prompts et paramètres comme du code : archivez-les dans git, stockez les seeds et sauvegardez le tag exact du modèle (j’ai utilisé V4.0 tel qu’affiché dans le tableau de bord le 6 mars 2026).

Par quel cas d’usage commencer ?

Si vous êtes curieux mais à court de temps, commencez par celui qui supprime un coin agaçant de votre semaine.

- Si vous postez de courts clips et détestez choisir de la musique : Vidéo sociale avec audio ambiant. Peu de configuration, soulagement rapide.

- Si vos photos produit semblent trop statiques : Image-to-video. Gardez la structure haute, le mouvement petit.

- Si vos montages se terminent trop tôt : Extension vidéo. C’est un correctif discret qui évite de refaire des prises.

- Si de petits désordres vous ralentissent : Inpainting. Masquez petit, vérifiez les bords.

- Si le silence rend les clips vides : Correspondance audio référencée. Donnez-lui un son de pièce, pas du chaos.

- Si vous construisez des outils internes : Intégration pipeline. Laissez les brouillons apparaître là où vous travaillez déjà.

Rien de tout ça n’est magique. Ce sont de petits leviers. Utilisés ensemble, ils ont réduit quelques décisions que je n’appréciais pas et m’ont donné un point de départ plus clair. C’est suffisant pour moi, du moins ce mois-ci. Je suis curieuse de savoir si les boucles ambiantes sembleront toujours invisibles après une douzaine de posts, ou si je commencerai à entendre les coutures.