SkyReels V4 : toutes les fonctionnalités expliquées – génération vidéo + audio, inpainting et édition

Un guide clair et accessible sur chaque grande fonctionnalité de SkyReels V4 — de la génération audio-vidéo conjointe à l'inpainting et l'édition — et ce que chacune apporte concrètement aux créateurs.

Avez-vous déjà rencontré le même problème que moi ?

Je m’appelle Dora. À l’époque, je créais une courte vidéo explicative, mais je me heurtais à un problème courant : le doublage et les visuels se désynchronisaient toujours pendant le montage. Ce n’était pas grave, mais cela donnait un rendu un peu brouillon. Je voyais souvent des gens mentionner « l’audio synchronisé » et de nouveaux flux de montage, alors la semaine dernière (fin février à début mars 2026), j’ai soigneusement testé SkyReels V4.

Le contenu suivant n’est pas une critique, mais plutôt mon témoignage direct sur les fonctionnalités de SkyReels V4 qui ont réellement changé mon travail quotidien. Si vous êtes également confronté à ces problèmes, continuez à lire !

Fonctionnalité 1 — Génération conjointe vidéo + audio

Ce que signifie concrètement « l’audio synchronisé »

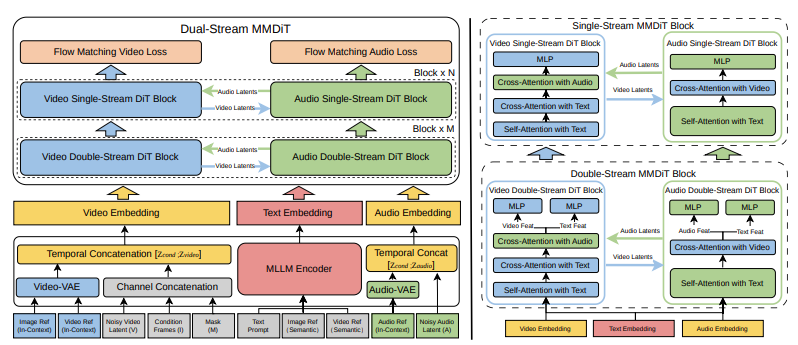

Je pensais que ce serait un terme à la mode. Ce n’était pas le cas. SkyReels V4 adopte une architecture Multimodal Diffusion Transformer (MMDiT) à double flux, où une branche synthétise la vidéo et l’autre génère un audio aligné temporellement, tout en partageant un puissant encodeur de texte basé sur des modèles de langage multimodaux de grande taille (MMLM). Lorsque SkyReels génère simultanément la vidéo et l’audio, le timing semble intégré dès le départ, et non ajouté après coup. Dans une démo de 20 secondes, le mouvement de la main à l’écran correspondait aux petits temps percussifs sans que j’aie à ajuster des images clés. La synchronisation labiale n’était pas parfaite (n’espérez pas un film doublé), mais cela a réduit les micro-ajustements que je fais habituellement pour masquer les décalages.

Le vrai changement : moins d’allers-retours sur la timeline. Normalement, je navigue entre un DAW et un éditeur vidéo pour affiner des millisecondes. Avec la génération conjointe, je n’ai effectué qu’un seul tour de coupes. Cela n’a pas fait gagner du temps au premier essai — apprendre les prompts a pris un moment — mais dès le troisième clip, j’ai remarqué que ma charge mentale avait diminué. Moins de préoccupations sur « l’audio est-il légèrement en avance ici ? » et plus d’attention sur le rythme et les incrustations de texte.

L’entrée de référence audio, comment ça marche

Fournir une référence audio donnait l’impression de donner au modèle un métronome et un tableau d’inspiration à la fois. J’ai utilisé une piste lo-fi douce comme guide et demandé des visuels urbains feutrés avec des panoramiques lents. Le résultat respectait le tempo, les coupes tombaient près des temps forts, et l’ambiance faisait écho à la référence sans la copier. Le bon côté : la courbe d’énergie était préservée. La limite : si la référence avait une section médiane chargée, les visuels avaient parfois tendance à trop couper à cet endroit. J’ai appris à choisir des références plus simples ou à cibler le segment qui m’importait.

En pratique, j’utiliserais des références audio lorsque j’ai une bande sonore fixée tôt (piste de marque client, habillage de podcast) et que je veux des visuels qui entrent en dialogue avec elle. Si vous préférez choisir la musique en dernier, cette fonctionnalité vous sera moins utile.

Fonctionnalité 2 — Prise en charge des entrées multimodales

Texte vers vidéo

Les prompts texte servaient d’ébauche rapide. J’ai écrit : « plan de bureau en plongée, pages d’un carnet qui se tournent, lumière chaude du matin. » Le premier résultat avait un cadrage correct mais des accessoires génériques. Après quelques ajustements — en mentionnant le grain du papier et un effet de vitesse d’obturation lente — le mouvement s’est amélioré et les hautes lumières se sont apaisées. Ce n’est pas un styliste d’accessoires : c’est un créateur d’ambiance. Je l’utilise comme des miniatures : bon pour la direction, pas pour les détails.

Image vers vidéo

SkyReels V4 accepte des instructions multimodales riches, notamment du texte, des images, des clips vidéo, des masques et des références audio, permettant un guidage visuel fin dans des conditions de conditionnement complexes. La conversion image vers vidéo m’a surpris avec SkyReels V4. J’ai déposé une photo fixe de mon vrai bureau. Le modèle l’a transformée en quelques secondes de dérive de caméra crédible, avec des ombres correspondant à l’angle de ma lampe. J’ai remarqué une légère déformation autour d’une tasse à café au premier essai. Relancer avec « maintenir la rigidité des objets » a aidé. Si vous essayez d’animer des photos de produits ou des publications sur les réseaux sociaux sans reconstruire une scène 3D, cela trouve un juste équilibre.

Vidéo vers vidéo (extension et édition)

La conversion vidéo vers vidéo s’est révélée un gain de temps pour la continuité. J’ai étendu un clip de 7 secondes à 12 secondes tout en conservant la même courbe de tonalité. Les modifications comme stabiliser un panoramique instable ou adoucir des hautes lumières trop dures ont bien fonctionné avec des instructions courtes et claires. Lorsque j’ai demandé trop de choses à la fois — nouveau mouvement, heure de la journée différente, changement d’étalonnage des couleurs — le résultat a vacillé. Ma note personnelle : une intention par session. Penser « étendre », puis « étalonner », puis « nettoyer », dans cet ordre.

Fonctionnalité 3 — Interface unifiée d’inpainting et d’édition

Ce que signifie la concaténation de canaux pour les créateurs (sans jargon technique)

Du côté vidéo, SkyReels V4 adopte une formulation par concaténation de canaux qui unifie un large éventail de tâches de type inpainting — telles que l’image vers vidéo, l’extension vidéo et l’édition vidéo — sous une seule interface, et s’étend naturellement à l’inpainting et à l’édition avec référence visuelle via des prompts multimodaux. En coulisses, SkyReels traite les entrées d’édition — masques, texte, indices audio — comme une conversation partagée plutôt que des étapes cloisonnées. Pour moi, cela signifiait que je pouvais effacer un câble gênant, ajuster l’indice de mouvement et conserver le même contexte de prompt sans recharger les assets. Moins de perte de contexte, moins de boucles d’export-réimport. Cela peut sembler anodin, mais éviter deux ou trois allers-retours par clip s’accumule.

L’inpainting avec référence visuelle expliqué

J’ai testé l’inpainting sur une photo de produit où le bord d’une étiquette semblait tordu. J’ai tracé un masque rapide et orienté le prompt vers « utiliser la texture de l’étiquette existante comme source ». Le remplissage respectait l’éclairage et le grain mieux que l’effet tampon de clonage que j’obtiens parfois avec d’autres outils. Sur du texte fin, il adoucissait parfois les micro-détails : effectuer un second passage avec « préserver les bords typographiques » a aidé. Je ne m’y fierais pas pour des corrections forensiques, mais pour le nettoyage d’arrière-plan et les petits ajustements d’accessoires, c’était plus rapide que mon flux de travail manuel.

Fonctionnalité 4 — Qualité de sortie cinématographique

1080p / 32 FPS / 15 secondes

Les spécifications ne racontent pas toute l’histoire, mais elles comptent. Le 1080p à 32 FPS pour des séquences allant jusqu’à 15 secondes m’a donné suffisamment de marge pour de courtes vidéos explicatives et des teasers. Le mouvement semblait fluide sans l’aspect savonneux du soap-opera. J’ai poussé une scène urbaine dense et observé un léger flou temporel sur des mouvements latéraux rapides : ajouter « caméra plus lente » avec un soupçon de flou de mouvement l’a amélioré. Si vous avez besoin de séquences plus longues, vous devrez toujours assembler des plans.

Capacité multi-plans

Le multi-plans était mon favori discret. J’ai storyboardé trois temps — établissement, détail, résolution — et les ai générés comme des éléments liés avec des indices de style partagés. Les coupes correspondaient plus proprement que lorsque je génère des scènes séparément. Ce n’est pas un éditeur complet : pensez « ensemble cohérent de plans », pas une timeline. Pour des séquences pour les réseaux sociaux ou des boucles pour pages d’atterrissage, c’était suffisant. Pour des documentaires ou des publicités avec des dialogues, je passerais quand même à un NLE traditionnel pour un contrôle fin.

Fonctionnalité 5 — Efficacité à grande échelle

La stratégie en deux étapes basse résolution + images clés expliquée simplement

Le moteur semble d’abord esquisser, puis embellir. Il ébauche un plan de mouvement en basse résolution, puis affine les images clés et interpole. Je l’ai remarqué lorsque les aperçus préliminaires semblaient bruts mais que les rendus finaux s’amélioraient nettement. En pratique, cela me permettait de prendre des décisions plus tôt. Je pouvais rejeter un plan en moins d’une minute si le mouvement semblait faux, au lieu d’attendre un rendu complet. Sur un lot matinal de six variations, cela m’a fait gagner environ 20 à 25 minutes.

Quelles fonctionnalités manquent encore ?

Quelques lacunes se sont démarquées :

- Contrôle des formats longs. Le plafond de 15 secondes vous pousse vers une réflexion modulaire. Parfait pour les réseaux sociaux, difficile pour les récits.

- Édition audio granulaire après génération. L’audio conjoint est excellent, mais je voulais toujours des enveloppes de volume par clip et des ajustements au niveau du temps à l’intérieur de l’outil.

- Traçabilité des versions. J’ai gardé mes propres notes car le lien entre les sorties et les modifications de prompt n’est pas aussi clair qu’il pourrait l’être.

- Contraintes strictes sur la continuité. Lors de l’extension d’un clip, j’aimerais pouvoir « verrouiller » certains objets ou couleurs pour qu’ils ne dérivent pas.

Pourquoi c’est important : les fonctionnalités de SkyReels V4 ont réduit ma charge cognitive sur les formats courts. Si vous jonguez déjà avec des DAW, l’étalonnage des couleurs et des outils de mouvement, cela consolide le milieu chaotique. Si vous avez besoin d’un contrôle de marque précis au pixel ou d’un contenu long avec script, vous devrez toujours l’associer à un éditeur plus puissant.

Cela a fonctionné à mon rythme — votre expérience peut varier. Je continuerai probablement à l’utiliser pour des vidéos explicatives de 10 à 30 secondes et des boucles de produits. Le petit gain régulier pour moi était l’attention : moins d’acrobaties sur la timeline, un peu plus de temps pour choisir ce qui compte vraiment à l’écran. Et c’est suffisant pour me garder ici, du moins pour l’instant.

Alors je suis curieuse —

Dans votre flux de montage, qu’est-ce qui vous coûte le plus d’énergie : synchroniser l’audio et les visuels, ou polir les petits décalages après coup ?

Si vous avez essayé des outils qui promettent « l’audio synchronisé », ont-ils vraiment réduit les frictions — ou les ont-ils simplement déplacées ?

Je teste encore où cela s’intègre dans mon ensemble d’outils. Quel est le premier goulot d’étranglement que vous supprimeriez dans le vôtre ?