Avis sur MaxClaw : Testé dans des Workflows Réels (Verdict Honnête)

Nous avons testé MaxClaw sur 5 workflows réels. Voici ce qui a vraiment fonctionné, ce qui nous a frustrés, et si l'abonnement en vaut la peine en 2026.

Salut, c’est Dora. Ces derniers temps, je butais sans cesse sur la même petite friction : des tâches quotidiennes en plusieurs étapes qui me volaient ma concentration. Des choses comme « parcourir trois liens, en tirer un résumé cohérent, et l’envoyer dans un chat Telegram » ou « analyser un PDF de 40 pages, extraire les risques, et déposer une courte note dans mes docs ». Rien de compliqué en soi. Mais exactement le genre de tâches qui rendent une journée plus lourde qu’elle ne devrait l’être.

J’ai donc testé MaxClaw pendant deux semaines de travail. Je voulais voir s’il pouvait prendre en charge ces corvées sans que j’aie à le surveiller. Je ne suis pas là pour comparer des fonctionnalités. Je voulais sentir si ça allégeait ma journée. C’est ça, mon critère.

Comment nous avons testé MaxClaw (notre configuration et nos cas d’usage)

J’ai utilisé MaxClaw sur macOS (M3 Air), Chrome et iOS. Mon point de référence : j’utilise habituellement de petits flux de type agent dans Notion + Zapier + un wrapper Claude API quand nécessaire. Je suis à l’aise avec les webhooks, mais je n’aime pas les maintenir.

Mes cas d’usage étaient ordinaires :

- Capture de recherche : lire 3 à 6 sources, extraire l’essentiel (ce qui est « ennuyeux mais vrai »), et transmettre à un canal Telegram que je tiens pour mes notes hebdomadaires.

- Coordination d’agenda : aligner deux calendriers, proposer des créneaux, et envoyer un message de confirmation une fois qu’un créneau est retenu.

- Lecture de documents : parcourir de longs PDF, extraire les décisions, les risques et les actions à mener, puis rédiger un bref rapport.

J’ai mesuré trois choses :

- Temps de configuration : minutes entre l’inscription et la première exécution utile.

- Charge de supervision : nombre de corrections ou de reformulations par tâche.

- Dérive ou mémoire : est-ce qu’il se souvient de mes préférences après quelques jours sans rappel.

J’ai exécuté chaque workflow 5 à 7 fois pour voir si la répétition réduisait la friction. C’est ce qui m’importe davantage qu’une belle « première démo ».

Prise en main et premières impressions

Temps entre l’inscription et la première tâche fonctionnelle

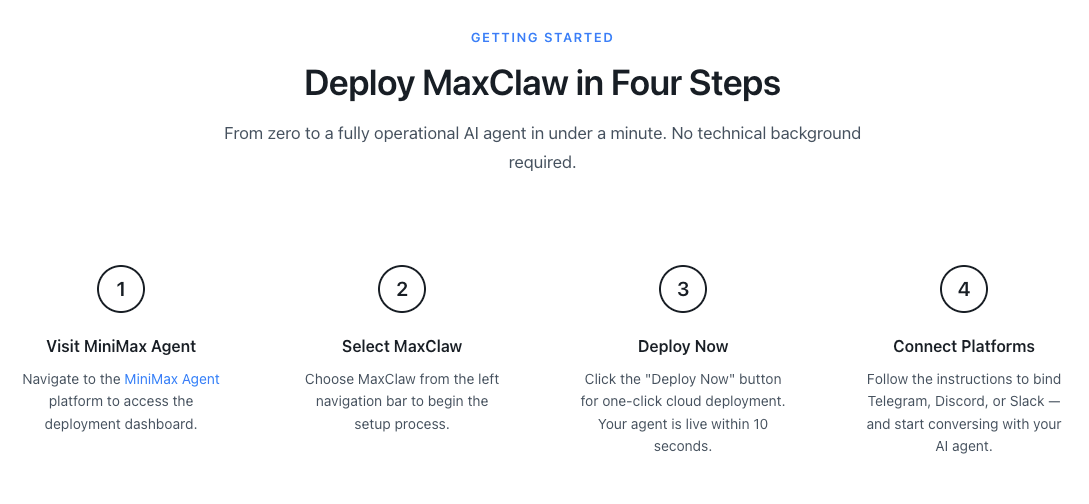

L’inscription était simple. Email, vérification, choix d’un plan. Je n’ai pas chronométré, mais j’avais ma première tâche fonctionnelle en environ 18 minutes. L’étape la plus lente n’était pas MaxClaw, c’était moi qui décidais quoi automatiser en premier. J’ai commencé par un petit enchaînement recherche → résumé → notification Telegram.

Ce qui m’a surprise : les modèles par défaut n’étaient pas tape-à-l’œil. Pas de confettis clignotants, pas de vibe « multipliez votre productivité par 10… ». J’ai apprécié cette retenue.

Expérience d’intégration des plateformes

Telegram a demandé un peu de bidouillage. J’ai créé un bot via BotFather, récupéré le token, et collé dans MaxClaw. J’ai dû définir l’ID du chat manuellement. Pas difficile, mais ça suppose que vous l’avez déjà fait. Si ce n’est pas le cas, la documentation de l’API Telegram Bot est plus claire que la plupart des infobulles produit.

L’intégration calendrier était plus fluide. L’authentification Google s’est faite rapidement et les créneaux libres/occupés s’affichaient correctement dès le premier essai. Aucun calendrier en doublon n’est apparu (petit soulagement).

Pour les documents, j’ai téléchargé un deck stratégique de 28 pages (PDF) et un rapport de recherche de 43 pages (PDF). L’analyse était suffisamment rapide pour que je ne dérive pas vers mes emails en attendant. J’ai fait un test avec un lien public : ça a bien fonctionné, mais je reste aux téléchargements directs pour éviter les problèmes de permissions.

Tests de workflows réels

Test 1 : Recherche + résumé + envoi via Telegram

Je lui ai donné 4 sources : un article de blog, un communiqué de presse, une note technique et un fil de forum. Mon instruction : « donne-moi un résumé sobre en 6 à 8 points, avec les sources, puis envoie-le sur mon canal Telegram. »

Exécution 1 : le résumé était bon mais le ton légèrement enthousiaste. J’ai ajusté l’instruction de style sur « sobre, pas promotionnel ». Les exécutions 2 à 6 ont conservé ce ton plus calme. Petite victoire : dès l’exécution 3 (après une correction de ma part), il a commencé à joindre les titres des sources plutôt que les URL brutes. Les liens ne se sont pas cassés dans Telegram, ce qui arrive parfois quand les outils sur-formatent.

Temps gagné ? La première exécution n’a pas fait gagner du temps — il m’a fallu ~10 minutes pour corriger le ton et le format des sources. Dès l’exécution 4, la révision prenait ~2 minutes. Rien de spectaculaire, mais l’effort mental a diminué. Je n’avais plus à garder la structure en tête.

Test 2 : Tâche de planification en plusieurs étapes

Je lui ai demandé de proposer trois créneaux de 45 minutes entre deux calendriers la semaine suivante, en privilégiant les matins, puis de rédiger un court message de confirmation une fois qu’une réponse arrivait avec un choix. Il a géré correctement les fuseaux horaires (je suis UTC+1, l’autre personne en ET). Pas de tentative de sur-optimisation, pas de « et si on prenait 6h du matin ? ».

Le message de confirmation était neutre et clair. J’ai aimé qu’il n’assume pas « réunion acceptée » avant que j’appuie sur Envoyer. J’ai dû valider le créneau final. Franchement, je préfère ça. Si un agent verrouille un créneau que je n’avais pas l’intention de confirmer, c’est moi qui m’excuse après.

Test 3 : Analyse de document et génération de rapport

C’était mon vrai test. Je lui ai demandé de lire un rapport de 43 pages et de me fournir :

- les décisions clés en langage simple,

- trois risques avec probabilité et impact (faible/moyen/élevé),

- une synthèse d’une page que je pourrais coller dans mes notes.

L’exécution 1 était correcte mais longue. Il m’a donné deux pages. J’ai demandé un maximum de 350 mots, et il a obéi lors des exécutions suivantes. L’évaluation des risques était posée, pas alarmiste. Quand le PDF contenait des tableaux, il les résumait plutôt que de tenter de les reconstruire — bon choix.

J’ai vérifié deux affirmations qui me semblaient douteuses. Elles étaient en réalité correctes : le rapport les avait glissées dans une annexe. Cela dit, je ne transmettrais pas ce résultat à un client sans l’avoir relu moi-même. C’est un outil de réflexion, pas un rédacteur final.

Mémoire à long terme — Est-ce que ça marche vraiment ?

Réponse courte : plus ou moins, et c’est suffisant.

J’ai donné à MaxClaw quelques préférences permanentes dès le premier jour :

- ton : sobre, pas promotionnel

- résumés Telegram : 6 à 8 points, sources avec titres

- planification : éviter les réservations provisoires, préférer les matins à mon heure

Une semaine plus tard, j’ai relancé les mêmes tâches sans rappeler ces règles. Il s’est souvenu du ton et de la longueur des résumés. Il a oublié les titres des sources une fois, puis les a récupérés à l’exécution suivante. La règle sur les réservations provisoires a tenu. Quand j’ai changé « préférer les matins » en « n’importe quand entre 9h et 17h », il a honoré ce changement immédiatement.

Analyse des coûts

Ce que couvre l’abonnement

Les tarifs évoluent, vérifiez la page produit pour les dernières informations. L’analyse MaxClaw de WaveSpeed explique que de « Créer MaxClaw » à une passerelle d’agent opérationnelle, il faut moins de 20 secondes, avec des intégrations optionnelles qui suivent des étapes guidées et nécessitent une configuration minimale. Pendant ma période de test, l’abonnement couvrait :

- l’accès à l’agent avec les intégrations intégrées (Telegram, calendriers, docs),

- un pool mensuel d’exécutions de tâches et de traitement de documents,

- et l’utilisation de modèles hébergés, sans gestion de clés API de ma part.

Pour moi, la valeur n’était pas dans un quelconque « illimité ». C’était de ne pas avoir à maintenir du code de collage. Je ne surveillais pas les webhooks et je ne me demandais pas si un secret avait expiré. Ça seul vaut quelque chose quand votre temps est fragmenté.

Comparé à utiliser OpenClaw avec l’API Claude

Je n’ai pas trouvé de documentation officielle stable pour « OpenClaw ». Si vous pensez à « agent DIY + Claude », voici mon calcul habituel en utilisant l’API Claude :

- Le tarif du modèle (ex. Claude 3.5 Sonnet) tourne autour de quelques dollars par million de tokens en entrée, plus pour les sorties. Au moment de la rédaction, Anthropic publie des tarifs au million : consultez leur page pour les chiffres exacts.

- Une exécution type recherche → résumé me coûte des centimes, pas des dollars. Les plus lourdes (longs PDF avec plusieurs passes) s’accumulent, mais dépassent rarement quelques dollars par jour.

- Coûts cachés : votre temps à câbler les nouvelles tentatives, les périmètres d’authentification, la gestion des erreurs, les calendriers et les particularités des bots Telegram. Si vous aimez ça (ça m’arrive), tant mieux. Sinon, un abonnement qui fonctionne tout seul peut être moins cher en pratique.

Ce que MaxClaw fait vraiment bien

- Passe de l’idée au flux opérationnel rapidement. Je n’ai pas lutté avec une interface de construction ni passé un après-midi sur « encore un réglage ».

- Gère les moments de transition avec grâce. Rédige un message, attend la validation, puis continue. Cette petite pause m’a évité la sur-automatisation.

- La digestion de documents est fiable. Il n’hallucine pas les tableaux ni ne force une structure là où il n’y en a pas. Les résumés semblaient ancrés dans la réalité.

- La mémoire des petites préférences est suffisamment bonne. Le style et les petites règles ont tenu sur une semaine sans que je les répète.

- Les intégrations Telegram + calendrier étaient stables. Pas de publications en doublon, pas de plantage sur les fuseaux horaires. J’ai appris à m’y attendre — je ne les ai pas vus ici.

Là où ça manque encore

- Le ton de la première exécution peut dériver vers l’enthousiasme. Si vous voulez sec et neutre, dites-le explicitement.

- La mémoire est superficielle par conception. Parfait pour le style et les paramètres récurrents, pas pour le contexte complexe d’un projet. Je garde quand même les prompts clés dans une note.

- Surface de débogage limitée. Quand quelque chose rate (comme un titre de source manquant), les logs sont sommaires. J’ai pu corriger, mais j’aurais voulu un « pourquoi » plus clair.

- L’attribution des sources nécessite des rappels. Il lui arrivait d’inférer les auteurs depuis les noms de sites. Facile à corriger, mais à surveiller si vous partagez largement vos résumés.

Verdict final — À qui s’adresse MaxClaw ?

Si vos journées sont remplies de petites corvées répétitives — résumés, notifications, planification légère — et que vous préférez ne pas maintenir des bots et des scripts, MaxClaw vaut la peine d’être essayé. Il ne vous éblouira pas, et c’est justement l’idée. Il fait le travail sans réclamer votre attention.

Ceux qui l’apprécieront :

- les créateurs indépendants qui tiennent un fil discret Telegram ou Slack de notes de recherche,

- les opérateurs et les chefs de produit qui veulent une coordination d’agenda prévisible sans construire un mini-système,

- les chercheurs qui ont besoin de synthèses compactes de longs documents, avec suffisamment de contrôle pour maintenir un ton constant.

Cette revue de MaxClaw se résume à une impression simple : après le premier jour, j’ai passé moins de temps à penser au « comment » et plus de temps à lire les résultats. Et ce petit soulagement — moins d’onglets ouverts, moins de micro-décisions — a été la vraie victoire. Je reste curieuse de voir comment il se comportera avec des projets plus chaotiques, entre plusieurs outils. Je garderai un œil là-dessus, discrètement.