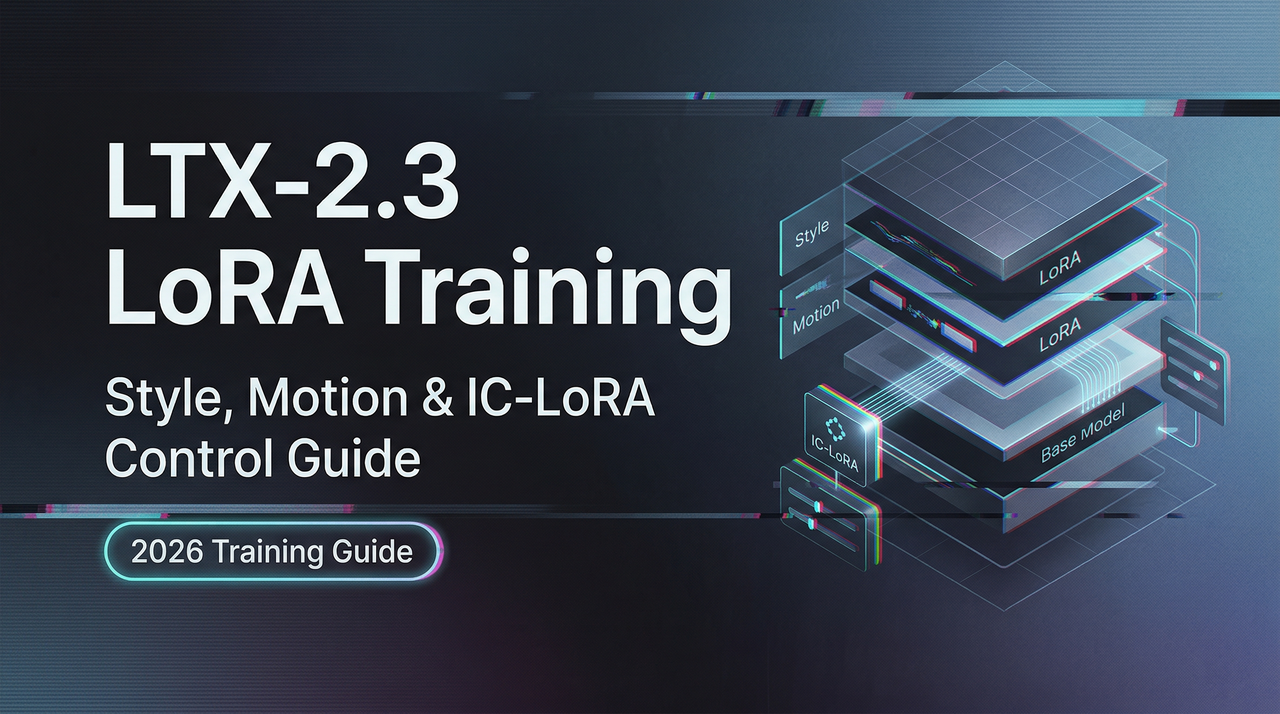

Guide de formation LoRA pour LTX-2.3 : Style, mouvement et contrôle IC-LoRA (2026)

Entraînez des LoRAs personnalisés sur LTX-2.3 avec le ltx-trainer officiel. Couvre les LoRAs de style, le contrôle structurel IC-LoRA, les paramètres de rang, la préparation des jeux de données et les erreurs d'entraînement courantes.

Salut, mon ami. C’est Dora.

Je n’avais pas prévu de passer une semaine à entraîner des LoRA. J’avais juste besoin qu’une démo produit suive un pattern de mouvement spécifique, et les prompts textuels ne suffisaient pas. Cette petite friction m’a entraînée sur le chemin de l’entraînement LTX-2.3, et ce que j’ai trouvé m’a surprise — non pas parce que c’est révolutionnaire, mais parce que c’est discrètement pratique une fois qu’on sait quels paramètres comptent vraiment.

Ce n’est pas une référence exhaustive. C’est ce que j’ai appris en testant des workflows de style, de mouvement et de contrôle IC-LoRA en mars 2026.

Ce que contient l’entraîneur officiel de LTX-2.3

Le dépôt GitHub LTX-2 est organisé comme un monorepo avec trois packages : ltx-core pour l’implémentation du modèle, ltx-pipelines pour les workflows de génération, et ltx-trainer pour le fine-tuning LoRA et IC-LoRA. Les paramètres de largeur et de hauteur doivent être divisibles par 32, et le nombre de frames doit suivre la règle 8n+1 — c’est-à-dire 1, 9, 17, 25 frames, et ainsi de suite.

J’ai ignoré ça lors de mon premier entraînement. L’entraîneur a planté, j’ai rembourré les frames manuellement, et ça a fonctionné. Contrainte mineure, mais à connaître dès le départ.

Trois types de LoRA et quand utiliser chacun

LoRA de style (apparence, texture, couleur)

Les LoRA de style apprennent à LTX-2.3 des esthétiques visuelles — étalonnage des couleurs, traitement des textures, ambiance lumineuse. J’en ai entraîné un sur de la photographie produit avec des fonds blancs uniformes et des ombres douces. Pour les LoRA de personnages ou de style, 20 à 50 images suffisent généralement pour obtenir de bons résultats, bien que pour des sujets très spécifiques, je sois allée jusqu’à 80-120 images.

Les datasets d’images uniquement fonctionnent très bien ici. Pour mes premières LoRAs, j’ai utilisé des frames fixes plutôt que des clips vidéo — c’est plus simple à sélectionner, et le modèle apprend l’identité sans avoir besoin de traiter le mouvement.

LoRA de mouvement / effets (déplacement, transformation)

Les LoRA de mouvement se concentrent sur la façon dont les choses bougent plutôt que sur leur apparence. Panoramiques de caméra, rotation d’objets, séquences de transformation. Ceux-ci nécessitent de courts clips vidéo cohérents, pas des images fixes. J’ai testé un LoRA de mouvement dolly-in avec des clips de 15 secondes à un cadrage cohérent, et le modèle a capté le pattern de mouvement sur différents sujets.

L’entraînement du mouvement m’a semblé moins stable que le style. Plus de tentatives, des résultats plus variables.

IC-LoRA (contrôle structurel : profondeur, pose, contour canny)

L’IC-LoRA est différent. Au lieu d’apprendre au modèle une nouvelle esthétique ou un nouveau mouvement, il conditionne la génération sur des signaux de référence — cartes de profondeur, squelettes de pose, détections de contours. L’IC-LoRA permet de conditionner la génération vidéo sur des frames vidéo de référence au moment de l’inférence, permettant un contrôle vidéo-à-vidéo précis par-dessus le modèle de base texte-vers-vidéo.

J’ai utilisé un IC-LoRA de profondeur pour bloquer le mouvement de caméra tout en changeant complètement le contenu visuel. Le guide officiel IC-LoRA explique bien les trois modes de contrôle : Canny pour la préservation des contours, Depth pour la caméra et la géométrie spatiale, Pose pour le transfert de mouvement humain.

Règles de préparation du dataset

Contrainte du nombre de frames (règle 8n+1)

Le nombre de frames doit être divisible par 8 + 1. Ce n’est pas une recommandation flexible — si vos clips font 10 ou 15 frames, l’entraîneur plantera ou les rembourrera en interne. J’ai traité mon dataset en lots à 17 frames (2 × 8 + 1) avant de télécharger, et l’entraînement s’est déroulé sans problème.

Divisibilité de la résolution (règle des 32px)

La largeur et la hauteur doivent être divisibles par 32. Je l’ai appris après avoir redimensionné un lot à 1024×576 et avoir vu l’entraîneur le rembourrer silencieusement à 1024×608. Mieux vaut redimensionner correctement dès le départ.

Datasets vidéo vs image : quand utiliser chacun

Les datasets d’images uniquement sont valides pour l’entraînement LoRA de LTX-2.3. C’est bien plus simple que de forcer l’apprentissage du mouvement trop tôt, surtout pour les LoRA d’identité ou de style. Je commençais chaque projet avec des images fixes, validais l’apparence, puis ajoutais de courts clips vidéo si le mouvement importait.

Pour les travaux à fort contenu de mouvement, de courts clips cohérents surpassent toujours les longs segments multi-scènes.

Paramètres d’entraînement de base

Rang 32 comme valeur par défaut correcte et quand monter plus haut

Pour LTX-2.3, le rang 32 est la valeur par défaut correcte. Il offre généralement une capacité suffisante sans rendre le LoRA trop rigide trop tôt. J’ai testé le rang 64 sur un LoRA de style complexe et constaté une amélioration minimale — la capacité supplémentaire n’a pas aidé parce que mon dataset n’était pas assez grand ou diversifié pour la remplir.

Point de départ du taux d’apprentissage et quand le modifier

Pour l’entraînement LoRA de LTX-2.3, 1e-4 est le bon point de départ. C’est l’un de ces cas où la réponse ennuyeuse est la bonne réponse. Je n’ai pas touché au taux d’apprentissage sur mes quatre premières LoRAs, et toutes ont convergé proprement.

Nombre d’étapes : comment savoir quand s’arrêter tôt

Beaucoup d’utilisateurs perdent du temps en sautant directement à des nombres d’étapes élevés sans vérifier si le checkpoint 250, 500 ou 750 est déjà bon. Je prélève un échantillon au checkpoint 500, et si le LoRA a déjà l’air solide, je m’arrête là. Si un LoRA semble déjà bon au checkpoint 750 ou 1000, le pousser beaucoup plus loin peut simplement le rendre plus fragile.

Le surapprentissage se manifeste quand le modèle mémorise les données d’entraînement au lieu de généraliser. Les échantillons de validation commencent à ressembler exactement aux frames d’entraînement.

IC-LoRA : contrôle par profondeur, pose et contour

En quoi l’IC-LoRA diffère d’un LoRA de style standard

L’IC-LoRA sépare le mouvement du style visuel. Vous orientez l’apparence avec du texte et des LoRA de style, et orientez le mouvement avec des guides structurels. Le modèle de contrôle union IC-LoRA de LTX-2.3 prend en charge plusieurs signaux de contrôle — profondeur, pose, contour — dans un seul adaptateur.

J’ai exécuté un IC-LoRA de profondeur sur une séquence de plateaux tournants produit. Le chemin de caméra est resté verrouillé sur la carte de profondeur de référence, mais le contenu visuel a changé complètement en fonction de mon prompt.

Intégration du workflow IC-LoRA dans ComfyUI

Le workflow RunComfy LTX 2.3 IC-LoRA gère automatiquement l’extraction de profondeur, de pose et de contour. Chargez un clip de référence, choisissez un mode de contrôle, rédigez un prompt centré sur le style, et le modèle gère le mouvement séparément.

Un détail que j’ai manqué au début : gardez les prompts centrés sur l’apparence car l’IC-LoRA gère le mouvement et la structure. Essayer de décrire le mouvement de caméra dans le prompt pendant que l’IC-LoRA le contrôle crée un conflit.

Échecs courants à l’entraînement et solutions

Débordement du LoRA sur tout (solution DOP)

Le DOP (Dropout of Prompts) est la première option avancée à utiliser quand un LoRA commence à déborder sur tout. J’ai entraîné un LoRA de style produit qui fonctionnait bien sur des éléments similaires mais commençait à affecter des sujets sans rapport. Ajouter du caption dropout a aidé le LoRA à généraliser.

Surapprentissage à des nombres d’étapes élevés

Ne traitez pas plus d’étapes comme une amélioration universelle de la qualité. J’ai poussé un LoRA de mouvement à 2 000 étapes et l’ai vu commencer à reproduire des frames d’entraînement exactes plutôt qu’à apprendre le pattern sous-jacent. Retour au checkpoint 750.

Conflit entre caption dropout et cache des embeddings textuels

Si le caption dropout est utilisé, Cache Text Embeddings doit rester DÉSACTIVÉ. C’est l’un des rares petits paramètres qui peut silencieusement dégrader le comportement d’entraînement s’il est mal utilisé. Je les ai activés tous les deux une fois et obtenu des résultats incohérents — le modèle ne pouvait pas décider s’il devait s’appuyer sur les embeddings mis en cache ou gérer les légendes manquantes.

Vérifier votre LoRA avant le déploiement

Je lance trois tests de validation avant de considérer un LoRA terminé : le même prompt avec et sans le LoRA pour confirmer qu’il ajoute ce que j’attends, des prompts variés pour vérifier la généralisation, et des cas limites qui n’étaient pas dans le dataset d’entraînement. Si le LoRA ne fonctionne qu’avec des prompts qui correspondent étroitement aux légendes d’entraînement, il est en surapprentissage.

FAQ

Puis-je entraîner des LoRA sur des A100 ou des GPU moins puissants ?

L’entraînement LTX-2.3 cible officiellement les GPU Nvidia H100 avec 80 Go+ de VRAM, bien que des configurations avec moins de VRAM puissent fonctionner avec le gradient checkpointing et des résolutions réduites. Je n’ai pas testé l’entraînement sur A100 moi-même, mais la documentation officielle de l’entraîneur indique cela comme référence matérielle recommandée.

Combien de temps faut-il pour entraîner un LoRA de style sur H100 ?

Environ 3 à 5 heures par LoRA sur un seul 4090 pour des datasets de taille moyenne, y compris la validation et les petits redémarrages, selon les retours du terrain. Le H100 devrait être plus rapide, bien que je n’aie pas de chiffres directs.

Les LoRA de LTX-2 fonctionnent-ils sur LTX-2.3 sans réentraînement ?

Non. LTX-2.3 est livré avec un VAE entièrement repensé entraîné sur des données de meilleure qualité, et l’architecture du connecteur texte a changé. Les anciens LoRA de LTX-2 ne se transfèrent pas proprement — je l’ai testé et obtenu des artefacts visuels.

L’IC-LoRA peut-il être combiné avec des LoRA de style ?

Oui. Vous pouvez empiler jusqu’à trois adaptateurs LoRA simultanément, mélangeant esthétiques personnalisées et contrôle structurel. J’ai exécuté un LoRA de style avant le chargeur IC-LoRA et maintenu son poids modéré pour que l’IC-LoRA puisse maintenir la géométrie et le timing.

L’entraînement LoRA est-il disponible via des plateformes cloud ?

Oui. RunComfy AI Toolkit et fal.ai proposent tous deux un entraînement via navigateur sans gestion d’infrastructure GPU. Téléchargez votre dataset, configurez les paramètres, téléchargez le LoRA une fois terminé.

Entraîner des LoRA pour LTX-2.3, ce n’est pas de la magie. C’est de la préparation de dataset, des paramètres de base, et savoir quand s’arrêter tôt. La règle des frames 8n+1 et la contrainte de divisibilité par 32px semblent arbitraires au premier abord, mais ce sont simplement les exigences géométriques du modèle. Travaillez avec elles, pas contre elles.

Ce qui m’a surprise, ce n’était pas la complexité — c’était le temps que j’ai économisé en m’en tenant au rang 32 et au taux d’apprentissage 1e-4 plutôt que de tweaker chaque paramètre dès le premier essai.

Articles précédents :