Guide de l'API LTX-2.3 : 7 points de terminaison, options d'accès et utilisation en production

LTX-2.3 propose 7 points de terminaison : texte vers vidéo, image vers vidéo, audio vers vidéo, extension, reprise (variantes standard et rapide). Ce guide couvre chaque mode et les options d'accès à l'API gérée.

Bonjour, je m’appelle Dora. Un petit détail m’a poussée à explorer l’API LTX-2.3 la semaine dernière : je reconstruisais sans cesse les mêmes plans explicatifs de 6 à 10 secondes à la main. Rien de dramatique — juste la corvée de recommencer encore et encore. J’avais vu passer des mentions de variantes « rapides » et d’endpoints « retake », alors j’ai consacré quelques matinées en mars 2026 à tester l’API ltx-2.3 dans un contexte de travail réel. Sans fanfare. Juste une poignée de prompts, quelques maquettes produit, et une intro de podcast sur laquelle je m’attardais trop.

Ce qui suit n’est pas un tour d’horizon des fonctionnalités. C’est le comportement des endpoints de l’API ltx-2.3 tel que je l’ai vécu, ce qui a accéléré les choses, et là où les limites se font encore sentir.

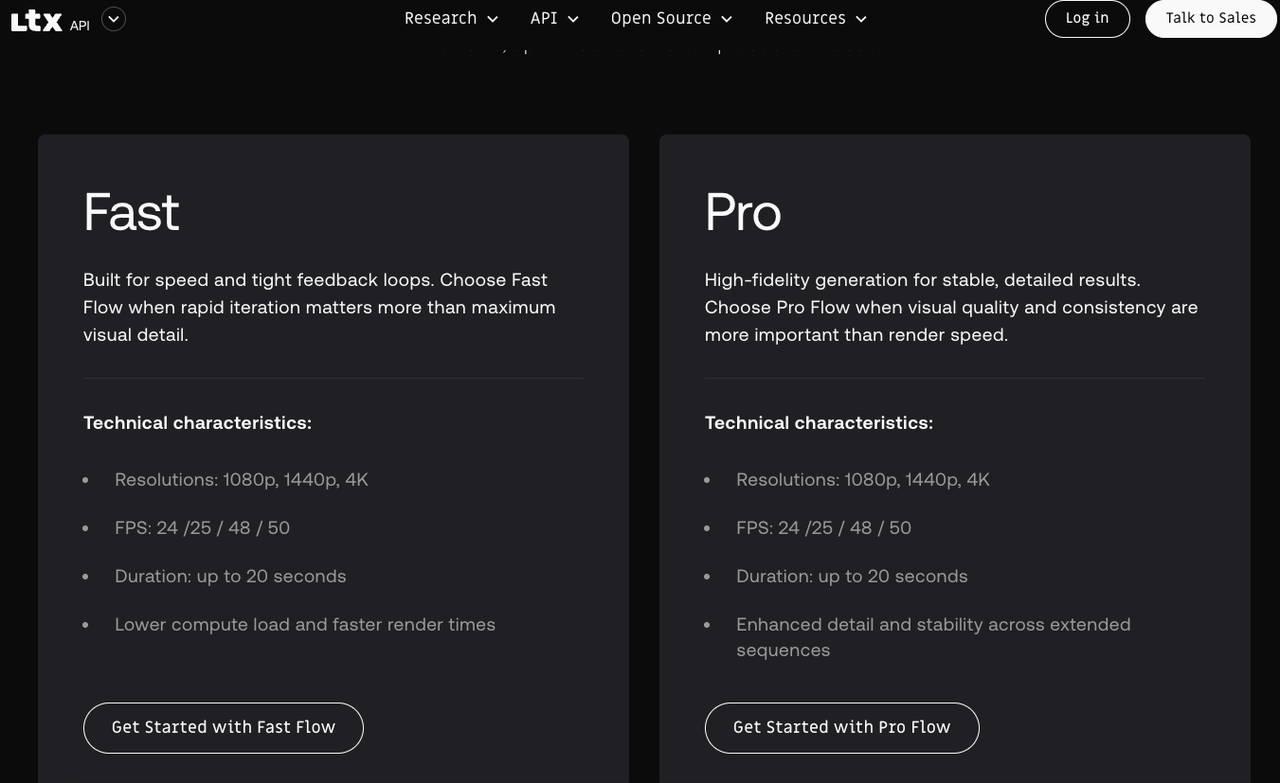

Les 7 Endpoints de LTX-2.3 en un Coup d’Œil

Voici la carte mentale que j’ai fini par utiliser après une semaine d’essais. Ce que j’ai remarqué en premier : ce ne sont pas des « fonctionnalités » séparées — ce sont des curseurs dans une séquence. Je passais souvent de text-to-video rapide pour esquisser, puis je verrouillais les prompts avant de basculer sur standard, ou je générais un clip image-to-video et je l’étendais pour ajuster le timing. La plateforme expose tout cela via une conception REST API standard, ce qui évitait que le flux de travail se fragmente entre plusieurs onglets.

- Text-to-Video (standard) : la passe qualité. Plus lente, meilleure cohérence du mouvement, textures plus nettes. Je l’utilisais quand le plan comptait et que je pouvais attendre.

- Text-to-Video (rapide) : le repérage. Lectures rapides sur le cadrage et les idées de mouvement, utile pour affiner les prompts et l’idéation en batch.

- Image-to-Video : anime une seule image. Si je voulais qu’un logo « rebondisse » ou qu’une maquette « respire » à l’écran, c’était suffisant sans trop dériver.

- Audio-to-Video : conditionne le mouvement avec une piste audio. Pas de la synchronisation labiale magique — plutôt donner un métronome au modèle.

- Extend-Video : ajoute des secondes à la fin. La continuité est correcte si les prompts et les seeds sont stables.

- Retake-Video : régénère un segment en conservant les contraintes. Utile pour corriger une main instable ou un mouvement de caméra bizarre sans tout recommencer.

- Système/Utilitaire : suivi des tâches. Pas glamour, mais nécessaire.

Text-to-Video : Compromis entre Variante Standard et Rapide

Je n’arrêtais pas de passer de l’une à l’autre. La distinction est simple sur le papier — vitesse vs qualité — mais elle se manifeste dans des détails qui comptent quand on livre un projet.

- La variante rapide tournait 2 à 4 fois plus vite par clip sur des hébergements managés. Idéale pour les esquisses et le choix d’une direction — pas idéale pour les textures fines ou la typographie en petite taille.

- La variante standard réduisait les « bords fondus » sur les mains et les scintillements de micro-mouvement, et maintenait la direction de l’éclairage de manière plus cohérente d’une image à l’autre.

- Sur les prompts chargés (foules, eau, feuillage), la variante standard gérait mieux le bruit temporel. La rapide semblait parfois correcte au premier visionnage, puis paraissait « agitée » coupée à côté de vraies images.

La vérité sans fioritures : j’ai gagné plus de temps en changeant de variante au bon moment que en poussant n’importe quel réglage à l’extrême.

Paramètres Clés et Conseils sur les Prompts

Quelques paramètres ont vraiment fait la différence :

- Durée et images : Plus court, c’est mieux. 4 à 8s à 16–24 fps était la plage idéale pour un mouvement stable et des temps d’attente raisonnables.

- Seed : Fixez-le une fois qu’une direction vous convient. Les seeds ont rendu les retakes et les extensions bien moins chaotiques.

- Guidance/CFG : Plus bas (4–6) laissait le modèle respirer ; plus haut (7–9) clamait le style mais augmentait la monotonie image par image.

- Indices négatifs : Ciblez-les sur le mouvement, pas seulement sur les visuels — « éviter les zooms rapides », « pas de caméra qui tourne », « trépied stable ». Cela a mieux contenu les à-coups que de décrire des objets.

La structure de prompt qui fonctionnait de manière fiable : une phrase pour la scène et le sujet, une pour la caméra et le mouvement, une pour la lumière et la texture. J’ai arrêté de surcharger les adjectifs dès que j’ai remarqué qu’ils se contredisaient.

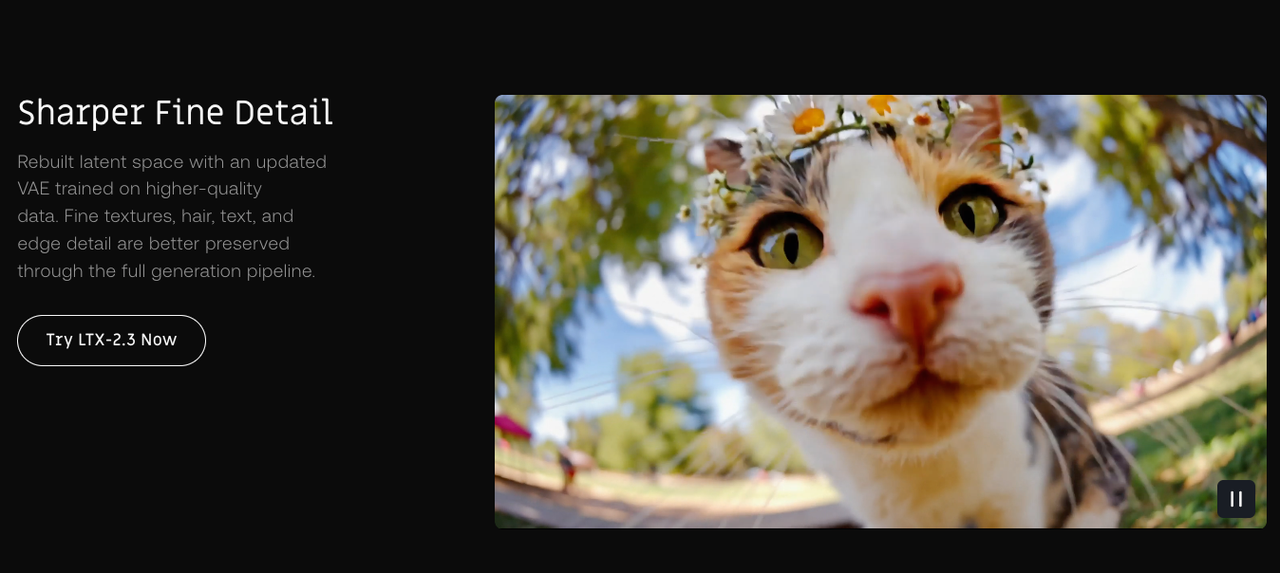

Image-to-Video : Spécifications d’Entrée et Risques d’Artefacts

Je l’ai surtout utilisé pour animer des images fixes — maquettes d’interface, visuels héros de produit, marques simples. L’entrée appréciait les sources nettes : des PNG nets, sans compression dégradée. Le format carré ou quasi-carré fonctionnait le mieux.

- Des indications de caméra douces (« légère parallaxe, légère oscillation à la main ») donnaient de la vie sans déchirer l’image.

- Gardez les calques de texte grands — les petites étiquettes d’interface devenaient illisibles en mouvement. J’ai intégré le texte critique en surimpression en post-production.

- Les dessins au trait fins scintillaient aux bords. Un léger flou en pré-traitement aidait.

- Les logos restaient lisibles si j’évitais les rotations rapides. Pour les révélations, je laissais le modèle faire une inclinaison de 10 à 15°, puis je coupais.

Si un artefact apparaît aux images 1–2, il persiste généralement. Régénérez avec un nouveau seed avant d’essayer de le corriger en post-production.

Audio-to-Video : Comment le Conditionnement Fonctionne Réellement

Je m’attendais à de la synchronisation labiale. Ce n’est pas ce que fait cet endpoint. Pensez plutôt rythme, énergie et grandes indications de mouvement. Avec des pistes de batterie, le modèle captait les temps forts comme de légères impulsions de caméra. Avec de l’audio ambiant, il ralentissait — moins de saccades, plus de dérive.

En pratique, je traitais l’audio comme une carte de tempo. Pour un fond ambiant de 20s, je découpais deux clips de 8s et un de 4s, chacun conditionné sur la même piste, puis je choisissais le meilleur pour la continuité. Même les grondements basse fréquence influençaient le mouvement — si vous ne voulez pas que la caméra « respire » à chaque coup de basse, ajoutez « pas de pulsation rythmique de la caméra » comme prompt négatif.

Où c’était utile : beds de foley, rythme musical pour le b-roll, correspondance de tonalité. Où ça ne l’était pas : synchronisation labiale, édition précise au tempo, ou scènes de dialogue.

Extend et Retake : Construire des Séquences Plus Longues ou Corrigées

Ces deux endpoints sont des victoires discrètes. J’ai enchaîné deux clips de 6s en un plan de 12s en prolongeant la fin du premier clip avec le même prompt, seed et indications de caméra. Le raccord n’était pas parfait, mais le point de coupe se cachait bien sous une respiration dans la bande sonore. Si la première image de votre extension semble incorrecte — arrêtez-vous là. Les mauvais débuts se rattrapent rarement.

Retake a corrigé un panoramique rapide qui s’était glissé dans les 2 dernières secondes d’un clip par ailleurs réussi. J’ai conservé les indications négatives sur le mouvement, pas le contenu, et j’ai eu besoin de 1 à 3 essais en moyenne. Les deux endpoints bénéficient de discipline : verrouillez le seed, la durée et le langage de caméra avant de chercher des micro-corrections.

API Auto-Hébergée vs Managée : Compromis

J’ai testé un hébergement managé (interface style fal.ai) et une machine locale pendant une journée. L’API managée gagne quand vous avez besoin de dix variantes rapidement et que vous ne voulez pas surveiller les pilotes — mais les limites de débit et les coûts à la minute s’accumulent sur des exécutions plus longues. L’auto-hébergement offre un coût marginal plus bas et un contrôle total du batch, au prix de la friction d’installation et des tracas de pilotes.

Une heuristique simple : une douzaine de courts clips exploratoires — l’hébergement managé gagne. Des centaines de secondes avec des prompts verrouillés — l’auto-hébergement commence à s’amortir.

Pour le matériel, 24 Go de VRAM était le plancher confortable pour des clips de 8 à 10s en 768p en mars 2026. La documentation du toolkit CUDA 12.x couvre les exigences en pilotes si vous configurez une machine d’inférence locale — j’ai épinglé les pilotes pour éviter les ralentissements inattendus.

Erreurs API Courantes et Comment les Corriger

- Dimensions incompatibles : Certains endpoints exigent des dimensions divisibles par 16. Si une tâche échoue instantanément, réduisez au multiple de 16 le plus proche.

- Prompts trop longs : Les hébergements managés tronquent ou expirent sur des charges JSON très longues. Réduisez les listes de styles en phrases plus courtes ; utilisez les négatifs avec parcimonie.

- Dérive de seed entre endpoints : Passer de text-to-video à extend-video ignorait parfois le seed si j’oubliais de le transmettre. Enregistrez le seed et le cfg avec chaque requête.

- Rafales de limite de débit : Échelonnez les soumissions en batch avec 200 à 300 ms de décalage ou utilisez les en-têtes de concurrence recommandés par le fournisseur.

FAQ

Quelle est la durée maximale d’un clip par appel API unique ?

La plupart des hébergements managés plafonnent à 4–10s aux fréquences d’images courantes pour maintenir les files d’attente raisonnables. En auto-hébergement, j’ai poussé jusqu’à ~12–16s avant que la qualité ne baisse. Pour tout ce qui est plus long, enchaînez des extensions avec des seeds partagés.

Quelle est la différence de qualité entre les variantes rapide et standard ?

Notable, mais pas radicale. La variante rapide vous donne 70 à 80 % du rendu en une fraction du temps. Si un clip doit côtoyer des images en prise de vue réelle, finalisez en standard.

Les adaptateurs LoRA peuvent-ils être appliqués via l’API managée ?

Cela dépend de l’hébergeur. Certains exposent des préréglages de modèles ou des adaptateurs de style ; d’autres les gardent en stock. Le hub de modèles Hugging Face est le meilleur endroit pour vérifier les slots d’adaptateurs disponibles et les ajustements fins communautaires avant de s’engager auprès d’un fournisseur. En local, vous avez plus de liberté — mais aussi plus de façons de casser les choses.

Qu’en est-il de l’utilisation de plusieurs modalités avec une seule clé API ?

La plupart des plateformes multi-modèles facturent par crédit et couvrent les endpoints image et vidéo sous la même clé. Vaut la peine de vérifier la page de tarification du fournisseur avant de commencer — la spécification OpenAPI est une référence utile pour comprendre comment une documentation API bien structurée doit présenter la couverture des endpoints et le comportement de facturation.

Une Note sur les Standards de Qualité Vidéo

Une chose à garder à l’esprit : « haute qualité » signifie des choses différentes selon les contextes. Pour du b-roll destiné aux réseaux sociaux, le mode rapide est souvent suffisant. Pour tout ce qui est monté avec du matériel de diffusion ou cinématographique, il est utile de comprendre quels codecs et quelle science des couleurs le rendu final exige. La bibliothèque de standards SMPTE est une lecture austère, mais les spécifications de base pour la fréquence d’images, la profondeur de bits et l’espace colorimétrique sont pertinentes si vous confiez des clips à un coloriste ou à une maison de post-production.

Je terminerai par une petite note : plus je traitais ces endpoints comme les parties d’un système — discipline du seed, courtes exécutions, langage de caméra stable — moins je me débattais avec eux ensuite. Ce n’est pas de la magie. Mais quelques règles simples ont rendu le travail plus léger.

Articles Précédents :

- Obtenez un démarrage rapide étape par étape pour intégrer WAN 2.7 dans votre flux de travail API

- Comparez WAN 2.7 vs WAN 2.6 pour comprendre les véritables compromis de mise à niveau

- Découvrez comment l’édition vidéo basée sur les instructions fonctionne dans de vrais pipelines de production

- Voyez comment le contrôle de la première et dernière image améliore la cohérence de la génération vidéo

- Explorez comment les upscalers vidéo IA améliorent la qualité de sortie après la génération