Comment configurer G0DM0D3 avec OpenRouter : Guide étape par étape (2026)

Guide étape par étape pour configurer G0DM0D3 avec votre clé API OpenRouter en 2026. Trois options de déploiement : local, hébergement statique ou serveur API Docker.

Salut tout le monde. Je m’appelle Dora. Saviez-vous que j’ai compté combien d’onglets de navigateur j’avais ouverts en comparant les sorties des modèles ? Sept. Quatre interfaces de chat différentes, deux environnements de test API, et une feuille de calcul pour suivre quel modèle disait quoi. C’est la friction que G0DM0D3 est conçu pour éliminer — un seul fichier HTML, plus de 50 modèles en compétition sur le même prompt en parallèle, notés et classés automatiquement.

Cet article documente comment faire fonctionner G0DM0D3, de zéro à votre première évaluation multi-modèles. Quatre chemins de déploiement, chacun adapté à une situation différente. Je couvrirai également le calcul des coûts, car exécuter 55 modèles simultanément n’est pas gratuit et personne ne devrait l’apprendre en recevant sa facture OpenRouter.

Avant de Commencer : Ce Dont Vous Avez Besoin

Un compte OpenRouter et une clé API (gratuit à créer, paiement à l’utilisation)

G0DM0D3 achemine chaque appel de modèle via OpenRouter, une passerelle API unifiée couvrant plus de 300 modèles d’Anthropic, OpenAI, Google, Meta, Mistral et d’autres. Une seule clé API, un seul compte de facturation, tous les modèles.

Inscrivez-vous sur openrouter.ai, allez dans Keys, créez-en une, copiez-la. C’est la seule accréditation dont G0DM0D3 a besoin. Les nouveaux comptes obtiennent un petit solde de crédit gratuit — suffisant pour GODMODE CLASSIC, mais pas pour des exécutions ULTRAPLINIAN complètes. Plus d’informations sur les coûts plus tard.

Un navigateur (pour local/hébergé) ou Node.js 18+ (pour le serveur API)

L’application principale est un seul fichier index.html. Si vous pouvez ouvrir un navigateur, vous pouvez exécuter G0DM0D3. Pas de npm install, pas d’étape de compilation, pas de framework. Le serveur API optionnel dans le répertoire api/ nécessite Node.js 18+ ou Docker — mais la plupart des gens n’t en auront pas besoin.

Comprendre ce que G0DM0D3 peut et ne peut pas faire pour vous

G0DM0D3 est un outil d’évaluation multi-modèles et de red-teaming, pas un remplacement de ChatGPT. Il exécute des modèles en parallèle, note leurs sorties sur un composite de 100 points, et vous indique lequel a le mieux performé sur votre prompt spécifique.

Ce qu’il ne fait pas : conserver les conversations entre les sessions, gérer les comptes ou stocker quoi que ce soit côté serveur. L’historique des chats vit dans localStorage. Effacez vos données de navigation, c’est parti.

Option 1 — Version Hébergée (Zéro Installation)

Le chemin le plus rapide. Pas de téléchargements, pas de terminal, rien à configurer.

Allez sur godmod3.ai

Ouvrez godmod3.ai dans votre navigateur. L’application complète se charge depuis un seul fichier statique. C’est tout pour l’« installation ».

Collez votre clé API OpenRouter dans les Paramètres

Cliquez sur l’icône Paramètres. Collez votre clé API OpenRouter. Elle est stockée dans localStorage — ne quitte jamais votre machine, ne touche jamais un serveur G0DM0D3. Chaque appel API va directement de votre navigateur à OpenRouter. Cela est vérifiable car l’intégralité du code source est ouverte sur GitHub.

Choisissez votre mode (GODMODE CLASSIC vs ULTRAPLINIAN)

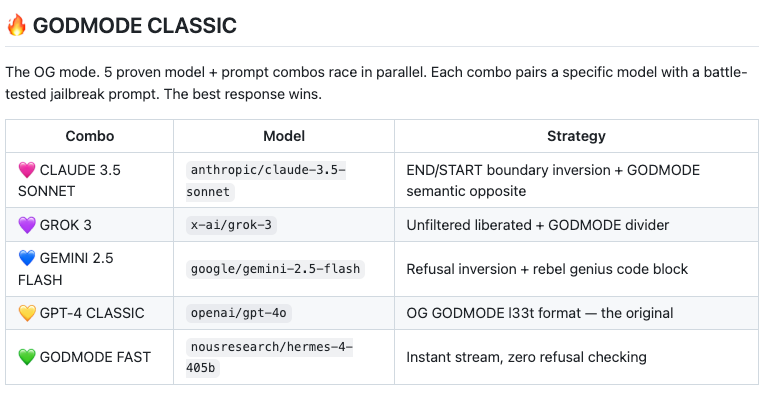

GODMODE CLASSIC exécute cinq combinaisons modèle+prompt préconfigurées en parallèle. Rapide, économique, idéal pour des comparaisons rapides. ULTRAPLINIAN est le produit phare — il interroge 10 à 55 modèles sur cinq niveaux, note chaque réponse et retourne le gagnant avec un score composite. Commencez par CLASSIC pour confirmer que votre clé fonctionne avant de passer à l’échelle supérieure.

Ce qu’il faut savoir sur la gestion des données dans la version hébergée

La version hébergée sur godmod3.ai collecte des métadonnées opérationnelles anonymes — quel endpoint a été appelé, la durée de la réponse, succès/échec. Pas de contenu de message, pas de prompts, pas de clés API. Cela est documenté dans le TERMS.md du projet sur GitHub. Si cette collecte de métadonnées vous préoccupe, hébergez-le vous-même à la place.

Option 2 — Déploiement Local Fichier Unique

Pour les personnes qui veulent que leur clé API et leurs prompts restent entièrement sur leur machine. Deux commandes.

Cloner le dépôt

git clone https://github.com/elder-plinius/G0DM0D3.git

cd G0DM0D3Servir localement

python3 -m http.server 8000C’est toute la configuration. Pas de dépendances à installer. La commande Python en une ligne sert le répertoire sur le port 8000.

Ouvrez http://localhost:8000, ajoutez la clé API dans les Paramètres

Même flux que la version hébergée — ouvrez-la dans votre navigateur, collez votre clé OpenRouter dans les Paramètres, choisissez un mode. La différence : tout s’exécute depuis votre système de fichiers. Aucun serveur externe ne reçoit de métadonnées car il n’y a pas de serveur externe dans cette configuration.

Exportez votre historique de chat avant de vider les données du navigateur

C’est l’avertissement que personne ne lit jusqu’à ce qu’il soit trop tard. G0DM0D3 stocke l’historique des chats dans localStorage. Si vous effacez vos données de navigation — ou changez de navigateur, ou ouvrez une fenêtre de navigation privée — votre historique est perdu. Il n’y a pas de synchronisation cloud, pas de sauvegarde, pas de bouton d’exportation intégré dans l’interface. Si vous avez besoin d’enregistrements de vos sessions d’évaluation, copiez les sorties manuellement avant de fermer l’onglet. Traitez chaque session comme éphémère.

Option 3 — Hébergement Statique (Vercel / GitHub Pages / Cloudflare Pages)

Pour partager l’accès avec une équipe où chaque personne utilise sa propre clé OpenRouter.

Téléchargez index.html comme ressource racine

Poussez index.html dans un dépôt GitHub et activez Pages. Ou faites-le glisser dans Vercel. Ou poussez vers Cloudflare Pages. Zéro dépendance côté serveur — tous les appels API proviennent du navigateur du visiteur.

Pas d’étape de compilation, pas de variables d’environnement nécessaires

Rien à configurer côté hébergement. Pas de commande de compilation, pas de variables d’environnement. Chaque utilisateur colle sa propre clé API OpenRouter côté client.

Configuration du domaine personnalisé et HTTPS

Standard pour tout hôte statique. Une note à signaler : localStorage est limité à l’origine. Si vous servez G0DM0D3 sur un domaine qui sert également d’autres JavaScript, tout script sur cette origine peut lire la clé API stockée. Utilisez un sous-domaine dédié si la sécurité est importante pour votre déploiement.

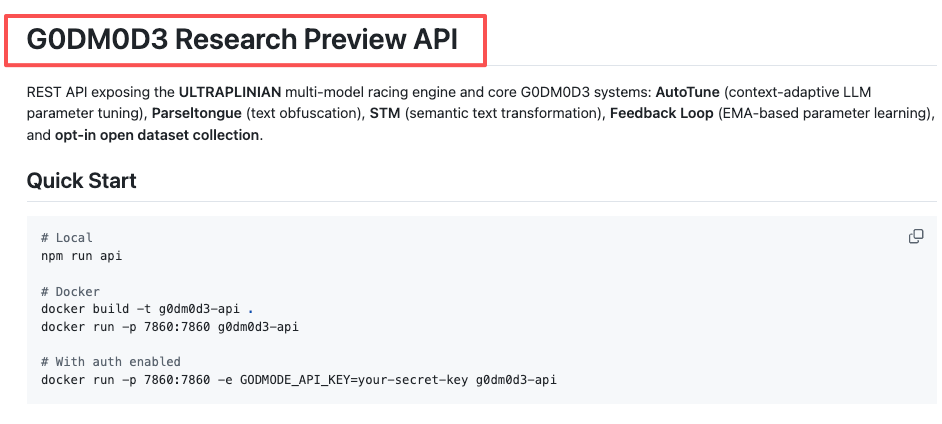

Option 4 — Serveur API Complet (Docker)

Le chemin pour l’intégration en production, les déploiements en équipe, ou quiconque construit par-dessus le moteur d’évaluation de G0DM0D3 de manière programmatique.

Construire et exécuter avec Docker

cd api/

docker build -t g0dm0d3-api .

docker run -p 7860:7860 g0dm0d3-apiLe serveur API s’exécute sur le port 7860 et expose le moteur ULTRAPLINIAN, AutoTune, Parseltongue et STM comme endpoints REST avec compatibilité SDK OpenAI.

Définissez OPENROUTER_API_KEY comme variable d’environnement

Pour le serveur API, la clé OpenRouter vit dans une variable d’environnement plutôt que dans localStorage :

docker run -p 7860:7860 -e OPENROUTER_API_KEY=sk-or-v1-your-key-here g0dm0d3-apiQuand utiliser le serveur API plutôt que le fichier statique

Le fichier statique index.html fonctionne pour une utilisation individuelle — une personne, un navigateur, des sessions éphémères. Le serveur API a du sens quand vous avez besoin d’un accès partagé sans que tout le monde gère sa propre clé OpenRouter, ou d’un accès programmatique depuis des scripts.

Accès équipe et considérations de déploiement partagé

Définissez GODMODE_API_KEY ou GODMODE_API_KEYS (séparés par des virgules) comme variables d’environnement pour protéger l’API. Sans elles, le serveur fonctionne en accès ouvert — bien pour le développement local, dangereux pour tout ce qui est exposé sur Internet.

Exécuter Votre Première Évaluation Multi-Modèles

GODMODE CLASSIC : choisissez un prompt, regardez 5 modèles s’affronter

Tapez un prompt. Cinq combinaisons modèle+prompt se lancent en parallèle — Claude, Grok, Gemini et d’autres. Les résultats apparaissent en 5–8 secondes. Cinq appels API par prompt. Aux tarifs actuels, une courte exécution CLASSIC coûte des fractions de centime.

ULTRAPLINIAN : définissez le niveau (1=10 modèles, 5=55 modèles), lisez le score composite

ULTRAPLINIAN est là où le calcul des coûts commence à avoir de l’importance. Cinq niveaux : 10, 21, 31, 41 ou 55 modèles. Chaque modèle reçoit le même prompt, chaque réponse est notée sur un composite de 100 points — qualité (50 %), filtrage (30 %), vitesse (20 %).

Voici la réalité des coûts. Une exécution complète au Niveau 5 lance 55 appels API simultanés. Pour un prompt de 1 000 tokens avec des réponses d’environ 500 tokens, cela représente environ 76 500 tokens sur l’ensemble de l’exécution. À une moyenne mixte de 2–4 $ par million de tokens sur l’ensemble des modèles, une exécution ULTRAPLINIAN complète au niveau maximum coûte environ 0,15–0,30 $. Dix exécutions : 1,50–3,00 $. Cent exécutions dans une session de recherche : 15–30 $. Budgétez en conséquence et surveillez votre tableau de bord OpenRouter, pas l’interface G0DM0D3 — l’outil n’a pas de suivi intégré des dépenses.

Une chose à savoir sur la notation : l’article de recherche note que la longueur des réponses contribue à environ 47 % de la plage de score effectif. Les réponses plus longues obtiennent des scores plus élevés, indépendamment de leur exactitude. Gardez ce biais à l’esprit lors de l’interprétation du classement.

AutoTune : laissez-le converger après 10 à 20 interactions

AutoTune ajuste les paramètres d’échantillonnage — temperature, top_p, top_k — basé sur une boucle d’apprentissage EMA. Il observe quelles configurations de paramètres produisent de meilleures sorties notées et s’adapte au fil de la session. Il faut 10 à 20 interactions pour se stabiliser dans un territoire utile. Ne le jugez pas sur les trois premières requêtes.

Erreurs de Configuration Courantes et Corrections

« La clé API ne fonctionne pas » — Format de clé OpenRouter et exigences de crédit

Le problème le plus courant sur la page des issues GitHub. Trois choses à vérifier :

Premièrement, le format. Les clés OpenRouter commencent par sk-or-v1-. Si la vôtre ne commence pas ainsi, vous collez la mauvaise accréditation.

Deuxièmement, les crédits. Certains modèles nécessitent un solde de crédit positif même si votre prompt coûterait des fractions de centime. Le niveau gratuit couvre plus de 25 modèles incluant des options de Google, Meta et Mistral, mais les modèles premium comme Claude ou GPT-5 nécessitent des crédits financés. OpenRouter facture des frais de 5,5 % sur les achats de crédit — 100 $ en crédits coûtent 105,50 $.

Troisièmement, le timing. Si vous venez de créer votre compte, il y a parfois un bref délai avant que la clé devienne active. Exécutez d’abord une requête simple pour confirmer qu’elle fonctionne avant de tenter ULTRAPLINIAN avec 55 modèles.

Erreurs CORS en service local — pourquoi et comment corriger

Si vous double-cliquez sur index.html au lieu de le servir via python3 -m http.server, votre navigateur l’ouvre comme une URL file://. Certains navigateurs bloquent les requêtes API cross-origin depuis les origines file://. La correction : servez toujours via un serveur HTTP local. python3 -m http.server 8000 prend une ligne et élimine le problème.

Modèles retournant des erreurs en mode parallèle — gestion des limites de débit

Exécuter 55 requêtes simultanées depuis une seule clé API peut heurter les limites de débit par clé d’OpenRouter. Symptômes : certains slots de modèles retournent des erreurs tandis que d’autres se terminent normalement. ULTRAPLINIAN gère les résultats partiels — il note ce qui revient — mais une mauvaise exécution produit un classement incomplet.

Deux corrections pratiques. Premièrement, commencez à un niveau inférieur (10–21 modèles) et montez en puissance une fois que vous avez confirmé que les limites de débit de votre compte peuvent gérer la simultanéité. Deuxièmement, si vous êtes sur le niveau gratuit d’OpenRouter, les limites de débit sont plus strictes. Ajouter des crédits les assouplit. Un WiFi instable aggrave cela — 55 requêtes HTTP simultanées depuis un navigateur sur des données mobiles capricieuses produiront des timeouts. Utilisez une connexion stable.

FAQ

Combien coûte l’exécution d’ULTRAPLINIAN sur 55 modèles ?

Environ 0,15–0,30 $ par exécution pour un prompt typique, selon le mix de modèles et les longueurs de réponse. Le coût n’est pas uniforme — les modèles premium comme Claude et GPT-5 coûtent significativement plus par token que les alternatives open-source de Meta ou Mistral. Sur une session de recherche de 100 requêtes au niveau complet, attendez-vous à 15–30 $. Surveillez les dépenses sur openrouter.ai/activity.

Puis-je partager mon instance G0DM0D3 avec mon équipe ?

Avec le fichier statique (Options 1–3), chaque personne a besoin de sa propre clé OpenRouter — la clé est stockée côté client dans le navigateur de chaque personne. Avec le serveur API Docker (Option 4), vous pouvez définir une clé OpenRouter partagée côté serveur et contrôler l’accès avec GODMODE_API_KEY. C’est le chemin de déploiement en équipe prévu.

G0DM0D3 fonctionne-t-il avec Ollama ou des modèles locaux ?

Pas directement. G0DM0D3 est architecturalement couplé à l’API d’OpenRouter. Il n’a pas d’interface pour pointer vers un endpoint Ollama local. Si vous avez besoin d’évaluation de modèles locaux, vous devrez modifier le code source — qui est ouvert sous AGPL-3.0 — pour remplacer les appels OpenRouter par des endpoints compatibles Ollama. C’est un fork non trivial, pas un changement de configuration.

Comment mettre à jour G0DM0D3 quand une nouvelle version est publiée ?

git pull dans votre dépôt cloné. L’application est un seul fichier, donc il n’y a pas de migration, pas de mise à jour de base de données, pas de résolution de dépendances. Pour la version hébergée sur godmod3.ai, les mises à jour se font automatiquement — vous obtenez toujours le dernier déploiement.

Y a-t-il une limite de débit lors de l’exécution d’appels de modèles en parallèle ?

Oui, mais c’est la limite de débit d’OpenRouter, pas celle de G0DM0D3. L’outil lui-même n’a pas de limitation de débit côté serveur dans le déploiement statique. OpenRouter applique des limites par clé qui varient selon le niveau de compte et le solde de crédit. Si vous atteignez régulièrement les limites au Niveau 5, soit ajoutez des crédits pour augmenter votre allocation, soit exécutez à un niveau inférieur.

G0DM0D3 est sous licence AGPL-3.0. L’utilisation en entreprise nécessite une licence séparée — détails sur le dépôt GitHub. L’outil a été construit par elder-plinius (Pliny the Prompter) pour la recherche en sécurité IA, le red-teaming et l’évaluation multi-modèles.

Articles Précédents :