Comment utiliser Seedance 2.0 via API : Jobs asynchrones, nouvelles tentatives et gestion des résultats

Modèles de production pour les API Seedance 2.0 : cycle de vie des jobs asynchrones, nouvelles tentatives, idempotence, observabilité et garde-fous de coût.

Vous souhaitez créer des vidéos cinématographiques comme Seedance 2.0 ? Essayez le WaveSpeed Cinematic Video Generator pour créer dès maintenant des vidéos cinématographiques de qualité Seedance 2.0.

Bonjour à tous. Dora arrive. Vous savez, je me retrouvais sans cesse à relancer une tâche longue durée dans l’API Seedance 2.0 et à basculer d’onglet en onglet pour vérifier si elle était terminée. Pas un bug, juste une petite friction persistante. Sur quelques jours, j’ai exécuté une poignée de vraies tâches (transformations de contenu et extractions par lot) en prêtant attention aux éléments qui changeaient réellement le ressenti de ma journée.

Ce qui suit est l’ensemble des patterns qui ont rendu le travail plus stable : comment je soumets, suis et collecte les résultats ; comment je structure les entrées ; ce que je retente (et ce que je ne retente pas) ; et les garde-fous de base qui m’ont évité de trébucher sur les clés, les coûts et les journaux. Si vous jongulez déjà avec des API, cela vous semblera familier — c’est voulu.

Cycle de vie d’un job API (soumission → statut → résultat)

J’ai essayé de garder l’API Seedance 2.0 simple dans ma tête : trois opérations, soumettre, vérifier le statut, récupérer le résultat. Quand j’ai réellement adopté cette approche, la charge mentale a diminué.

Soumission : j’envoie un job avec un payload clair et autonome, accompagné d’une clé d’idempotence générée côté client (j’y reviendrai plus tard). Je note, dans les commentaires du code pour moi-même, ce que je considère comme « terminé ». Pas une question philosophique : juste la forme exacte du succès (ex. : JSON avec les champs X, Y, Z ; un checksum correspondant ; pas de résultats partiels).

Statut : j’ai arrêté de considérer le statut comme une seule chose. Je le classe en catégories :

- En cours (interrogation sûre)

- Bloqué (nécessite mon intervention, généralement une mauvaise entrée)

- Terminal (succès ou échec permanent)

Cette simple distinction a changé ma façon de vérifier. Si c’est en cours, je ralentis et j’attends. Si c’est bloqué, je corrige les entrées. Si c’est terminal, je passe à la suite. Je n’interprète pas à l’excès les libellés intermédiaires.

Résultat : quand un job se termine, je récupère les sorties dans un format fiable, généralement du JSON avec un schéma stable et un simple hash de contenu. Si l’API supporte les webhooks, je maintiens quand même le polling en secours. Les webhooks sont excellents jusqu’à ce qu’une règle de pare-feu ou un incident de file d’attente en avale un. Le polling est ennuyeux et fiable.

Deux petites observations de terrain :

- Les premières exécutions n’ont pas gagné de temps. Après quelques itérations, j’ai remarqué qu’elles économisaient de l’attention. Moins de vérifications « est-ce que c’est fini ? », plus de « je le verrai quand ce sera vraiment terminé ».

- J’évite d’enchaîner des jobs au sein de l’API si je peux l’éviter. Un job, un résultat. Si j’ai besoin d’une logique de ventilation ou de dépendances, je la garde dans mon système. Cela rend le débogage et les nouvelles tentatives plus propres.

Si vous construisez autour de ça, une machine à états simple est utile. Rien de dramatique, juste quelques états énumérés et des transitions claires. Ce n’est pas élaboré, mais cela absorbe les cas limites sans devenir du code spaghetti.

Conception du payload (texte + packaging des références)

La plupart de mes frictions venaient des payloads. Pas des échecs, juste des incompatibilités. Quand j’ai un peu structuré la chose, tout s’est mis en place.

J’ai arrêté d’envoyer de gros blocs de texte inline quand ce n’était pas nécessaire. À la place, je :

- Envoie des instructions textuelles concises et des paramètres inline.

- Passe les artefacts volumineux (documents, médias, sorties précédentes) par référence — URLs signées ou clés d’objet — avec des identifiants versionnés.

Cette séparation a rendu les nouvelles tentatives plus sûres et réduit le churn d’upload. Elle a aussi assaini les journaux : je pouvais voir ce qui avait changé entre les exécutions sans faire défiler des mégaoctets de contenu. Si l’API Seedance 2.0 a besoin à la fois de texte et de références, je les regroupe sous un seul objet « input » avec des noms clairs. Mon moi futur apprécie de ne pas avoir à chercher des champs éparpillés.

Validation des entrées avant soumission

Avant d’envoyer quoi que ce soit, j’effectue trois vérifications localement :

- Forme : le payload correspond-il à mon propre schéma ? Champs obligatoires présents, types corrects, énumérations valides. J’utilise un validateur JSON Schema pour ça.

- Références : les URLs se résolvent-elles et respectent-elles les règles de taille/type ? J’effectue des requêtes HEAD préalables et j’attache la content-length et le checksum quand c’est disponible.

- Cohérence : les paramètres sont-ils compatibles avec le type de job demandé ? Si je dis « résumer », je ne passe pas aussi « full_transcript=true ». C’est bête, mais ça arrive.

Ces vérifications ne font pas disparaître les erreurs : elles les déplacent vers l’endroit le moins coûteux pour les corriger — avant les sauts réseau, avant les limites de débit, avant de lire des journaux à minuit.

Patterns de fiabilité

Après une semaine d’utilisation régulière, la plupart de mes maux de tête venaient de nouvelles tentatives que je ne pouvais pas raisonner. Le remède était des patterns simples que je pouvais expliquer à un collègue en une phrase.

Je classe les échecs en deux catégories :

- Sûr à retenter (problèmes réseau transitoires, erreurs 5xx, timeouts avant que le serveur commence à travailler)

- Ne pas retenter aveuglément (erreurs de validation, quota dépassé, états inconnus)

Une fois que j’ai fait ça, le reste s’est mis en place.

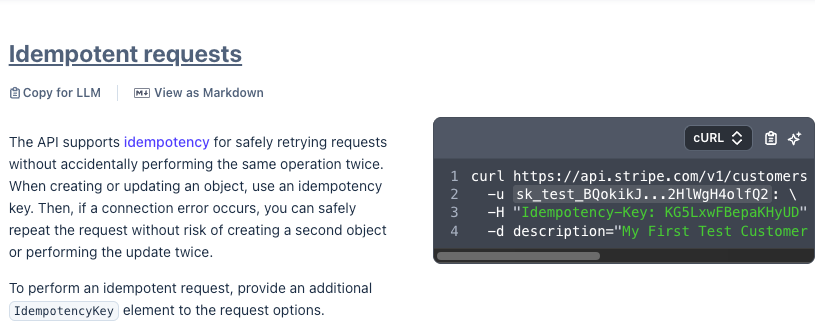

Clés d’idempotence + nouvelles tentatives sûres

J’ajoute une clé d’idempotence unique à chaque soumission de job. Le serveur devrait traiter les répétitions avec la même clé comme la même requête. En pratique, je suppose que je ne sais peut-être pas si une requête a atteint le serveur. Je rends donc les nouvelles tentatives sûres par conception.

Ce qui a aidé :

- Dériver la clé à partir d’entrées stables (ex. : un UUID plus un hash du payload normalisé) pour que les doublons accidentels entrent en collision intentionnellement.

- Stocker la clé et l’effet attendu avec un TTL court de mon côté. Si je perds une réponse, je peux retenter en toute confiance.

- Traiter les opérations non idempotentes (comme « démarrer et facturer ») comme idempotentes à la frontière client. Soit le serveur l’applique, soit j’évite les nouvelles tentatives automatiques.

Pour un bon modèle mental, la façon dont les API de paiement gèrent ça est claire. La documentation de Stripe sur les clés d’idempotence est concise et vaut la peine d’être parcourue, même si vous ne manipulez pas de l’argent.

Timeouts, backoff et plafonds de nouvelles tentatives

Je garde trois chiffres à portée de main : timeout de requête, backoff initial et nombre maximum de tentatives.

Ma configuration par défaut ressemble à ceci :

- Timeouts : conservateurs mais pas avares. Assez longs pour le travail serveur typique, assez courts pour éviter les sockets zombies. Si un job est vraiment long, je préfère un appel de soumission rapide et un polling séparé.

- Backoff : exponentiel avec jitter. Le jitter est important. Sans lui, les nouvelles tentatives synchronisées se comportent comme un petit DDoS.

- Plafonds : limites strictes sur le nombre total de tentatives et le temps d’horloge murale total par job. Après avoir atteint un plafond, je remonte une erreur conviviale et je m’arrête. Pas de boucle silencieuse.

En pratique, ces chiffres ont changé deux fois : une fois après le premier jour (trop agressif), et une fois après avoir observé un pattern de courtes pointes autour de l’heure pile (j’ai ajouté plus de jitter). Rien de sophistiqué. Ça a juste rendu le système plus calme.

Observabilité (journaux, catégories d’échecs, surveillance des coûts)

Je ne cherche pas à avoir un traçage complet sauf si j’en ai besoin. Pour le travail avec l’API Seedance 2.0, trois vues ont suffi :

- Journaux de requêtes avec IDs de corrélation : je tague chaque appel de soumission, de statut et de résultat avec le même ID de corrélation. Quand quelque chose déraille, je peux suivre un job de bout en bout sans conjectures. Les conventions sémantiques d’OpenTelemetry sont un guide utile si vous configurez ça de zéro.

- Catégories d’échecs : je regroupe les échecs par cause (validation, auth, quota, timeout, 5xx, incompatibilité de schéma). Les catégories rendent les tendances visibles. Si « quota » devient soudainement préoccupant le lundi, je planifie en conséquence plutôt que de lutter contre l’incendie.

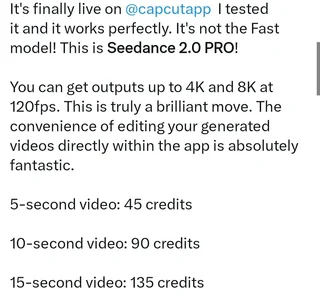

- Lens des coûts : je journalise le coût estimé par job — entrées, sorties, nouvelles tentatives incluses — et je le consolide chaque semaine. L’objectif n’est pas la précision : c’est de ressentir la pente. Une vue simple en percentiles (P50, P95) montre si quelques valeurs aberrantes grèvent silencieusement le budget.

Une petite note sur les alertes : je les garde ennuyeuses. Pas de feux d’artifice, juste des seuils qui correspondent à des actions : « catégorie d’échecs > X pendant Y minutes » ou « P95 des coûts augmente > Z% semaine sur semaine ». Je préfère remarquer tard que vivre dans les faux positifs. L’énergie économisée est rentabilisée ailleurs.

Bases de sécurité et conformité (clés, gestion du contenu utilisateur)

Rien de sophistiqué ici, et c’est un peu le but. Les bases font l’essentiel du travail.

- Clés : je garde les clés API hors du code et je les fais tourner selon un calendrier. Des clés par environnement, le moindre privilège si les portées existent, et pas de partage entre équipes. Si l’API supporte les jetons de courte durée, je les utilise.

- Contenu utilisateur : je ne journalise pas les données brutes des utilisateurs. Je journalise des hashes, des tailles et des références. Si j’ai besoin d’échantillons pour le débogage, je les expurge ou les réduis d’abord, avec une durée de conservation clairement définie.

- Gestion des données : je tague chaque job avec un ID de tenant ou d’utilisateur et je transporte ce tag dans les journaux et le stockage. C’est banal, mais ça évite que les vérifications d’accès ne deviennent du folklore.

- Stockage : les résultats atterrissent dans un bucket ou une base de données avec chiffrement côté serveur et ACL strictes. Les pistes d’audit comptent plus que l’ingéniosité ici.

- Posture de conformité : si une équipe a besoin de confort SOC 2 ou RGPD, je documente exactement ce qui va où, qui peut le voir et pour combien de temps. Pas de promesses dans l’obscurité. En cas de doute, je consulte la page sécurité du fournisseur et les conditions de traitement des données plutôt que de supposer.

Mon test est simple : pourrais-je expliquer cette configuration à un collègue soucieux de la vie privée sans agiter les mains ? Si non, je ne l’ai pas suffisamment simplifiée.

Une dernière note

Je suis venu en cherchant de la vitesse. Ce que j’ai obtenu, c’est de la stabilité. L’API Seedance 2.0 n’a pas supprimé d’étapes : elle les a rendues prévisibles. C’était suffisant pour rendre le travail plus léger. Je surveille encore l’évolution des coûts sur un mois, et si mes catégories tiennent face à de nouveaux types de jobs. Des questions tranquilles, mais bonnes. Vous en pensez quoi ?

Vous souhaitez créer des vidéos cinématographiques comme Seedance 2.0 ? Essayez le WaveSpeed Cinematic Video Generator pour créer dès maintenant des vidéos cinématographiques de qualité Seedance 2.0.