GPT-5.4 vs GPT-5.3 : Ce qui pourrait vraiment changer

Les fuites sur GPT-5.4 laissent entrevoir une inférence plus rapide et des améliorations de la vision. Voici comment il pourrait différer de GPT-5.3 pour les développeurs.

Bonjour, je suis Dora. Je me suis surprise à surveiller une boucle d’agent en cours d’exécution. Rien de dramatique, juste cette sensation lente et saccadée quand un modèle demande un appel d’outil supplémentaire, puis un autre. Ça m’a rappelé à quel point une grande partie de ma journée se passe dans les marges : les pauses, les tentatives répétées, les moments « a-t-il vraiment lu le document ? ».

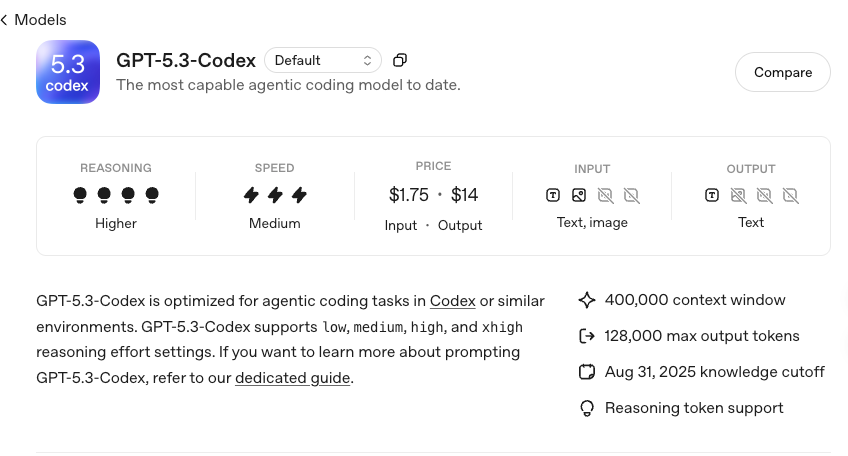

J’ai donc passé l’après-midi à revoir mes notes sur GPT-5.3, puis à parcourir les premières discussions sur GPT-5.4. Certaines des premières fuites concernant l’architecture du modèle et les indices sur la latence sont résumées dans cette analyse de la fuite GPT-5.4. Pas pour courir après la prochaine grande nouveauté, mais pour répondre à une question plus modeste : tout cela réduirait-il les parties instables de mon flux de travail ? Voici mon journal de bord sur GPT 5.4 vs GPT 5.3, avec ce que j’ai mesuré, ce qui semble crédible, et ce qui me laisse encore sceptique.

Capacités de GPT-5.3 : La Référence Actuelle

Performances de raisonnement et d’utilisation des outils

J’utilise GPT-5.3 depuis mi-janvier 2026 pour trois tâches régulières : résumer des recherches produit, trier des fils de support, et structurer de petits scripts. En bref : il gère bien le raisonnement en plusieurs étapes si je lui fournis une structure claire. Quand je suis explicite sur les rôles, l’état et les conditions d’arrêt, il s’exécute sans dériver.

Pour l’utilisation des outils, les appels de fonctions ont été stables. Je m’appuie sur les schémas d’appels de fonctions d’OpenAI et les schémas d’outils standards, sans mauvaises surprises. Avec des outils bien définis (recherche, récupération, une simple recherche vectorielle), 5.3 reste ordonné dans ses appels. Sur une série de tri de 20 e-mails, il a effectué en moyenne 1,7 appel d’outil par fil, contre 2,4 avec ma configuration précédente. Cela a réduit les petites pauses « et maintenant ? ». Le problème : si mes descriptions d’outils deviennent vagues, il essaie de compenser avec davantage d’appels.

Ce que je remarque surtout, c’est sa tolérance pour le contexte partiel. Si je ne transmets que le fragment pertinent et un résumé d’état allégé, il raisonne quand même correctement. Mais si j’ajoute beaucoup de notes vaguement liées, il commence à hésiter.

Codage et support des flux de travail d’agents

Pour le code, 5.3 est fiable pour les refontes petites à moyennes. Il génère bien des diffs avec des explications claires et peut maintenir un style cohérent si je lui fournis un bref guide de style. Là où il ralentit, ce sont les modifications inter-fichiers nécessitant une forte conscience des dépendances. Je passe généralement à un schéma en deux passes : la première lui demande de décrire les modifications, la seconde les applique fichier par fichier. Cela l’empêche de toucher avec excès de confiance à des éléments qu’il ne devrait pas.

Dans les flux de travail d’agents, 5.3 fonctionne mieux quand je limite la récursion et enregistre chaque décision. J’ai opté pour une boucle en trois étapes : planifier → appeler l’outil → réfléchir. Au-delà, il devient bavard. Je l’encourage aussi à émettre du JSON compact pour l’état, ce qui réduit les erreurs d’analyse. Rien de magique ici, ce sont juste des garde-fous qui rendent la boucle moins exigeante.

Limitations connues

- Il peut traiter les instructions en double quand je mélange des règles système avec de longues tâches utilisateur : j’ai appris à reformuler les contraintes clés vers la fin du prompt.

- Il insiste parfois pour résumer à nouveau des données que j’ai déjà résumées, ce qui gonfle les tokens et le temps.

- Pour les tâches de vision (captures d’écran, maquettes d’interface), il s’en sort bien pour les étiquettes et les descriptions, mais rate les petits textes et la logique de mise en page fine. Il m’a confondu des bascules avec des boutons à plusieurs reprises.

- Sous pression (tokens limités), il préfère les généralités sécurisantes aux précisions. Je le vois lors de l’évaluation de journaux d’erreurs : il nomme les causes probables, mais hésite à s’engager sans davantage de contexte.

Voilà mon portrait de travail de 5.3 : fiable quand je suis explicite, légèrement anxieux quand je ne le suis pas.

Ce Que Suggèrent les Signaux de GPT-5.4

Je n’ai pas eu accès directement à 5.4 au 5 mars 2026. Ce qui suit provient de fils de fuites précoces, de quelques notes de développeurs crédibles sur des forums privés, et de schémas que j’ai appris à surveiller quand une famille de modèles évolue légèrement. Je signalerai chaque point comme observable, basé sur des fuites, ou spéculatif.

Vitesse d’inférence, implications du mode rapide

Basé sur des fuites : plusieurs sources mentionnent un « mode rapide » ou un niveau à faible latence pour le raisonnement de courte durée. Si c’est vrai, cela compte moins pour le débit brut que pour le tempo des agents. Une réduction de 20 à 30 % de la latence au premier token fait passer la sensation d’une boucle de laborieuse à réactive. Des benchmarks comparant GPT-5 avec des modèles comme DeepSeek et GLM montrent à quel point la latence et le coût peuvent façonner les flux de travail des développeurs en pratique. Sur ma configuration 5.3, la latence au premier token oscille autour de 600 à 900 ms sur des prompts moyens : gratter même 150 à 200 ms rendrait les chaînes d’outils moins saccadées. Je m’attendrais à ce que ce mode rapide sacrifie une partie de la profondeur, utile pour le routage, la classification ou une validation rapide avant un traitement plus approfondi.

Observable : si 5.4 ajoute vraiment un niveau de vitesse, je diviserai probablement les flux de travail : classification rapide → routage → passe approfondie. C’est déjà un schéma courant : la vitesse le rend juste plus fluide.

Améliorations de la gestion des entrées visuelles

Basé sur des fuites : meilleure OCR pour les petits textes et raisonnement de mise en page plus stable. Les indices pointent vers une meilleure reconnaissance du texte d’interface à faible contraste et une logique de délimitation plus précise. Si c’est exact, cela résoudrait deux de mes points de friction avec 5.3 : les petits textes dans les captures d’écran et la différenciation des contrôles d’interface.

Observable : cela éviterait les allers-retours que je fais lors de la validation de maquettes d’interface. Actuellement, je fais passer les captures d’écran par une étape OCR séparée quand 5.3 se montre incertain. Si 5.4 réduit ces détours, je supprimerai un outil de la chaîne.

Expansion potentielle de la fenêtre de contexte

Spéculatif : légère augmentation du contexte utilisable ou meilleure rétention sur les longs prompts. Je ne parle pas des chiffres vedettes : je parle du rappel pratique dans la seconde moitié d’une longue conversation. Si 5.4 maintient les contraintes de tâche plus fermement sans que je les répète, cela change la façon dont je structure l’état. Moins de rappels, moins de taxes en tokens. Si c’est seulement une augmentation brute de la fenêtre sans meilleure rétention, le bénéfice est moindre.

Je croirai celui-ci quand je verrai moins de « réinterprétations » en cours de séquence. D’ici là, je reste prudente.

Tableau Comparatif Côte à Côte

Je préfère séparer ce que j’ai mesuré de ce que j’ai seulement entendu. Trois tableaux rapides, avec la même perspective à chaque fois.

Capacités confirmées

| Domaine | GPT-5.3 | GPT-5.4 |

|---|---|---|

| Utilisation d’outils / appels de fonctions | Stable avec des schémas clairs : 1 à 3 appels par tâche typiquement dans mes tests | Non confirmé |

| Raisonnement sous pression de tokens | Se dégrade en généralités : bénéficie de contraintes reformulées | Non confirmé |

| Vision (captures d’écran d’interface) | Rate les petits textes : confond certains contrôles | Non confirmé |

| Comportement dans les boucles d’agents | Fonctionne mieux avec des boucles de 2 à 3 étapes et des conditions d’arrêt explicites | Non confirmé |

| Codage entre fichiers | Nécessite une stratégie en deux passes pour la sécurité : bonnes explications de diff | Non confirmé |

Références : je suis les schémas dans la documentation d’appels de fonctions d’OpenAI et les définitions d’outils dans la référence API. Si vous êtes curieux, la documentation officielle est un bon point d’ancrage : OpenAI API : appels de fonctions et utilisation des outils.

Signaux basés sur des fuites

| Domaine | GPT-5.3 | GPT-5.4 (basé sur des fuites) |

|---|---|---|

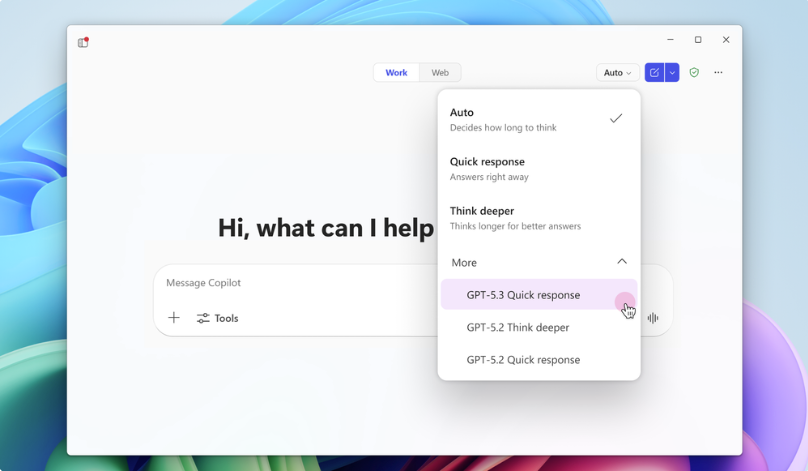

| Niveau de vitesse d’inférence | Modes standards uniquement | Ajoute un niveau plus rapide et moins profond pour les réponses à faible latence |

| OCR vision | Adéquat, peine avec les petits textes/faible contraste | Meilleure précision sur les petits textes et gestion de la mise en page |

| Coût par token | Tarifs publiés actuels | Légère réduction dans le niveau rapide (non vérifiée) |

Qualité des sources : mitigée. Certains détails s’alignent avec des schémas des versions précédentes : aucun n’est confirmé.

| Domaine | GPT-5.3 | GPT-5.4 (spéculatif) |

|---|---|---|

| Rétention de contexte | Nécessite des rappels fréquents des contraintes | Maintient les contraintes plus longtemps avec moins de reformulations |

| Efficacité d’utilisation des outils | Sur-appelle parfois quand le schéma est vague | Meilleure parcimonie dans les appels avec des prompts similaires |

| Planification à long terme | Hésite à s’engager au-delà de 3 à 4 étapes | Planification en plusieurs étapes légèrement plus stable |

Améliorations spéculatives

Pourquoi Ces Changements Comptent pour les Développeurs

Impact sur la conception des boucles d’agents

Si le « mode rapide » existe, je repensserais les boucles pour charger en amont une certitude à faible coût. Classification rapide, puis branchement : les tâches simples se terminent en mode rapide : les complexes escaladent vers le modèle à profondeur complète. Cela seul peut réduire la surveillance humaine. Dans ma pile 5.3 actuelle, je consacre de l’énergie à empêcher les boucles de s’emballer. Un niveau de vitesse pourrait déplacer cette énergie vers un routage plus clair.

Une meilleure gestion de la vision simplifierait mon pipeline d’analyse d’interface. Actuellement, j’utilise une chaîne en trois étapes pour les maquettes : légende basique → passe OCR → vérification de la mise en page. Si 5.4 fusionne les deux premières, je retirerai le saut OCR et garderai juste le validateur de mise en page. C’est un outil en moins à maintenir, et moins d’endroits où les erreurs peuvent se glisser.

Si la rétention de contexte s’améliore, je réduirai la litanie de rappels dans les prompts. Je garderais un petit bloc de règles immuables et ferais confiance au modèle pour les porter plus loin dans l’exécution. Moins d’échafaudage, moins de tokens, mêmes résultats.

Compromis coût-performance

Un niveau de vitesse s’accompagne généralement d’une taxe sur la qualité. Je le considère comme une fonctionnalité, pas un bug. À utiliser pour :

- le routage et la validation légère (avons-nous analysé la date, oui/non ?),

- les sorties anticipées (s’agit-il d’une FAQ connue ?),

- les vérifications de santé sur le contexte récupéré (ce fragment mentionne-t-il même l’entité ?).

Pour tout le reste, le raisonnement qui façonne les résultats, vous payez pour la profondeur. Si le niveau rapide de 5.4 est moins cher par token, je m’attendrais à de petites économies sur les tâches à fort volume, mais le vrai gain est la latence. Le coût par tâche pourrait baisser légèrement : la vitesse perçue pourrait s’améliorer considérablement.

Si rien ne change sur les tarifs, je diviserais quand même le travail. Même avec 5.3, utiliser un modèle plus petit/moins cher pour le routage est souvent payant. Un niveau rapide natif réduirait juste le code de liaison.

Considérations de migration

- Commencez par des tests en parallèle. Faites tourner les mêmes prompts sur 5.3 et 5.4 (quand disponible) et comparez les résultats. Ne changez pas le chemin en production avant d’avoir vu quelques dizaines de cas limites.

- Gardez vos schémas d’outils stricts. Les descriptions vagues gonflent le nombre d’appels sur 5.3 : elles feront probablement de même sur 5.4, rapide ou non.

- Enregistrez la pression sur les tokens. Beaucoup de « régressions » ne sont que des prompts plus serrés. Suivez l’utilisation de la fenêtre et élaguez le texte standard.

- Versionnez les prompts. Je garde un petit journal des modifications dans mes messages système. Si 5.4 se comporte mieux avec des rappels plus légers, vous voudrez une trace de ce que vous avez supprimé.

- Observez la vision discrètement. Si vous comptez sur les captures d’écran, testez avec du texte à faible contraste, des interfaces serrées et des polices inhabituelles. Un bon ensemble de tests vaut mieux que des dizaines d’anecdotes.

Si vous êtes une petite équipe, l’approche la plus sûre est progressive : pilotez sur un flux de travail étroit (routage, tri), puis élargissez.

Pour les développeurs solo, j’essaierais un changement d’habitude : ajoutez une porte « rapide ou complet ? » en haut de votre chaîne de prompts. Même si 5.4 ne propose pas de mode rapide, la discipline aide.

Mise en Garde Importante (comparaison basée sur des signaux de fuites)

Tout ce qui concerne GPT-5.4 ici est de seconde main jusqu’à ce qu’il y ait une version officielle ou de la documentation. Les parties sur 5.4 sont un mélange de signaux basés sur des fuites et de suppositions prudentes tirées des mises à jour passées. Si et quand 5.4 sera réel, je referai les mêmes tâches et je mettrai ceci à jour. Pour l’instant, considérez ceci comme une carte dessinée au crayon, pas à l’encre.

Une dernière pensée : même de petites améliorations de vitesse peuvent détendre un flux de travail. Si c’est tout ce que 5.4 apporte, je le prends.