Date de sortie de GPT-5.4 : Ce que les signaux indiquent

Pas encore de date officielle. Sur la base des schémas de publication d'OpenAI et des récents signaux de fuite, voici la fenêtre de lancement la plus réaliste pour GPT-5.4.

Bonjour à tous ! Je suis Dora. Tout a commencé par un petit détail. J’ai ouvert mes notes la semaine dernière pour mettre à jour un script qui s’appuie sur GPT pour résumer des entretiens utilisateurs. Dans ma boîte de réception : trois messages me demandant si j’avais « déjà basculé vers GPT 5.4. » Je n’avais même pas vu d’annonce. Ce décalage silencieux — l’engouement dans la boîte de réception contre la réalité de la documentation — m’a poussée à faire ce que je fais habituellement : fermer les onglets de prédictions, ouvrir le changelog, et tracer ce qui est réel.

Voici ce que j’ai trouvé, et comment j’envisage une date de sortie de GPT 5.4 en 2026. Pas de drama, juste des signaux qui ont tendance à compter quand on essaie de planifier son travail autour de cibles mouvantes.

Pourquoi il n’y a pas encore de date officielle

Fuite versus annonce officielle

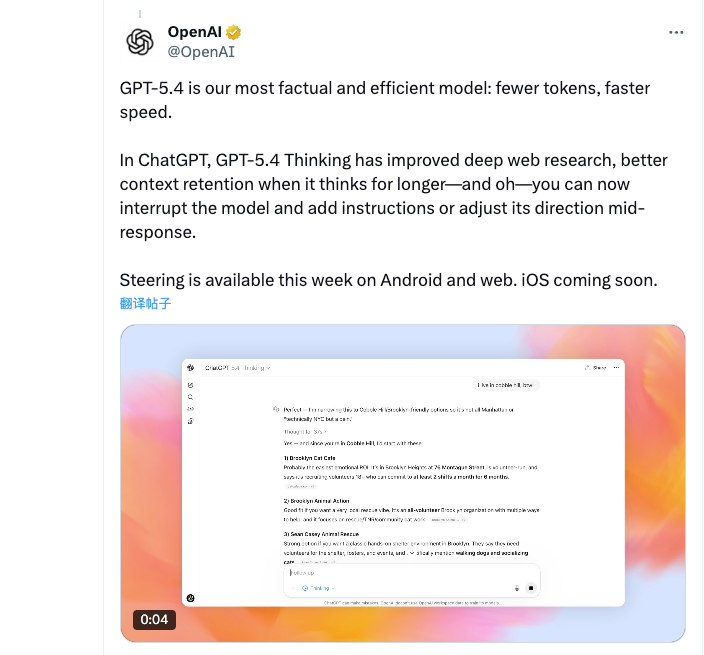

J’ai appris à mes dépens : les fuites mènent à un calendrier chaotique. Des captures d’écran circulent, un nom comme « GPT 5.4 » apparaît dans un menu déroulant, et tout le monde commence à parler comme si c’était disponible mardi prochain. Puis je consulte le blog OpenAI et le changelog de l’API, et c’est le silence. Quand cet écart apparaît, je m’en tiens au côté officiel. Si ce n’est pas dans la documentation, un billet de blog signé, ou surfacé dans la liste des modèles de l’API, je traite ça comme du bruit.

Une règle simple qui m’a évité bien des scrambles : les noms de modèles sur les slides marketing ne sont pas la même chose que des endpoints de production que vous pouvez appeler à grande échelle. Si les achats, la confidentialité ou les limites de débit font partie de votre quotidien, cette différence compte énormément.

Ce que signalent généralement les tests internes

Parfois on voit des indices, des mentions de préversions privées dans des conférences, une référence égarée dans un article d’évaluation, ou une démo partenaire qui semble légèrement… en avance. D’après mon expérience (2024–2026), ces signaux se traduisent généralement par l’une de ces trois chronologies :

- Semaines : Si la documentation ajoute discrètement un indicateur « bêta » et une note de disponibilité limitée, la disponibilité générale est peut-être proche.

- Mois : Si seuls les partenaires y ont accès et qu’il n’existe pas encore d’artefact documentaire, nous sommes probablement à plusieurs cycles.

- Indéfini : S’il apparaît dans des diapositives ou des benchmarks tiers sans citations OpenAI, il ne sera peut-être jamais livré sous ce nom.

Je ne dis pas ça par cynisme. Je préfère simplement construire des plans de projet autour de choses dotées d’URLs et de numéros de version.

Cadence des sorties OpenAI : analyse des tendances

Chronologie de GPT-4 à GPT-5

Regarder en arrière aide. De GPT‑3.5 à GPT‑4, on a observé un grand saut, puis une longue traîne d’itérations. Après GPT‑4, les progrès sont arrivés moins comme un « jour de rupture » unique et plus comme des couches de capacités régulières — vision, améliorations des appels de fonctions, utilisation d’outils, réductions de coût/latence. La leçon pour moi : le numéro de modèle principal est rarement le pivot du quotidien. Ce sont les sorties de support et les gains de fiabilité qui changent mes flux de travail davantage.

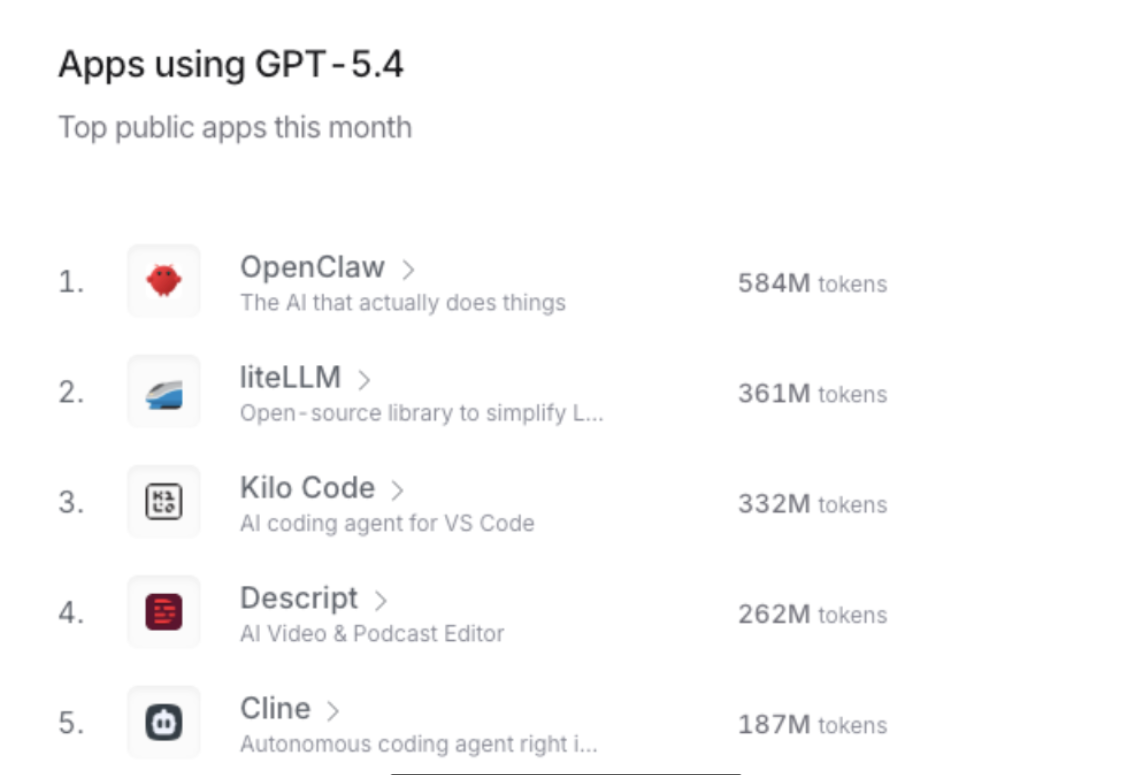

Sorties de versions incrémentielles de GPT-5

OpenAI a tendance à livrer par incréments : sorties de point, variantes spécialisées (orientées raisonnement, optimisées multimodales), et nouvelles options de fenêtre contextuelle. Même quand un label « 5.x » apparaît, il arrive souvent avec :

- De nouvelles limites de tokens par minute ou niveaux de tarification qui permettent (ou bloquent) l’adoption réelle

- Des améliorations d’outillage (sortie structurée, sémantique améliorée des appels de fonctions)

- Des mises à jour de sécurité/évaluation qui modifient ce qui est autorisé par défaut

Donc si un GPT 5.4 apparaît, je m’attends à ce qu’il arrive comme un ensemble — documentation, tableaux de tarification, nudges SDK — et non comme un drapeau solitaire dans le vent. C’est cet ensemble qui fait basculer ma feuille de route.

Comparaison avec la cadence de sortie d’Anthropic et Google

Les concurrents comptent pour le contexte, pas la prédiction. Les benchmarks comparant les modèles GPT avec des alternatives comme DeepSeek et GLM montrent à quelle vitesse les dynamiques de performance et de coût peuvent évoluer selon les générations de modèles. Anthropic et Google ont suivi des arcs similaires : une sortie phare de famille, puis des sous-versions rapides qui renforcent la fiabilité et réduisent la latence. Les noms diffèrent ; le tempo, non. Pour la planification, je suppose :

- Familles majeures : 9 à 18 mois d’intervalle

- Incréments notables : tous les 2 à 4 mois, parfois plus vite quand la sécurité et l’infrastructure s’alignent

Quand les délais glissent, c’est généralement pour les mêmes raisons : seuils d’évaluation, comportement des modèles dans les cas limites, et mise à l’échelle de l’infrastructure. Rien de cela ne transparaît bien dans une capture d’écran, mais c’est ce qui conditionne réellement les dates de sortie.

Scénarios réalistes de fenêtre de lancement

Scénario A, possible sortie au T2 2026

Si vous me forciez à encercler une fenêtre sur le calendrier pour un éventuel GPT 5.4, je choisirais la fin du T2 2026. Non pas à cause d’un secret quelconque, mais parce que la cadence des sorties de points passées ajoutée au rythme actuel des événements partenaires rend cette fenêtre plausible. Quelques éléments que je surveille entre avril et juin :

- Une mention bêta dans le changelog de l’API avec un nom de modèle concret

- Des tableaux de tarification mis à jour dans la documentation la même semaine

- Des références précoces dans les bilans d’évaluation OpenAI renvoyant à des notes méthodologiques

Si cela n’apparaît pas avant mi-juin, je ferais glisser mes attentes vers la fin de l’été.

Scénario B, passer directement à GPT-5.5

OpenAI a déjà sauté une numérotation ordonnée. Si les évaluations internes suggèrent que la mise à niveau est plus qu’incrémentale — disons, des traces de raisonnement nettement meilleures ou une orchestration d’outils — elle pourrait recevoir un label 5.5 à la place. Concrètement, cela signifierait une réécriture plus importante de la documentation, probablement de nouvelles fiches de sécurité, et une note de migration nous indiquant quoi changer dans les prompts et les schémas de fonctions. Pour les équipes, c’est un type de travail différent : moins de basculement de nom de modèle, plus de retests d’hypothèses et de garde-fous.

Facteurs pouvant retarder le lancement

Quand les sorties dérivent, je vois généralement un (ou plusieurs) de ces éléments en arrière-plan :

- Fiabilité sous charge : Excellent en laboratoire, capricieux à grande échelle. Latences irrégulières, timeouts étranges.

- Régressions de sécurité : Comportements limites échouant aux tests red-team, surtout avec l’utilisation d’outils.

- Courbes de coûts : Le modèle est trop coûteux à faire tourner aux niveaux tarifaires prévus ; la tarification nécessite un autre passage.

- Dette documentaire : De nouveaux comportements sans orientation claire pour les développeurs ralentissent un déploiement responsable.

Rien de tout cela n’est glamour. Tout cela constitue de bonnes raisons d’attendre quelques semaines.

Ce que les développeurs doivent surveiller

Annonces pour les développeurs OpenAI

Je garde deux onglets épinglés :

- Le blog officiel OpenAI pour les articles produits.

- Le forum des développeurs quand j’ai besoin de voir ce qui casse ou surprend les gens en premier.

Si une sortie est réelle, les deux s’illuminent en l’espace d’un jour ou deux. Quand seul le forum bourdonne, je reste sur place.

Signaux du changelog de l’API

Le changelog est l’artefact le plus honnête. Quelques indices que je recherche :

- Mises à jour des alias de modèles : quand un alias stable (comme « -latest ») pointe discrètement vers une nouvelle famille

- Tags bêta qui passent en GA sans fanfare

- Lignes de tarification et de limites de débit arrivant le même jour — un signe que l’infrastructure est prête

Je parcours également les notes de version du SDK sur GitHub. Les mainteneurs glissent des lignes petites mais révélatrices dans les bumps de version. Si un client ajoute une constante pour un nouveau nom de modèle, ce n’est généralement pas un accident.

Signaux de la communauté à accès anticipé

Je fais davantage confiance aux tendances qu’aux proclamations. Quand plusieurs développeurs indépendants partagent :

- Des chiffres de latence reproductibles sur une semaine (pas un cas isolé)

- Des diffs de prompts montrant des gains cohérents, pas des victoires triées sur le volet

- Des notes sur les modes d’échec (par exemple, les hallucinations d’appels d’outils en baisse dans des schémas spécifiques)

…alors je commence à migrer de petites charges de travail. Pas avant. Ma règle empirique cette dernière année : deux semaines de signaux stables avant de toucher à la production.

Avertissement (chronologie spéculative)

Il n’existe pas de date de sortie officielle pour GPT 5.4 au moment de la rédaction de cet article. Tout ce qui précède reflète mes propres habitudes de test et la façon dont je planifie autour de cibles mouvantes. Si vos contraintes sont plus strictes — conformité, SLA, ou gros trafic utilisateur — accordez-vous plus de marge.

Si vous vous débattez avec la même question que j’avais la semaine dernière — « Dois-je attendre la 5.4 ? » —, ma réponse discrète est : livrez avec ce qui est fiable, et gardez un œil sur le changelog. Si la 5.4 arrive bientôt, vous le verrez là en premier. Et si elle n’arrive pas, vous n’aurez pas mis votre travail en pause pour une rumeur.

Je garderai l’onglet épinglé. Vous savez lequel.