GPT-5.4 pour les Développeurs : Ce que les Signaux Filtrés Signifient pour les Flux de Travail IA

Mode rapide, améliorations de vision et signaux d'agents de codage — voici ce que les fuites sur GPT-5.4 pourraient signifier pour les constructeurs d'infrastructure IA.

Bonjour, je m’appelle Dora. Je n’avais pas prévu de surveiller GPT‑5.4. Je continuais simplement à buter sur de petits obstacles dans mes workflows d’agents, des pauses assez longues pour que je bascule vers mes e-mails, puis que j’oublie ce que je faisais. Quand un modèle promet un « Mode Rapide » et une vision en pleine résolution, mes oreilles se dressent — non pas parce que je veux la nouveauté, mais parce que je veux moins de ces petites interruptions.

Cet article s’adresse aux développeurs de gpt 5.4 — ou, plus précisément, aux développeurs qui décident s’ils vont construire autour de lui et comment. Je ne suis pas là pour vendre le modèle. Je suis là pour partager là où il pourrait réduire les frictions, là où il ne le fera probablement pas, et ce vers quoi construire pour que le travail d’aujourd’hui survive aux notes de version de demain.

Pourquoi les Développeurs Surveillent GPT-5.4 de Près

Le glissement vers le modèle-en-tant-qu’infrastructure

J’ai remarqué un glissement lent mais réel : les modèles ressemblent moins à des « produits » et davantage à des utilitaires à travers lesquels on achemine des tâches. Il y a un an, je traitais chaque modèle comme une personnalité. Maintenant, je les traite comme des voies sur une autoroute : haute précision, rapide, et bon marché — et j’essaie de fusionner entre elles en douceur.

Si GPT‑5.4 stabilise un schéma à double voie (rapide/lent ou rapide/réflexif), il nous pousse à concevoir des agents autour du routage, pas de paris uniques. Ça semble abstrait jusqu’au moment où vous déboguez une tâche en 12 étapes et réalisez que l’étape 3 nécessite juste une classification rapide, mais que l’étape 8 nécessite une chaîne de pensée soigneuse. J’ai cousu cette logique à la main dans les systèmes actuels. C’est fragile. Si l’infrastructure l’intègre nativement, on a moins d’endroits où trébucher.

Je ne suis pas impressionnée par les numéros de version : ce qui m’intéresse, c’est si une version me permet de consolider des étapes ou de supprimer du code de colle. GPT‑5.4, s’il va dans la direction que les indices suggèrent, pourrait en être un.

Pourquoi les versions incrémentielles comptent

Les petites montées de version semblent ennuyeuses, mais elles évitent aux équipes des reconstructions complètes. Quand les modèles maintiennent des interfaces stables tout en améliorant la latence ou la fidélité visuelle, je n’ai pas besoin de recycler les utilisateurs (ni moi-même). La valeur apparaît dans des endroits comme : moins de tentatives, des prompts plus serrés, des délais d’attente plus courts.

Je surveille les docs de l’API OpenAI et les pages de modèles pour détecter des changements de forme plutôt que des slogans. Si GPT‑5.4 s’intègre dans les endpoints existants avec des valeurs par défaut plus sensées et un comportement système plus clair, c’est une victoire. Moins de rotation de code, des logs plus prévisibles. Et pour quiconque maintient des agents en production, la prévisibilité bat la nouveauté tous les jours.

Mode Rapide — Ce Que Ça Change pour les Workflows d’Agents

Le coût actuel du raisonnement dans les agents multi-étapes

Dans mes exécutions au cours du dernier mois avec les modèles de génération actuelle, un agent multi-étapes typique (planifier → récupérer → appeler des outils → résumer) prend 8 à 15 appels de modèle. Chaque appel coûte deux choses : des tokens et de l’attention. Les tokens, vous pouvez les budgétiser. L’attention, c’est ce qui vous épuise — les petites attentes, les tentatives partielles, les moments où vous vous demandez si c’est bloqué.

Pour moi, une tâche typique de résolution d’outil interne prend en moyenne 20 à 45 secondes de bout en bout. La majeure partie n’est pas du raisonnement lourd : ce sont des vérifications légères et du formatage. Si le Mode Rapide de GPT‑5.4 réduit la latence sur ces étapes légères tout en maintenant une précision suffisante, ça change la forme de l’exécution entière. La longue traîne de petites attentes se réduit. Ça ne semble pas dramatique sur le papier, mais ça se ressent mieux dans le travail quotidien.

Inférence à double mode et logique de routage

Ce que j’observe, c’est si le « Mode Rapide » est juste un modèle plus petit, ou vraiment un modèle associé à un raisonneur à l’intérieur d’une même frontière. Si l’API expose un indice propre — disons un paramètre ou une règle de routage au niveau de l’outil — je peux centraliser la décision : rapide pour la classification, complet pour la synthèse. Plus de bifurcations personnalisées à chaque étape de l’agent.

Dans les tests avec les modèles actuels, j’ai prototypé un comportement à double route en vérifiant l’intention et la confiance de l’étape. C’est maladroit mais ça fonctionne : route rapide pour les patterns connus, route profonde quand l’incertitude est élevée. GPT-5.4 fera probablement pareil si l’API ne fait pas de routage automatique. S’il fait du routage automatique, le travail se déplace vers l’écriture de garde-fous sensés et la journalisation, pour voir quand le modèle surexploite la voie lente.

Dans tous les cas, la logique est l’enjeu. Une fonctionnalité appelée « Rapide » n’aide pas si vous ne pouvez pas savoir quand elle est utilisée. Je préfère un paramètre simple et une bonne trace à de la magie.

Implications pour les boucles d’appel d’outils

Voilà où ça compte au quotidien : les boucles d’outils. Quand un agent appelle votre calculatrice, base de données ou navigateur trois fois de suite, les frais généraux s’accumulent. Si le Mode Rapide réduit le coût aller-retour pour l’analyse d’intention et la construction des arguments de fonction, vous réduisez la boucle. Ça libère du budget pour les étapes qui ont vraiment besoin de raisonnement.

Mais il y a un piège : si le passage rapide mal-route même 5 à 10 % des appels, vous le payez en retentatives et en garde-fous. Ma règle empirique est simple : mesurer le total des boucles complétées par minute, pas la latence par appel. Si ce nombre augmente avec le Mode Rapide activé, gardez-le. S’il diminue (plus de retentatives, plus de corrections), désactivez-le pour ce flux. Ce n’est pas une question de vitesse, c’est une question de débit fiable.

Vision en Pleine Résolution — Cas d’Utilisation Concrets

Pipelines de capture d’écran vers code

Je gère un petit pipeline de capture d’écran vers composant pour des outils internes. Aujourd’hui, la vision basse résolution rate les petits espacements ou les indices d’état (hover vs. actif). La vision en pleine résolution, si elle est réelle et accessible à des coûts de tokens raisonnables, change ça. Le modèle peut voir la bordure de 1 pixel et l’ombre subtile qui signale l’élévation.

En pratique, je le câblerais ainsi : passe haute résolution pour étiqueter les éléments UI atomiques, puis une passe rapide texte uniquement pour assembler le code en utilisant une carte de bibliothèque. Deux passes, chacune douée dans son domaine. La récompense n’est pas la magie « design vers code », ce sont moins de corrections manuelles. Sur un tableau de bord simple, ça pourrait me faire économiser 10 à 15 minutes et quelques allers-retours sur Figma.

Workflows de débogage UI

Un cas discret mais utile : les reproductions de bugs. Je reçois souvent des captures d’écran avec des toasts d’erreur à moitié coupés ou des superpositions modales. La vision haute résolution aide le modèle à raisonner sur le z-index et l’empilement de mise en page sans que je le décrive en mots. Le modèle peut noter : le bouton de fermeture du toast chevauche la navigation : probablement un problème d’empilement CSS. Je vérifie toujours, mais commencer plus près de la solution est un soulagement.

Pour les équipes, ça pourrait s’intégrer dans le triage : coller une capture d’écran, obtenir une liste de causes probables, plus des sélecteurs à inspecter. Rien de magique, juste une boucle plus serrée.

Interprétation des ressources de design

Les designers me remettent des exports avec des conventions de nommage qui dérivent sous pression de deadline — ça arrive. La vision haute résolution plus le contexte sur le système de design peut rétablir l’ordre. Le modèle peut mapper les tokens visuels (espacement, rayon, contraste de couleur) aux variables du système de design les plus proches.

Les limites s’appliquent toujours. Le modèle ne connaîtra pas le goût de votre équipe. Mais il peut faire la partie ennuyeuse : « ces 12 icônes font 20px, ces 3 font 16px : probable inadéquation. » Ce n’est pas digne d’une manchette, mais c’est le genre de petite exactitude qui s’accumule sur un sprint.

Signaux d’Agent de Codage en Contexte

Pourquoi des fuites sont apparues dans les dépôts Codex

Vous avez probablement vu des indices — des commits référençant des signaux d’agent, ou des configs avec des flags de routage inexpliqués. Je ne lis pas trop dans les fuites, mais elles concordent avec ce dont les développeurs ont besoin : des signaux plus clairs sur quand le modèle planifie, agit ou réfléchit. Les dépôts de l’ère Codex antérieurs simulaient souvent ça avec des heuristiques côté client. C’est pourquoi des configs ont fuité : la logique devait vivre en dehors du modèle.

Si GPT‑5.4 expose des signaux d’état plus fermes (même simples comme « planification » vs « exécution »), les développeurs peuvent synchroniser UI et journalisation sans analyser des vibrations dans le texte.

Potentiel d’édition multi-fichiers

Les éditions multi-fichiers sont là où les agents de codage s’effondrent. Aujourd’hui, je découpe le contexte, demande un plan, puis applique des diffs avec un linter dans la boucle. Ça fonctionne jusqu’à ce que ça ne fonctionne plus — généralement quand l’agent oublie un petit fichier ou renomme quelque chose en cours de route. Un meilleur support natif ressemblerait à : proposer un commit avec une carte de fichiers, inclure une justification par fichier, et me laisser accepter les changements par fichier.

Même sans nouvelles primitives, le raisonnement amélioré de GPT‑5.4 (s’il tient) plus des messages plus stricts — « montre-moi un ensemble de patches, pas de prose » — pourrait réduire les pièges. J’ai eu du succès en forçant un format de patch et en rejetant tout le reste. C’est ennuyeux. Ça aide.

Améliorations de la navigation dans les dépôts

Les fenêtres de contexte ont grandi, mais la navigation compte toujours. Les meilleures exécutions de codage que j’ai eues en 2026 utilisent un indexeur rapide qui construit une carte de symboles et un graphe de dépendances, puis n’alimente que les tranches pertinentes. Si GPT‑5.4 est meilleur pour lire ces cartes — tables de références croisées, résumés de symboles — on peut passer un contexte plus mince et plus précis.

Un signal pratique à surveiller : combien de fois l’agent demande un fichier qu’il a déjà vu. Moins de répétitions signifie généralement qu’il construit un meilleur ensemble de travail. Je le trace. Si vous ne le faites pas, commencez maintenant : c’est une métrique facile à suivre dans les versions.

Ce que les Développeurs Devraient Construire Dès Maintenant

Patterns d’architecture agnostiques au modèle

J’essaie de garder les modèles derrière un port étroit. Un courtier décide du routage : les outils restent sans état et visibles dans les logs : les prompts vivent dans des fichiers versionnés avec des tests. De cette façon, si GPT‑5.4 rend le Mode Rapide intéressant, je peux changer de voie sans tout recâbler.

Deux patterns qui ont bien vieilli pour moi :

- Des schémas d’outils typés avec des validateurs stricts. Moins de devinettes, moins de mauvais appels.

- Conception trace-d’abord. Chaque étape d’agent écrit une trace compacte que je peux rejouer. Quand une mise à jour de modèle change le comportement, je peux comparer les anciennes et nouvelles exécutions.

Aucun n’est brillant. Les deux sont ce qui empêche la livraison de stagner quand les modèles changent.

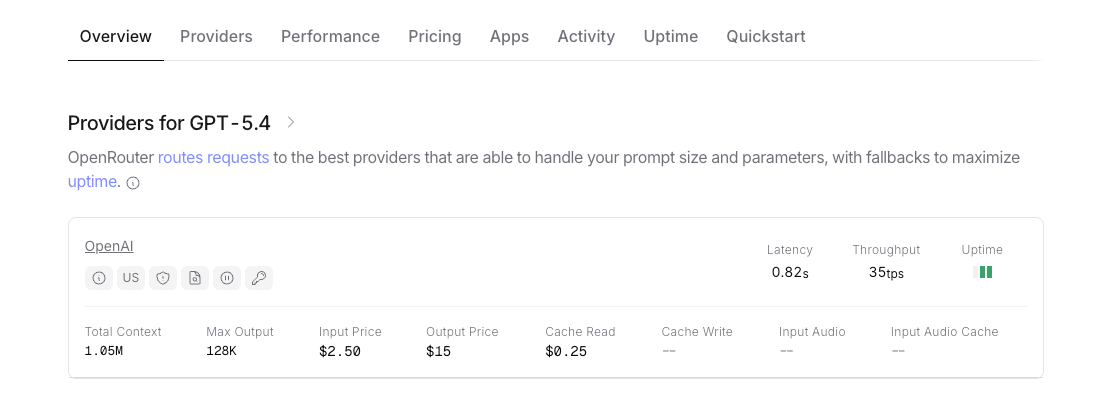

Surveiller les canaux de publication des modèles

Même si vous n’allez pas vite, surveillez les canaux. Je m’abonne aux pages de modèles et je parcours la liste des modèles et les notes de version. Je note trois choses par mise à jour : les indices de latence, le prix des tokens, et tout nouveau commutateur au niveau système (modes, routage, comportement de sécurité). Puis je réexécute un petit ensemble de benchmarks — 10 à 20 traces qui représentent mes vrais workflows.

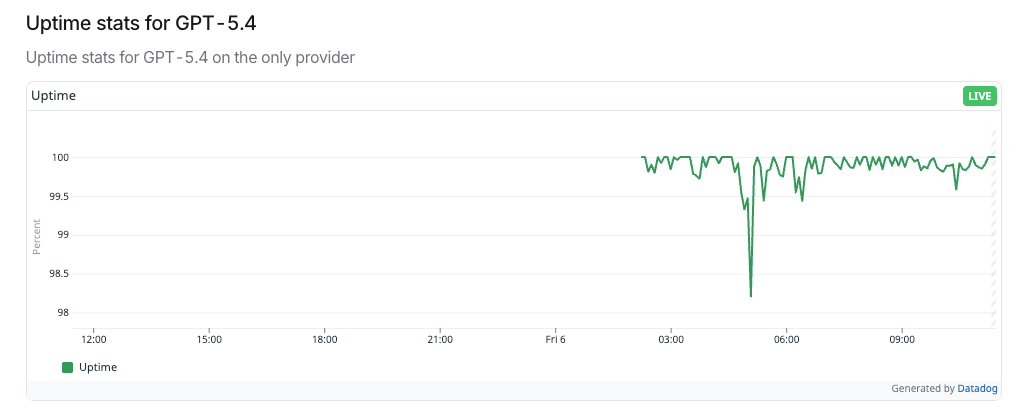

Ça prend une heure. Ça économise des jours plus tard. Si GPT‑5.4 se déploie en phases (c’est généralement le cas), vous verrez les cas limites d’abord dans les traces, pas dans les tickets de support. C’est l’intérêt de la surveillance : détecter la dérive calmement, avant qu’elle ne devienne un incendie.

Avertissement de Statut

Je n’ai pas été sponsorisée pour écrire ceci. Je n’ai pas non plus fait de paris de production sur GPT‑5.4 encore. Mes notes ici viennent d’expériences adjacentes et de patterns qui ont tenu à travers des mises à jour de modèles antérieures. Si et quand la documentation officielle clarifie les modes ou les détails de vision, je les lierai et m’adapterai. En attendant, traitez ceci comme des notes de terrain — utiles, je l’espère, mais provisoires.

Une dernière chose sur laquelle je rumine encore : si le Mode Rapide rend les parties silencieuses plus rapides, remarquons-nous moins, ou nous inquiétons-nous simplement moins ? Je suis d’accord avec l’un ou l’autre.