Construire un pipeline créatif IA avec GLM-5 + WaveSpeed

Construisez un pipeline créatif IA complet : GLM-5 rédige les prompts, WaveSpeed génère images et vidéos, le tout orchestré via API.

Bonjour, je suis Dora. Je passais sans cesse d’un outil à l’autre juste pour finaliser un court clip produit. Le brief dans un endroit. Les images dans un autre. La vidéo ailleurs. Les notes éparpillées. Rien de tout cela n’était difficile, mais c’était… bruyant. J’ai donc essayé quelque chose de plus simple : un parcours stable, de bout en bout, qui me mène d’un brief brut à un clip terminé sans jongler constamment. Je l’appelle un pipeline créatif GLM-5. Je l’ai testé sur deux semaines, sur trois concepts courts et quelques bribes de travaux clients. Ce n’est pas spectaculaire. Mais ça a rendu le travail plus léger.

Ce que nous construisons (vue d’ensemble de bout en bout)

Je voulais un seul parcours allant d’un brief court à une vidéo de 6 à 10 secondes, avec de la place pour de petites itérations mais sans chasse aux fonctionnalités. La structure ressemble à ceci :

- J’écris un brief simple (deux ou trois phrases). Le ton, le sujet, les contraintes éventuelles.

- GLM-5 transforme cela en descriptions de scènes claires.

- FLUX ou Seedream génère des images fixes via WaveSpeed pour rendre l’inférence prévisible.

- WAN 2.5 ou Seedance construit le mouvement à partir des images fixes approuvées.

- GLM-5 examine les rendus et suggère des modifications précises, pas des réécritures.

Quelques règles que je me suis fixées :

- Garder des prompts courts et structurés. J’utilise les mêmes champs à chaque fois : Sujet, Décor, Style, Notes de mouvement, Contraintes.

- Travailler en petits lots. Trois concepts maximum par session. Cela a gardé mon esprit clair et facilité les comparaisons.

- Figer les seeds quand quelque chose me plaît. Les variations après, pas pendant.

En pratique, le pipeline a réduit les clics et les hésitations plus qu’il n’a réduit le temps brut. Lors de ma troisième session, j’ai économisé environ 15 minutes sur un parcours concept-à-clip qui prenait habituellement 90 minutes. Le gain le plus important était mental : moins de branches, moins de détours « et si j’essaie X ». C’est ce que je cherchais.

Étape 1 — GLM-5 génère des descriptions de scènes à partir du brief

J’ai commencé avec un tout petit brief : « Lumière matinale chaude sur une tasse en céramique près d’une fenêtre. Vapeur douce. Ambiance minimaliste et calme. Pour une story sociale en 9:16. Couleurs de marque : accent teal atténué. »

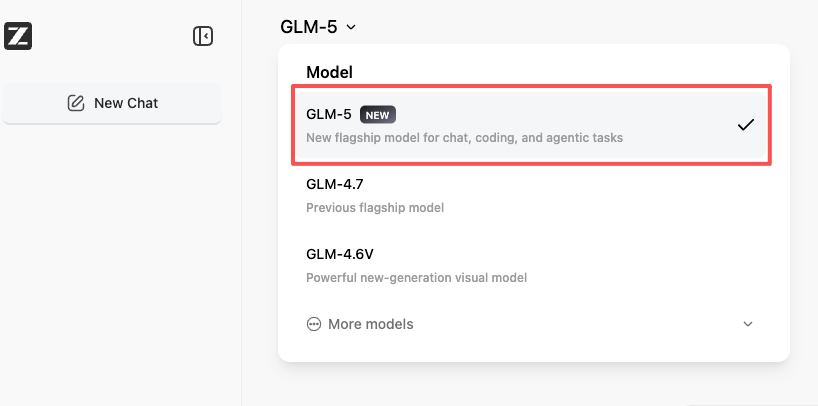

GLM-5 excelle dans l’écriture créative avec une polyvalence stylistique, selon la documentation officielle de Zhipu AI. Ce dont j’avais besoin de GLM-5, ce n’était pas de l’ingéniosité. Je voulais de la structure : des fiches de scènes cohérentes qu’un moteur de rendu pouvait suivre. Voici le format que j’ai demandé et maintenu :

- Titre de la scène

- Type de plan (ex. : gros plan moyen)

- Composition (règle des tiers, notes sur l’espace négatif)

- Éclairage

- Palette

- Textures/matériaux

- Notes de mouvement (le cas échéant)

- Contraintes strictes (pas de visages, pas de texte à l’écran, dimensions de sortie)

La première passe était verbeuse. GLM-5 sur-expliquait l’ambiance. Je l’ai recadré : « Gardez chaque champ à une seule phrase. Utilisez des noms précis et des termes cinématographiques. » Cela a réglé la plupart des problèmes. Dès la deuxième session, j’obtenais des fiches nettes qui se traduisaient proprement en prompts d’images.

Petit gain : j’ai demandé à GLM-5 d’ajouter les éléments « interdits » sur lesquels j’avais trébuché avant (mains supplémentaires, logos errants, reflets avec des visages). Cela a réduit les corrections ultérieures. Pas parfait, mais moins de surprises.

Cette partie n’a pas économisé du temps en amont : elle a économisé de la fatigue de jugement plus tard. Je ne choisissais plus entre cinq styles de prompts différents. J’en avais un seul.

Étape 2 — FLUX / Seedream génère des images via WaveSpeed

J’ai utilisé FLUX et Seedream car ils ont des tempéraments différents. FLUX m’a donné des images nettes et orientées design. Seedream dérivait un peu plus mais trouvait parfois de belles textures dans les céramiques et le bois. J’ai piloté les deux via WaveSpeed pour pouvoir standardiser les étapes, les seeds et les schedulers sans gérer manuellement des dizaines de paramètres.

Notes de terrain :

- La reproductibilité de WaveSpeed était importante. Quand j’aimais une image, je figeais le seed et ajustais seulement le guidance et les étapes. Cela rendait les « bons accidents » reproductibles.

- J’ai défini le format sur la sortie cible (9:16) dès le départ. Recadrer après rendait toujours la vapeur bizarre.

- Je me suis limitée aux prompts issus de GLM-5. Pas de fioritures poétiques. Stérile, mais cela réduisait les bordures étranges.

Friction : les mains et les fenêtres. Les reflets adorent inventer des personnes. J’ai ajouté « pas de silhouettes, pas de reflets humains » aux contraintes et appliqué un guidance négatif légèrement plus élevé. Cela a réduit le bruit.

Le temps de génération par image variait de rapide à « pause café » selon ma machine. Je générais 8 à 12 candidats par scène, puis je réduisais sévèrement à 2. Si je ne pouvais pas choisir rapidement, cela signifiait que le prompt n’était pas assez précis. Retour à GLM-5 avec une petite modification plutôt que de pêcher des images.

Étape 3 — WAN 2.5 / Seedance génère la vidéo à partir des images fixes

C’est là que je perds généralement le fil : trop d’options de mouvement. Je me suis limitée à deux modes : léger parallaxe et doux mouvement de caméra. WAN 2.5 gérait le parallaxe de manière convaincante. Seedance s’en sortait mieux avec les micro-mouvements comme la vapeur et les doux changements de mise au point.

Ma checklist de transfert de l’image fixe au mouvement :

- Exporter un PNG propre à la résolution cible (1080x1920 pour les tests).

- Fournir une note de mouvement précise (ex. : « dolly-in de 2–3°, garder l’anse de la tasse dans le tiers, dérive de vapeur adaptée à un loop »).

- Limiter la durée à 6–8 secondes. Les clips longs devenaient flous et attiraient l’attention sur les artefacts du modèle.

Surprises :

- Scintillement des textures. Les émaux granuleux sont superbes en image fixe et deviennent bruités en mouvement. J’ai réduit l’intensité des textures à l’étape 2 quand je savais que j’allais animer.

- Déformation des bords vers les coins. Les compositions centrées tenaient mieux. Les tasses hors axe se courbaient comme du caoutchouc.

Les meilleures sessions étaient invisibles. Quand ça fonctionnait, je cessais de penser au modèle et je regardais simplement la lumière respirer. Quand ça ne marchait pas, tout s’effondrait rapidement, généralement parce que j’avais demandé trop de mouvement.

Étape 4 — GLM-5 examine les rendus et suggère des itérations

J’ai fait revenir GLM-5 comme un calme second regard. Je lui ai demandé de :

- Comparer les clips finaux au brief original.

- Signaler les incohérences (palette, ambiance, contraintes).

- Proposer une seule petite modification par clip, pas cinq.

C’était plus utile que je ne l’espérais. GLM-5 repérait systématiquement les dérives de couleur. Lors d’une session, il a noté que l’accent teal semblait froid face à la lumière chaude : un léger décalage de teinte dans l’arrière-plan l’a corrigé.

Mais il dépassait parfois les bornes, en suggérant de nouveaux accessoires ou des incrustations de texte. Je l’ai recadré en établissant une règle : « Pas de nouveaux noms. Ajustez seulement l’éclairage, la couleur ou l’intensité du mouvement. » Cela a maintenu les itérations dans des limites raisonnables.

La boucle ici était rapide : une passe de notes, une passe de corrections. Si je n’étais toujours pas satisfaite, je mettais le concept de côté plutôt que de m’acharner. Cette retenue a empêché le pipeline de gonfler.

Code complet (Python, WaveSpeed SDK)

J’ai gardé l’orchestration simple. Un seul script Python relie les étapes avec quelques petits utilitaires :

- Une classe Brief qui stocke Sujet, Décor, Style, Mouvement, Contraintes.

- Un utilitaire glm5() qui formate le prompt et parse les fiches de scènes en dicts.

- Un utilitaire images() qui appelle WaveSpeed avec FLUX ou Seedream, en passant seeds, étapes et prompts négatifs.

- Un utilitaire video() qui transmet les images fixes à WAN 2.5 ou Seedance avec les notes de mouvement.

- Un utilitaire review() qui renvoie des miniatures ou de courts gifs à GLM-5 pour des notes d’alignement.

Deux détails ont assuré la stabilité :

- J’écrivais les résultats sur le disque avec des chemins déterministes : run_id/scene_01/flux_seed1234.png. Cela facilitait le rétro-suivi.

- Je journalisais les paramètres à côté des sorties dans un petit fichier YAML. Quand un clip était réussi, je savais exactement pourquoi.

Je ne publie pas le code ici pour éviter de transformer ceci en copier-coller massif. La structure ci-dessus suffit à le recréer avec votre propre stack. Si vous utilisez déjà WaveSpeed, il s’agit surtout de choisir où figer l’aléatoire et où autoriser la dérive.

Détail des coûts pour 10 assets

Les coûts varient beaucoup selon le fournisseur et les paramètres du modèle, donc prenez ceci comme une fourchette pratique tirée de mes tests, pas comme une promesse. Dix assets signifie ici 10 courts clips verticaux (une scène chacun), avec 8 à 12 candidats d’images par scène.

- Prompting et review GLM-5 : léger. La tarification de l’API GLM-5 est de 1,00 $/M en entrée et 3,20 $/M en sortie, nettement moins cher que Claude Opus 4.6 (5 $/M en entrée, 25 $/M en sortie). Pour mes sessions, chaque asset utilisait environ 2 à 3 interactions de brief plus une review. Sur une facturation à l’usage, cela se situe généralement dans les quelques dollars pour 10 assets.

- Génération d’images : le principal facteur variable. Avec des étapes moyennes et 8 à 12 candidats par scène, j’ai observé des coûts dans les moyennes à hautes unités par asset sur des plans à l’inférence. Moins si vous travaillez en lot sur votre propre GPU.

- Génération vidéo : également variable. Les clips à parallaxe simple coûtent moins cher ; les mouvements physiques coûtent plus cher. Dans mes notes, cela revenait similaire aux images par asset, parfois un peu plus élevé.

Total approximatif pour 10 assets, modèles mixtes, paramètres conservateurs : une centaine d’euros bas de gamme si entièrement cloud avec beaucoup de variations, notablement moins si vous hébergez vous-même les étapes d’images et ne payez que pour le mouvement. Avec rigueur — 6 candidats au lieu de 12, une seule passe de mouvement — vous pouvez réduire d’un tiers. Si vous chassez les variations, ça double vite. Seeds et règles de petite itération aident à maîtriser la facture.

Extensions : ajout de LoRAs, upscaling, traitement par lots

Une fois la base stabilisée, j’ai essayé quelques extensions.

- LoRAs pour la texture de marque : j’ai entraîné un petit pack d’accent pour l’émail de céramique et le papier de fond. Cela a aidé à maintenir la cohérence des matériaux entre les scènes. L’astuce était un poids modeste. Les LoRAs trop forts tiraient tout vers le même aspect.

- Upscaling doux : je n’upscale qu’après le mouvement, pas avant. L’upscaling préalable amplifiait les artefacts. L’upscaling post-mouvement avec un modèle léger préservant les détails gardait les bords nets sans inventer de pores sur une tasse.

- Traitement par lots : j’ai ajouté une file d’attente où chaque concept avance comme une unité. Pas de mélange d’étapes provenant de briefs différents. Cela semble strict, mais ça m’a sauvée de la spirale du « juste un essai de plus ».

Quelques éléments que je n’ai pas conservés :

- Le sous-titrage automatique dans le pipeline. Il tirait les visuels vers du « contenu » plutôt que des images-en-mouvement. Je fais les sous-titres en dehors, plus près de la publication.

- Le mélange de styles agressif. C’est joli dans une grille et fatiguant en mouvement.

À qui ça convient : les créateurs qui aiment les parcours prévisibles et les gains petits et réguliers. À qui ça ne conviendra pas : les personnes qui cherchent le spectacle ou l’art à haute variance. C’est bien ainsi.

Je voulais rendre le pipeline créatif GLM-5 plus silencieux, pas plus intelligent. Les bons jours, c’est exactement ce que ça donne : une tasse, un peu de lumière, et moins d’onglets ouverts que d’habitude. Je m’en contente.