Qué Es Qwen3.5-Omni: Capacidades, Variantes y Acceso a la API

Qwen3.5-Omni acaba de lanzarse con las variantes Plus, Flash y Light. Esto es lo que los desarrolladores necesitan saber sobre capacidades, acceso a la API y uso en producción.

¡Hola a todos! ¡Soy Dora y vuelvo de nuevo! Estaba a mitad de edición en un proyecto de video cuando llegó la notificación: Qwen3.5-Omni acaba de lanzarse. Llevo meses ejecutando la familia Qwen3-Omni en algunos flujos de trabajo de producción, así que supe de inmediato que no era un parche menor. Una ventana de contexto de 256K, clonación de voz, interrupción semántica y 113 idiomas para el reconocimiento de voz — todo en un solo modelo. Tuve que detener lo que estaba haciendo.

Si construyes agentes de voz, pipelines de subtitulado, o cualquier cosa que deba manejar audio y video humano real juntos, este lanzamiento es directamente relevante para ti. Déjame explicar qué hace realmente, qué significan las tres variantes en la práctica y cómo obtener acceso — incluyendo lo que aún no está claro a día de hoy.

Qué Hace Realmente Qwen3.5-Omni

Texto, Imagen, Audio y Video en una Sola Llamada de Inferencia

Aquí está lo que se sigue subestimando en los anuncios de IA: el procesamiento multimodal nativo y el procesamiento multimodal de pipelines encadenados no son lo mismo.

Cuando un modelo no omnimodal como ChatGPT 5.4 recibe un video, tiene que extraer fotogramas a través de un modelo de visión, procesar el audio a través de algo como Whisper para la transcripción, y aplicar OCR para leer los subtítulos incrustados — tres procesos separados encadenados para aproximar lo que un verdadero modelo omni hace en un solo paso. En condiciones ideales, con un clip bien iluminado y audio limpio, eso tardó nueve minutos en una prueba real.

Qwen3.5-Omni maneja la misma entrada en una sola llamada. Envías el video. Recibes una respuesta. Sin pipeline intermedio. Sin sobrecarga de conversión de formato. Sin un modelo de audio que no sabe qué está pasando en pantalla y un modelo de visión que no puede escuchar nada.

El modelo admite comprensión de texto, imagen, audio y audio-video, con los componentes Thinker y Talker usando ambos una arquitectura Hybrid-Attention MoE. Esa última parte importa más de lo que podría parecer, y lo explicaré en la sección de arquitectura más abajo.

Qué Significa “Omnimodal” en la Práctica vs. Pipelines Encadenados

La diferencia aparece en escenarios que son genuinamente difíciles para los sistemas encadenados. Piensa en: una grabación de pantalla donde alguien está programando y narrando al mismo tiempo. O una llamada de servicio al cliente donde el contexto es mitad verbal y mitad en pantalla. O un flujo de trabajo de subtitulado de accesibilidad donde el audio ambiente y la acción visual ambos llevan significado de forma independiente.

El equipo de Qwen demostró lo que llaman “Audio-Visual Vibe Coding” — el modelo puede ver una grabación de pantalla de una tarea de programación y escribir código funcional basándose puramente en lo que ve y escucha, sin necesidad de un prompt de texto.

Es un nombre de demo extraño, pero es una brecha de capacidad real en comparación con los modelos centrados en texto con audio añadido. Cuando el razonamiento y la percepción ocurren dentro del mismo modelo al mismo tiempo, las cosas que requieren contexto multimodal realmente funcionan.

Tres Variantes: Plus, Flash y Light

Plus — Líder en Benchmarks, Cuando Vale el Costo

Qwen3.5-Omni-Plus logró 215 resultados SOTA en tareas de comprensión de audio y audio-video, razonamiento e interacción. Es un número grande, y los benchmarks de Alibaba tienden a contar de forma agresiva — pero las comparaciones independientes lo están respaldando en las categorías que importan.

En benchmarks estándar, Qwen3.5-Omni Plus superó a Gemini 3.1 Pro en tareas de comprensión de audio general, razonamiento y traducción, y lo igualó en comprensión audio-visual. En estabilidad de voz multilingüe en 20 idiomas, superó a ElevenLabs, GPT-Audio y Minimax.

La clonación de voz está disponible tanto en Plus como en Flash a través de la API — envías una muestra de voz de 10 a 30 segundos, y el modelo la clona para la salida.

¿Cuándo pagas por Plus? Cuando la calidad de salida es lo que tus usuarios realmente notan. Productos de agentes de voz donde la naturalidad de la voz es una propuesta de valor central. Transcripción de alto riesgo donde la precisión en idiomas poco comunes importa. Cualquier cosa donde estés comparando contra Gemini o GPT-Audio directamente y necesites ganar en calidad.

Flash — Compensaciones de Rendimiento y Latencia

Flash es la recomendación predeterminada para uso en producción según la documentación de la API. Los IDs de modelo son qwen3.5-omni-flash para la variante estándar, y Flash se describe como el predeterminado al equilibrar latencia, calidad y respuesta para la mayoría de los escenarios de producción.

Para creadores que construyen flujos de trabajo asistidos por IA — pipelines de subtitulado automático, transcripción de entrevistas en tiempo real, resumen de video a escala — Flash es casi con certeza tu punto de partida. Realizas pruebas por lotes contra Plus para ver si el delta de calidad vale la diferencia de costo para tu caso de uso específico.

El predecesor Qwen3-Omni Flash ya tenía respuestas de voz en streaming con latencia tan baja como 234 milisegundos. Espera que Qwen3.5-Omni Flash esté en un rango similar, aunque los benchmarks de latencia publicados exactos para 3.5 específicamente no están confirmados en las notas del lanzamiento inicial.

Light — Casos de Uso en Edge y Presupuesto Reducido

Light es la variante más pequeña de la familia. Los recuentos de parámetros para la serie 3.5-Omni no se han confirmado completamente al momento de escribir esto, pero el modelo 30B-A3B del predecesor funcionaba razonablemente bien en hardware de consumo con la cuantización correcta, y la variante Light aquí podría seguir un patrón similar.

Si estás prototipando, construyendo algo para un cliente con costos de inferencia ajustados, o genuinamente operando en el edge, Light es donde empiezas. No lo descartes como “el malo” — para muchos flujos de trabajo de herramientas para creadores (piensa: subtitulado automático de miniaturas, Q&A simple sobre audio cargado), es probable que sea más que suficiente.

Qué Hay de Nuevo vs. Qwen3-Omni

Ventana de Contexto: 256K Tokens, Más de 10 Horas de Audio

Este es el cambio que más me importa desde una perspectiva práctica de producción.

La ventana de contexto de 256K tokens se traduce en más de 10 horas de audio, o aproximadamente 400 segundos de video a 720p con audio. Eso es un salto significativo. El modo de pensamiento de Qwen3-Omni predecesor tenía un máximo de 65,536 tokens con cadenas de razonamiento de 32,768 tokens — útil, pero limitado para medios de formato largo.

Para análisis de podcasts, procesamiento de entrevistas de formato largo, resumen extendido de llamadas de clientes — esta ventana de contexto cambia lo que realmente es factible en una sola llamada de API.

Cobertura de Idiomas: 113 de Reconocimiento, 36 de Generación

El reconocimiento de voz ahora cubre 113 idiomas y dialectos, frente a 19 en el predecesor. La generación de voz se expandió de 10 idiomas a 36.

Una nota honesta aquí: Alibaba cuenta los dialectos regionales de una manera que infla estos números en comparación con cómo, por ejemplo, OpenAI contaría la misma cobertura. Incluso descontando eso, el salto es real. Si estás construyendo para mercados del Sudeste Asiático, contenido en árabe, o cualquier flujo de trabajo de voz multilingüe, esta es una mejora práctica significativa.

Thinker-Talker con Hybrid-Attention MoE

La arquitectura Thinker-Talker fue introducida por primera vez en Qwen2.5-Omni. La mejora importante en 3.5-Omni es que ambos componentes ahora usan un diseño Hybrid-Attention MoE (Mixture-of-Experts), igualando el cambio de la familia Qwen3.5 más amplia hacia arquitecturas dispersas.

Por qué esto importa para los desarrolladores: la división Thinker-Talker permite que los sistemas externos — pipelines RAG, filtros de seguridad, llamadas de función — intervengan entre las dos etapas antes de que comience la síntesis de voz. Eso no es solo un detalle arquitectónico. Significa que puedes conectar tu propia lógica entre lo que el modelo razona y lo que dice en voz alta. Para los agentes de voz en producción, eso es genuinamente útil.

Interrupción Semántica y Clonación de Voz

Cualquiera que haya desplegado un bot de voz conoce el problema: el usuario tose, un perro ladra, alguien dice “ajá,” y el bot se detiene a mitad de respuesta pensando que lo están interrumpiendo.

Qwen3.5-Omni añade interrupción semántica, que intenta distinguir entre un usuario que genuinamente quiere intervenir y el ruido de fondo ambiental o comentarios pasajeros. Esta es una de esas características que suena menor en un registro de cambios pero que en realidad es la diferencia entre un asistente de voz que la gente encuentra frustrante y uno que siguen usando.

La clonación de voz y el control de voz en tiempo real para velocidad, volumen y emoción también son nuevos. El equipo menciona una característica llamada ARIA que mejora la estabilidad y la naturalidad de la salida de voz — los detalles técnicos de lo que ARIA hace internamente no se han detallado en el lanzamiento inicial.

Cómo Acceder a Qwen3.5-Omni

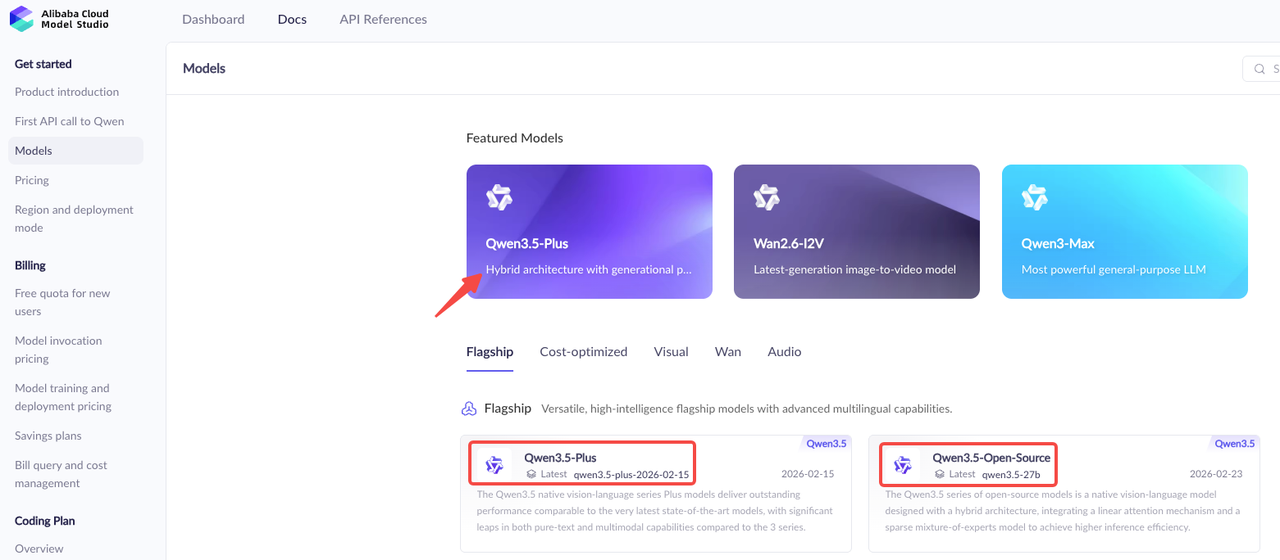

API DashScope (Alibaba Cloud)

La ruta de acceso de producción principal es a través de la API DashScope de Alibaba Cloud. Usa una interfaz compatible con OpenAI, lo que significa que si ya estás llamando a GPT-4o o Claude a través del SDK de OpenAI, la migración es sencilla.

DashScope admite múltiples regiones: Singapur (internacional), Virginia (EE. UU.), Pekín (China) y Hong Kong, con diferentes URLs de endpoint para cada una. Para la mayoría de los equipos fuera de China, el endpoint internacional de Singapur es tu predeterminado: dashscope-intl.aliyuncs.com.

Los IDs de modelo para las tres variantes siguen el patrón qwen3.5-omni-plus, qwen3.5-omni-flash y qwen3.5-omni-light. La estructura de la API sigue el formato estándar /v1/chat/completions con un parámetro modalities para especificar si quieres texto, audio o ambos en la respuesta.

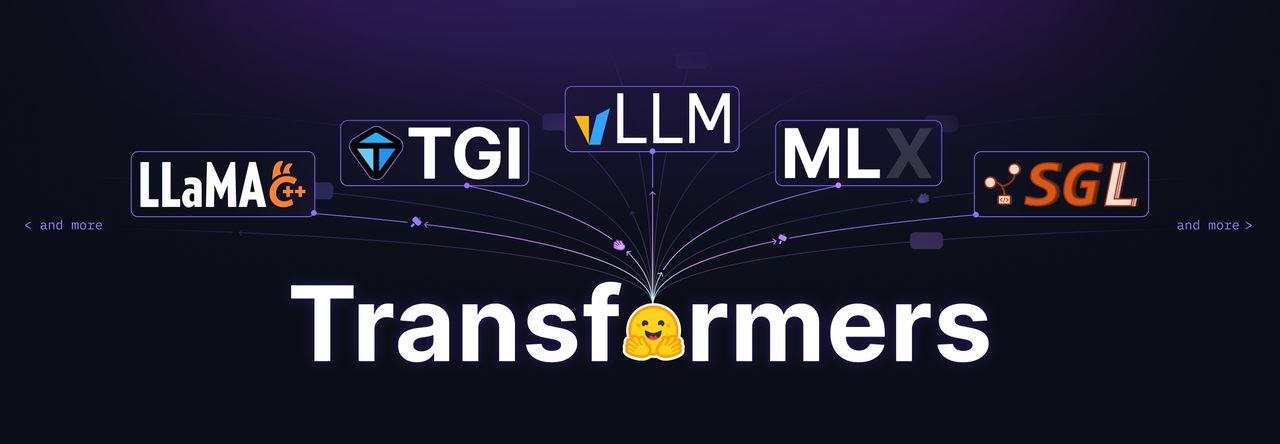

Opción de Auto-Alojamiento con vLLM

El equipo de Qwen recomienda encarecidamente vLLM para la inferencia y el despliegue de los modelos de la serie Qwen-Omni, proporcionando una imagen Docker que incluye un entorno de ejecución completo tanto para HuggingFace Transformers como para vLLM.

La advertencia es que la velocidad de inferencia con HuggingFace Transformers en modelos MoE puede ser muy lenta, por lo que para requisitos de gran escala o baja latencia, vLLM o la API DashScope es la ruta recomendada.

Si te estás auto-alojando, planifica alrededor de vLLM 0.13.0 específicamente — esa es la versión referenciada en la documentación oficial de configuración. La arquitectura MoE significa que los requisitos de memoria son más bajos que un modelo denso comparable al mismo nivel de calidad, pero aún querrás validar la asignación de GPU antes de poner en marcha un despliegue de producción.

Estado de Pesos Abiertos: Qué Está Confirmado vs. Pendiente

Aquí es donde quiero ser cuidadosa y no especular más allá de lo que está confirmado.

Qwen3-Omni (el predecesor) fue lanzado bajo Apache 2.0 en GitHub y HuggingFace. Si los pesos de Qwen3.5-Omni seguirán la misma ruta de licencia Apache 2.0 no ha sido confirmado en el anuncio inicial. Los pesos del predecesor están disponibles públicamente — los pesos de 3.5 pueden seguir, pero a partir de la fecha de lanzamiento del 30 de marzo, esa confirmación está pendiente.

No construyas tus planes de despliegue de pesos abiertos en torno a esto hasta que el repositorio oficial de GitHub o la tarjeta del modelo en HuggingFace confirmen la licencia. Consulta QwenLM GitHub para actualizaciones.

Quién Debería Prestar Atención a Este Lanzamiento

Constructores de Agentes de Voz y Conversación en Tiempo Real

Si estás construyendo aplicaciones de voz primero — bots de servicio al cliente, compañeros de IA, herramientas interactivas de voz — Qwen3.5-Omni vale una evaluación seria. La interrupción semántica por sí sola aborda un punto de dolor conocido que todo desarrollador de agentes de voz ha encontrado. Añade llamadas de función nativas y búsqueda web, y esto empieza a parecer infraestructura real en lugar de un lanzamiento de investigación.

La publicación del blog de Qwen destaca la búsqueda web nativa y el soporte de llamadas de función integrados directamente en el modelo omni, lo que lo posiciona menos como un artefacto de investigación y más como infraestructura para aplicaciones de voz primero.

Flujos de Trabajo de Producción Audio-Visual y Subtitulado

Para herramientas de creadores, automatización de producción de video y subtitulado a escala — este es el lanzamiento más convincente en el espacio multimodal de pesos abiertos ahora mismo. El contexto de audio de más de 10 horas significa que puedes procesar contenido de duración completa en una sola llamada. La cobertura de idiomas ampliada significa que el contenido multilingüe ya no es un caso especial.

La combinación de comprensión de audio y análisis de fotogramas de video en una sola llamada de inferencia también hace que esto sea genuinamente útil para cosas como: extracción automática de momentos destacados, subtitulado de B-roll, transcripción de narración en off con correlación de texto en pantalla.

Equipos Que Ya Ejecutan Qwen3-Omni en Producción

Si Qwen3-Omni ya está en tu stack, actualizar a Qwen3.5-Omni es sencillo. La estructura de la API es consistente. La mejora de la ventana de contexto por sí sola hace que valga la pena probarlo en tus cargas de trabajo existentes — especialmente cualquier cosa que estuviera alcanzando el límite de 65K tokens.

Lo Que No Cubre

No Es un Modelo de Generación de Imágenes

Vale la pena decirlo claramente porque “omnimodal” crea cierta confusión: Qwen3.5-Omni genera texto y voz. No genera imágenes ni video. Entiende imágenes y video como entrada — esa es una capacidad completamente diferente. Si la generación de imágenes es lo que necesitas, mira las líneas de modelos VL y de generación de imágenes separadas de Qwen, o el modelo qwen-image-plus en el catálogo de DashScope.

Velocidad de Inferencia en MoE: vLLM vs. HuggingFace Transformers

Esto confundió a mucha gente con Qwen3-Omni y también confundirá a la gente con 3.5-Omni. Dado que Qwen3-Omni emplea una arquitectura MoE, la velocidad de inferencia con HuggingFace Transformers en modelos MoE puede ser muy lenta. Para invocación a gran escala o requisitos de baja latencia, vLLM o la API DashScope está fuertemente recomendada.

No hagas benchmarks en HuggingFace Transformers y concluyas que el modelo es lento. Prueba en vLLM o la API administrada antes de formarte una opinión sobre la viabilidad en producción.

Preguntas Frecuentes

¿Es Qwen3.5-Omni de código abierto o de pesos abiertos?

A partir del lanzamiento del 30 de marzo de 2026, el estado de pesos abiertos de Qwen3.5-Omni no ha sido confirmado oficialmente. El predecesor Qwen3-Omni era de pesos abiertos bajo Apache 2.0 y estaba disponible en HuggingFace. Espera un cadencia de lanzamiento similar para 3.5-Omni, pero verifica en el GitHub oficial de QwenLM antes de depender de ello.

¿Puedo auto-alojar Qwen3.5-Omni-Plus?

La API DashScope es la ruta de producción confirmada hoy. El auto-alojamiento a través de vLLM está soportado para Qwen3-Omni y probablemente estará soportado para 3.5-Omni una vez que se publiquen los pesos. Los requisitos de parámetros activos de la arquitectura MoE de la variante Plus son más bajos que un modelo denso comparable, pero necesitarás una configuración multi-GPU para la variante Plus completa.

¿Admite llamadas de función y búsqueda web de forma nativa?

Sí. La publicación del blog de Qwen destaca explícitamente el soporte nativo de búsqueda web y llamadas de función integrado en el modelo omni. Las llamadas de función siguen el formato estándar de herramientas de OpenAI a través de la API DashScope. Este es un diferenciador significativo — puedes construir agentes de voz que consulten datos en vivo sin enrutar a través de una capa de orquestación separada.

Publicaciones Anteriores: