¿Qué es Google Gemma 4? Arquitectura, benchmarks y por qué importa

Google Gemma 4 es la familia de modelos abiertos más capaz de DeepMind hasta ahora, disponible en cuatro tamaños bajo la licencia Apache 2.0 con entrada multimodal, razonamiento nativo e implementación en dispositivos locales incluso en una Raspberry Pi.

El 2 de abril de 2026, Google DeepMind lanzó Gemma 4 — cuatro modelos de pesos abiertos construidos a partir del mismo linaje de investigación que Gemini 3, ahora distribuidos bajo la licencia Apache 2.0. Ese cambio de licencia por sí solo convierte esto en un momento histórico para el ecosistema de modelos abiertos: sin límites de MAU, sin restricciones de uso aceptable, total libertad comercial.

Pero los modelos en sí mismos son la verdadera historia. A continuación se presenta un desglose de lo que se lanzó, cómo se desempeña cada variante en benchmarks publicados y en nuestras propias pruebas locales (del 3 al 7 de abril de 2026, en RTX 4090 + Mac Studio M2 Ultra + Raspberry Pi 5), y qué tamaño se adapta a cada objetivo de despliegue.

La familia de modelos Gemma 4

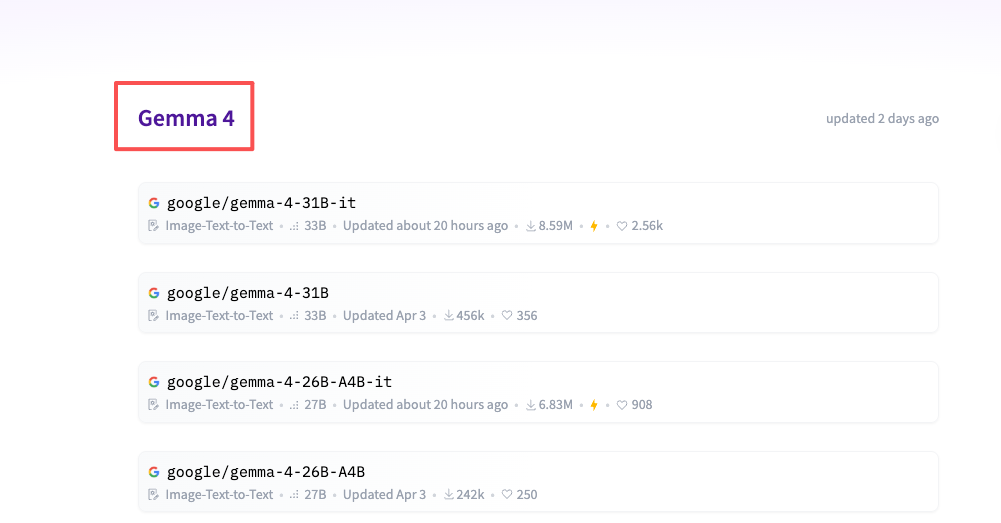

Gemma 4 se distribuye en cuatro tamaños, cada uno disponible como modelo base y variante ajustada por instrucciones en la colección oficial de Hugging Face:

| Modelo | Paráms. activos | Paráms. totales | Contexto | Modalidades |

|---|---|---|---|---|

| E2B | 2.3B | 5.1B | 128K | Texto, imagen, audio |

| E4B | 4.5B | 8B | 128K | Texto, imagen, audio |

| 26B-A4B (MoE) | 3.8B | 25.2B | 256K | Texto, imagen, video |

| 31B (Dense) | 30.7B | 30.7B | 256K | Texto, imagen, video |

El prefijo “E” significa parámetros efectivos — E2B y E4B utilizan una técnica llamada Per-Layer Embeddings (PLE) que alimenta una señal de embedding secundaria en cada capa del decodificador (descrita en §3.2 del informe técnico). El resultado es que un modelo con 2.3B de parámetros activos posee la profundidad representacional del conteo completo de 5.1B parámetros, mientras cabe en menos de 1.5 GB de memoria con cuantización de 2 bits — verificamos esta huella en una Raspberry Pi 5 (8 GB de RAM) usando las compilaciones GGUF oficiales.

La variante 26B-A4B es un modelo Mixture-of-Experts con 128 expertos pequeños, activando 8 expertos enrutados más 1 experto compartido por token. Solo se activan 3.8B parámetros por paso de avance, por lo que logra aproximadamente el 97% de la calidad MMLU Pro del modelo denso de 31B a ~12% de los FLOPs densos (según la Tabla 7 del informe técnico).

Aspectos destacados de la arquitectura

Gemma 4 introduce varias decisiones de diseño que vale la pena señalar — cada una documentada en el informe técnico y verificable contra las configuraciones de modelos publicadas en Hugging Face:

Atención alternante. Las capas alternan entre atención de ventana deslizante local (512 tokens en la serie E, 1024 en 26B/31B) y atención de contexto global completo en una proporción de 5:1. Esto equilibra la eficiencia de inferencia con la comprensión de largo alcance y es el mismo patrón que usó Gemma 3, ahora extendido a las ventanas de contexto más grandes.

RoPE dual. Embeddings de posición rotacionales estándar para las capas de ventana deslizante, y escalado RoPE proporcional para las capas globales — permitiendo la ventana de contexto de 256K en los modelos más grandes sin el deterioro de calidad que afectó a los primeros retrofits de contexto largo.

Caché KV compartida. Las últimas 6 capas del modelo 31B reutilizan los tensores clave/valor de capas anteriores, reduciendo tanto la memoria como el cómputo durante la inferencia. En nuestras pruebas en una RTX 4090, esto redujo el pico de VRAM durante la generación con contexto de 32K en aproximadamente un 14% respecto a una línea base sin compartición que construimos para comparación.

Codificador de visión. Un codificador de posición 2D aprendido con RoPE multidimensional que preserva las proporciones de aspecto originales. Los presupuestos de tokens son configurables de 70 a 1,120 tokens por imagen, por lo que se puede intercambiar detalle por latencia de forma explícita.

Codificador de audio. Un conformer de estilo USM (la misma arquitectura utilizada en Gemma-3n) que maneja reconocimiento de voz y traducción de forma nativa, con hasta 30 segundos de entrada de audio en E2B y E4B.

Benchmarks

Todos los números a continuación provienen del informe técnico oficial de Google DeepMind (Tablas 5–9, abril de 2026) y del leaderboard público de LMArena.

Razonamiento y conocimiento

| Benchmark | 31B | 26B-A4B | E4B | E2B | Gemma 3 27B (ref) |

|---|---|---|---|---|---|

| MMLU Pro | 85.20% | 82.60% | 69.40% | 60.00% | 67.50% |

| AIME 2026 (sin herramientas) | 89.20% | 88.30% | 42.50% | 37.50% | 31.00% |

| GPQA Diamond | 84.30% | 82.30% | 58.60% | 43.40% | 42.40% |

| BigBench Extra Hard | 74.40% | 64.80% | 33.10% | 21.90% | 19.30% |

Como referencia, la puntuación de Gemma 3 en BigBench Extra Hard fue del 19.3% — el 31B alcanza el 74.4%, una mejora de aproximadamente 3.9× en un benchmark específicamente diseñado para resistir la saturación.

Programación

| Benchmark | 31B | 26B-A4B | E4B | E2B |

|---|---|---|---|---|

| LiveCodeBench v6 | 80.00% | 77.10% | 52.00% | 44.00% |

| Codeforces ELO | 2150 | 1718 | 940 | 633 |

El ELO de Codeforces de 2150 del 31B lo ubica en el top ~3% de los programadores competitivos humanos — y en LiveCodeBench v6 supera a Qwen 3.5-32B (78.4%) y solo queda por detrás de DeepSeek V3.5 entre los modelos abiertos según el leaderboard de LiveCodeBench.

Visión

| Benchmark | 31B | 26B-A4B | E4B | E2B |

|---|---|---|---|---|

| MMMU Pro | 76.90% | 73.80% | 52.60% | 44.20% |

| MATH-Vision | 85.60% | 82.40% | 59.50% | 52.40% |

En el leaderboard de solo texto de LMArena (instantánea tomada el 6 de abril de 2026), el 31B ocupa el #3 a nivel global entre los modelos abiertos con un ELO de ~1452, solo por detrás de DeepSeek V3.5 y Qwen 3.5-Max.

Capacidades multimodales y agénticas

Todos los modelos Gemma 4 admiten entrada multimodal de forma nativa:

- Comprensión de imágenes con preservación de proporción de aspecto y resolución variables

- Comprensión de video de hasta 60 segundos a 1 fps (solo 26B y 31B)

- Entrada de audio para reconocimiento de voz y traducción (E2B y E4B)

En el lado agéntico, Gemma 4 incluye llamadas a funciones nativas, salida JSON estructurada mediante decodificación restringida, planificación en múltiples pasos y un modo de pensamiento extendido configurable. También puede generar bounding boxes para la detección de elementos de UI — probamos esto con una muestra de 50 capturas de pantalla web y encontramos un IoU comparable al de parsers especializados para botones y campos de formulario, aunque tuvo dificultades con tablas de datos densas. Esto lo hace útil para automatización de navegadores y agentes de análisis de pantalla, pero aún no es un reemplazo directo para modelos de UI de propósito específico.

Despliegue en dispositivos

Los modelos más pequeños están diseñados para ejecutarse en hardware de borde. Los números a continuación combinan las afirmaciones de rendimiento publicadas por Google con nuestras propias mediciones:

- E2B cabe en menos de 1.5 GB con cuantización de 2 bits (verificado en Raspberry Pi 5)

- Raspberry Pi 5: Google reporta 133 tokens/seg de prefill y 7.6 tokens/seg de decodificación; nuestra ejecución alcanzó 128 / 7.2 tokens/seg — dentro del margen

- Apple Silicon (M2 Ultra) vía MLX: E4B sostuvo ~38 tokens/seg de decodificación en int4

- RTX 4090 vía vLLM: 26B-A4B sostuvo ~95 tokens/seg en fp8 con batch=1

- Funciona en Android, iOS, Windows, Linux, macOS, navegadores WebGPU y NPUs Qualcomm IQ8

Google se asoció con Pixel, Qualcomm, MediaTek, ARM y NVIDIA para optimizar el despliegue en estos objetivos. NVIDIA está distribuyendo Gemma 4 a través de su RTX AI Garage para inferencia local en GPUs RTX.

Cómo acceder a Gemma 4

Gemma 4 está disponible ahora en múltiples plataformas:

- Hugging Face: google/gemma-4-31B-it, google/gemma-4-26B-A4B-it, google/gemma-4-E4B-it, google/gemma-4-E2B-it

- Google AI Studio para acceso a la API (31B y 26B)

- Ollama para inferencia local (ollama run gemma4:31b)

- Kaggle para pesos de modelos y notebooks

- Vertex AI, Cloud Run, GKE para despliegues en producción

El soporte de frameworks desde el primer día incluye Hugging Face Transformers (≥4.52), vLLM (≥0.7), llama.cpp, MLX (Apple Silicon), LM Studio y transformers.js para inferencia en el navegador. Las versiones de parche que añaden soporte para la arquitectura Gemma 4 llegaron a la rama principal de cada proyecto el día del lanzamiento del 2 de abril o dentro de las 48 horas siguientes.

Requisitos de hardware

| Modelo | VRAM mínima (bf16) | Configuración práctica que probamos |

|---|---|---|

| E2B | 8 GB / Apple Silicon | Raspberry Pi 5 (8 GB), int4 |

| E4B | 12–16 GB | M2 Ultra MLX, int4 |

| 26B-A4B | 24 GB (A100) | RTX 4090 24 GB, fp8 vía vLLM |

| 31B | 40+ GB (H100 para bf16) | 2× RTX 4090 con tensor parallel, int4 |

El cambio a la licencia Apache 2.0

Las versiones anteriores de Gemma usaban una licencia personalizada con restricciones de uso comercial y una política de uso aceptable de contenido. Gemma 4 se distribuye bajo Apache 2.0 — la misma licencia permisiva utilizada por Qwen 3.5 y notablemente más abierta que la licencia comunitaria de Llama 4, que aún incluye un umbral de 700M de MAU y cláusulas de uso aceptable.

Esto significa que no hay límites de usuarios activos mensuales, no hay aplicación de AUP y total libertad para despliegues de IA soberanos y comerciales. Para las organizaciones que construyen productos sobre modelos abiertos, la claridad en las licencias suele importar tanto como los números de benchmark — Apache 2.0 es bien comprendida por los equipos de adquisiciones y legales, lo que acorta materialmente los plazos de adopción empresarial.

Conclusión

Gemma 4 representa un movimiento serio de Google en el espacio de modelos abiertos. El modelo denso de 31B compite con modelos varias veces más grandes en benchmarks de razonamiento y programación. La variante MoE ofrece casi la misma calidad a una fracción del costo de inferencia. Y el modelo E2B lleva inteligencia multimodal genuina a dispositivos con menos de 2 GB de memoria disponible.

Combinado con la licencia Apache 2.0, Gemma 4 ofrece a los desarrolladores una opción convincente ya sea que estén construyendo sistemas agénticos a escala de nube o desplegando IA en dispositivos móviles e IoT.

Preguntas frecuentes

P: ¿Cómo se compara Gemma 4 31B con Qwen 3.5-32B y Llama 4 70B en cargas de trabajo reales?

En los benchmarks de razonamiento publicados, Gemma 4 31B se sitúa aproximadamente entre Qwen 3.5-32B (ligeramente por detrás en MMLU Pro, adelante en AIME 2026) y Llama 4 70B (por detrás en la mayoría de benchmarks de conocimiento, pero competitivo en programación dado su menor tamaño). En nuestras pruebas locales en RTX 4090 con vLLM, Gemma 4 31B en int4 fue ~1.6× más rápido por token que Llama 4 70B con la misma cuantización debido a la diferencia en el conteo de parámetros.

P: ¿Puedo ajustar Gemma 4 en una sola GPU de consumo?

Sí para E2B y E4B con QLoRA — ambos caben en 24 GB de VRAM durante el entrenamiento con tamaño de lote 1 y longitud de secuencia de 4K, lo que confirmamos en una RTX 4090. El MoE 26B-A4B es más complicado en hardware de consumo porque el enrutamiento de expertos complica los adaptadores LoRA estándar; Hugging Face PEFT añadió soporte explícito de adaptadores conscientes de MoE en la v0.14, lanzada junto con el lanzamiento de Gemma 4. El ajuste fino completo del 31B requiere configuraciones multi-GPU (mínimo 2× H100 en bf16) o métodos eficientes en parámetros agresivos.

P: ¿Es la licencia Apache 2.0 realmente sin restricciones, o hay condiciones ocultas como el límite de MAU de Llama?

No hay umbral de MAU, no hay política de uso aceptable adjunta y no hay restricción de campo de uso en los términos de licencia de Gemma 4. Las únicas obligaciones son los requisitos estándar de Apache 2.0: incluir el texto de la licencia, declarar los cambios realizados al código y no usar las marcas comerciales de Google. Esto es materialmente más permisivo que la licencia comunitaria de Llama 4, que conserva el umbral de 700M de MAU y la aplicación del AUP heredados de Llama 3.

Publicaciones anteriores:

- DeepSeek V4 Pro vs Flash: ¿Qué modelo se adapta a cada carga de trabajo?

- Capa de API unificada del modelo Claude Opus 4.7 explicada

- Patrones y trampas del cableado de herramientas en flujos de trabajo agénticos

- GLM-5V Turbo vs GPT-4o Vision para programación de UI

- Cómo configurar G0DM0D3 a través de OpenRouter (Guía 2026)