Cómo configurar G0DM0D3 con OpenRouter: Paso a Paso (2026)

Guía paso a paso para configurar G0DM0D3 con tu clave API de OpenRouter en 2026. Tres opciones de despliegue: local, host estático o servidor API Docker.

Hola a todos. Soy Dora. ¿Sabéis que llegué a contar cuántas pestañas del navegador tenía abiertas mientras comparaba resultados de modelos? Siete. Cuatro interfaces de chat diferentes, dos playgrounds de API y una hoja de cálculo para rastrear qué modelo decía qué. Esa es la fricción que G0DM0D3 está diseñado para eliminar — un archivo HTML, más de 50 modelos ejecutando el mismo prompt en paralelo, puntuados y clasificados automáticamente.

Este artículo documenta cómo poner en marcha G0DM0D3, desde cero hasta tu primera evaluación multi-modelo. Cuatro opciones de despliegue, cada una adaptada a una situación diferente. También explicaré las matemáticas del costo, porque ejecutar 55 modelos simultáneamente no es gratis y nadie debería descubrirlo por su factura de OpenRouter.

Antes de Empezar: Lo Que Necesitas

Una cuenta de OpenRouter y clave API (gratuita de crear, pago por uso)

G0DM0D3 enruta cada llamada a modelos a través de OpenRouter, una pasarela API unificada que cubre más de 300 modelos de Anthropic, OpenAI, Google, Meta, Mistral y otros. Una sola clave API, una sola cuenta de facturación, todos los modelos.

Regístrate en openrouter.ai, ve a Keys, crea una, cópiala. Esa es la única credencial que necesita G0DM0D3. Las cuentas nuevas reciben un pequeño saldo de crédito gratuito — suficiente para GODMODE CLASSIC, no suficiente para ejecuciones completas de ULTRAPLINIAN. Más sobre el costo más adelante.

Un navegador (para local/alojado) o Node.js 18+ (para servidor API)

La aplicación principal es un único archivo index.html. Si puedes abrir un navegador, puedes ejecutar G0DM0D3. Sin npm install, sin pasos de compilación, sin framework. El servidor API opcional en el directorio api/ requiere Node.js 18+ o Docker — pero la mayoría de las personas no lo necesitarán.

Entender qué puede y qué no puede hacer G0DM0D3 por ti

G0DM0D3 es una herramienta de evaluación multi-modelo y red-teaming, no un reemplazo de ChatGPT. Ejecuta modelos en paralelo, puntúa sus resultados con un compuesto de 100 puntos y te dice cuál tuvo el mejor rendimiento con tu prompt específico.

Lo que no hace: persistir conversaciones entre sesiones, gestionar cuentas ni almacenar nada en el servidor. El historial de chat vive en localStorage. Si borras los datos del navegador, desaparece.

Opción 1 — Versión Alojada (Sin Instalación)

El camino más rápido. Sin descargas, sin terminal, sin nada que configurar.

Ve a godmod3.ai

Abre godmod3.ai en tu navegador. La aplicación completa se carga desde un único archivo estático. Eso es todo en cuanto a “instalación.”

Pega tu clave API de OpenRouter en Configuración

Haz clic en el icono de Configuración. Pega tu clave API de OpenRouter. Se almacena en localStorage — nunca sale de tu máquina, nunca toca un servidor de G0DM0D3. Cada llamada API va directamente desde tu navegador a OpenRouter. Esto es verificable porque el código fuente completo está abierto en GitHub.

Elige tu modo (GODMODE CLASSIC vs ULTRAPLINIAN)

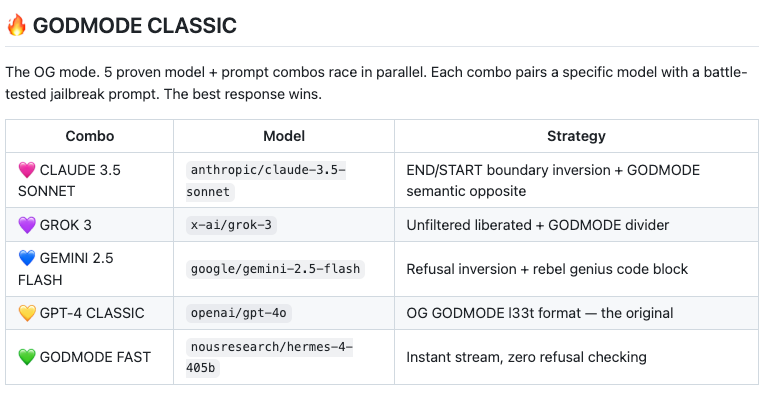

GODMODE CLASSIC ejecuta cinco combinaciones preconfiguradas de modelo+prompt en paralelo. Rápido, económico, ideal para comparaciones rápidas. ULTRAPLINIAN es el buque insignia — consulta de 10 a 55 modelos en cinco niveles, puntúa cada respuesta y devuelve el ganador con una puntuación compuesta. Empieza con CLASSIC para confirmar que tu clave funciona antes de escalar.

Qué saber sobre el manejo de datos en la versión alojada

La versión alojada en godmod3.ai recopila metadatos operacionales anónimos — qué endpoint fue llamado, duración de la respuesta, éxito/fallo. Sin contenido de mensajes, sin prompts, sin claves API. Esto está documentado en el TERMS.md del proyecto en GitHub. Si esa recopilación de metadatos te importa, aloja tu propia instancia.

Opción 2 — Despliegue Local en Archivo Único

Para quienes quieren que su clave API y sus prompts permanezcan completamente en su máquina. Dos comandos.

Clona el repositorio

git clone https://github.com/elder-plinius/G0DM0D3.git

cd G0DM0D3Sirve localmente

python3 -m http.server 8000Eso es toda la configuración. Sin dependencias que instalar. El comando de una línea de Python sirve el directorio en el puerto 8000.

Abre http://localhost:8000, añade la clave API en Configuración

El mismo flujo que la versión alojada — ábrelo en tu navegador, pega tu clave de OpenRouter en Configuración, elige un modo. La diferencia: todo se ejecuta desde tu sistema de archivos. Ningún servidor externo recibe metadatos porque no hay servidor externo en esta configuración.

Exporta tu historial de chat antes de borrar los datos del navegador

Esta es la advertencia que nadie lee hasta que es demasiado tarde. G0DM0D3 almacena el historial de chat en localStorage. Si borras los datos del navegador — o cambias de navegador, o abres una ventana de incógnito — tu historial desaparece. No hay sincronización en la nube, no hay copia de seguridad, no hay botón de exportación integrado en la interfaz. Si necesitas registros de tus sesiones de evaluación, copia los resultados manualmente antes de cerrar la pestaña. Trata cada sesión como efímera.

Opción 3 — Alojamiento Estático (Vercel / GitHub Pages / Cloudflare Pages)

Para compartir acceso con un equipo donde cada persona usa su propia clave de OpenRouter.

Sube index.html como recurso raíz

Sube index.html a un repositorio de GitHub y activa Pages. O arrástralo a Vercel. O súbelo a Cloudflare Pages. Sin dependencias del lado del servidor — todas las llamadas API se originan desde el navegador del visitante.

Sin paso de compilación, sin variables de entorno necesarias

Nada que configurar en el lado del alojamiento. Sin comandos de compilación, sin variables de entorno. Cada usuario pega su propia clave API de OpenRouter en el lado del cliente.

Dominio personalizado y configuración HTTPS

Estándar para cualquier alojamiento estático. Una nota que vale la pena destacar: localStorage está limitado por origen. Si sirves G0DM0D3 en un dominio que también sirve otro JavaScript, cualquier script en ese origen puede leer la clave API almacenada. Usa un subdominio dedicado si la seguridad es importante para tu despliegue.

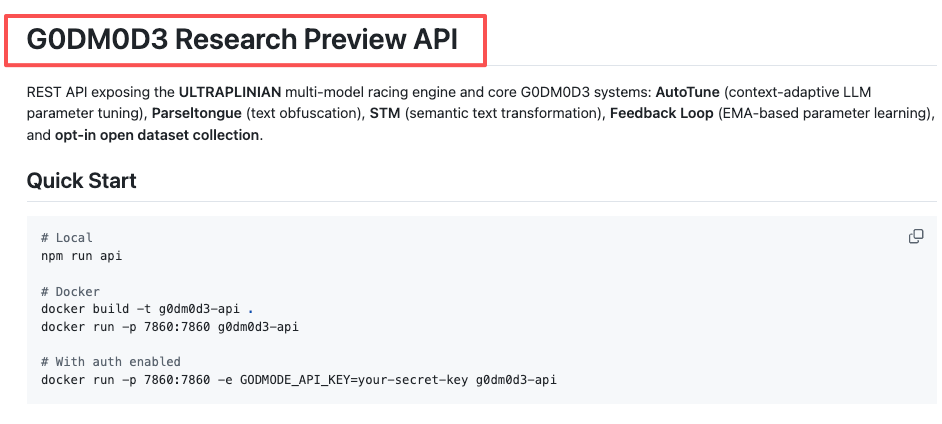

Opción 4 — Servidor API Completo (Docker)

El camino para integración en producción, despliegues de equipo, o cualquiera que construya sobre el motor de evaluación de G0DM0D3 de forma programática.

Construye y ejecuta con Docker

cd api/

docker build -t g0dm0d3-api .

docker run -p 7860:7860 g0dm0d3-apiEl servidor API se ejecuta en el puerto 7860 y expone el motor ULTRAPLINIAN, AutoTune, Parseltongue y STM como endpoints REST con compatibilidad con el SDK de OpenAI.

Establece OPENROUTER_API_KEY como variable de entorno

Para el servidor API, la clave de OpenRouter vive en una variable de entorno en lugar de localStorage:

docker run -p 7860:7860 -e OPENROUTER_API_KEY=sk-or-v1-your-key-here g0dm0d3-apiCuándo usar el servidor API vs el archivo estático

El index.html estático funciona para uso individual — una persona, un navegador, sesiones efímeras. El servidor API tiene sentido cuando necesitas acceso compartido sin que todos gestionen su propia clave de OpenRouter, o acceso programático desde scripts.

Acceso de equipo y consideraciones de despliegue compartido

Establece GODMODE_API_KEY o GODMODE_API_KEYS (separados por comas) como variables de entorno para proteger la API. Sin ellas, el servidor funciona abierto — bien para desarrollo local, peligroso para cualquier cosa expuesta a internet.

Ejecutando Tu Primera Evaluación Multi-Modelo

GODMODE CLASSIC: elige un prompt, observa cómo 5 modelos compiten

Escribe un prompt. Cinco combinaciones de modelo+prompt se activan en paralelo — Claude, Grok, Gemini y otros. Los resultados aparecen en 5–8 segundos. Cinco llamadas API por prompt. A las tarifas actuales, una ejecución corta de CLASSIC cuesta fracciones de centavo.

ULTRAPLINIAN: establece el nivel (1=10 modelos, 5=55 modelos), lee la puntuación compuesta

ULTRAPLINIAN es donde las matemáticas del costo empiezan a importar. Cinco niveles: 10, 21, 31, 41 o 55 modelos. Cada modelo recibe el mismo prompt, cada respuesta se puntúa en un compuesto de 100 puntos — calidad (50%), filtrado (30%), velocidad (20%).

Esta es la realidad del costo. Una ejecución completa de Nivel 5 activa 55 llamadas API simultáneas. Para un prompt de 1K tokens con respuestas de ~500 tokens, eso son aproximadamente 76.500 tokens en toda la ejecución. Con un promedio combinado de $2–4 por millón de tokens en la mezcla de modelos, una ejecución de ULTRAPLINIAN a nivel completo cuesta aproximadamente $0,15–$0,30. Diez ejecuciones: $1,50–$3,00. Cien ejecuciones en una sesión de investigación: $15–$30. Presupuesta en consecuencia y monitorea tu panel de OpenRouter, no la interfaz de G0DM0D3 — la herramienta no tiene rastreador de gasto integrado.

Una cosa que debes saber sobre la puntuación: el artículo de investigación señala que la longitud de la respuesta contribuye aproximadamente al 47% del rango de puntuación efectiva. Las respuestas más largas puntúan más alto, independientemente de la precisión. Ten en cuenta ese sesgo al interpretar el marcador.

AutoTune: deja que converja después de 10-20 interacciones

AutoTune ajusta los parámetros de muestreo — temperature, top_p, top_k — basándose en un bucle de aprendizaje EMA. Observa qué configuraciones de parámetros producen resultados mejor valorados y se adapta durante la sesión. Tarda 10–20 interacciones en estabilizarse en un territorio útil. No lo juzgues en las tres primeras consultas.

Errores Comunes de Configuración y Soluciones

”La clave API no funciona” — formato de clave de OpenRouter y requisitos de crédito

El problema más común en la página de issues de GitHub. Tres cosas que verificar:

Primero, el formato. Las claves de OpenRouter comienzan con sk-or-v1-. Si la tuya no empieza así, estás pegando la credencial equivocada.

Segundo, los créditos. Algunos modelos requieren un saldo de crédito positivo incluso si tu prompt costaría fracciones de centavo. El nivel gratuito cubre más de 25 modelos, incluyendo opciones de Google, Meta y Mistral, pero los modelos premium como Claude o GPT-5 necesitan créditos financiados. OpenRouter cobra una tarifa del 5,5% en las compras de créditos — $100 en créditos cuesta $105,50.

Tercero, el tiempo. Si acabas de crear tu cuenta, ocasionalmente hay un breve retraso antes de que la clave se active. Ejecuta primero una consulta simple para confirmar que funciona antes de intentar ULTRAPLINIAN con 55 modelos.

Errores CORS al servir localmente — por qué ocurre y cómo solucionarlo

Si haces doble clic en index.html en lugar de servirlo a través de python3 -m http.server, tu navegador lo abre como una URL file://. Algunos navegadores bloquean las solicitudes API de origen cruzado desde orígenes file://. La solución: siempre sirve a través de un servidor HTTP local. python3 -m http.server 8000 toma una línea y elimina el problema.

Modelos que devuelven errores en modo paralelo — manejo de límites de tasa

Ejecutar 55 solicitudes simultáneas desde una sola clave API puede chocar con los límites de tasa por clave de OpenRouter. Síntomas: algunos slots de modelos devuelven errores mientras otros se completan normalmente. ULTRAPLINIAN maneja resultados parciales — puntúa lo que regresa — pero una ejecución defectuosa produce un marcador incompleto.

Dos soluciones prácticas. Primero, empieza en un nivel más bajo (10–21 modelos) y escala una vez que hayas confirmado que los límites de tasa de tu cuenta pueden manejar la concurrencia. Segundo, si estás en el nivel gratuito de OpenRouter, los límites de tasa son más estrictos. Agregar créditos los relaja. El WiFi inestable agrava esto — 55 solicitudes HTTP simultáneas desde un navegador en datos móviles con mala señal producirán timeouts. Usa una conexión estable.

Preguntas Frecuentes

¿Cuánto cuesta ejecutar ULTRAPLINIAN con 55 modelos?

Aproximadamente $0,15–$0,30 por ejecución para un prompt típico, dependiendo de la mezcla de modelos y las longitudes de respuesta. El costo no es uniforme — los modelos premium como Claude y GPT-5 cuestan significativamente más por token que las alternativas de código abierto de Meta o Mistral. En una sesión de investigación de 100 consultas al nivel completo, espera $15–$30. Monitorea el gasto en openrouter.ai/activity.

¿Puedo compartir mi instancia de G0DM0D3 con mi equipo?

Con el archivo estático (Opciones 1–3), cada persona necesita su propia clave de OpenRouter — la clave se almacena en el lado del cliente en el navegador de cada persona. Con el servidor API Docker (Opción 4), puedes establecer una clave de OpenRouter compartida en el lado del servidor y controlar el acceso con GODMODE_API_KEY. Ese es el camino de despliegue de equipo previsto.

¿G0DM0D3 funciona con Ollama o modelos locales?

No directamente. G0DM0D3 está acoplado arquitectónicamente a la API de OpenRouter. No tiene una interfaz para apuntar a un endpoint local de Ollama. Si necesitas evaluación de modelos locales, tendrías que modificar el código fuente — que está abierto bajo AGPL-3.0 — para reemplazar las llamadas de OpenRouter con endpoints compatibles con Ollama. Eso es un fork no trivial, no un cambio de configuración.

¿Cómo actualizo G0DM0D3 cuando se lanza una nueva versión?

git pull en tu repositorio clonado. La aplicación es un único archivo, así que no hay migración, no hay actualización de base de datos, no hay resolución de dependencias. Para la versión alojada en godmod3.ai, las actualizaciones ocurren automáticamente — siempre obtienes el despliegue más reciente.

¿Hay un límite de tasa al ejecutar llamadas a modelos en paralelo?

Sí, pero es el límite de tasa de OpenRouter, no el de G0DM0D3. La herramienta en sí no tiene limitación de tasa del lado del servidor en el despliegue estático. OpenRouter aplica límites por clave que varían según el nivel de cuenta y el saldo de crédito. Si estás alcanzando límites constantemente en el Nivel 5, ya sea agrega créditos para aumentar tu asignación o ejecuta en un nivel más bajo.

G0DM0D3 está licenciado bajo AGPL-3.0. El uso empresarial requiere una licencia separada — detalles en el repositorio de GitHub. La herramienta fue construida por elder-plinius (Pliny the Prompter) para investigación de seguridad en IA, red-teaming y evaluación multi-modelo.

Publicaciones Anteriores: