WAN 2.7 vs WAN 2.6: Funktionsvergleich & Upgrade-Entscheidung

WAN 2.7 vs WAN 2.6 im Vergleich: neue Funktionen, API-Änderungen und ein Entscheidungsleitfaden für Teams, die WAN bereits im Produktionseinsatz betreiben.

Hallo zusammen, ich bin Dora. Ich beobachte die WAN-Modell-Familie schon eine Weile durch ihre Versionszyklen – nicht mit Begeisterung, sondern mit der Aufmerksamkeit, die man Infrastrukturentscheidungen widmet, die schwer rückgängig zu machen sind. WAN 2.7 ist für März 2026 geplant, und die Funktionsliste ist bemerkenswert genug, um genau darzulegen, was sich ändert, was gleich bleibt und wo die Unsicherheit noch besteht – bevor du irgendetwas in der Produktion anfasst.

30-Sekunden-Entscheidung (Zuerst lesen)

Jetzt upgraden, wenn du Folgendes brauchst:

- Steuerung von erstem und letztem Frame in einem einzelnen Clip (strukturelle Szenenkontrolle, nicht nur Animationsanker)

- Multi-Bild-Eingabe über 9-Raster-Layout für reichhaltigere I2V-Kompositionen

- Bearbeitung bestehender Videos per Anweisung in natürlicher Sprache – Hintergrund, Beleuchtung oder Kleidung ändern, ohne neu zu generieren

- Bis zu 5 gleichzeitige Videoreferenzen (2.6 ist auf weniger begrenzt; 2.7 erweitert dies erheblich)

- Kombinierte Subjekt- und Sprachreferenz in einem einzigen Durchlauf (R2V verbessert)

Auf 2.6 bleiben, wenn du Folgendes brauchst:

- Eine stabile, dokumentierte API mit getesteten Produktionsverhalten

- Selbst gehostete Deployments – der Open-Weight-Status von WAN 2.7 ist noch nicht bestätigt

- Budgetklarheit – die Preise für 2.7 wurden zum Zeitpunkt der Erstellung dieses Artikels noch nicht veröffentlicht

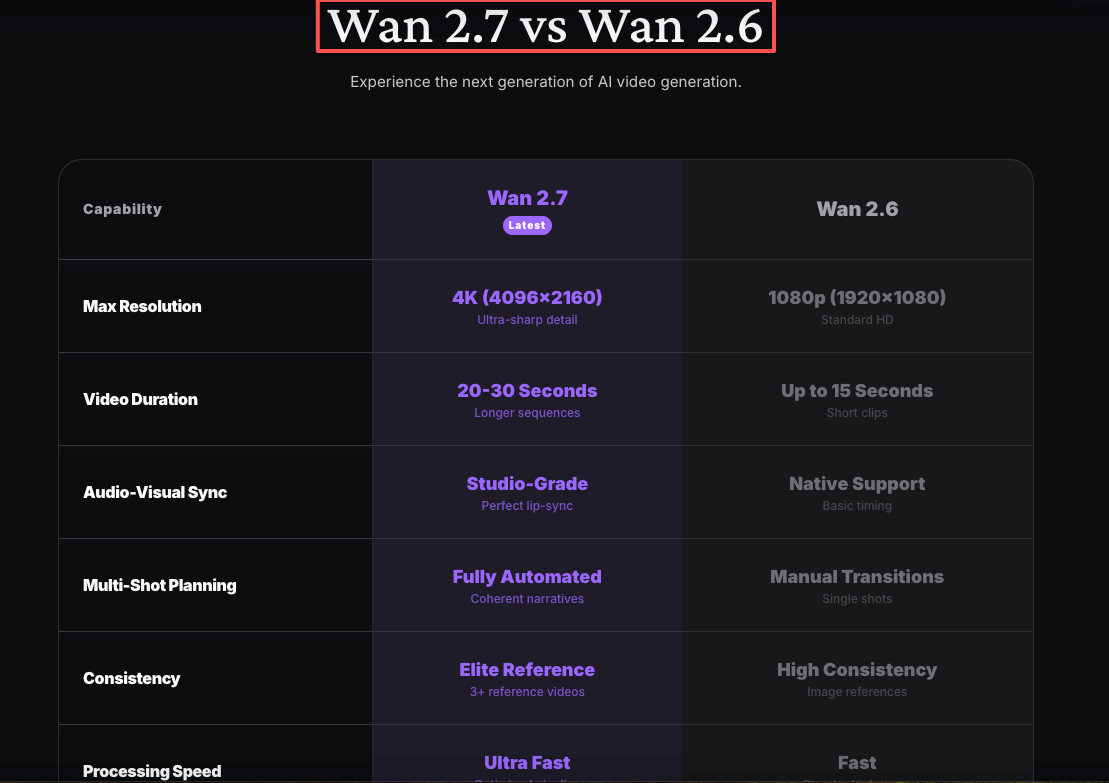

Funktionsvergleichstabelle

Steuerung von erstem/letztem Frame: 2.6 vs. 2.7

WAN 2.6 führte grundlegendes First-Frame-Anchoring für I2V ein. WAN 2.7 fügt Last-Frame-Steuerung hinzu, sodass beide Endpunkte eines Clips definiert werden können. Für Teams, die narrative Sequenzen oder Loop-Inhalte erstellen, ist dies der Unterschied zwischen dem Beschreiben von Bewegung und dem tatsächlichen Komponieren. Das Modell leitet die Trajektorie zwischen den beiden Keyframes ab.

Dies hat reale Auswirkungen auf den Workflow: Anstatt mehrere Kandidaten zu generieren und zu hoffen, dass einer beim gewünschten Ende landet, wird der Ausgaberaum von beiden Seiten eingeschränkt.

Multi-Eingabe I2V (9-Raster): Neu in 2.7

Dies ist das strukturell neuartigste Feature in 2.7. Anstelle eines einzelnen Referenzbildes akzeptiert das 9-Raster-Layout eine 3×3-Anordnung von Bildern – wodurch Mehrwinkel-Referenzen, sequenzielle Posen oder Szenenvarianten in eine einzige I2V-Generierung einfließen können. Das Modell nutzt diesen strukturierten visuellen Input, um die Szenenzusammensetzung zu verbessern und Drift zu reduzieren.

Ob dies in der Praxis gut-gepromptetes Single-Image-I2V bedeutsam übertrifft, möchte ich direkt testen. Die Architektur ist interessant. Das reale Delta muss gemessen werden.

Sprachreferenz: R2V in 2.6 → Verbessert in 2.7

WAN 2.6 führte Reference-to-Video mit Spracheingabe ein. WAN 2.7 verfeinert dies zu einer kombinierten Subjekt- und Sprachreferenz – einem einzigen Workflow, der sowohl das Erscheinungsbild einer Figur als auch die Sprachrichtung gleichzeitig verankert. Für Teams, die virtuelle Präsentatoren oder figuren-geführte Inhalte in großem Maßstab erstellen, reduziert dies die Anzahl der Pipeline-Schritte erheblich. Mehr zur übergeordneten audiovisuellen Sync-Architektur dieser Familie ist in Alibabas Wan-Modell-Forschung auf Hugging Face nachzulesen.

Anweisungsbasierte Bearbeitung: Neu in 2.7

Dies ist das Feature, das 2.7 qualitativ anders fühlen lässt als ein reines Generierungsmodell. Du kannst ein vorhandenes Video zusammen mit einer Anweisung in natürlicher Sprache übergeben („Hintergrund in eine regengetränkte Straße ändern”, „Jacke auf Rot wechseln”) und erhältst eine bearbeitete Ausgabe statt einer neuen Generierung.

Das hat operationelle Bedeutung: Iterationszyklen, die bisher eine Neugenerierung erforderten, können jetzt als leichtgewichtige Bearbeitungen durchgeführt werden. Es bedeutet auch, dass sich deine Prompt-Strategie verschiebt – du wirst Bearbeitungsanweisungen schreiben, keine Generierungs-Prompts.

Ausgabeauflösung & Dauer

Sowohl 2.6 als auch 2.7 unterstützen bis zu 1080P und bis zu 15 Sekunden. Keine Änderung hier. Wenn Auflösung oder Dauer deine primären Einschränkungen waren, erweitert diese Version diese Grenzen nicht.

Anzahl der Videoreferenzen (bis zu 5 in 2.7)

WAN 2.6 unterstützt einzelne oder doppelte Videoreferenzen für Subjektkonsistenz. WAN 2.7 erhöht dies auf fünf gleichzeitige Referenzen, nützlich für Multi-Charakter-Szenen oder Produktions-Workflows, die eine strikte Markenkonsistenz über Referenz-Assets hinweg erfordern.

API-Änderungen für Entwickler

Neue Parameter / Payload-Struktur

Der 9-Raster-Input und die anweisungsbasierte Bearbeitung erfordern mit ziemlicher Sicherheit neue Payload-Felder – Bild-Array-Strukturen, einen edit_instruction-Parameter und möglicherweise einen eigenen Endpunkt oder Mode-Flag. Bis die offiziellen API-Docs veröffentlicht werden, sollte jede Drittanbieter-Parameterspekulation als vorläufig behandelt werden. Das WAN-Modell GitHub-Repository war historisch gesehen der erste Ort, an dem das Team von Alibaba Schema-Änderungen für Open-Weight-Releases dokumentiert.

Endpunkt- und Modell-ID-Änderungen

Erwarte eine neue Modell-ID (z. B. wan-2.7-i2v, wan-2.7-edit), die sich von wan-2.6-i2v unterscheidet. Plattformen wie fal.ai, die gehostete Inferenz anbieten, veröffentlichen Endpunktverfügbarkeit typischerweise innerhalb weniger Tage nach einem offiziellen Release – es lohnt sich, deren Changelog direkt zu verfolgen.

Abwärtskompatibilität mit WAN 2.6-Workflows

Standard-I2V- und T2V-Payloads (einzelne Bildeingabe, Text-Prompt, Auflösung, Dauer) sollten strukturell kompatibel sein. Die neuen Features erscheinen additiv und nicht brechend. Dennoch sollte nicht davon ausgegangen werden, dass das Prompt-Verhalten identisch ist – Anpassungen beim Instruction-Following-Tuning bedeuten, dass für 2.6 kalibrierte Prompts in 2.7 andere Ergebnisse liefern können, selbst ohne Payload-Änderungen.

Qualität & Leistung: Was die Beweise zeigen

Behauptungen zur visuellen Wiedergabetreue

Pre-Release-Materialien beschreiben Verbesserungen bei Schärfe, Farbgenauigkeit und Detailerhaltung. Diese Aussagen werde ich nicht als Fakten wiederholen – das ist genau die Art von Behauptung, die Benchmark-Daten erfordert. Sobald offizielle Benchmarks veröffentlicht werden, sollte ein Abgleich mit eigenen repräsentativen Prompts erfolgen. Aggregierte Scores erfassen selten die Edge-Case-Fehlermodi, die für spezifische Workflows am wichtigsten sind.

Verbesserungen der Audio-Synchronisation

WAN 2.5 führte native Audiogenerierung ein. WAN 2.6 verfeinerte sie. WAN 2.7 behauptet weitere Verbesserungen bei der audiovisuellen Synchronisation. Der fal.ai-Blog zur Audio-Architektur von WAN 2.5 bietet nützlichen Kontext dazu, wie sich die Sync-Pipeline entwickelt hat – lesenswert, bevor die Behauptungen von 2.7 mit eigenem Testaudio bewertet werden.

Bewegungskonsistenz

Beschrieben als flüssiger und physikalisch plausibler als 2.6. Dies ist die schwierigste Qualitätsbehauptung, die ohne eigene Clips zu bewerten ist. Bewegungskonsistenz verschlechtert sich unvorhersehbar bei Edge Cases – ungewöhnliche Kamerawinkel, schnelle Bewegungen, komplexe Hintergründe. Die eigenen spezifischen Anwendungsfälle testen, nicht generische Demos.

Kostenauswirkungen des Upgrades

Neue Feature-Kostenstruktur

9-Raster-I2V und anweisungsbasierte Bearbeitung werden mit ziemlicher Sicherheit andere Kostenprofile als die Standard-I2V-Generierung haben. Multi-Input-Inferenz ist rechenintensiver. Entsprechend budgetieren, aber keine endgültigen Projektionen festlegen, bis die Preise live sind.

Rechenkosten: 9-Raster vs. Single I2V

Neun Referenzbilder versus eines ist eine bedeutende Zunahme bei der Eingabeverarbeitung. Bei hochvolumigen automatisierten Pipelines diese Annahme in Kostenschätzungen einmodellieren, bevor migriert wird: 9-Raster kostet wahrscheinlich mehr pro Generierung als Single-Image-I2V bei gleicher Auflösung und Dauer.

Migrations-Checkliste für Teams, die bereits WAN 2.5/2.6 verwenden

- Bestehende Payloads auf fest codierte Modell-IDs prüfen – bei Verfügbarkeit auf 2.7-Endpunkt aktualisieren

- Die 10 am häufigsten verwendeten Prompts vor der vollständigen Migration gegen 2.7 testen

- Anweisungsbasierte Bearbeitung für Workflows evaluieren, die derzeit Neugenerierung für Iteration verwenden

- 9-Raster-Eingabeformat gegen die bestehende Bild-Pipeline prüfen

- ComfyUI-Node-Migration zurückhalten, bis von der Community verifizierte 2.7-Nodes veröffentlicht sind

- Preise mit dem Inferenzanbieter bestätigen, bevor neue Feature-Nutzung skaliert wird

- 2.6-Workflows nicht deprecaten, bis die API-Stabilität von 2.7 in der Produktion bestätigt ist

FAQ

- Kann ich WAN 2.7 und WAN 2.6 mit demselben API-Key aufrufen? Mit ziemlicher Sicherheit ja, wenn ein gehosteter Inferenzanbieter verwendet wird – die Modellauswahl erfolgt pro Anfrage. Beim spezifischen Anbieter bestätigen.

- Sind WAN 2.6-Prompts mit 2.7 kompatibel? Strukturell wahrscheinlich ja. Verhaltenstechnisch nicht garantiert. Instruction-Following-Tuning verschiebt sich zwischen Versionen. WAN 2.6-Prompts als Ausgangspunkte betrachten, nicht als fertige Assets.

- Ändert 2.7 die Art, wie Bildeingaben für I2V strukturiert werden? Standard-Single-Image-I2V: wahrscheinlich keine Änderung. 9-Raster: völlig neue Struktur. Beide Pfade separat in der Codebasis dokumentieren.

- Was passiert mit meinen WAN 2.5 ComfyUI-Workflows? WAN 2.7-Nodes werden erst existieren, wenn Community-Mitwirkende sie nach dem Release veröffentlichen. Der ComfyUI-Blog war historisch gesehen der schnellste Ort, um verifizierte Partner-Nodes für neue Wan-Releases zu finden.

- Ist WAN 2.7 für Self-Hosting verfügbar? Zum Zeitpunkt der Erstellung unbekannt. Die Wan-Familie war uneinheitlich – einige Versionen wurden unter Apache 2.0 als Open Weights veröffentlicht, andere nur über proprietäre API. Bestätigen, bevor ein Self-Hosting-Plan für 2.7 erstellt wird.

Fazit

WAN 2.7 ist eine bedeutsame Version, wenn die Arbeit Iteration, Charakterkonsistenz oder Multi-Input-Komposition umfasst. Anweisungsbasierte Bearbeitung verschiebt das Modell von einem Generierungswerkzeug zu etwas, das eher einer Video-Editing-Pipeline ähnelt – was verändert, wie Workflows strukturiert werden, nicht nur welche Prompts geschrieben werden.

Was es nicht ist: ein Grund zur sofortigen Migration. API-Details sind nicht abgeschlossen, Preise sind nicht veröffentlicht, und Qualitätsbehauptungen müssen gegen tatsächlichen Produktionsinhalt validiert werden. Die 2.7-Evaluierung in den Sprint einplanen, sobald die Dokumentation verfügbar ist, parallel zu 2.6 ausführen und die Migrationsentscheidung auf Basis von Daten treffen – nicht mit Begeisterung am Release-Tag.

Ein WAN 2.7 API-Schnellstart wird folgen, sobald die offizielle Dokumentation live ist – mit Payload-Struktur, dem 9-Raster-Eingabeformat und einem funktionierenden Anweisungsbearbeitungsbeispiel für Teams, die bereits 2.6 in der Produktion verwenden.

Vorherige Beiträge:

- Sehen Sie, wie Sora sich in echten Workflows mit anderen Videogenerierungsmodellen vergleicht

- Praktische Anwendungsfälle für SkyReels V4 in Produktions-Pipelines erkunden

- Verstehen, wie konsistente Charaktere über KI-Videogenerierungen hinweg erstellt werden

- Erfahren Sie, wie Produktbilder in vollständige KI-generierte Video-Ads umgewandelt werden

- Eine Übersicht über Z-Image-Referenz-Workflows für Multi-Bild-Generierung erhalten