WAN 2.7 Anweisungsbasierte Videobearbeitung: Leitfaden

WAN 2.7 bietet anweisungsbasierte Videobearbeitung. Was es ist, was Sie bearbeiten können, wie es in eine Produktionspipeline passt und was Entwickler wissen müssen.

Hallo zusammen. Ich bin Dora. Ich arbeite schon eine Weile mit KI-Video-Tools, und als ich zum ersten Mal von der WAN 2.7-Funktion zur anweisungsbasierten Bearbeitung hörte, war ich nicht sofort überzeugt, dass sie viel verändern würde. Videos mit Textbefehlen zu bearbeiten klang nach einer dieser Funktionen, die in einer Demo gut aussieht, aber in der Praxis auseinanderfällt.

Ich gebe zu, ich lag teilweise falsch.

Was anweisungsbasierte Videobearbeitung in WAN 2.7 bedeutet

Du nimmst einen bestehenden Videoclip, schreibst auf, was du geändert haben möchtest, und das Modell passt genau dieses Element an, während alles andere erhalten bleibt. Keine Neugenerierung. Eine Bearbeitung.

Unterschied zur Standard-Text-zu-Video-Generierung

Text-zu-Video beginnt bei null. Du schreibst einen Prompt und bekommst, was dabei herauskommt.

Anweisungsbasierte Bearbeitung beginnt mit etwas, das bereits existiert. Der Clip ist da. Das Timing ist festgelegt. Du bittest das Modell, ein einziges Element zu ändern – den Hintergrund tauschen, die Beleuchtung verschieben, ein Outfit umfärben – ohne den Rest zu berühren.

Die Analyse von WaveSpeedAI stellt fest, dass dies operativ wichtig ist: Iterationszyklen, die früher das Neugenerieren von Clips von Grund auf erforderten, können nun als leichtgewichtige Bearbeitungen abgewickelt werden. Neu zu generieren, weil die Jackenfarbe falsch war, fühlte sich verschwenderisch an. Nur die Jacke zu bearbeiten fühlte sich richtig an.

Unterschied zur Video-Nachbildung

Bei der Nachbildung wird die Bewegungsstruktur eines Referenzvideos übernommen und auf neue Motive oder Stile angewendet. Bewegungsübertragung.

Anweisungsbasierte Bearbeitung modifiziert. Der Originalclip bleibt erhalten; nur das von dir angegebene Element ändert sich.

Was das Modell als Eingabe erhält

Zwei Dinge: das Quellvideo (bis zu 15 Sekunden bei 1080P) und eine Anweisung in natürlicher Sprache.

Was mich überraschte: kein Masking, keine Ebenenabgrenzung. Nur der Clip und der Satz.

Was du mit Anweisungen bearbeiten kannst und was nicht

Unterstützte Bearbeitungskategorien

Aus Tests und der Plattformdokumentation von Dzine bewältigt die anweisungsbasierte Bearbeitung:

- Hintergrundwechsel (Innenraum zu Außenbereich, sonnig zu regnerisch)

- Beleuchtungsverschiebungen (goldene Stunde zu blauer Stunde)

- Objektbezogene Anpassungen (Hemdfarbe ändern, Requisiten hinzufügen)

- Stilmodifikationen (realistisch zu illustriert)

Diese funktionieren, weil es begrenzte Änderungen sind. Das Modell weiß, was ein Hintergrund ist, was Beleuchtung bewirkt.

Was sich anweisungsbasierter Bearbeitung widersetzt

Komplexe räumliche Umstrukturierungen funktionieren nicht gut. „Bewege den Charakter nach links” lieferte keine sauberen Ergebnisse. Der Charakter blieb an Ort und Stelle, oder die Komposition verschob sich ungeschickt.

Szenen mit starken Identitätsmerkmalen – spezifische Gesichtsausdrücke, feine Logodetails – widersetzen sich der Bearbeitung. Das Modell kann die Beleuchtung ändern, hat aber Schwierigkeiten, genaue Merkmale beizubehalten, wenn Ausdruck oder Alter verändert werden.

Physikalische Änderungen sind unberechenbar. „Lass das Wasser schneller fließen” funktionierte manchmal, sah manchmal aber fehlerhaft aus.

Bearbeitungsgranularität

Alle Bearbeitungen erfolgen auf Prompt-Ebene. Du beschreibst, was sich ändert; das Modell schließt daraus, auf welchen Teil das zutrifft. Noch kein objektbezogenes Targeting.

Ich habe gelernt, sehr spezifische Anweisungen zu schreiben. „Ändere die Jacke zu Rot” funktionierte besser als „Mache das Outfit wärmer in den Tönen.”

Effektive Bearbeitungsanweisungen formulieren

Was eine gute Bearbeitungsanweisung ausmacht

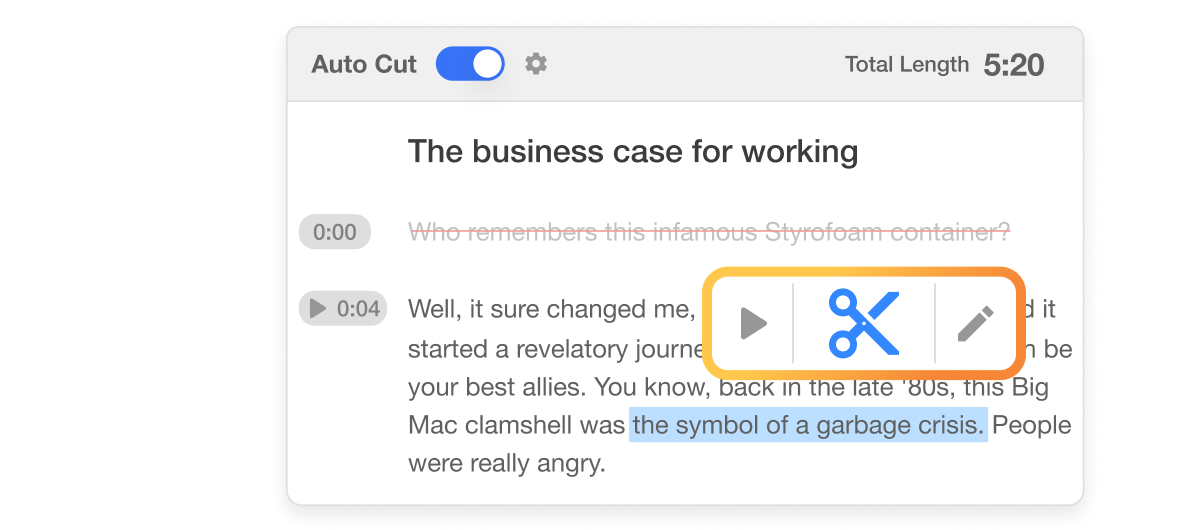

Gute Anweisungen sind spezifisch, richtungsweisend und begrenzt. Dieser Ansatz spiegelt die Philosophie hinter Tools wie Descript wider, wo du Videos einfach durch das Bearbeiten von Text bearbeiten kannst – ohne Masking oder Ebenenabgrenzung.

„Ändere den Himmel zu bedeckt mit dunklen Wolken” funktionierte konstant. Es legt fest, was sich ändert, was daraus wird, und fügt Details hinzu.

„Lass es dramatischer wirken” hingegen nicht. Zu vage. Das Modell interpretierte es jedes Mal anders.

Was eine schlechte Anweisung ausmacht

Anweisungen, die dem Quellclip widersprechen, schlagen lautlos fehl. „Entferne die Person aus der Szene” in einer charakterzentrierten Aufnahme wurde entweder ignoriert oder produzierte fehlerhafte Frames.

Anweisungen mit mehreren widersprüchlichen Elementen haben Schwierigkeiten. „Ändere die Jacke zu Blau und den Hintergrund zu einem Wald und füge Regen hinzu” versuchte drei Bearbeitungen auf einmal. Eine Bearbeitung pro Anweisung funktionierte besser. Dieses klare Prompting-Muster – festlegen, was sich ändert, und den Zielzustand beschreiben – entspricht den Best Practices, die man bei Vislas textbasierter Videobearbeitung sieht, wo du Filmmaterial durch direktes Bearbeiten des Transkripts verfeinerst.

Prompting-Muster

Das Muster, das funktionierte:

- Festlegen, was sich ändert

- Den Zielzustand beschreiben

- Unter 15 Wörtern bleiben

„Tausche den städtischen Hintergrund gegen eine Berglandschaft” – klares Objekt, klares Ziel, saubere Ergebnisse.

Eingabeanforderungen

Quellevideo-Spezifikation

Quellvideos: 2 bis 15 Sekunden, bis zu 1080P. Ich testete 5-Sekunden-Clips bei 1080P und 10-Sekunden-Clips bei 720P. Beides funktionierte.

Referenzausrichtung

Wenn deine Quelle starke Bewegungsunschärfe, schnelle Schnitte oder extreme Belichtung aufweist, verschlechtern sich die Bearbeitungsergebnisse. Das Modell benötigt klare Frames.

Schnell schwenkende Aufnahmen produzierten verwischte Hintergrundwechsel. Statische oder langsam bewegte Aufnahmen lieferten saubere Bearbeitungen.

Wo anweisungsbasierte Bearbeitung in eine Produktionspipeline passt

Ich hatte nicht erwartet, dies als primäres Tool zu verwenden. Ich erwartete, dass es eine Spielerei wäre. Ist es nicht.

Post-Generierungs-Politur-Schleife

Nach dem Generieren eines Clips mit Standard-Text-zu-Video bekam ich oft 80 % dessen, was ich wollte. Die Bewegung war richtig, der Bildausschnitt war richtig, aber die Farbgebung fühlte sich falsch an oder der Hintergrund passte nicht zum Briefing.

Vor der anweisungsbasierten Bearbeitung bedeutete das Neugenerieren mit angepassten Prompts und Hoffen. Trefferquote: vielleicht 40 %. Jede Neugenerierung dauerte 60–90 Sekunden, und ich verbrauchte oft drei oder vier Versuche, bevor ich etwas Verwendbares hatte.

Jetzt generiere ich einmal und bearbeite dann das spezifische Element, das falsch ist. Die Trefferquote liegt näher an 70 %, und die Iteration ist schneller. Statt drei vollständiger Neugenerierungen à 90 Sekunden (4,5 Minuten insgesamt) mache ich eine Generierung plus eine Bearbeitung (ungefähr 2,5 Minuten insgesamt). Die Zeitersparnis summiert sich über mehrere Projekte.

Stiliterierung ohne vollständige Neugenerierung

Ich testete dies, indem ich einen Basisclip eines durch eine Stadtstraße gehenden Charakters generierte und dann drei Stilentsprechungen mit Bearbeitungsanweisungen erstellte:

- „Wechsle zu Cyberpunk-Neon-Ästhetik”

- „Ändere zu Aquarellmalstil”

- „Mache es schwarzweißen Film-Noir”

Alle drei Bearbeitungen bewahrten die ursprüngliche Bewegung und Komposition. Nur der visuelle Stil änderte sich. Der Gehzyklus des Charakters blieb identisch. Die Kamerabewegung verschob sich nicht.

Das ist nützlich für Kundenpräsentationen, wo du Konzeptoptionen zeigen möchtest, ohne die gesamte Szene dreimal neu zu generieren. Auch nützlich für A/B-Tests von Werbemitteln, ohne Generierungsguthaben zu verbrennen.

Ich versuchte denselben Workflow mit Neugenerierung statt Bearbeitung – drei verschiedene Prompts mit eingebetteten Stil-Schlüsselwörtern. Zwei der drei kamen mit leicht unterschiedlichem Bewegungs-Timing zurück, was den Vergleich zunichte machte. Bearbeitung hielt alles vergleichbar, außer der Stilwariablen, die ich testete.

Kostenvergleich: Bearbeitung vs. Neugenerierung

Basierend auf der Kostenanalyse von WaveSpeedAI wird anweisungsbasierte Bearbeitung wahrscheinlich ein anderes Kostenprofil als Standard-Generierung haben, aber genaue Preise wurden noch nicht veröffentlicht.

Aus Workflow-Perspektive ist es selbst dann günstiger, wenn die Bearbeitung pro Sekunde genauso viel kostet wie die Generierung, weil du keine fehlgeschlagenen Versuche verwirfst. Eine Generierung plus eine gezielte Bearbeitung schlägt drei vollständige Neugenerierungen.

Die Rechnung: Wenn die Generierung $0,12/Sekunde für 1080P kostet (WAN 2.6-Preise von PiAPI), kostet ein 5-Sekunden-Clip $0,60. Drei Neugenerierungen kosten $1,80. Eine Generierung plus eine Bearbeitung – selbst wenn die Bearbeitung genauso $0,60 kostet – kostet nur $1,20. Das sind 33 % Ersparnis allein durch die Reduzierung von Verschwendung.

Wenn sich die Bearbeitung als günstiger als die Generierung herausstellt (was wahrscheinlich erscheint, da bestehende Frames modifiziert statt neue von Grund auf erstellt werden), multiplizieren sich die Einsparungen.

Auswirkungen auf den API-Zugang

Separater Endpunkt oder Parameter-Flag?

Die Analyse von WaveSpeedAI legt nahe, dass anweisungsbasierte Bearbeitung neue Payload-Felder erfordern wird – wahrscheinlich einen edit_instruction-Parameter und möglicherweise einen eigenen Endpunkt.

Ich warte auf die offizielle API-Dokumentation vor der Produktionsintegration.

Token- und Rechenkosten

Multi-Input-Inferenz ist aufwendiger als Single-Input-Generierung. Anweisungsbasierte Bearbeitung verarbeitet sowohl das Quellvideo als auch die Bearbeitungsanweisung, was höhere Rechenkosten bedeutet.

Entsprechend budgetieren, aber keine endgültigen Projektionen festlegen, bis die Preise verfügbar sind.

Async-Job-Überlegungen

Alle WAN-Operationen laufen asynchron. Anfrage einreichen, Task-ID erhalten, bis zum Abschluss abfragen.

Erwartete Wartezeit aus meinen Tests: 30 Sekunden bis 2 Minuten für eine 5-sekündige 1080P-Bearbeitung.

FAQ

Ist anweisungsbasierte Bearbeitung bei Launch über die WaveSpeed API verfügbar?

WAN 2.7 erscheint noch im März 2026. Die API-Verfügbarkeit für anweisungsbasierte Bearbeitung wurde noch nicht bestätigt. WaveSpeedAI fügt neue Endpunkte typischerweise innerhalb von Tagen nach offiziellen Releases hinzu.

Wie lang kann das Quellvideo für die Bearbeitung sein?

Bis zu 15 Sekunden bei 1080P. Kürzere Clips (2–5 Sekunden) werden schneller verarbeitet und liefern sauberere Bearbeitungen.

Behält die Bearbeitung den Originalton bei? Kommt auf die Bearbeitung an. Hintergrundwechsel behalten den Ton. Stilverschiebungen, die die visuelle Ästhetik verändern, beeinflussen manchmal die Synchronisation. Es lohnt sich, dies von Fall zu Fall zu testen.

Vorherige Beiträge:

- Entdecke, wie die anweisungsbasierte Bearbeitung in natürlicher Sprache in WAN 2.7 funktioniert

- Sieh die wichtigsten Unterschiede zwischen WAN 2.7 und WAN 2.6, insbesondere für leichtgewichtige anweisungsbasierte Bearbeitungen

- Lerne praktische Möglichkeiten kennen, anweisungsbasierte Bearbeitung mit First/Last-Frame-Steuerung zu kombinieren

- Erkunde WAN 2.7s neue Funktionen, einschließlich anweisungsbasierter Videobearbeitung und API-Upgrade-Pfad

- Verstehe reale Produktionsanwendungsfälle und Iterationsvorteile der anweisungsbasierten Bearbeitung in WAN 2.7