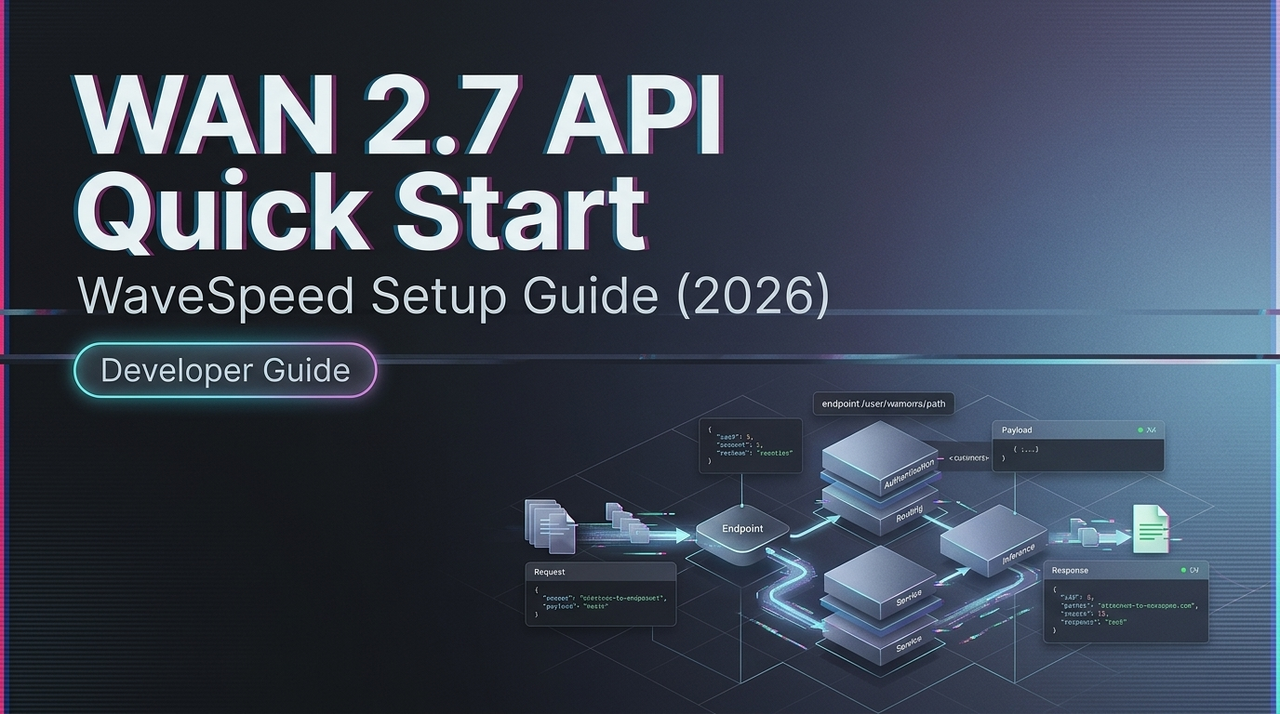

WAN 2.7 API Schnellstart auf WaveSpeed (2026)

WAN 2.7 über die WaveSpeed API zum Laufen bringen: Authentifizierung, Modell-ID, Kernparameter, erste Anfragemuster für T2V, I2V und First/Last-Frame-Jobs.

Hey, Leute. Ich bin Dora. Ich hab das immer wieder aufgeschoben. WAN 2.7 ist live. Ich hatte ein Projekt, das es brauchte, und ich sagte mir, ich würde es einbinden, “nachdem sich die Dinge stabilisiert haben.” Das ist meistens der falsche Instinkt. Die API-Oberfläche ist unkompliziert, sobald man die Versionsbenennung verstanden hat – und der größte Teil der Hürden kommt von ein oder zwei Entscheidungen, die man früh trifft und die sich still auf alles Nachfolgende auswirken.

Das hier ist kein Feature-Showcase. Das ist, was ich tatsächlich am ersten Tag brauchte.

WAN 2.7 auf der Plattform: Modell-ID & Verfügbarkeit

Bevor ich eine einzige Codezeile geschrieben habe, verbrachte ich zehn Minuten damit, den Modell-String zu bestätigen. Das klingt offensichtlich, aber WAN hat ein Benennungsmuster, über das man stolpert – wan2.5-i2v, wan2.6-i2v, wan2.7-flf2v – und eine veraltete ID zu verwenden liefert ein sauberes 404 ohne hilfreiche Fehlermeldung.

Der Modell-Katalog ist die erste Anlaufstelle. Navigiere zum Abschnitt für Videogenerierung, filtere nach Version 2.7 und kopiere den exakten Modell-ID-String. Nicht aus dem Gedächtnis eintippen.

Der Zeitpunkt der Verfügbarkeit ist ebenfalls wichtig. WAN 2.7 wurde im März 2026 mit einer bedeutenden Reihe neuer Funktionen veröffentlicht – Steuerung des ersten/letzten Frames, 3×3-Raster-Bild-zu-Video-Synthese, bis zu fünf Video-Referenzen und anweisungsbasierte Bearbeitung. Laut der Alibaba Cloud Model Studio Übersicht zur Videogenerierung gehen gehostete Inferenz-Endpunkte für neue WAN-Versionen typischerweise innerhalb weniger Tage nach einer offiziellen Veröffentlichung online – aber nicht immer am selben Tag, also überprüfe die Plattform-Statusseite, bevor du etwas Zeitkritisches baust.

Auth & API-Key-Einrichtung

Dieser Teil ist schnell erledigt. Der API-Key kommt in den Authorization-Header als Bearer-Token. Die Basis-URL folgt der Region, die du bei der Kontoeinrichtung ausgewählt hast – Singapur, Virginia oder Peking für die Bereitstellung auf dem chinesischen Festland. Regionenübergreifende Aufrufe schlagen fehl, nicht lautstark, sondern nur mit einem Auth-Fehler, der zwanzig Minuten kostet, wenn man das nicht erwartet.

Authorization: Bearer YOUR_API_KEY

Content-Type: application/jsonEins, was ich von Anfang an mache: Den API-Key in einer Umgebungsvariable speichern und ihn niemals hartcodieren, nicht mal in lokalen Testskripten. Ein durchgesickerter Key ist eine Überraschung bei der Abrechnung, die man nicht haben möchte.

Die Basis-URL-Struktur folgt Standard-REST-Konventionen, wie in IETF RFC 9110 (HTTP Semantics) definiert. Wenn man mit einer modernen KI-API gearbeitet hat, wird sich das vertraut anfühlen – JSON rein, JSON raus, Statuscodes, die sich wie erwartet verhalten.

Kernparameter der Anfrage

Hier würde ich dich ermutigen, etwas langsamer zu werden. Die erforderlichen Parameter sind überschaubar – Modell-ID, Prompt, Eingabetyp – aber die optionalen prägen die Ausgabequalität mehr als man erwarten würde.

Erforderlich:

model— exakter Modell-String, aus dem Katalog verifiziertprompt— deine Textbeschreibung; bei Video ist Spezifität wichtiger als Länge- Eingabe: entweder

image_url(für I2V) oder nur Text für T2V

Optional, aber praktisch wichtig:

resolution— akzeptiert"480P","720P","1080P"; WAN 2.7 unterstützt native 1080P-Ausgabe bis zu 15 Sekundenduration— 2 bis 15 Sekunden; längere Clips kosten mehr und dauern länger in der Verarbeitungseed— diesen sperren, sobald man eine gute Ausgabe findet. Er ist der eine Parameter, der Ergebnisse über Durchläufe hinweg reproduzierbar machtnegative_prompt— nützlich zum Unterdrücken von Flackern, Unschärfe und Bewegungsartefakten

WAN 2.7-spezifische Parameter, die bei der offiziellen Dokumentationsveröffentlichung zu verifizieren sind:

first_frame_url+last_frame_url— für den FLF2V-Modus (First-and-Last-Frame)image_grid— die 9-Raster-Eingabestruktur für reichhaltigere I2V-Kompositionedit_instruction— Bearbeitung eines bestehenden Videos in natürlicher Sprache

Die letzten drei sind neu in 2.7. Parameternamen können sich zwischen Vorschau und allgemeiner Verfügbarkeit ändern. Die offizielle API-Referenz ist die maßgebliche Quelle – auf vorläufige Parameternamen zu bauen, geschieht auf eigenes Risiko.

Erste Anfragemuster

Text-zu-Video (minimal)

response = VideoSynthesis.async_call(

model="wan2.7-t2v", # exakten String beim Launch verifizieren

prompt="A slow dolly shot through a foggy pine forest at dawn.",

resolution="720P",

duration=5,

seed=42

)

task_id = response.output.task_idStandard-Bild-zu-Video

response = VideoSynthesis.async_call(

model="wan2.7-i2v",

img_url="https://your-cdn.com/input.jpg",

prompt="Camera holds still. Subject turns slowly toward light.",

resolution="720P",

duration=5

)Erster Frame + letzter Frame (FLF2V)

Hier macht WAN 2.7 etwas, das frühere Versionen nicht sauber konnten. Man definiert den Eröffnungs- und Schlussframe; das Modell füllt die Bewegung dazwischen aus. Das ist keine Animation im traditionellen Sinne – es ist strukturierte Inferenz aus zwei semantischen Endpunkten.

response = VideoSynthesis.async_call(

model="wan2.7-flf2v", # exakten String beim Launch verifizieren

first_frame_url="https://your-cdn.com/start.png",

last_frame_url="https://your-cdn.com/end.png",

prompt="Fixed camera. Smooth transition. Natural lighting.",

resolution="720P",

seed=99

)Die Qualität des Frame-Paars ist wichtiger als der Prompt. Ein gut aufeinander abgestimmtes Paar mit einer klaren räumlichen Beziehung wird konsistent besser abschneiden als ein ausgearbeiteter Prompt auf nicht passenden Eingabe-Frames. Ich habe genug Durchläufe getestet, um das mit einiger Zuversicht sagen zu können. Als Referenz dazu, wie die Open-Weight-Variante mit Frame-Konditionierung umgeht, dokumentiert das Hugging Face WAN-Modell-Repository die Architektur im Detail – nützlich auch, wenn man nur die gehostete API aufruft.

9-Raster-Bild-zu-Video

Die 9-Raster-Eingabe ermöglicht es, eine 3×3-Anordnung von Standbildern als kompositorische Referenzen für eine einzelne Generierung zu übergeben. Die genaue Payload-Struktur beim Launch verifizieren – der Parameter akzeptiert wahrscheinlich ein Array aus neun Bild-URLs, aber jede Vorab-Dokumentation sollte als vorläufig behandelt werden.

Asynchrone Job-Verarbeitung: Einreichen → Abfragen → Ergebnis

Videogenerierung ist niemals synchron. Selbst für kurze Clips sind 1–5 Minuten pro Job zu erwarten. Das Muster ist immer dasselbe: einreichen → eine task_id erhalten → abfragen → Ergebnis-URL abrufen.

import time

def poll_for_result(task_id, interval=15, timeout=600):

elapsed = 0

while elapsed < timeout:

result = VideoSynthesis.fetch(task_id)

status = result.output.task_status

if status == "SUCCEEDED":

return result.output.video_url

if status == "FAILED":

raise Exception(f"Task failed: {result}")

time.sleep(interval)

elapsed += interval

raise TimeoutError("Job exceeded timeout")Abfrageintervall: 15 Sekunden ist die dokumentierte Empfehlung aus Alibabas eigener API-Referenz für den Wan-Bild-zu-Video-Endpunkt. Nicht häufiger abfragen – das beschleunigt nichts und verbraucht Rate-Limits.

Statusübergänge der Aufgabe: PENDING → RUNNING → SUCCEEDED oder FAILED. Die Ergebnis-URL ist 24 Stunden nach der Generierung gültig. Sofort herunterladen und speichern – wenn man dieses Fenster verpasst, läuft auch die Task-ID nach 24 Stunden ab und gibt bei nachfolgenden Abfragen UNKNOWN zurück. Das habe ich beim ersten Batch-Durchlauf auf die unangenehme Weise gelernt.

Fehlerbehandlung

Die häufigsten Fehler:

| Fehler | Wahrscheinliche Ursache | Lösung |

|---|---|---|

| 404 bei Modell | Falsche oder veraltete Modell-ID | Exakten String aus dem Katalog verifizieren |

| 400 bei Eingabe | Bildformat abgelehnt oder URL nicht erreichbar | Öffentliche HTTPS-URLs verwenden; Format prüfen |

| 429 Zu viele Anfragen | Rate-Limit erreicht | Exponentielles Backoff mit Jitter |

| UNKNOWN-Aufgabenstatus | Task-ID abgelaufen (24-Stunden-Fenster) | Früher abfragen; Ergebnis sofort herunterladen |

Bei 429-Fehlern: zurückhalten, Jitter hinzufügen, nicht in engen Schleifen wiederholen. Die MDN-HTTP-Dokumentation zum Retry-After-Header-Verhalten erklärt das Standardmuster – die Antwort-Header verraten oft genau, wann man es erneut versuchen soll.

Video-Job-Rate-Limits für WAN 2.7 werden getrennt von den Bildgenerierungslimits veröffentlicht. Jobs mit hoher Auflösung oder langer Dauer zählen typischerweise gegen ein Limit für gleichzeitige Jobs, nicht nur gegen ein Anfragen-pro-Minute-Limit. Gegen die Dokumentation des eigenen Kontotiers verifizieren.

Kostenschätzung

Die WAN 2.7-Preisgestaltung war zum Zeitpunkt des Verfassens noch nicht abgeschlossen. Basierend auf dem, was über die WAN-Modellfamilie konsistent ist, skalieren die Kosten in drei Dimensionen:

- Auflösung — 1080P kostet deutlich mehr als 720P pro Ausgabesekunde

- Dauer — wird pro Sekunde des generierten Videos berechnet

- Eingabekomplexität — Mehrfach-Referenz-Eingaben können einen Multiplikator haben; beim Launch bestätigen

Eine grobe Schätzungsformel:

geschätzte Kosten = Dauer (Sekunden) × Auflösungsmultiplikator × Einheitspreis pro SekundeVor einem Batch-Durchlauf einen Clip bei jeder Auflösungs- und Dauerkombination testen, die man verwenden möchte. Die Alibaba Cloud-Abrechnungsübersicht für Model Studio wird Einheitskosten pro Sekunde haben, sobald die offiziellen WAN 2.7-Tarife veröffentlicht sind. Videogenerierungskosten summieren sich schneller als Bildgenerierung – die Auflösung ist der größte Hebel.

FAQ

Ist WAN 2.7 am selben Tag wie die offizielle Alibaba-Veröffentlichung verfügbar?

Nicht immer. Gehostete API-Endpunkte gehen typischerweise innerhalb von Tagen nach einer Open-Weight-Veröffentlichung online, manchmal am selben Tag, manchmal eine Woche später. Das Plattform-Changelog direkt beobachten. Das WAN-Modell-GitHub-Repository war historisch der Ort, wo Alibabas Team Schema-Änderungen für neue Open-Weight-Veröffentlichungen zuerst dokumentiert.

Sind WAN 2.5-API-Aufrufe mit WAN 2.7 kompatibel?

Standard-T2V- und Einzelbild-I2V-Payloads sollten strukturell kompatibel sein – die neuen 2.7-Funktionen erscheinen additiv und nicht brechend. Das heißt, man muss den Modell-ID-String aktualisieren, und jeder Code, der 2.5-spezifische Parameter verwendet, sollte getestet werden, bevor man ihn als Drop-in behandelt. Die 9-Raster- und FLF2V-Modi erfordern vollständig neue Payload-Strukturen.

Was ist das Rate-Limit für WAN 2.7-Video-Jobs?

Beim Kontotyp zur Laufzeit verifizieren. Als funktionierender Standard: Jobs mit einem gleichmäßigen Fluss einreihen statt zu bursten. 429 mit exponentiellem Backoff behandeln. Die request_id aus jeder Antwort protokollieren – das ist das nützlichste Feld, wenn etwas schiefläuft und man es zurückverfolgen muss.

Die Mechanik hier ist nicht kompliziert. Was tatsächlich Zeit kostet, ist das Erstellen guter Eingabe-Assets – die Frame-Paare, die Referenzbilder, die Prompts, die spezifisch bleiben ohne starr zu werden. Wenn diese stabil sind, wird die API-Seite zur Routine.

Ich werde das aktualisieren, sobald die offizielle WAN 2.7-Parameterdokumentation live ist und ich die Möglichkeit hatte, das 9-Raster-Format von Anfang bis Ende zu testen. Das ist der Teil, auf den ich am neugierigsten bin.

Frühere Beiträge:

- Entdecke, wie die anweisungsbasierte Bearbeitung in natürlicher Sprache in WAN 2.7 funktioniert

- Sieh die wesentlichen Unterschiede zwischen WAN 2.7 und WAN 2.6, insbesondere für leichtgewichtige anweisungsbasierte Bearbeitungen

- Lerne praktische Wege, anweisungsbasierte Bearbeitung mit der Steuerung des ersten/letzten Frames zu kombinieren

- Erkunde WAN 2.7s neue Funktionen einschließlich anweisungsbasierter Videobearbeitung und API-Upgrade-Pfad

- Verstehe reale Produktionsanwendungsfälle und Iterationsvorteile der anweisungsbasierten Bearbeitung in WAN 2.7