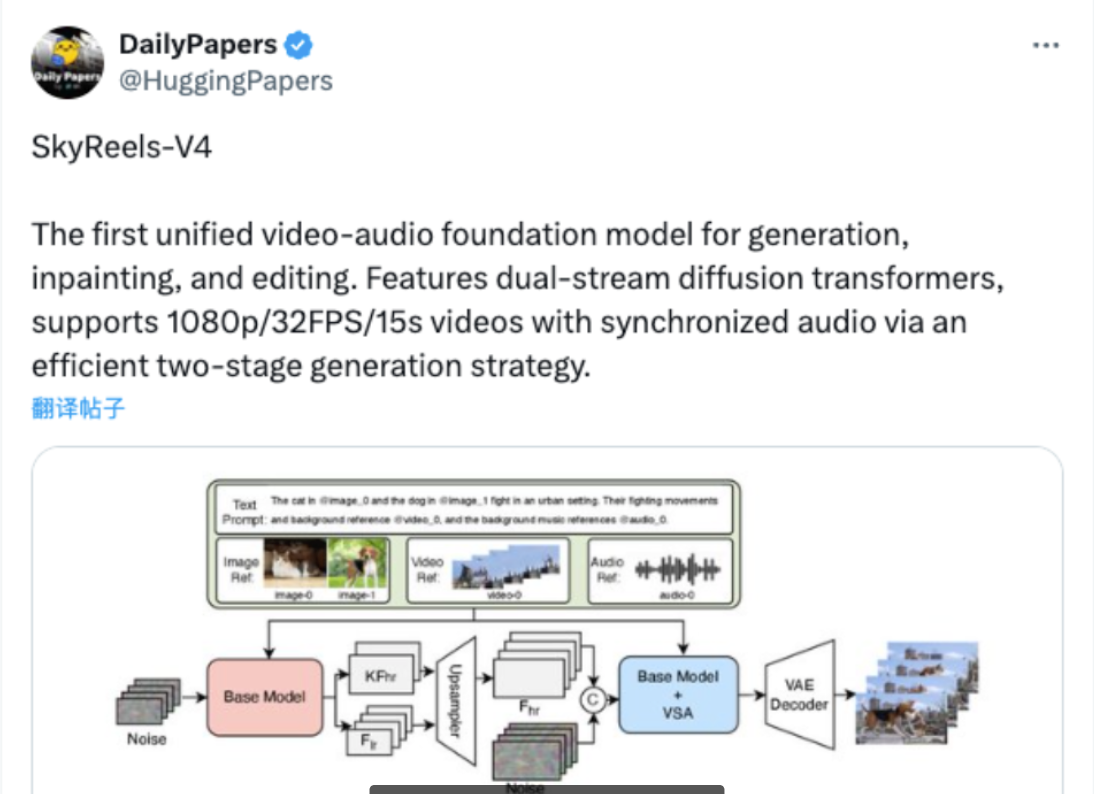

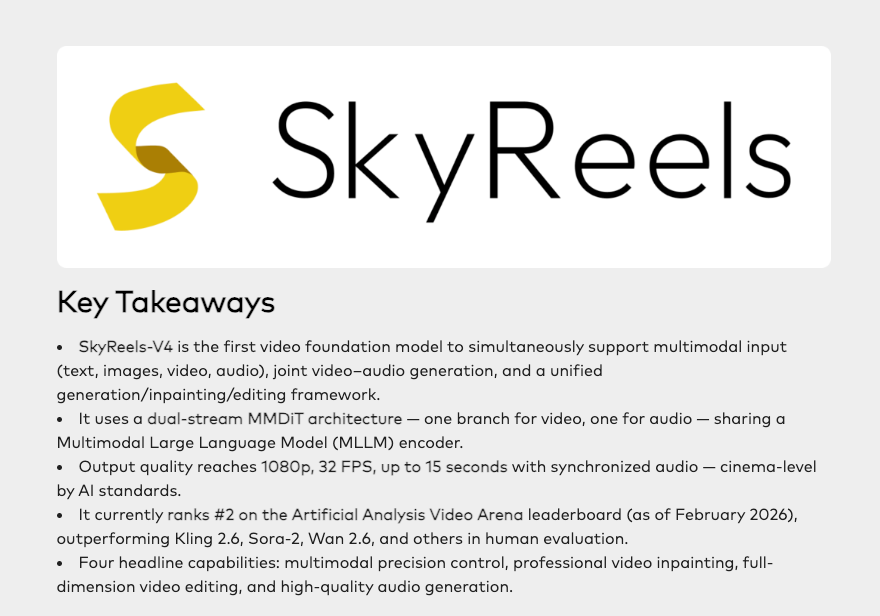

SkyReels V4 Anwendungsfälle: 6 Möglichkeiten für Creators, es jetzt zu nutzen

Von Social-Videos mit natürlichem Audio bis hin zu KI-Filmbearbeitung – hier sind 6 praktische SkyReels V4 Anwendungsfälle und für wen sie jeweils am besten geeignet sind.

Ein kleines Detail hat mich zu SkyReels V4 gebracht: Ich stockte ständig bei kurzen Videos. Nicht beim Schneiden, sondern beim Setup. Musik auswählen, einen Clip trimmen, exportieren, neu exportieren. Zu viele kleine Entscheidungen. Ich wollte etwas, das mich nicht jedes Mal nach einem Moodboard fragt. Also habe ich letzte Woche eine Handvoll SkyReels-V4-Anwendungsfälle ausprobiert, von denen ich immer wieder gehört hatte, und dabei darauf geachtet, was sich im Arbeitsalltag tatsächlich leichter anfühlt.

Ich bin Dora. Was folgt, sind die sechs Anwendungsfälle, die hängen geblieben sind – wo das Tool kleine Reibungspunkte beseitigt hat oder im Weg stand, und in welchem Ausmaß. Wenn du mit Video an den Rändern deines Tages arbeitest – Social Posts, Produkt-Loops, schnelle Demos –, ist hier, wo SkyReels V4 nützlich war, und wo nicht.

Anwendungsfall 1 — Social-Video mit Ambient-Audio

Ich habe hier angefangen, weil ich die Musikauswahl meide wie E-Mails an einem Sonntagabend. Ich habe SkyReels einen 12-Sekunden-Clip eines Schreibtisch-Setups gegeben (Vogelperspektive, Kaffegedampf, ein langsamer Schwenk). Der Prompt war simpel: „ruhig halten, subtiles Ambient-Audio hinzufügen, Bewegung anpassen.”

Meine erste Reaktion: Erleichterung. Es fügte einen weichen Raumklang mit einem leisen Summen hinzu – mehr Präsenz als Stille, weniger Ablenkung als Stock-Tracks. Ich musste keine Timeline anfassen. Der Export dauerte ~18 Sekunden in der Web-App und ~7–9 Sekunden über die API auf einer gemieteten GPU. Das Audio fühlte sich an die Bewegung geklebt an, ohne offensichtliche Schnitte.

Zwei Einschränkungen zeigten sich schnell:

- SkyReels übersüßt manchmal mit Hall, besonders bei weiteren Einstellungen. Ich habe die „Wetness” (ihr Begriff) auf 0,2 reduziert, und es hörte auf, wie eine leere Kirche zu klingen.

- Bei schnellen Schnitten zeigte sich eine Naht im Ambient-Loop um die 10–12 Sekunden. Eine Verlängerung auf 20 Sekunden hat das behoben, aber es ist ein kleines Indiz, wenn man viele Micro-Cuts postet.

In der Praxis habe ich das genutzt, um zwei kurze Clips auf LinkedIn zu posten, mit fast keinem Herumfummeln. Beim ersten Durchgang hat es mir keine Zeit gespart (ich habe viele Einstellungen überprüft), aber beim dritten Mal merkte ich, dass mein Kopf ruhiger war – weniger Entscheidungen, weniger Unterbrechungen.

Was man erstellen kann, was man erwarten kann

- Funktioniert gut für B-Roll, Behind-the-Scenes, Schreibtisch- oder Werkstatt-Aufnahmen, stille Demos und Zeitrafferaufnahmen.

- Erwarte gleichmäßige Ambient-Textur, keine „Songs”. Denke an Schritte, Tasten, leichten Wind, sanfte Synth-Pads. Wenn du einen klaren Beat-Drop brauchst, ist das hier nichts.

- Beste Länge in meinen Tests: 10–30 Sekunden. Über 45 Sekunden können sich kleine Loops wiederholen, außer man gibt der Vielfalt einen Schubs.

- Wenn Untertitel wichtig sind, füge sie woanders hinzu. SkyReels’ Untertitel waren genau genug, aber optisch von Haus aus nichtssagend.

Anwendungsfall 2 — Image-to-Video für Produktinhalte

Ich habe drei statische Aufnahmen ausprobiert: ein Ladegerät, einen Keramikbecher und eine kleine LED-Leuchte, alle vor einem schlichten Hintergrund. Prompt: „subtile Bewegung, 3–5 Sekunden, Produkt bleibt scharf, langsamer Parallax, sanfter Schattenversatz.”

Zuerst das Gute: Die Bewegung wirkte glaubwürdig. Der Becher fing ein kleines Glanzlichtwischen ein, und das Kabel des Ladegeräts machte ein ruhiges Schwingen, das aufgenommen wirkte, nicht simuliert. Die Ausgaben waren standardmäßig 720p; ich habe in der App auf 1080p hochskaliert. Durchlaufzeit: ~12–20 Sekunden pro Stück.

Wo es stockte: Kanten. Bei der LED-Leuchte wurde das Gitter beim Parallax weich-unscharf. Ich habe das behoben, indem ich einen höheren Wert für „Structure Preservation” gesetzt habe (von 0,6 auf 0,85). Kompromiss: weniger Bewegungsfreiheit, aber das Produkt blieb scharf. Text auf Verpackungen hielt stand, wenn ich ihn als „statisch” maskiert hatte. Ohne das verzerrten sich die Buchstaben an den Ecken.

Für Einzelpersonen und kleine Shops deckt das viele „zeig das Ding”-Bedürfnisse ab: kurze Loops für eine Produktseite, Header-Banner oder Social-Cutaways. Es ersetzt keinen gut beleuchteten Drehtisch, aber wenn man nur ein Standbild und eine Deadline hat, reicht es… im guten Sinne.

Ein Tipp: Schneide oder exportiere deine Quellbilder ein kleines bisschen breiter als nötig. SkyReels nutzt diesen Platz, um Kamerabewegung zu simulieren, ohne Details zu strecken.

Anwendungsfall 3 — Videoverlängerung & Szenenkontinuierung

Ich habe die Szenenkontinuierung an einem 5-Sekunden-Clip von Händen getestet, die ein Notizbuch öffnen. Ich bat um „Aktion für 3 weitere Sekunden fortsetzen” und „gleiches Licht, gleiche Körnung”.

Die Naht zwischen Original und Verlängerung war beim zweiten Versuch sauber. Beim ersten Versuch hatte das Papier ein anderes Fasermnster – kaum auffällig, außer man starrt drauf. Das Festsetzen von „Texture Consistency” auf Hoch hat es behoben. Die Bewegung blieb glaubwürdig: die Handgelenksdrehung und der Seitenhub setzten sich fort.

Das hat mir einen kleinen, aber echten Ärger erspart: eine Nachaufnahme zu drehen. Normalerweise lebe ich mit harten Schnitten, weil eine Schreibtischbeleuchtung für eine 2-Sekunden-Korrektur nicht die Mühe wert ist. Hier war es das. Exportzeiten lagen im Bereich von 20–30 Sekunden für 1080p.

Einschränkungen:

- Wenn der Quellclip eine schnelle Perspektivänderung hat (wie ein Whip Pan), schätzt die Fortsetzung manchmal falsch ein, und man bekommt einen Micro-Jump.

- Das Körnung-Matching ist ordentlich, nicht perfekt. Ich füge finale Körnung lieber danach in meinem Editor hinzu.

Nutze das, wenn ein Clip zu früh endet oder wenn du einen sanfteren Ausgangspunkt für Untertitel oder Overlays möchtest.

Anwendungsfall 4 — Inpainting: Videoelemente bereinigen oder ersetzen

Das war mein praktischster Gewinn. Ich habe ein verstreutes Ladekabel und einen Logo-Aufkleber auf einem Laptop-Deckel maskiert. Prompt: „natürliche Schreibtisch-Textur, Reflexionen beibehalten.”

Das Entfernen des Kabels funktionierte beim ersten Durchgang. Das Logo brauchte zwei Versuche. Beim ersten Durchgang brach der Glanzlichtverlauf – ein kleines Wackeln, das die Oberfläche falsch wirken ließ. Ich fügte einen kurzen Referenzframe hinzu, der denselben Deckel ohne Logo zeigte (aus einer älteren Aufnahme), und der zweite Durchgang hat es überzeugend eingeblendet.

Ich habe auch einen Lichttausch versucht: einen blauen Becher gegen einen grünen tauschen. Es sah in Bewegung gut aus, aber ein einzelnes Standbild zeigte eine weiche Kante um den Henkel. Für Social-Scroll absolut durchgehbar. Für ein Produkt-Hero-Bild wahrscheinlich nicht.

Was im Alltag zählt: Das hat die kleinen Bearbeitungen erledigt, die ich immer vor mir herschiebe. Ich habe insgesamt ~4 Minuten für Masken und Prompts aufgewendet, gegenüber 15–20 Minuten in einem herkömmlichen Editor mit Klon-/Heilen-Werkzeugen. Wenn man Inhalte in Batches erstellt, summiert sich diese Differenz schnell.

Vorbehalte:

- Kleine Masken verfolgen am besten. Große, bewegliche Masken können bei Frame 20–30 wackeln. Feathering hilft.

- Reflexionen sind knifflig. Gib eine saubere Referenz an oder halte Änderungen subtil.

- Exportiere ein paar Frames als Standbilder, um Kanten zu prüfen, bevor du ein volles Rendering startest.

Anwendungsfall 5 — Audio-referenziertes Matching

Ich habe SkyReels eine ruhige Feldaufnahme gegeben: Schlüssel, Stuhlscharren, leises Lüftungsgeräusch – etwa 14 Sekunden. Ich bat es, die Stimmung über einen langsamen Schwenk meines Regals zu matchen.

Es tat etwas, das mir gefiel: Anstatt die exakten Geräusche draufzuklatschen, generierte es ein Ambient-Bett, das Rhythmus und Textur widerspiegelte. Das Regal fühlte sich an, als würde es im selben Raum wie die Aufnahme existieren, obwohl es das nicht tat. Das ist die richtige Art von Schummeln.

Zwei Tücken:

- Wenn die Referenz einen scharfen Transienten hat (ein Klatschen, ein fallengelassener Stift), versucht SkyReels manchmal, ihn visuell zu „erklären”, indem es einen Micro-Zoom oder Puls einschiebt. Ich habe reaktive Bewegung deaktiviert, um das zu vermeiden.

- Die Lautstärke kam zu heiß rein. Ich korrigiere die Ausgabe nun auf etwa −16 LUFS für Social. Leicht zu beheben, aber leicht zu übersehen.

Ich habe das bei zwei Clips genutzt, die ich normalerweise stumm schalten würde. Es gab ihnen genug Textur, um sich absichtsvoll anzufühlen, ohne auf sich aufmerksam zu machen.

Gib ihm einen Referenzton, match die Stimmung

- Gute Quellen: Raumton, sanftes Foley, ruhige Außengeräusche, zurückhaltende Synth-Pads.

- Vermeiden: laute Musik-Stems oder geräuschvolle Cafés – das Modell jagt dem Chaos nach.

- Strebe nach 10–20 Sekunden langen Clips. Unter 6 Sekunden wiederholt es sich; über 30 Sekunden glättet es zu sehr.

- Wenn dir Sync-Punkte wichtig sind (Beats, Schnitte), mache diese zuerst in deinem Editor, und bitte SkyReels dann, die Lücken dazwischen zu füllen.

Anwendungsfall 6 — Developer-Pipeline-Integration

Ich bin Mitte der Woche von der Web-App zur API gewechselt, weil ich keinen weiteren klickintensiven Schritt wollte. Das Setup auf meinem Rechner (macOS 15, Python 3.12) dauerte etwa 10 Minuten. Ich habe drei Endpunkte verdrahtet: Image-to-Video, Continuation und Audio-Match. Ich habe auch einen kleinen Retry mit exponentiellem Backoff hinzugefügt – hilfreich, wenn Jobs zu Stoßzeiten in der Warteschlange stehen.

Ein einfacher Ablauf, der funktioniert hat:

- Einen „Staging”-Ordner im Cloud-Speicher beobachten.

- Wenn ein Standbild landet, Image-to-Video mit einem milden Bewegungs-Preset ausführen und einen 5-Sekunden-Loop speichern.

- Wenn ein kurzer Clip landet, Continuation versuchen, um 8 Sekunden für Social zu erreichen.

- Wenn ein Audio-Snippet landet, Mood-Match versuchen und das Ergebnis anhängen.

Der Sinn war keine vollständige Automatisierung. Es ging darum, die leere-Seite-Pause zu entfernen. Ich konnte Assets in einen Ordner ablegen und in unter einer Minute verwendbare Entwürfe zurückbekommen. Dann entschied ich, ob etwas einen Veredelungsdurchgang verdiente.

Ein paar Feldnotizen:

- Rate Limits waren in meinen Tests vernünftig (5–10 gleichzeitige Jobs hielten stabil). Darüber hinaus stiegen die Wartezeiten an.

- Jobs geben hilfreiche Metadaten zurück: Seed, Bewegungsintensität, Structure Preservation und ein schnelles Diff der visuellen Änderungen. Ich habe diese in einer Sidecar-JSON gespeichert, damit ich einen Look erneut ausführen konnte, ohne zu raten.

- Die Kosten variieren. Ich habe Durchläufe kurz gehalten und vernünftige Standardwerte gesetzt, um Credits bei 4K-Experimenten nicht zu verbrennen, die ich nicht brauchte.

Das ist der Anwendungsfall, der SkyReels wie ein System-Baustein und nicht wie eine Spielerei wirken ließ. Ich kann mir vorstellen, dass Teams es in CMS-Workflows oder interne Tools einbinden, ohne es ständig zu beaufsichtigen.

API / Open-Source-Workflow-Potenzial

- Die API ist die stabile Tür. Wenn du in Editoren lebst (Premiere, Resolve), denke an SkyReels als Vorverarbeitungswerkzeug, das dir saubereres Rohmaterial liefert.

- Wenn du Open-Source-Tools bevorzugst, kannst du den Ablauf mit FFMPEG für Ingest/Extract spiegeln und SkyReels nur dort einsetzen, wo das Modell tatsächlich Mehrwert liefert (Bewegungsinferenz, Inpainting).

- Für die Versionierung behandle Prompts und Parameter wie Code: Checke sie in Git ein, speichere Seeds und notiere den genauen Modell-Tag (ich habe V4.0 verwendet, wie im Dashboard am 6. März 2026 angegeben).

Mit welchem Anwendungsfall sollte man anfangen?

Wenn du neugierig, aber knapp an Zeit bist, fange mit dem an, der eine nervende Ecke deiner Woche kürzt.

- Wenn du schnelle Clips postest und Musikauswahl hasst: Social-Video mit Ambient-Audio. Geringes Setup, schnelle Erleichterung.

- Wenn deine Produktfotos zu statisch wirken: Image-to-Video. Structure hoch halten, Bewegung klein.

- Wenn deine Schnitte zu früh enden: Videoverlängerung. Es ist eine stille Lösung, die Nachaufnahmen erspart.

- Wenn kleine Unordnungen dich verlangsamen: Inpainting. Kleine Masken, Kanten prüfen.

- Wenn Stille Clips leer wirken lässt: Audio-referenziertes Matching. Gib ihm Raumton, kein Chaos.

- Wenn du interne Tools baust: Pipeline-Integration. Lass Entwürfe dort erscheinen, wo du bereits arbeitest.

Nichts davon ist magisch. Es sind kleine Hebel. Zusammen verwendet haben sie ein paar Entscheidungen reduziert, die ich nicht mochte, und mir einen saubereren Ausgangspunkt gegeben. Das reicht mir – zumindest diesen Monat. Ich bin gespannt, ob die Ambient-Loops nach einem Dutzend Posts noch unsichtbar wirken, oder ob ich anfange, die Nähte zu hören.