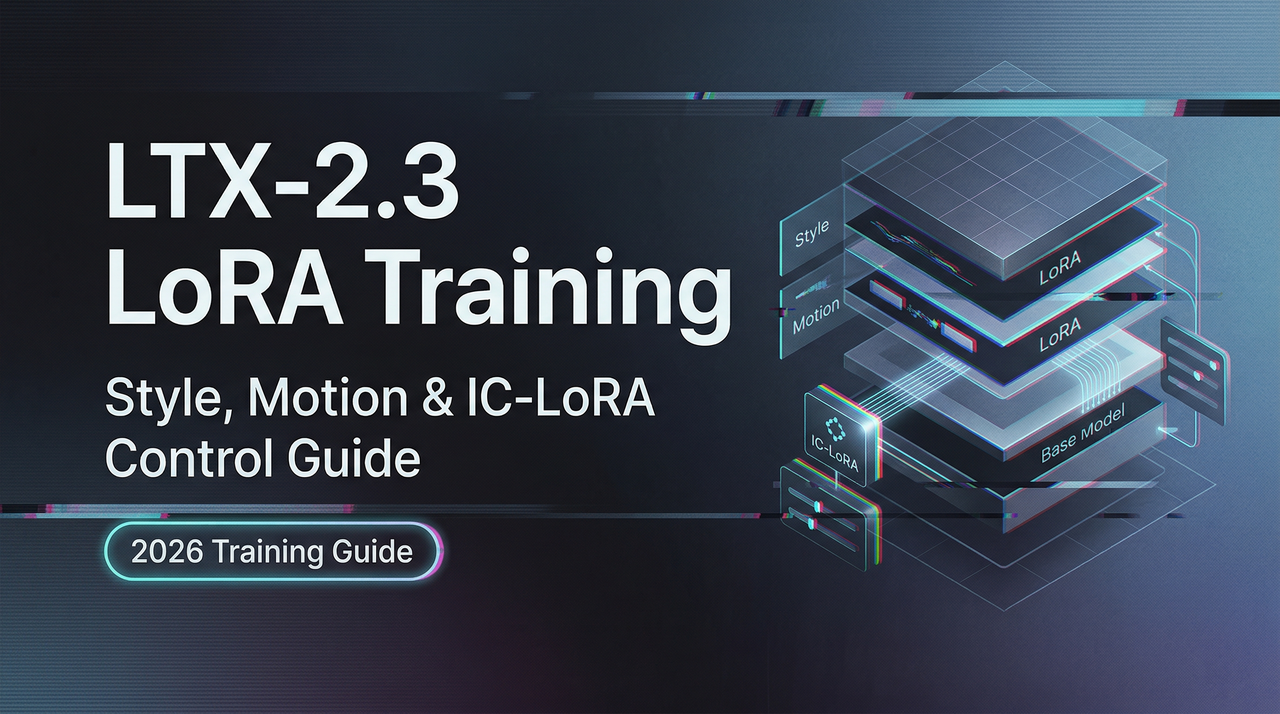

LTX-2.3 LoRA-Trainingsanleitung: Stil-, Bewegungs- & IC-LoRA-Kontrolle (2026)

Trainieren Sie benutzerdefinierte LoRAs auf LTX-2.3 mit dem offiziellen ltx-trainer. Umfasst Stil-LoRAs, IC-LoRA-Struktursteuerung, Rank-Einstellungen, Datensatzvorbereitung und häufige Trainingsfehler.

Hey, mein Freund. Hier ist Dora.

Ich hatte nicht geplant, eine Woche damit zu verbringen, LoRAs zu trainieren. Ich brauchte nur eine Produktdemo, die einem bestimmten Bewegungsmuster folgt, und Textprompts haben das nicht geschafft. Diese kleine Hürde führte mich auf den LTX-2.3-Trainingspfad, und was ich fand, überraschte mich — nicht weil es revolutionär ist, sondern weil es still und leise praktisch ist, sobald man weiß, welche Einstellungen wirklich wichtig sind.

Das ist kein umfassendes Nachschlagewerk. Es ist das, was ich beim Testen von Stil-, Bewegungs- und IC-LoRA-Steuerungs-Workflows im März 2026 gelernt habe.

Was der offizielle Trainer von LTX-2.3 enthält

Das LTX-2 GitHub-Repository ist als Monorepo mit drei Paketen organisiert: ltx-core für die Modellimplementierung, ltx-pipelines für Generierungs-Workflows und ltx-trainer für LoRA- und IC-LoRA-Fine-Tuning. Breite und Höhe müssen durch 32 teilbar sein, und die Frameanzahl muss der 8n+1-Regel folgen — also 1, 9, 17, 25 Frames und so weiter.

Beim ersten Trainingsdurchlauf habe ich das ignoriert. Der Trainer hat einen Fehler ausgegeben, ich habe die Frames manuell aufgefüllt, und dann hat es funktioniert. Eine kleine Einschränkung, aber es lohnt sich, sie von Anfang an zu kennen.

Drei LoRA-Typen und wann man welchen verwendet

Style-LoRAs (Erscheinungsbild, Textur, Farbe)

Style-LoRAs bringen LTX-2.3 visuelle Ästhetik bei — Farbgebung, Texturbehandlung, Beleuchtungsstimmung. Ich habe eine auf Produktfotografie mit einheitlichen weißen Hintergründen und weichen Schatten trainiert. Für Charakter- oder Style-LoRAs reichen normalerweise 20–50 Bilder aus, um solide Ergebnisse zu erzielen, obwohl ich bei sehr spezifischen Motiven schon auf 80–120 Bilder gegangen bin.

Reine Bild-Datensätze funktionieren hier gut. Für meine ersten LoRAs habe ich Standbilder statt Videoclips verwendet — sie sind einfacher zu kuratieren, und das Modell lernt die Identität, ohne Bewegung verarbeiten zu müssen.

Motion-/Effekt-LoRAs (Bewegung, Transformation)

Motion-LoRAs konzentrieren sich darauf, wie sich Dinge bewegen, nicht wie sie aussehen. Kameraschwenks, Objektrotation, Transformationssequenzen. Diese benötigen kurze, kohärente Videoclips, keine Standbilder. Ich habe eine Dolly-In-Motion-LoRA mit 15-Sekunden-Clips bei gleichmäßiger Rahmung getestet, und das Modell hat das Bewegungsmuster bei verschiedenen Motiven erfasst.

Das Training von Bewegung fühlte sich weniger stabil an als bei Stil. Mehr Wiederholungsversuche, variablere Ergebnisse.

IC-LoRAs (strukturelle Steuerung: Tiefe, Pose, Canny-Kante)

IC-LoRA ist anders. Anstatt dem Modell eine neue Ästhetik oder Bewegung beizubringen, konditioniert es die Generierung auf Referenzsignale — Tiefenkarten, Posen-Skelette, Kantenerkennung. IC-LoRA ermöglicht es, die Videogenerierung zur Inferenzzeit auf Referenz-Video-Frames zu konditionieren und so eine fein abgestimmte Video-zu-Video-Steuerung auf dem Text-zu-Video-Basismodell zu ermöglichen.

Ich habe Tiefen-IC-LoRA verwendet, um Kamerabewegungen zu fixieren und gleichzeitig den visuellen Inhalt vollständig zu verändern. Der offizielle IC-LoRA-Leitfaden erklärt die drei Steuermodi gut: Canny für Kantenerhaltung, Depth für Kamera- und Raumgeometrie, Pose für die Übertragung menschlicher Bewegungen.

Regeln zur Datensatzvorbereitung

Einschränkung der Frameanzahl (8n+1-Regel)

Die Frameanzahl muss durch 8 teilbar + 1 sein. Das ist keine weiche Richtlinie — wenn deine Clips 10 oder 15 Frames haben, wird der Trainer entweder einen Fehler ausgeben oder sie intern auffüllen. Ich habe meinen Datensatz vor dem Hochladen auf 17 Frames (2 × 8 + 1) vorverarbeitet, und das Training verlief reibungslos.

Auflösungsteilbarkeit (32px-Regel)

Breite und Höhe müssen durch 32 teilbar sein. Das habe ich gelernt, nachdem ich einen Batch auf 1024×576 skaliert hatte und dem Trainer dabei zugeschaut habe, wie er ihn still auf 1024×608 aufgefüllt hat. Besser, es von Anfang an korrekt zu skalieren.

Video- vs. Bild-Datensätze: Wann man welchen verwendet

Reine Bild-Datensätze sind für das LTX-2.3-LoRA-Training gültig. Das ist viel einfacher als das Erzwingen von Bewegungslernen zu früh, besonders für Identitäts- oder Style-LoRAs. Ich habe jedes Projekt mit Standbildern begonnen, das Aussehen validiert und dann kurze Videoclips hinzugefügt, wenn Bewegung wichtig war.

Für bewegungsintensive Arbeiten schlagen kurze, kohärente Clips immer noch lange Multi-Szenen-Segmente.

Grundlegende Trainingseinstellungen

Rang 32 als korrekter Standard und wann man höher geht

Für LTX-2.3 ist Rang 32 der richtige Standard. Er gibt normalerweise genug Kapazität, ohne die LoRA zu früh zu starr zu machen. Ich habe Rang 64 bei einer komplexen Style-LoRA getestet und minimale Verbesserungen gesehen — die zusätzliche Kapazität hat nicht geholfen, weil mein Datensatz nicht groß oder vielfältig genug war, um sie zu füllen.

Lernrate: Ausgangspunkt und wann man sie ändert

Für das LTX-2.3-LoRA-Training ist 1e-4 der richtige Ausgangspunkt. Das ist einer jener Fälle, in denen die langweilige Antwort die richtige ist. Bei meinen ersten vier LoRAs habe ich die Lernrate nicht angetastet, und alle haben sauber konvergiert.

Schrittanzahl: Wann man früh aufhört

Viele Nutzer verschwenden Zeit, indem sie direkt zu hohen Schrittanzahlen springen, ohne zu prüfen, ob Checkpoint 250, 500 oder 750 schon gut aussieht. Ich teste bei Checkpoint 500, und wenn die LoRA bereits gut aussieht, höre ich dort auf. Wenn eine LoRA bei Checkpoint 750 oder 1000 bereits gut aussieht, kann sie durch weiteres Training nur spröder werden.

Overfitting zeigt sich darin, dass das Modell Trainingsdaten auswendig lernt, anstatt zu verallgemeinern. Validierungsproben sehen dann identisch mit Trainings-Frames aus.

IC-LoRA: Tiefe, Pose und Kantenkontrolle

Wie sich IC-LoRA von Standard-Style-LoRA unterscheidet

IC-LoRA trennt Bewegung von visueller Gestaltung. Das Aussehen steuerst du mit Text und Style-LoRAs, die Bewegung mit strukturierten Guides. Das LTX-2.3 IC-LoRA Union Control Model unterstützt mehrere Steuersignale — Tiefe, Pose, Kante — in einem einzigen Adapter.

Ich habe Tiefen-IC-LoRA auf einer Produkt-Drehtisch-Sequenz eingesetzt. Der Kamerapfad blieb an die Referenz-Tiefenkarte gebunden, aber der visuelle Inhalt hat sich basierend auf meinem Prompt vollständig verändert.

ComfyUI IC-LoRA Workflow-Integration

Der RunComfy LTX 2.3 IC-LoRA Workflow erledigt die Extraktion von Tiefe, Pose und Kante automatisch. Lade einen Referenzclip, wähle einen Steuermodus, schreibe einen auf das Aussehen ausgerichteten Prompt, und das Modell kümmert sich separat um die Bewegung.

Ein Detail, das ich zunächst übersehen habe: Halte Prompts auf das Aussehen fokussiert, da IC-LoRA Bewegung und Struktur übernimmt. Der Versuch, Kamerabewegungen im Prompt zu beschreiben, während IC-LoRA sie steuert, erzeugt Konflikte.

Häufige Trainingsfehler und Lösungen

LoRA-Bleed in alles (DOP-Lösung)

DOP (Dropout of Prompts) ist die erste erweiterte Option, nach der man greifen sollte, wenn eine LoRA anfängt, in alles hineinzubluten. Ich habe eine Produkt-Style-LoRA trainiert, die bei ähnlichen Objekten gut funktionierte, aber anfing, nicht verwandte Motive zu beeinflussen. Das Hinzufügen von Caption-Dropout half der LoRA, zu verallgemeinern.

Overfitting bei hohen Schrittanzahlen

Behandle mehr Schritte nicht als universelles Qualitäts-Upgrade. Ich habe eine Motion-LoRA auf 2.000 Schritte gebracht und dabei zugeschaut, wie sie anfing, genaue Trainings-Frames zu reproduzieren, anstatt das zugrundeliegende Muster zu lernen. Bin auf Checkpoint 750 zurückgegangen.

Konflikt zwischen Caption-Dropout und Cache-Text-Embeddings

Wenn Caption-Dropout verwendet wird, sollte Cache Text Embeddings DEAKTIVIERT bleiben. Das ist eine der wenigen kleinen Einstellungen, die das Trainingsverhalten still und leise verschlechtern können, wenn sie falsch verwendet werden. Ich habe beides einmal aktiviert und inkonsistente Ergebnisse erhalten — das Modell konnte nicht entscheiden, ob es sich auf gecachte Embeddings stützen oder fehlende Captions verarbeiten soll.

LoRA vor dem Einsatz validieren

Ich führe drei Validierungstests durch, bevor ich eine LoRA als fertig erkläre: denselben Prompt mit und ohne die LoRA, um zu bestätigen, dass sie das Erwartete hinzufügt, abwechslungsreiche Prompts zur Prüfung der Verallgemeinerung und Randfälle, die nicht im Trainingsset waren. Wenn die LoRA nur bei Prompts funktioniert, die eng mit Trainings-Captions übereinstimmen, ist sie überangepasst.

FAQ

Kann ich LoRAs auf A100 oder kleineren GPUs trainieren?

Das LTX-2.3-Training zielt offiziell auf Nvidia-H100-GPUs mit 80 GB+ VRAM ab, obwohl Setups mit weniger VRAM mit Gradient-Checkpointing und reduzierten Auflösungen funktionieren können. Ich habe A100-Training selbst nicht getestet, aber die offizielle Trainer-Dokumentation nennt dies als empfohlene Hardware-Basis.

Wie lange dauert das Training einer Style-LoRA auf H100?

Laut Praxisberichten etwa 3–5 Stunden pro LoRA auf einer einzelnen 4090 bei mittelgroßen Datensätzen, einschließlich Validierung und kleiner Neustarts. H100 sollte schneller sein, ich habe aber keine direkten Zahlen.

Funktionieren LTX-2-LoRAs auf LTX-2.3 ohne Neutraining?

Nein. LTX-2.3 wird mit einem komplett neu gestalteten VAE geliefert, der auf höherwertigen Daten trainiert wurde, und die Text-Connector-Architektur hat sich verändert. Alte LoRAs von LTX-2 lassen sich nicht sauber übertragen — ich habe das getestet und visuelle Artefakte erhalten.

Kann IC-LoRA mit Style-LoRAs kombiniert werden?

Ja. Du kannst bis zu drei LoRA-Adapter gleichzeitig stapeln und dabei benutzerdefinierte Ästhetik mit struktureller Steuerung vermischen. Ich habe eine Style-LoRA vor dem IC-LoRA-Loader eingesetzt und ihr Gewicht moderat gehalten, damit IC-LoRA Geometrie und Timing beibehalten konnte.

Ist LoRA-Training über Cloud-Plattformen verfügbar?

Ja. RunComfy AI Toolkit und fal.ai bieten beide browserbasiertes Training ohne die Verwaltung von GPU-Infrastruktur an. Lade deinen Datensatz hoch, konfiguriere die Parameter und lade die LoRA herunter, wenn sie fertig ist.

LoRAs für LTX-2.3 zu trainieren ist keine Zauberei. Es geht um Datensatzvorbereitung, grundlegende Einstellungen und das Wissen, wann man früh aufhören soll. Die 8n+1-Frame-Regel und die 32px-Teilbarkeitseinschränkung fühlen sich anfangs willkürlich an, aber sie sind einfach die Geometrieanforderungen des Modells. Arbeite mit ihnen, nicht um sie herum.

Was mich überrascht hat, war nicht die Komplexität — sondern wie viel Zeit ich gespart habe, indem ich bei Rang 32 und einer Lernrate von 1e-4 geblieben bin, anstatt beim ersten Durchlauf jeden Parameter anzupassen.

Vorherige Beiträge: