LTX-2.3 ComfyUI-Einrichtung: Zweistufige Pipeline, VRAM-Lösungen & Gemma-Encoder

LTX-2.3 in ComfyUI einrichten: Checkpoint-Platzierung, Gemma 3 12B Encoder-Konfiguration, die zweistufige Generierungspipeline und VRAM-sparende Strategien für Consumer-GPUs.

Hey Leute. Ich bin Dora. Ihr wisst, ich hatte keinen Plan zu wechseln. Mein LTX-2-Setup in ComfyUI lief einwandfrei, und ich bin kein Fan von „Neues nur weil neu.” Aber letzte Woche (März 2026) sah ich immer wieder kleine Hinweise zu LTX-2.3: bessere Kohärenz, neuer Text-Encoder (Gemma 3 12B) und ein zweistufiger Pfad, der schärfere Bilder versprach, ohne den VRAM zu ruinieren.

Ich nutzte einen ruhigen Morgen und stellte meinen Workflow um. Hier ist, was sich für mich wirklich verändert hat, wo ich auf Probleme gestoßen bin und die Punkte, die die Arbeit leichter gemacht haben. Wer nach Installationsschritten sucht: Die sind drin, aber der nützliche Teil sind die Abwägungen, die ich beim schrittweisen Aufbau eines LTX-2.3 ComfyUI-Workflows bemerkt habe.

Was ist anders bei LTX-2.3 in ComfyUI (gegenüber dem LTX-2-Setup)

LTX-2.3 ComfyUI fühlt sich eher wie ein Schritt in Richtung Zuverlässigkeit an als ein großer Sprung. Das Modell erwartet Gemma 3 12B als Text-Encoder, und der empfohlene Pfad ist eine zweistufige Pipeline: erst bei halber Auflösung für grundlegende Kohärenz generieren, dann Latents mit einem LTX-spezifischen Upsampler hochskalieren. In der Praxis hat das zwei Dinge für mich verändert:

- Prompts hielten bei moderater Schrittzahl besser zusammen. Ich bemerkte weniger „matschige” Details, wenn ich bei Stage 1 im Bereich von 25–35 Schritten blieb.

- Der VRAM war weniger sprunghaft als befürchtet, solange ich die Stage-Grenzen respektierte und nicht versuchte, Full-Res in einem Durchgang zu erzwingen.

Ich stellte auch fest, dass ältere LTX-2-Nodes größtenteils funktionierten, aber LTX-2.3 bevorzugt seine eigenen Sampler/Latent-Upsampler-Nodes. Nur den Checkpoint zu tauschen reichte nicht. Da stolperte ich zum ersten Mal.

Benötigte Dateien und Ordnerstruktur

Hier ist das Setup, bei dem ich nach einigen Fehlstarts gelandet bin. Es ist nicht aufwendig: Es ist das Minimum, das die roten Fehlerboxen verschwinden ließ.

Checkpoint-Optionen (dev / fp8 / distilled + distilled LoRA)

- dev: Gut zum Ausprobieren. Etwas schwerer, aber ich fand es verzeihender, wenn Prompts abwichen.

- fp8: Leichter für den VRAM. Auf meiner 12-GB-Karte ließ fp8 mich Batch-Größe 1 behalten, ohne OOM beim Decode. Leichter Qualitätsverlust, nichts Dramatisches für Social- oder Marketing-Assets.

- distilled + distilled LoRA: Sauberste Ergebnisse für produktähnliche Aufnahmen in meinen Tests, aber man muss daran denken, die LoRA tatsächlich zu laden und ein Gewicht festzulegen (0,6–0,8 hat bei mir funktioniert). Ohne aktive LoRA sahen die Ergebnisse eher wie dev aus.

Alle Checkpoints lagen in ComfyUI/models/checkpoints. LoRAs hielt ich in ComfyUI/models/loras und benannte sie mit dem gleichen Stamm wie den Basis-Checkpoint, um das Paar schnell zu finden.

Gemma 3 12B Text-Encoder: Download und Ablageort

LTX-2.3 erwartet den Gemma 3 12B Text-Encoder. Je nach Node-Stack verwendet man entweder ein PyTorch-Gewicht oder eine GGUF-Datei (für llama.cpp-gestützte Nodes). Ich habe beides ausprobiert.

- PyTorch-Route: abgelegt in ComfyUI/models/clip (einige Nodes erkennen das automatisch). Wenn der Node einen anderen Ordner erwartet, der Dokumentation folgen, nicht dagegen ankämpfen.

- GGUF-Route: abgelegt in ComfyUI/models/llm (oder einem node-spezifischen text_encoders-Ordner). Q4_K_M war der Sweet Spot für mich: Q3 sparte mehr Speicher, verlor aber etwas Nuancen bei langen Prompts.

Im Zweifel die „?”-Hilfe oder README des Nodes öffnen. Der Ordnername ist wichtig.

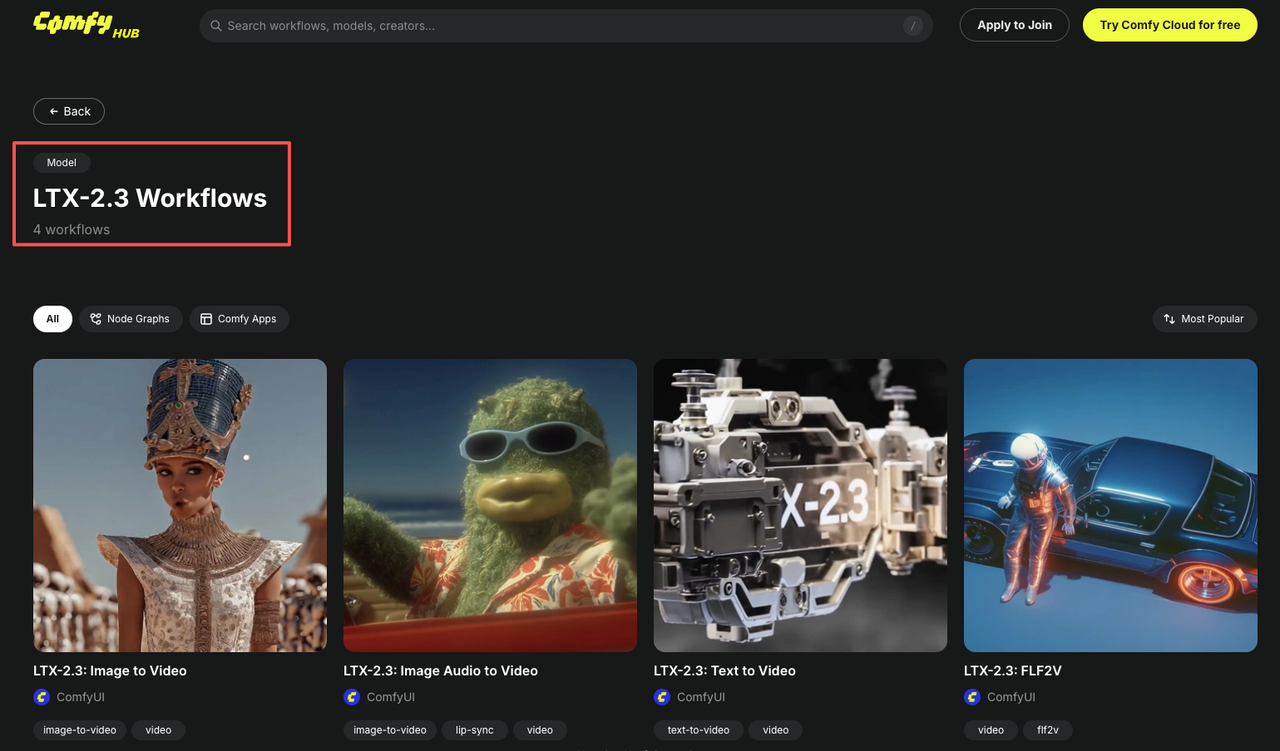

Upscaler-Modelle: Wann sie benötigt werden

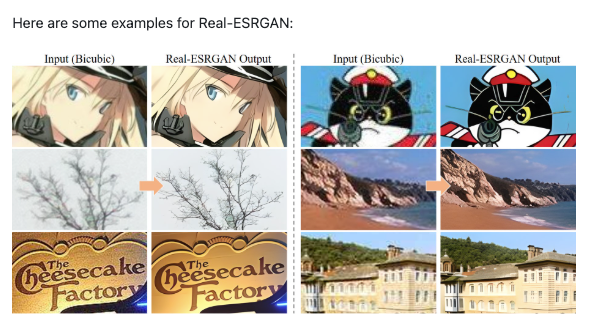

Ein externer Bild-Upscaler wird nicht benötigt, wenn man den LTX-Latent-Upsampler verwendet. Trotzdem behielt ich ein 4x ESRGAN und einen SDXL x2 Latent-Upscaler in ComfyUI/models/upscale_models für Nicht-LTX-Bilder. Für LTX-2.3 hat der eingebaute LTXVLatentUpsampler bei Kanten und textähnlichen Formen besser abgeschnitten als ESRGAN.

Die zweistufige Pipeline erklärt

Ich habe immer wieder versucht, Stage 1 zu überspringen. Das war ein Fehler. Der zweistufige Pfad war am Ende einfacher nachzuvollziehen und schonender für den VRAM.

Stage 1: Grundlegende Kohärenz bei halber Auflösung

Ich generiere bei der Hälfte meiner Zielgröße (z. B. 640×384 für ein finales 1280×768-Bild). Diese Stage legt Komposition und Motivdetails fest. 25–35 Schritte, CFG moderat (4–6), Batch-Größe 1. Wenn etwas nicht stimmt – Hände, Layout, Farbstich – ist es hier günstiger zu korrigieren.

Was ich bemerkte: Weniger „Abweichungen”, wenn ich Prompts vereinfachte und maximal ein oder zwei Style-Anker verwendete. LTX-2.3 scheint fokussierte Sprache zu belohnen.

Stage 2: Latent-Upscaling für Schärfe (LTXVLatentUpsampler)

Dann übergebe ich die Stage-1-Latents an den LTXVLatentUpsampler. Dieser schärft Kanten und stellt Feindetails wieder her, ohne die Komposition neu auszuwürfeln. Ich laufe normalerweise 15–20 Schritte für das Upsampling. Es ist kein Zauberlöscher: Wenn die Basis falsch ist, macht der Upsampler nur ein schärferes Falsches.

Dev + Distilled LoRA vs. Full Distilled: Was verwenden

- Dev + Distilled LoRA: Mein Standard, wenn ich einen Look erkunde. Etwas flexibler. Ich setze die LoRA-Stärke auf etwa 0,7 und passe sie an, wenn Texturen übertrieben wirken.

- Full Distilled: Wenn ich schnelle, konsistente Ergebnisse für einen Batch brauche. Es ist wählerischer bei Prompts, spart aber mentale Energie – weniger Überraschungen von Run zu Run.

Wer nicht weiterkommt: dev für Stage 1 (lockerer) und distilled für Stage 2 (enger) probieren. Diese Kombination hat mir ein stimmungsvolles Portrait-Set gerettet.

Konfiguration des Gemma 3 12B Encoders: VRAM-Management

Gemma 3 12B war der Hauptgrund, warum ich Schmerzen erwartete. Es war nicht schlimm, braucht aber Leitplanken.

Den Encoder auf CPU/RAM auslagern, wenn VRAM knapp ist

Auf einer 12-GB-Karte lagerte ich den Gemma-Encoder für den Text-Durchlauf auf die CPU aus. Das fügte einige Sekunden pro Run hinzu, stoppte aber OOM während Stage 1. Wenn der Node gemischtes Laden auf verschiedene Geräte unterstützt, die Aufmerksamkeitsschichten auf GPU setzen und den Rest auf CPU. Das Gefühl: nicht schneller, aber ruhiger – keine harten Abstürze mitten in einer Idee.

—novram-Flag und andere Start-Fixes

Beim Start von ComfyUI mit Befehlsflags half —novram, Speicherspitzen bei Modellwechseln zu glätten. Außerdem:

- „Keep loaded” bei großen Modellen zwischen Testläufen deaktiviert.

- torch.set_grad_enabled(False) in einem kleinen benutzerdefinierten Init gesetzt (wenn das Setup es erlaubt), um unnötige Gradienten zu vermeiden.

- Kleinere Sicherheitsnetze genutzt: 16-Bit- oder fp8-Checkpoints, wenn ich wusste, dass ich LoRAs stapeln würde.

Low-VRAM-Strategien für Consumer-GPUs (12 GB / 16 GB / 24 GB)

Was auf drei Maschinen funktioniert hat, die ich ausprobiert habe (RTX 3060 12 GB, 4070 12 GB und 4090 24 GB):

GGUF-quantisierte Modelle: Q3 vs. Q4 Abwägungen

- Q3: Niedrigster Speicherbedarf, schnellster Ladevorgang, aber ich verlor Prompt-Nuancen und sah mehr Wiederholungen in Deskriptoren.

- Q4: Etwas schwerer, deutlich bessere Kohärenz. Meine Wahl für 12–16-GB-Karten. Bei 24 GB überspringe ich die Quantisierung oder verwende Q5, wenn verfügbar.

VAE auslagern, um Speicherspitzen zu reduzieren

Beim Decoding traf mich OOM am häufigsten. Das Auslagern des VAE auf die CPU oder die Verwendung eines leichteren VAE reduzierte Spitzen am Ende von Stage 2. Auf 12 GB setzte ich den finalen Decode auch auf ein einzelnes Bild (kein Batching), selbst wenn frühere Nodes in Batches arbeiteten – weniger Drama.

Weitere kleine Gewinne:

- Auflösung in Stage 1 moderat halten: später hochskalieren.

- Mehrere Guidance-Tricks nicht stapeln. Ein CFG, eine LoRA auf einmal.

Häufige Fehler beim ersten Start und deren Behebung

Ich begegnete den üblichen roten Boxen. Diese Fixes haben sich bewährt.

Fehlende Node-Fehler nach dem Laden

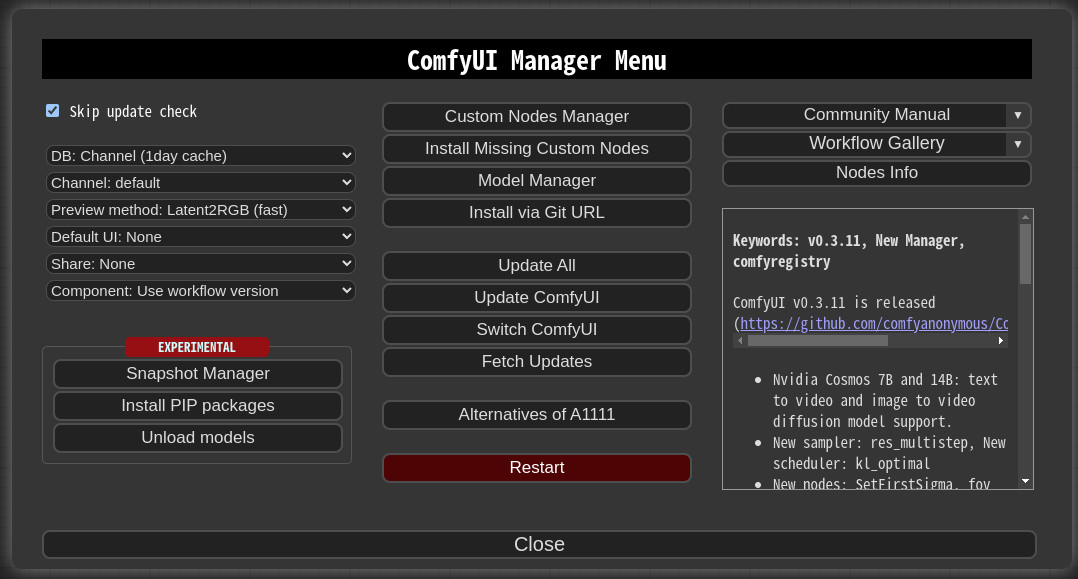

Wenn ComfyUI die LTX-2.3-Nodes nicht findet, das Custom-Nodes-Repository aktualisieren und neu starten. Einige LTX-Nodes erfordern auch einen neueren ComfyUI-Core. Einen hartnäckigen Fehler habe ich behoben, indem ich den Cache-Ordner des Nodes gelöscht und ihn beim Start neu aufbauen ließ.

OOM beim Decode

Zwei Hebel halfen sofort: Checkpoint auf fp8 wechseln oder VAE auf CPU auslagern. Außerdem den Batch der letzten Stage auf 1 senken. Wenn es immer noch abstürzt, die Zielauflösung halbieren und einen externen Bild-Upscaler den Rest erledigen lassen.

Gemma-Encoder-Absturz

Das bedeutete meist Ordner-Mismatch oder eine Quant-Datei, die dem Node nicht gefiel. Ich lud Gemma 3 12B erneut von der im Node-README angegebenen Quelle herunter, überprüfte die Prüfsumme und legte es dort ab, wo der Node es erwartet (clip vs. llm). Q4 funktionierte: Q3 schlug auf meinem 4070 manchmal beim Laden fehl, bis ich auf den neuesten llama.cpp-gestützten Build aktualisierte.

FAQ

Müssen LTX-2.3 ComfyUI-Nodes separat installiert werden?

Normalerweise ja. Das alleinige Aktualisieren des Modells reicht nicht. Das neueste LTX-Node-Repository ziehen und ComfyUI neu starten, damit es neue Sampler und den Latent-Upsampler registriert.

Kann ich bestehende LTX-2-Workflows mit LTX-2.3-Checkpoints verwenden?

Teilweise. Das Layout konnte ich wiederverwenden, musste aber den LTX-2.3-Sampler und LTXVLatentUpsampler einsetzen und Prompts auf Gemma 3 12B ausrichten. Danach verhielten sich die meisten Steuerelemente wie erwartet.

Wie viel VRAM wird mindestens benötigt, um LTX-2.3 in ComfyUI zu betreiben?

Brauchbare Einzelbild-Runs gelangen mir auf 12 GB mit fp8 oder GGUF Q4 für den Encoder, Stage 1 bei halber Auflösung und ausgelagertem VAE. Bei 16 GB läuft es flüssiger. Bei 24 GB kann man in PyTorch bleiben und schneller vorankommen.

Ist die zweistufige Pipeline schneller oder langsamer als eine einstufige?

Die Wanduhrzeit kann ähnlich sein, aber es fühlt sich leichter an. Ich verbringe weniger Zeit damit, Full-Res-Fehlschläge neu auszuprobieren. Stage 1 klärt die Idee: Stage 2 verfeinert sie. Auf einer 12-GB-Karte ist es außerdem der Unterschied zwischen Arbeiten und Abstürzen.

Ich bin nicht wirklich „begeistert” von LTX-2.3 ComfyUI. Eher erleichtert. Die Bilder sahen früher so aus, wie ich es wollte, und der Workflow hörte auf, sich mit dem VRAM zu streiten. Den zweistufigen Pfad werde ich behalten. Er ist unaufgeregt, und er funktioniert.

Vorherige Beiträge: