HappyHorse-1.0 vs Seedance 2.0: Wer gewinnt aktuell?

HappyHorse-1.0 übertrifft Seedance 2.0 bei T2V und I2V ohne Audio – liegt aber bei Audio zurück und hat keine stabile API. Was das für Entwickler bedeutet.

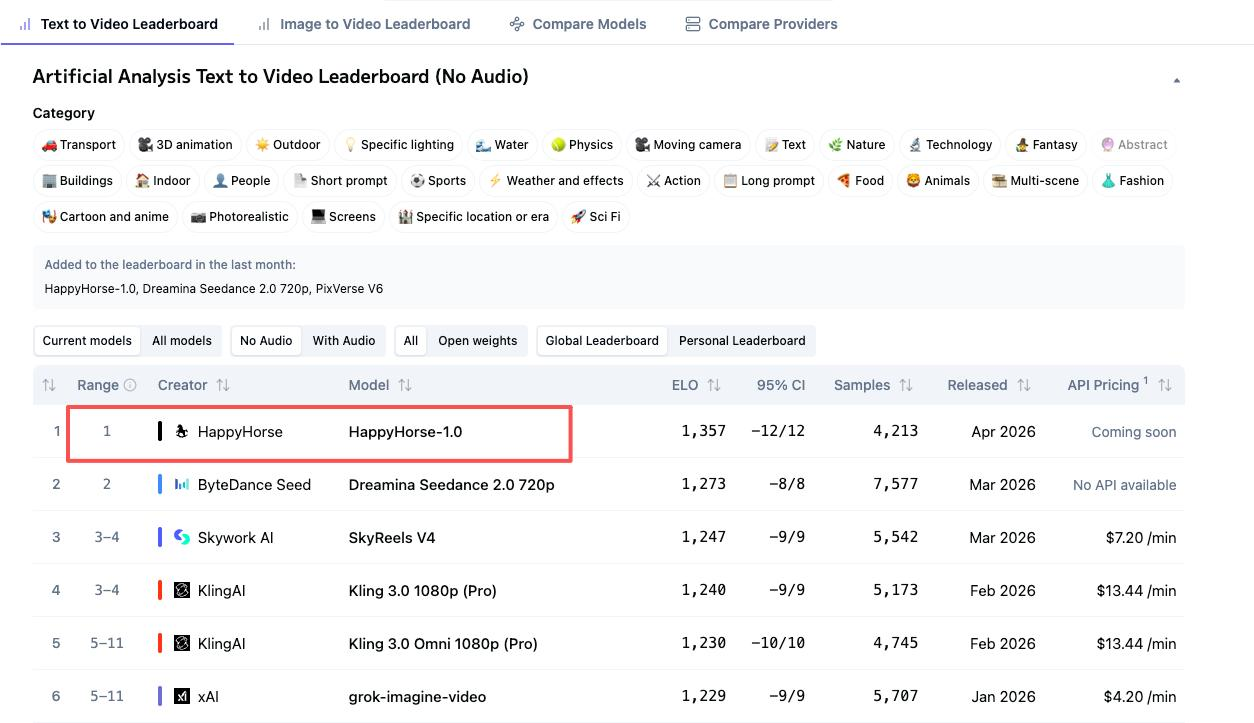

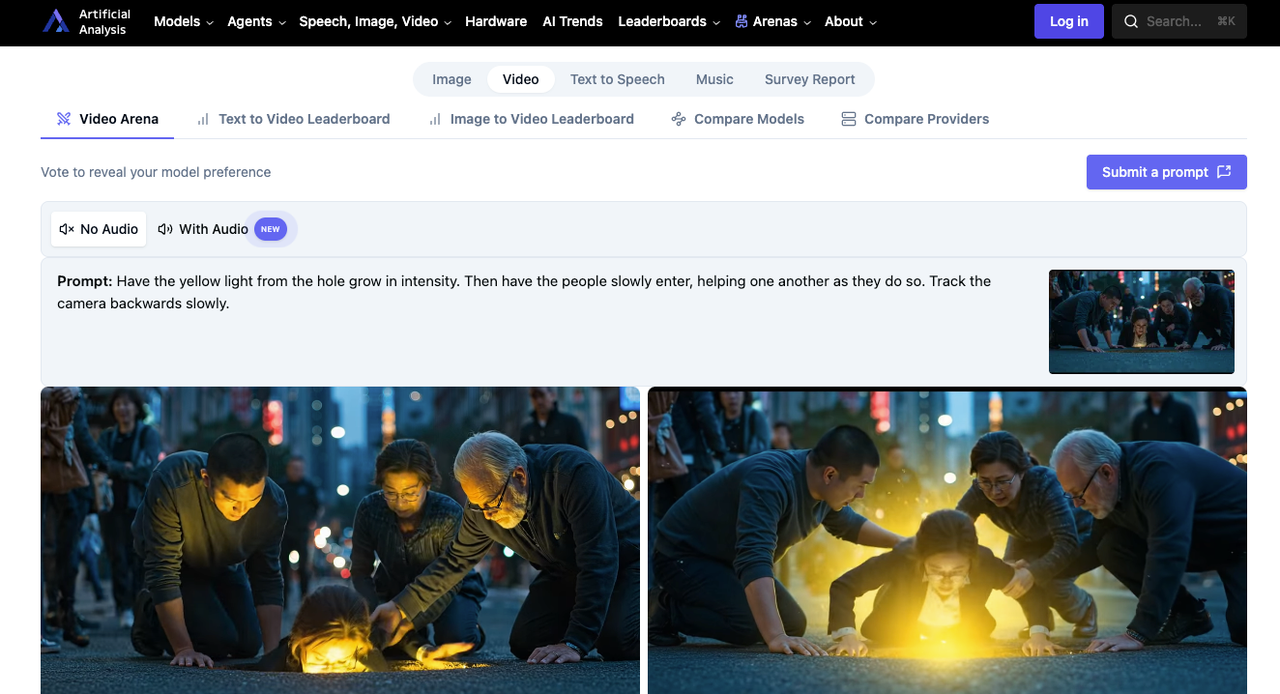

Ich habe viel Zeit damit verbracht, das Artificial Analysis Video Arena Leaderboard zu aktualisieren. Hey, hier ist Dora! Ein Modell, von dem ich noch nie gehört hatte – HappyHorse-1.0 – tauchte über das Wochenende still und leise auf und verdrängte Seedance 2.0 in zwei von vier Hauptrankings vom ersten Platz. Niemand schien zu wissen, wer es entwickelt hatte. Artificial Analysis selbst bezeichnete es als einen „pseudonymen” Eintrag. Und mein Timeline war halb Begeisterung, halb Verwirrung.

Also zog ich die Zahlen zusammen, verfolgte die Zugriffspfade und versuchte, die einzige Frage zu beantworten, die für jeden, der gerade mit diesen Modellen baut, wirklich wichtig ist: Mit welchem kann man heute noch liefern?

Die Antwort ist nicht so eindeutig, wie das Leaderboard es vermuten lässt.

Die vier Leaderboard-Zahlen, die zählen

HappyHorse und Seedance 2.0 stehen in vier separaten Artificial-Analysis-Rankings ganz oben. Ihre Positionen wechseln jedoch, je nachdem, ob Audio Teil der Bewertung ist. Diese Unterscheidung ist wichtiger, als die meisten Vergleiche einräumen.

T2V ohne Audio: HappyHorse #1 (Elo 1333) vs. Seedance 2.0 #2 (Elo 1273)

Dies ist HappyHorses stärkste Leistung. Ein 60-Punkte-Elo-Vorsprung in einer Blind-Voting-Arena ist bedeutsam – er bedeutet grob gesagt, dass Nutzer HappyHorses Ergebnis in direkten Duellen etwa 59 % der Zeit bevorzugen. Die Stimmen hier erfassen visuelle Bewegungsqualität, Prompt-Treue und Szenenkohärenz, ohne dass Audio die Wahrnehmung beeinflusst.

T2V mit Audio: Seedance 2.0 #1 (Elo 1219) vs. HappyHorse #2 (Elo 1205)

Sobald Audio ins Spiel kommt, übernimmt Seedance die Führung mit 14 Punkten. ByteDances Dual-Branch Diffusion Transformer erzeugt Video und Audio gleichzeitig in einem einzigen Durchgang – ein Branch für Videobilder, einer für Audiowellenformen, verbunden durch Cross-Attention. Diese architektonische Entscheidung zahlt sich aus, wenn synchronisierte Soundeffekte und Dialoge Teil des Urteils werden.

I2V ohne Audio: HappyHorse #1 (Elo 1392) vs. Seedance 2.0 #2 (Elo 1355)

HappyHorses höchster Elo-Wert über alle vier Kategorien. Ein 37-Punkte-Vorsprung bei Bild-zu-Video ohne Audio legt nahe, dass das Modell besonders stark darin ist, der Komposition des Referenzbildes zu folgen – Subjektidentität, Bildausschnitt und visuellen Stil konsistent zu halten, während es Bewegung erzeugt. Für Teams, die Produktanimationen oder Konzept-zu-Bewegung-Arbeiten durchführen, ist das die relevante Zahl.

I2V mit Audio: Seedance 2.0 #1 (Elo 1162) vs. HappyHorse #2 (Elo 1161) – nahezu gleichauf

Ein Punkt. Das liegt innerhalb jeder vernünftigen Fehlertoleranz. Kein Modell hat hier einen echten Vorteil. Behandeln Sie diese Kategorie als Unentschieden, bis deutlich mehr Stimmen eingegangen sind.

Was Elo tatsächlich misst – und seine Grenzen für Produktionsentscheidungen

Diese Elo-Werte stammen aus blinden Nutzerabstimmungen in Seite-an-Seite-Vergleichen, unter Verwendung eines Bradley-Terry-Modells, das aus Schach-Rankings adaptiert wurde. Nutzer sehen zwei anonym generierte Videos desselben Prompts und wählen das bevorzugte aus. Es ist das Nächste, was wir einem skalierten „Vibe-Check” haben.

Elo misst jedoch keine API-Zuverlässigkeit, Generierungsgeschwindigkeit, Kosten pro Clip, Zugriffsstabilität oder ob Sie das Modell tatsächlich programmatisch aufrufen können. Ein Leaderboard-Rang ist ein Qualitätssignal, keine Entscheidungsgrundlage für den Einsatz in der Produktion.

Kernvergleichstabelle

| Dimension | HappyHorse-1.0 | Seedance 2.0 |

|---|---|---|

| T2V Elo (ohne Audio) | 1333 (#1) | 1273 (#2) |

| T2V Elo (mit Audio) | 1205 (#2) | 1219 (#1) |

| I2V Elo (ohne Audio) | 1392 (#1) | 1355 (#2) |

| I2V Elo (mit Audio) | 1161 (#2) | 1162 (#1) |

| Audiogenerierung | Vorhanden, hinter Seedance | Stärker – natives Dual-Branch-Sync |

| Bekannter Anbieter | Nein – pseudonym | Ja – ByteDance |

| Architektur (angegeben) | Einzel-Stream-40-Schicht-Transformer | Dual-Branch Diffusion Transformer |

| Offene Gewichte | „Demnächst verfügbar” angekündigt | Nein |

| Stabile API | Keine öffentliche API verfügbar | Verbraucherzugang über Dreamina; offizielle API pausiert |

| Zugang heute | Nur Demo-Seiten | Dreamina, CapCut Pro, chinesische Apps |

Wo HappyHorse die Nase vorn hat

Visuelle Bewegungsqualität ohne Audio: was blinde Abstimmungen erfassen

Die Elo-Lücken in den No-Audio-Rankings – 60 Punkte bei T2V, 37 bei I2V – sind nicht trivial. Nutzer in blinden Vergleichen wählen HappyHorse konsistent für das, was als natürlicheres Kameradriften, flüssigere Körperbewegungen und stärkere Szenenatmosphäre beschrieben wird. Wenn Ihr Anwendungsfall stille Produktschleifen, Social-Clips mit separat hinzugefügter Musik oder B-Roll umfasst, die in der Postproduktion vertont wird, ist das relevant.

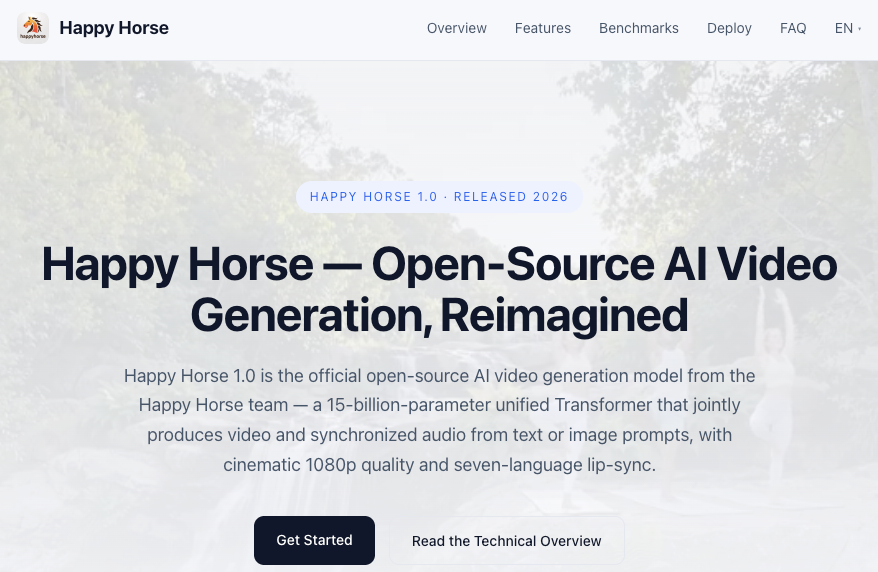

Einzel-Stream-Transformer-Architektur (angegeben) vs. Multi-Stream-Pipelines

HappyHorses Marketingmaterialien beschreiben einen einheitlichen 40-Schicht-Self-Attention-Transformer, der Text-, Video- und Audiotoken in einer einzigen Sequenz verarbeitet – kein Cross-Attention zwischen separaten Branches. Wenn das stimmt, ist das architektonisch klar von Seedances Dual-Branch-Ansatz zu unterscheiden. Die ersten und letzten 4 Schichten verwenden angeblich modalitätsspezifische Projektionen, während die mittleren 32 Schichten Parameter über alle Modalitäten hinweg teilen. Ich kann diese Behauptungen derzeit nicht unabhängig überprüfen. Das GitHub-Repository und der Model-Hub sind als „demnächst verfügbar” aufgeführt.

Mehrsprachige Audio-Unterstützung

HappyHorse behauptet, native Unterstützung für sieben Sprachen zu bieten – Englisch, Mandarin, Kantonesisch, Japanisch, Koreanisch, Deutsch und Französisch – mit einer Lippensynchronisation mit niedrigen Wortfehlerraten. Seedance 2.0 unterstützt 8+ Sprachen für Phonem-Level-Lippensync. Auf dem Papier sind sie wettbewerbsfähig. In der Praxis konnte ich HappyHorses mehrsprachige Ausgabe nicht ausreichend testen, um Parität zu bestätigen.

Wo Seedance 2.0 die Nase vorn behält

Audiogenerierung: führt weiterhin in beiden Audio-Leaderboards

Seedance hält Platz #1 sowohl bei T2V als auch bei I2V mit Audio. Seine Dual-Branch-Architektur – ein Branch generiert Videobilder, der andere Audiowellenformen, verbunden über Cross-Attention für millisekondengenaue Synchronisation – wurde genau dafür entwickelt. Wenn Ihre Ausgabe Dialoge, Umgebungsgeräusche oder bildgenaue Foley-Effekte benötigt, gibt Seedances architektonische Entscheidung, Audio als erstklassigen Bürger während der Generierung zu behandeln (und nicht als Nachbearbeitungsschritt), ihm einen strukturellen Vorteil.

Bekannter Anbieter: ByteDance, stabile Identität, etabliertes Ökosystem

Sie wissen, wer Seedance 2.0 entwickelt hat. ByteDances Seed-Forschungsteam, geleitet von Wu Yonghui (ehemaliger Google Fellow, 17 Jahre bei Google einschließlich Google Brain), hat eine dokumentierte Linie von Pixeldance über Seedance 1.0, 1.5 Pro und nun 2.0. HappyHorse? Zum Zeitpunkt der Veröffentlichung hat niemand öffentlich bestätigt, wer es entwickelt hat. Artificial Analysis fügte es als pseudonymen Eintrag hinzu. Mehrere Drittanbieter-Wrapper-Sites erschienen innerhalb von Stunden nach ihrem Arena-Debüt, aber keine behauptet, der ursprüngliche Entwickler zu sein.

Für Produktionsentscheidungen ist die Herkunft wichtig. Sie müssen wissen, von wem Sie bei Modell-Updates, Compliance und Kontinuität abhängig sind.

Zugriffspfad: Dreamina hat öffentliche Einstiegspunkte

Seedance 2.0 ist heute über ByteDances Dreamina-Plattform international zugänglich, mit bezahlten Plänen ab ca. 18 $/Monat. Die CapCut-Pro-Integration wurde Ende März 2026 in ausgewählten Märkten eingeführt. Chinesische Nutzer können über Jimeng darauf zugreifen, mit Plänen ab ca. 69 RMB/Monat (~9,60 USD).

Das gesagt – die offizielle Seedance-2.0-API ist seit Mitte März 2026 pausiert, aufgrund gemeldeter Copyright-Streitigkeiten. Der Verbraucherzugang funktioniert. Programmatischer API-Zugang im Produktionsmaßstab erfordert eine Überprüfung, bevor Sie sich für eine Pipeline darauf festlegen. Drittanbieter bieten Seedance v1.5 über API an; die Verfügbarkeit der Seedance-2.0-API über offizielle Kanäle muss vor der Produktionsphase bestätigt werden.

Die Zugriffslücke ist der eigentliche Entscheidungsfaktor

HappyHorse: keine stabile API, keine öffentlichen Gewichte, nur Demo zum Zeitpunkt der Veröffentlichung

Trotz der Ankündigung einer Open-Source-Veröffentlichung sind HappyHorses GitHub und Model-Hub beide als „demnächst verfügbar” aufgeführt. Mehrere Demo- und Wrapper-Sites existieren, aber keine bietet dokumentierte API-Endpunkte mit SLAs, Rate-Limits oder Preisen an, auf denen man ein Produkt aufbauen könnte. Ich konnte keinen einzigen Drittanbieter finden, der HappyHorse-1.0 derzeit über einen stabilen, dokumentierten Endpunkt anbietet.

Wenn Sie für die Produktion evaluieren, ist das der mit Abstand wichtigste Faktor. Ein Modell, das Sie nicht zuverlässig aufrufen können, ist kein Modell, mit dem Sie liefern können.

Seedance 2.0: über Dreamina zugänglich – Details müssen überprüft werden

Der Verbraucherzugang über Dreamina funktioniert. Die Plattform unterstützt den vollen Funktionsumfang, einschließlich des @-Referenzsystems, Multi-Shot-Editing und audiovisueller Generierung. Wenn Ihr Workflow jedoch API-Level-Integration erfordert, ist die Lage weniger eindeutig. Die offizielle BytePlus-API für Seedance 2.0 ist seit März pausiert. Drittanbieter wie fal.ai und PiAPI haben Seedance 1.5 angeboten; der programmatische Zugang zu Seedance 2.0 und die zugehörige Preisstruktur sollten direkt bestätigt werden, bevor eine Produktionsabhängigkeit aufgebaut wird.

Warum „Leaderboard #1” und „produktionsbereit” unterschiedliche Fragen sind

Ich komme immer wieder darauf zurück. Elo sagt Ihnen, welches Modell Nutzer in einem kontrollierten Vergleich bevorzugen. Es sagt Ihnen nicht, ob Sie nächsten Dienstag 10.000 Generierungen ohne 503-Fehler durchbekommen. HappyHorse produziert möglicherweise tatsächlich bessere stille Videos. Aber wenn Sie es nicht zuverlässig aufrufen können, lebt dieser Qualitätsvorteil in der Arena, nicht in Ihrer Pipeline.

Entscheidungsrahmen

Audioqualität ist nicht verhandelbar → Seedance 2.0. Es führt in beiden Audio-Leaderboards und seine Dual-Branch-Architektur generiert synchronisierten Sound nativ. Wenn Ihre Clips Dialoge, Umgebungsaudio oder bildgenaue Soundeffekte benötigen, ist Seedance heute die stärkere Wahl.

Visuelle Bewegungstreue hat Priorität und Sie sind bereit zu warten → HappyHorse beobachten. Die No-Audio-Elo-Vorsprünge sind real. Wenn offene Gewichte und API-Zugang wie versprochen realisiert werden, könnte HappyHorse für silent-first-Workflows überzeugend werden. Aber „demnächst verfügbar” ist kein SLA.

Sie benötigen heute eine Produktions-API → Seedance 2.0 ist die sicherere Wahl. Nicht weil es perfekt ist – die offizielle API-Pause ist eine echte Einschränkung – sondern weil Dreamina einen funktionalen Zugriffspfad mit dokumentierten Preisen bietet und Drittanbieter aktiv Seedance-2.0-Endpunkte vorbereiten. HappyHorse hat noch keine vergleichbare Infrastruktur.

FAQ

Ist HappyHorse-1.0 tatsächlich besser als Seedance 2.0?

Das hängt davon ab, was Sie messen. HappyHorse führt bei visueller Qualität in No-Audio-Vergleichen (Elo 1333 vs. 1273 bei T2V, 1392 vs. 1355 bei I2V). Seedance führt, wenn Audio Teil der Bewertung ist. Kein Modell dominiert alle vier Kategorien. „Besser” ist nur relativ zu Ihrem spezifischen Anwendungsfall sinnvoll – und davon abhängig, ob Audio wichtig ist.

Warum führt HappyHorse ohne Audio, liegt aber mit Audio zurück?

Wahrscheinlich liegt es an der Architektur. HappyHorse behauptet, einen einzigen einheitlichen Transformer zu verwenden, der alle Modalitäten in einer Sequenz verarbeitet. Seedance 2.0 verwendet ein zweckgebautes Dual-Branch-Design, bei dem separate Video- und Audio-Branches durch Cross-Attention verbunden sind. Dieser spezialisierte Audio-Branch scheint Seedance einen Vorteil zu verschaffen, wenn Klangqualität und Synchronisation zusammen mit den Visuals beurteilt werden.

Kann ich heute über eine API auf HappyHorse-1.0 zugreifen?

Nicht über einen stabilen, dokumentierten Endpunkt, den ich zum Stand vom 8. April 2026 verifizieren konnte. Mehrere Wrapper-Sites bieten browserbasierten Demo-Zugang, aber keine veröffentlicht API-Dokumentation, Rate-Limits oder produktionstaugliche SLAs. Das offizielle GitHub und der Model-Hub sind beide als „demnächst verfügbar” aufgeführt.

Wie zuverlässig ist das Artificial-Analysis-Leaderboard für Produktionsentscheidungen?

Es ist das glaubwürdigste crowdsourced Signal für wahrgenommene Videoqualität – blinde Abstimmungen, Elo-basiertes Ranking, echte menschliche Präferenzen. Aber es misst eine Sache: welche Ausgabe Nutzer im direkten Vergleich bevorzugen. Es berücksichtigt keine Generierungsgeschwindigkeit, Kosten, Zuverlässigkeit, API-Uptime oder Zugriffsstabilität. Verwenden Sie es als Qualitätsinput, nicht als vollständige Beschaffungsentscheidung.

Wird HappyHorse-1.0 in zukünftigen Versionen Audio-Verbesserungen erhalten?

Es gibt keine öffentliche Roadmap. Das Modell erschien vor weniger als einer Woche unter einem Pseudonym in der Arena. Wenn die „demnächst verfügbare” Open-Source-Veröffentlichung stattfindet, könnten Community-Beiträge die Audioqualität verbessern. Aber es gibt keinen Zeitplan, kein bestätigtes Entwicklungsteam und keine angekündigten v2-Pläne. Alles, was über das, was derzeit im Leaderboard steht, hinausgeht, ist Spekulation.

Es passiert etwas Interessantes in der Lücke zwischen dem, was ein Leaderboard sagt, und dem, was ein Entwickler tatsächlich nutzen kann. HappyHorses Zahlen sind wirklich beeindruckend – aber Zahlen ohne Zugang sind nur Zahlen. Ich behalte das GitHub-Repository im Auge, bis es live geht. Bis dahin geht es im Vergleich nicht wirklich darum, welches Modell besser ist. Es geht darum, welches Modell verfügbar ist.

HappyHorse-1.0 auf WaveSpeedAI ausprobieren

HappyHorse-1.0 ist jetzt auf WaveSpeedAI verfügbar:

Frühere Beiträge: