Godmod3 AI erklärt: Multi-Model-Chat ohne Einschränkungen

Godmod3 ermöglicht es Ihnen, 50+ KI-Modelle parallel mit einem einzigen OpenRouter-Schlüssel zu betreiben – keine Installation, kein Server, kein Konto. Was das in der Praxis bedeutet.

Ich habe einen Workflow darum herum gebaut, bevor ich vollständig verstanden hatte, was es war. So läuft das meistens.

Letzte Woche war ich drei Tabs tief — Claude in einem, GPT-5 in einem anderen, Gemini in einem dritten — und kopierte denselben Prompt in jeden, um herauszufinden, welches Modell einen nuancierten technischen Vergleich am besten bewältigt. Die Reibung war offensichtlich: drei Login-Sitzungen, drei Parameterpanels, drei Abrechnungskonten, null standardisiertes Ausgabeformat. Ich bin Dora, die diese Art von modellübergreifender Evaluierung dutzende Male durchgeführt hat und in meinem Arbeitsprotokoll eine laufende Notiz führt: „Wechselkosten sind unsichtbar, bis man es fünfzig Mal pro Woche macht.” Dann werden sie sehr sichtbar.

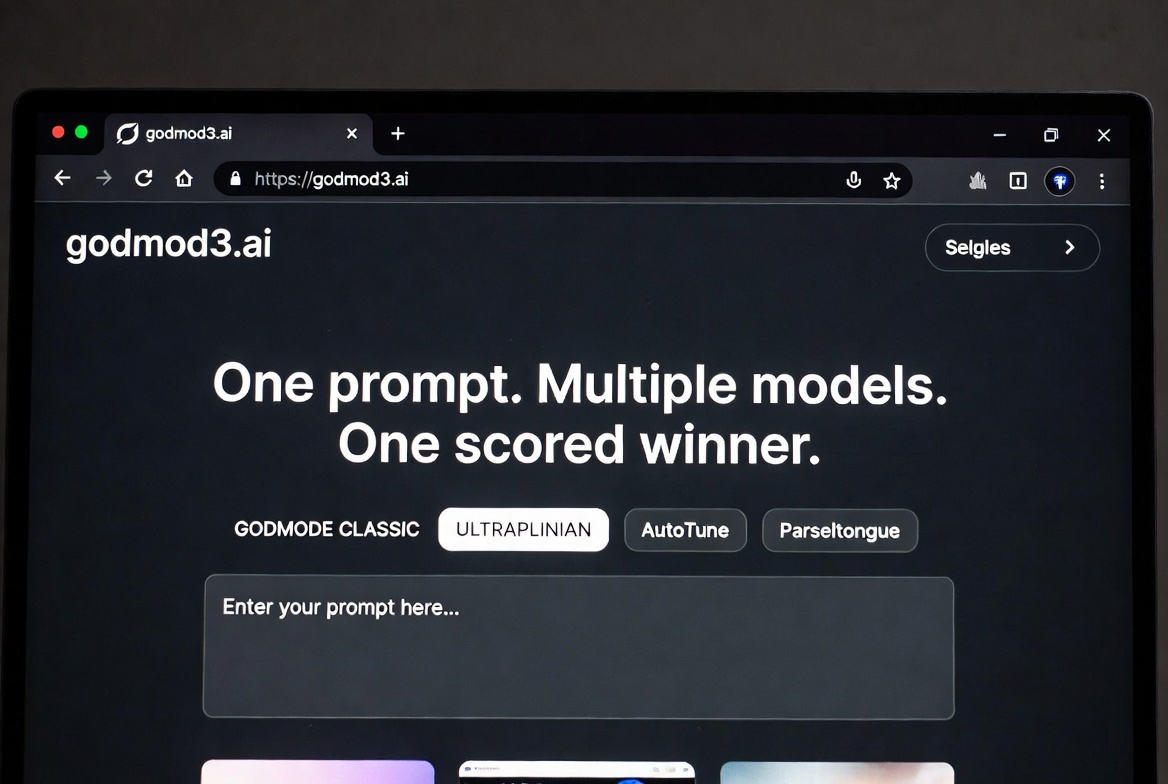

Das ist das Problem, das godmod3.ai löst. Ein Prompt. Mehrere Modelle. Ein bewerteter Gewinner. Hier ist, was Sie wirklich wissen müssen, bevor Sie entscheiden, ob es in Ihren Workflow gehört.

Godmod3 vs. Ihr aktuelles KI-Chat-Setup

Das Einzelmodell-Problem: Warum das Tab-Wechseln zwischen ChatGPT und Claude nicht ausreicht

Das Problem ist nicht, dass ChatGPT oder Claude schlecht sind. Es ist, dass die Verwendung eines Modells gleichzeitig Sie zwingt, dem Urteil dieses Modells ohne Vergleichspunkt zu vertrauen. Sie tippen einen Prompt, erhalten eine Antwort und akzeptieren sie entweder oder formulieren sie neu. Sie wissen nicht, ob ein anderes Modell es beim ersten Versuch getroffen hätte.

Tabs zu wechseln, um das herauszufinden, ist langsam. Jede Plattform hat ihre eigenen Parametereinstellungen, ihr eigenes Kontextfensterverhalten, ihre eigene Art, dieselbe Anweisung zu interpretieren. Bis Sie drei Ausgaben verglichen haben, haben Sie mehr Zeit mit dem Prozess verbracht als mit der eigentlichen Aufgabe.

Was godmod3.ai Ihnen bietet: ein Prompt, mehrere Modelle, ein Gewinner

Godmod3 sendet Ihren Prompt gleichzeitig an mehrere Modelle und gibt die Ergebnisse nebeneinander zurück. In seinem ULTRAPLINIAN-Modus bewertet es Antworten auf einer zusammengesetzten 100-Punkte-Metrik und zeigt automatisch die am höchsten bewertete Antwort an. Sie lesen nicht durch fünf Tabs — Sie lesen das Urteil.

Die gesamte Benutzeroberfläche ist eine Single-Page-Browseranwendung, die von Pliny (elder-plinius) unter der AGPL-3.0-Lizenz erstellt wurde. Für die einfache gehostete Version ist kein Backend-Server erforderlich. Ihr API-Schlüssel bleibt im localStorage Ihres Browsers. Godmod3 speichert Ihre Gespräche auf keinem Server — schließen Sie den Tab und sie sind weg.

Die OpenRouter-Abhängigkeit einfach erklärt

Godmod3 verbindet sich nicht direkt mit OpenAI, Anthropic oder Google. Es leitet alles über OpenRouter weiter, ein einheitliches API-Gateway, das mit einem einzigen Schlüssel Zugang zu 300+ Modellen von mehreren Anbietern bietet. Sie zahlen OpenRouter pro Token, nicht godmod3. Das Tool selbst ist kostenlos. OpenRouter ist die Abrechnungsschicht, der Modellkatalog und die Routing-Infrastruktur in einem.

Drei Wege, auf Godmod3 zuzugreifen

Gehostete Version auf godmod3.ai — keine Installation, bringen Sie Ihren OpenRouter-Schlüssel mit

Gehen Sie zu godmod3.ai, fügen Sie Ihren OpenRouter-API-Schlüssel in den Einstellungen ein und beginnen Sie mit dem Prompting. Das war’s. Kein Download, kein Docker, kein npm install. Die gehostete Version entfernt das optionale Dataset-Sammlungsfeature vollständig — es ist eine reine clientseitige Chat-Oberfläche.

Ich nutzte es innerhalb von 60 Sekunden nach dem Aufrufen der Seite. Die Reibung war nahezu null, was bei Open-Source-KI-Tools selten ist.

Selbst gehostete Einzeldatei — klonen und index.html öffnen

Die gesamte Anwendung passt in eine einzige index.html-Datei. Klonen Sie das GitHub-Repository, öffnen Sie index.html in einem Browser, fertig. Oder führen Sie python3 -m http.server 8000 aus, wenn Sie einen lokalen Server möchten. Kein Build-Schritt, keine Abhängigkeitsinstallation, keine Konfigurationsdatei.

Das ist wichtig, wenn Sie genau prüfen möchten, welcher Code ausgeführt wird, bevor Sie einen API-Schlüssel einfügen. Die AGPL-3.0-Lizenz — anerkannt von der Open Source Initiative als freie Softwarelizenz — bedeutet, dass der Quellcode vollständig überprüfbar ist.

Statisches Deployment — GitHub Pages, Vercel oder Netlify in unter 5 Minuten

Da es sich um eine einzelne HTML-Datei handelt, ist das Deployment auf einer beliebigen statischen Hosting-Plattform trivial. Pushen Sie in ein GitHub-Repository, aktivieren Sie GitHub Pages, und Ihre persönliche godmod3-Instanz ist unter einer URL, die Sie kontrollieren, live. Dasselbe gilt für Vercel oder Netlify — importieren Sie das Repository und deployen Sie. Keine Serverless-Funktionen, keine Umgebungsvariablen (abgesehen von Ihrem API-Schlüssel, der clientseitig bleibt).

Ich testete den GitHub Pages-Weg. Es dauerte etwa drei Minuten vom Fork bis zur Live-URL.

Die vier Modi erklärt

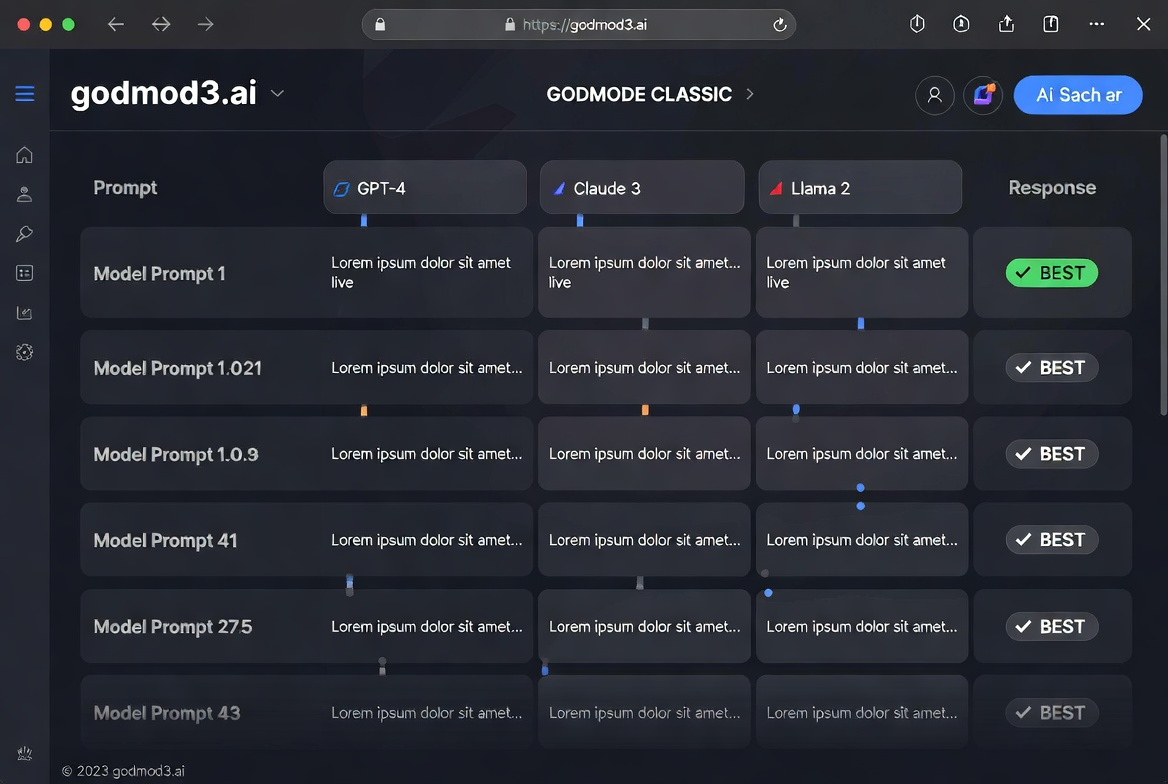

GODMODE CLASSIC — der parallele Rennen-Modus

Der ursprüngliche Modus. Fünf Modell-Prompt-Kombinationen laufen parallel, jede verbindet ein spezifisches Modell mit einem abgestimmten System-Prompt. Die Antworten rasen, und die Benutzeroberfläche zeigt die beste an. Es ist schnell und eigensinnig — Sie vertrauen den voreingestellten Konfigurationen, anstatt Modelle selbst auszuwählen.

Gut für schnelle Vergleiche, wenn Sie nicht über Parameter-Tuning nachdenken möchten. Weniger nützlich, wenn Sie spezifische Modellkontrolle benötigen.

ULTRAPLINIAN — tiefe Multi-Modell-Evaluierung für ernsthafte Vergleiche

Das ist der Modus, der mich zum Innehalten brachte. Er kann bis zu 51 Modelle parallel abfragen, jede Antwort auf einer zusammengesetzten Metrik bewerten und sie einordnen. Die Bewertung berücksichtigt Relevanz, Kohärenz und Antwortqualität. Für Prompt-Ingenieure, die testen, wie verschiedene Modelle dieselbe Anweisung handhaben, liegt hier der eigentliche Wert.

Nicht günstig, allerdings. 51 Modelle parallel zu betreiben bedeutet 51 separate API-Aufrufe, jeder über OpenRouter abgerechnet. Ich führte einen mittelkomplexen Prompt durch eine 10-Modell-Konfiguration, und die Kosten waren moderat — ein paar Cent. Bei 51 Modellen summiert es sich.

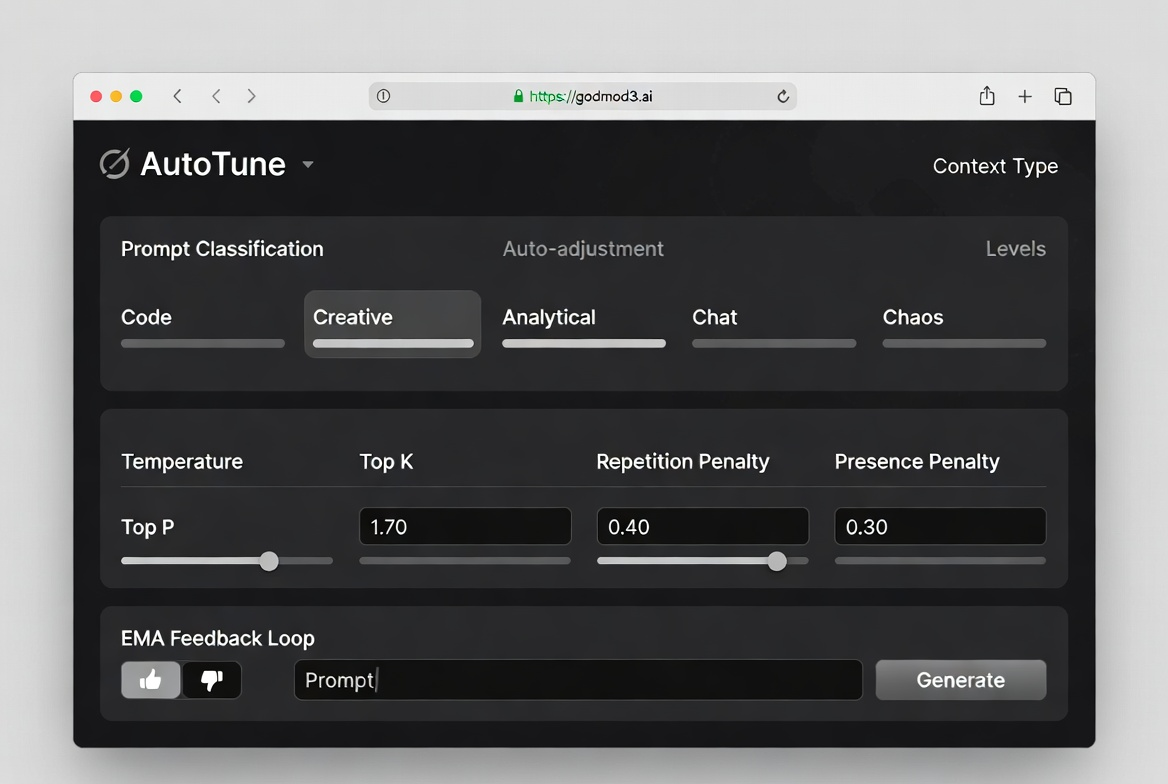

AutoTune — warum Sie die Temperatur nicht mehr manuell einstellen müssen

AutoTune klassifiziert Ihren Prompt in einen von fünf Kontexttypen — Code, kreativ, analytisch, Chat oder Chaos — und passt automatisch Temperatur, top_p, top_k und Penalty-Parameter an. Es verwendet eine EMA-basierte Feedback-Schleife: Daumen hoch oder runter bei einer Antwort verfeinert zukünftige Parameterauswahl.

Ich bin mir noch nicht vollständig sicher, wie viel Unterschied das gegenüber dem manuellen Setzen der Temperatur auf 0,7 macht. Nach einer Woche Nutzung fühlten sich die Parameterauswahlen vernünftig an, aber nicht dramatisch besser als meine Standardwerte. Diese Schlussfolgerung hat ein Verfallsdatum — die Feedback-Schleife braucht mehr Daten zum Konvergieren.

Parseltongue — Eingabe-Perturbation für Sicherheitsforscher (und wofür es nicht gedacht ist)

Parseltongue ist ein Red-Team-Forschungsmodul. Es erkennt Trigger-Wörter und wendet zeichenbasierte Transformationen an — Leetspeak, Unicode-Substitution, phonetische Kodierung — um zu studieren, wie Modelle auf gegnerische Eingaben reagieren. Das Forschungspapier des Projekts rahmt dies ausdrücklich als KI-Sicherheitsevaluierungswerkzeug zum Testen der Modellrobustheit zur Inferenzzeit ein.

Das ist kein Content-Bypass-Tool. Es ist für kontrollierte Forschung darüber konzipiert, wie Sicherheitsschichten auf Eingabe-Perturbation reagieren. Die Unterscheidung ist wichtig. Wenn Ihr Anwendungsfall „Ich möchte eine KI dazu bringen, etwas zu sagen, was sie nicht sollte” ist, ist das nicht das, wofür dieses Modul gebaut wurde, und die Projektdokumentation sagt das direkt.

Modellzugang über OpenRouter

Welche Modelle verfügbar sind

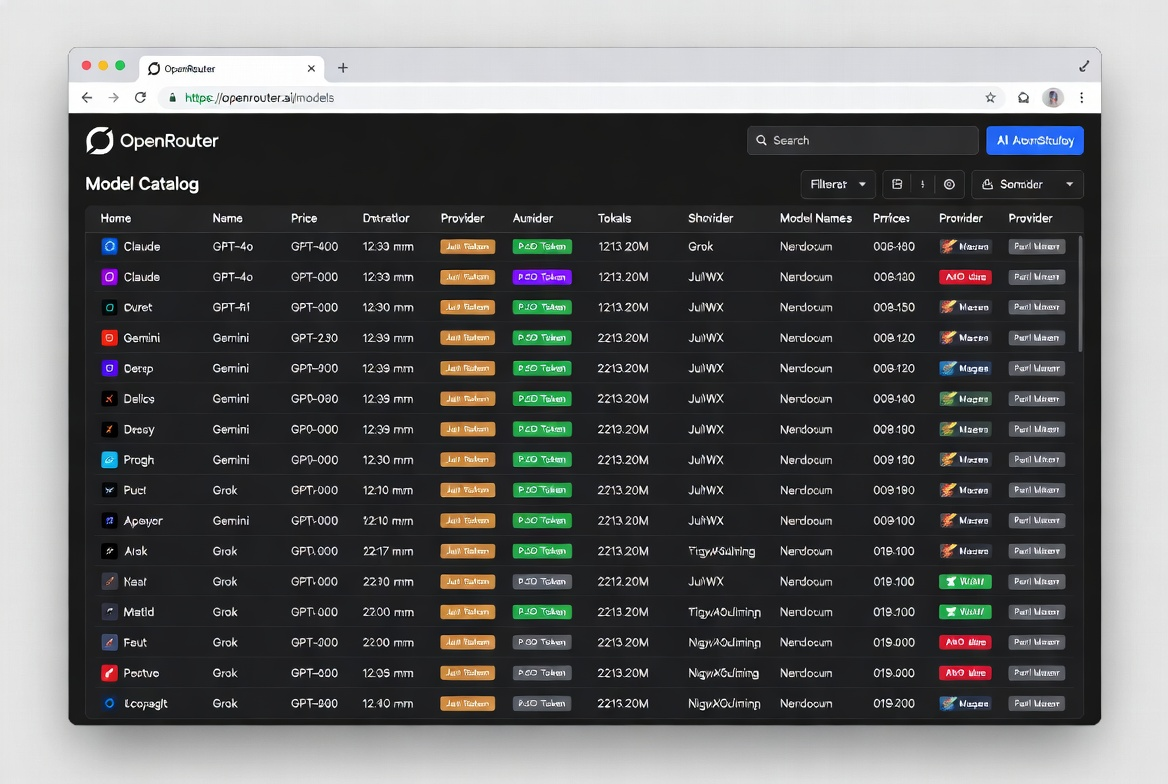

Über OpenRouter kann godmod3 auf Claude, GPT-4o, Gemini, Grok, Mistral, Llama, DeepSeek, Qwen und Dutzende mehr zugreifen. Der OpenRouter-Modellkatalog listet Stand April 2026 300+ Optionen von 60+ Anbietern auf. Nicht alle sind für jede Aufgabe nützlich, aber die Breite bedeutet, dass Sie kaum an eine „Modell nicht verfügbar”-Wand stoßen werden.

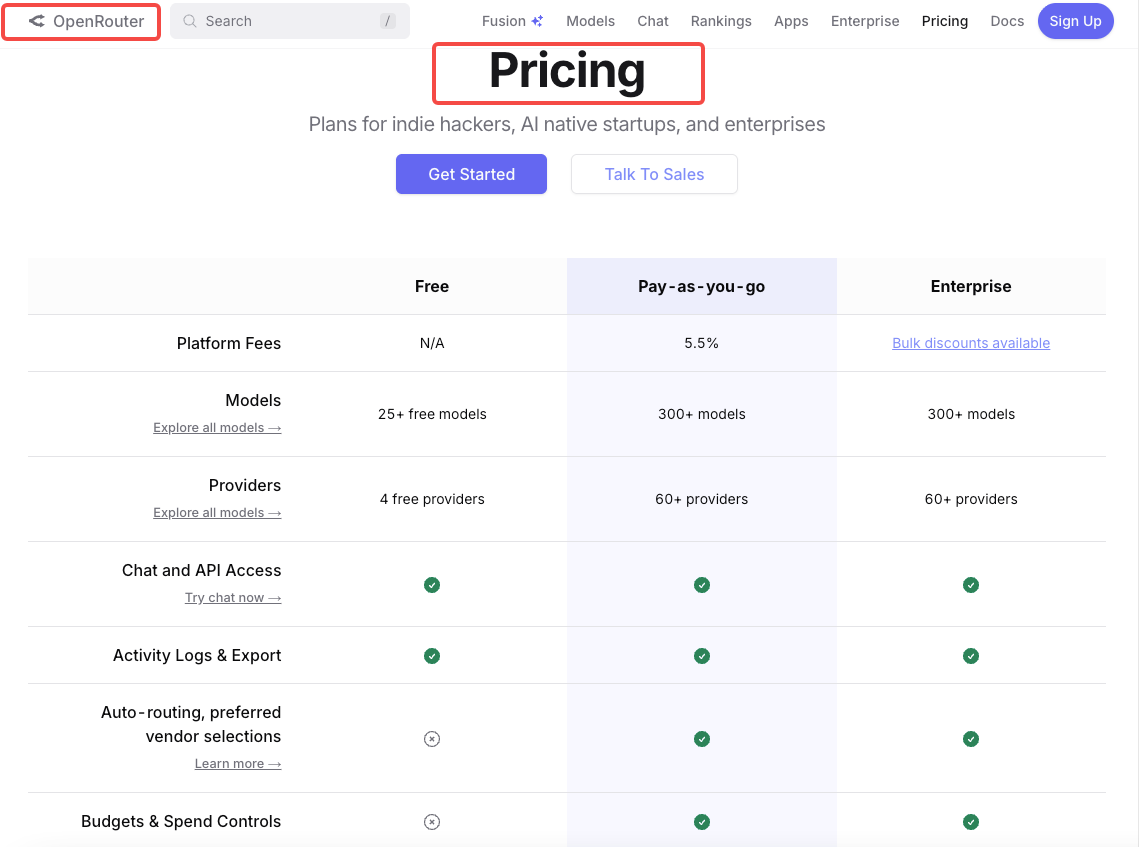

Preisrealität: Sie zahlen OpenRouter pro Token, nicht godmod3

Godmod3 selbst ist kostenlos. Ihre Kosten kommen von OpenRouters Pro-Token-Abrechnung, die die Preisgestaltung jedes Anbieters zum oder nahe am direkten API-Preis weitergibt. Einen Prompt durch ein Modell zu führen kostet dasselbe wie das direkte Aufrufen der API dieses Modells. Durch zehn Modelle zu führen kostet das Zehnfache.

Die OpenRouter-Preisseite schlüsselt Pro-Token-Raten nach Modell auf. Es gibt keine Monatsgebühr, keinen Mindestverbrauch. Sie fügen Guthaben hinzu, das sich bei Verwendung erschöpft.

Kostenlose Modelle auf OpenRouter, die Sie heute mit godmod3 verwenden können

OpenRouter pflegt eine Sammlung kostenloser Modelle — derzeit rund 29 Optionen einschließlich DeepSeek R1, Llama 3.3 70B, Qwen3 Coder und mehrere Gemma-Varianten. Kostenlose Modelle haben Ratenbegrenzungen (typischerweise 20 Anfragen pro Minute, 200 pro Tag), erfordern aber kein Guthaben.

Um zu testen, ob godmod3 in Ihren Workflow passt, bevor Sie Geld ausgeben, reicht die kostenlose Stufe, um sich eine Meinung zu bilden.

Was Godmod3 nicht ist

Kein Backend — Chat-Verlauf lebt nur in Ihrem Browser

Es gibt kein Konto, keine Cloud-Synchronisation, keinen serverseitigen Speicher. Löschen Sie Ihre Browserdaten und Ihre Gespräche verschwinden dauerhaft. Wechseln Sie das Gerät und nichts folgt Ihnen. Der private Browsing-Modus verwirft alles beim Schließen des Fensters.

Das ist ein Datenschutzmerkmal, keine Einschränkung — aber es bedeutet, dass godmod3 ein Notizbuch ist, keine Wissensdatenbank.

Kein Ersatz für Produktions-APIs

Wenn Sie ein Produkt aufbauen, das LLMs aufruft, benötigen Sie direkte API-Integration mit Wiederholungslogik, Fehlerbehandlung und Ratenbegrenzungsverwaltung. Godmod3 ist eine Forschungs- und Evaluierungsschnittstelle, keine Produktionsinfrastruktur. Die eigene Dokumentation des Projekts ist darin klar.

Kein Bypass-Tool — Parseltongues Zweck in der KI-Sicherheitsforschung

Es lohnt sich, es zu wiederholen: Parseltongue existiert zum Studium der Modellrobustheit unter kontrollierten Bedingungen. Das Projekt positioniert sich innerhalb der breiteren KI-Sicherheitsforschungslandschaft neben Frameworks wie Constitutional AI und RLHF. Es bietet Evaluierungswerkzeuge zur Inferenzzeit — keine Trainingszeit-Modifikationen. Das Dual-Use-Risiko wird in der Dokumentation anerkannt, und Benutzer sind für die Einhaltung des lokalen Rechts verantwortlich.

Wer den größten Nutzen aus Godmod3 zieht

Prompt-Ingenieure, die schnelle Multi-Modell-Vergleiche benötigen

Wenn Sie testen, wie ein Prompt über Claude, GPT-4o und Gemini hinweg funktioniert, bevor Sie sich für einen entscheiden, komprimiert godmod3 diesen Workflow von „drei Tabs, drei Logins, manueller Vergleich” zu „ein Prompt, ein Bildschirm, eingestufte Ergebnisse”. Das ist der Kernwert.

Entwickler, die evaluieren, welches LLM zu ihrem Anwendungsfall passt, bevor sie sich für eine API entscheiden

Bevor Sie eine API integrieren und um ihre Eigenheiten herum aufbauen, möchten Sie wissen: Bewältigt dieses Modell meinen Anwendungsfall gut? Dieselben Test-Prompts durch 5-10 Modelle parallel zu führen gibt Ihnen in Minuten, nicht Tagen, eine Vergleichsmatrix.

Forscher, die kontrollierte LLM-Verhaltensstudien durchführen

Die Kombination von AutoTune (Parametervariation), Parseltongue (Eingabe-Perturbation) und ULTRAPLINIAN (modellübergreifende Bewertung) schafft eine strukturierte Evaluierungspipeline. Für akademische oder Industrieforscher, die studieren, wie Modelle unter verschiedenen Bedingungen reagieren, ist dies ein fertiges Toolkit, das keine benutzerdefinierte Infrastruktur erfordert.

FAQ

Ist godmod3.ai dasselbe wie G0DM0D3 auf GitHub?

Ja. „Godmod3” und „G0DM0D3” beziehen sich auf dasselbe Projekt. Die gehostete Version auf godmod3.ai läuft mit derselben Codebasis wie das GitHub-Repository. Der Hauptunterschied ist, dass die gehostete Version nicht das Opt-in-Dataset-Sammlungsfeature enthält — das ist nur beim Selbst-Hosting mit dem vollständigen Docker-basierten API-Server verfügbar.

Muss ich bezahlen, um godmod3 zu nutzen?

Das Tool selbst ist kostenlos. Sie benötigen einen OpenRouter-API-Schlüssel, und OpenRouter berechnet pro Token bei Verwendung bezahlter Modelle. Sie können kostenlose Modelle auf OpenRouter ohne Kosten verwenden, vorbehaltlich der Ratenbegrenzungen. Kein Abonnement, keine Plattformgebühr von godmod3.

Ist mein API-Schlüssel auf godmod3.ai sicher?

Ihr OpenRouter-Schlüssel wird im localStorage Ihres Browsers gespeichert und direkt an OpenRouters API gesendet. Er berührt niemals einen godmod3-Server. Das heißt, Sie vertrauen darauf, dass der clientseitige Code ihn nicht exfiltriert — weshalb die Open-Source-Codebasis wichtig ist. Sie können sie selbst prüfen oder selbst hosten für volle Kontrolle.

Kann ich godmod3 ohne OpenRouter-Konto verwenden?

Nein. OpenRouter ist die Routing-Schicht für den gesamten Modellzugang. Sie benötigen ein OpenRouter-Konto und einen API-Schlüssel. Die Kontoerstellung ist kostenlos und erfordert keine Kreditkarte, wenn Sie nur kostenlose Modelle verwenden.

Was passiert mit meinem Chat-Verlauf, wenn ich den Browser schließe?

Er bleibt im localStorage, bis Sie die Browserdaten löschen. Aber es gibt kein Backup, keine Synchronisation, keine Wiederherstellung. Wenn Sie ein Gespräch aufbewahren müssen, kopieren Sie es manuell heraus, bevor Sie den Tab schließen.

Ich nutze godmod3 seit etwa zehn Tagen. Es hat meine direkten Claude- oder GPT-Abonnements nicht ersetzt — diese sind nach wie vor wichtig für lange Gesprächsworkflows, bei denen die Kontinuität des Kontexts zählt. Aber für die spezifische Aufgabe „Welches Modell bewältigt diesen Prompt am besten”, hat es meine Vergleichszeit von Minuten auf Sekunden reduziert.

Das ist alles, was ich bestätigen kann. Den Rest müssen Sie selbst verifizieren.

Vorherige Beiträge: