Seedance 2.0 per API nutzen: Async-Jobs, Wiederholungsversuche und Ergebnisverarbeitung

Produktionsmuster für Seedance 2.0 APIs: asynchroner Job-Lebenszyklus, Wiederholungsversuche, Idempotenz, Observability und Kostenschranken.

Möchten Sie kinematografische Videos wie Seedance 2.0 erstellen? Probieren Sie den WaveSpeed Cinematic Video Generator aus, um jetzt sofort Seedance 2.0-würdige kinematografische Videos zu erstellen.

Hallo zusammen. Dora ist da. Ich habe eine längere Aufgabe in der Seedance 2.0 API immer wieder angestupst und mich dabei ertappt, wie ich per Alt-Tab prüfte, ob sie fertig war. Nicht kaputt, nur nervig. Im Laufe einiger Tage habe ich eine Handvoll echter Jobs durchgeführt (Inhaltstransformationen und Batch-Extraktionen) und dabei besonders auf die Aspekte geachtet, die meinen Arbeitsalltag tatsächlich verändert haben.

Was folgt, sind die wenigen Muster, die die Arbeit gleichmäßiger gemacht haben: wie ich Aufgaben einreiche, verfolge und Ergebnisse abrufe; wie ich Eingaben packe; was ich wiederhole (und was nicht); und die grundlegenden Leitplanken, die mich davor bewahrt haben, über Schlüssel, Kosten und Protokolle zu stolpern. Wer bereits mit APIs jongliert, dem wird das bekannt vorkommen – und das ist so gewollt.

API-Job-Lebenszyklus (Einreichen → Status → Ergebnis)

Ich habe versucht, die Seedance 2.0 API in meinem Kopf einfach zu halten: drei Schritte – Einreichen, Status prüfen, Ergebnis abrufen. Als ich es tatsächlich so behandelte, sank die mentale Belastung.

Einreichen: Ich sende einen Job mit einem klaren, in sich geschlossenen Payload und einem clientseitig generierten Idempotenzschlüssel (dazu später mehr). Ich notiere mir in Codekommentaren, was ich als „fertig” betrachte. Keine philosophische Frage – nur die genaue Form des Erfolgs (z. B. JSON mit den Feldern X, Y, Z; eine passende Prüfsumme; keine Teillieferungen).

Status: Ich habe aufgehört, Status als eine einzige Sache zu betrachten. Ich unterteile ihn:

- In Bearbeitung (sicheres Polling)

- Blockiert (erfordert mein Eingreifen, meist ungültige Eingaben)

- Terminal (erfolgreich oder dauerhaft fehlgeschlagen)

Diese kleine Unterteilung hat verändert, wie ich prüfe. Wenn es in Bearbeitung ist, warte ich. Wenn es blockiert ist, korrigiere ich die Eingaben. Wenn es terminal ist, mache ich weiter. Ich überinterpretiere keine Zwischenzustände.

Ergebnis: Wenn ein Job abgeschlossen ist, hole ich die Ausgaben in einem Format ab, dem ich später vertrauen kann – meist JSON mit einem stabilen Schema und einem einfachen Inhalts-Hash. Wenn die API Webhooks unterstützt, behalte ich Polling trotzdem als Fallback. Webhooks sind großartig, bis eine Firewall-Regel oder ein Queue-Fehler einen verschluckt. Polling ist langweilig und zuverlässig.

Zwei kurze Praxisnotizen:

- Frühe Durchläufe sparten keine Zeit. Nach einigen Iterationen bemerkte ich, dass sie Aufmerksamkeit sparten. Weniger „Ist das schon fertig?”-Checks, mehr „Ich sehe es, wenn es wirklich fertig ist.”

- Ich vermeide es, Jobs innerhalb der API zu verketten, wenn ich es vermeiden kann. Ein Job, ein Ergebnis. Wenn ich Fan-out- oder Abhängigkeitslogik brauche, behalte ich das in meinem System. Das macht Fehlersuche und Wiederholungen sauberer.

Wer darauf aufbaut, dem hilft eine einfache Zustandsmaschine. Keine Dramatik – nur ein paar Enum-Zustände und klare Übergänge. Nicht ausgefallen, aber es schluckt Randfälle, ohne zur Spaghetti-Architektur zu werden.

Payload-Design (Text + Referenzverpackung)

Der größte Teil meiner Reibung kam von Payloads. Nicht Fehler, nur Abweichungen. Als ich die Struktur etwas anhob, klickte es.

Ich habe aufgehört, riesige Textblöcke inline zu senden, wenn ich es nicht musste. Stattdessen:

- Sende ich knappe Textanweisungen und Parameter inline.

- Übergebe ich große Artefakte (Dokumente, Medien, frühere Ausgaben) per Referenz – signierte URLs oder Objektschlüssel – mit versionierten Bezeichnern.

Diese Aufteilung machte Wiederholungen sicherer und reduzierte Upload-Overhead. Sie machte auch Protokolle sinnvoller: Ich konnte sehen, was sich zwischen Durchläufen geändert hatte, ohne durch Megabytes an Inhalt zu scrollen. Wenn die Seedance 2.0 API sowohl Text als auch Referenzen benötigt, halte ich sie unter einem einzigen „input”-Objekt mit klaren Namen. Mein zukünftiges Ich schätzt es, nicht nach verstreuten Feldern suchen zu müssen.

Eingaben vor dem Einreichen validieren

Bevor ich etwas sende, führe ich drei lokale Prüfungen durch:

- Form: Stimmt der Payload mit meinem eigenen Schema überein? Pflichtfelder vorhanden, Typen korrekt, Enums gültig. Ich verwende dafür einen JSON-Schema-Validator.

- Referenzen: Lösen URLs auf und erfüllen Größen-/Typregeln? Ich führe vorab HEAD-Anfragen durch und füge Content-Length und Prüfsumme bei, wenn verfügbar.

- Erwartungen: Sind die Parameter konsistent mit der Art des Jobs, den ich anfordere? Wenn ich „zusammenfassen” sage, übergebe ich nicht gleichzeitig „full_transcript=true”. Dumm, aber es passiert.

Diese Prüfungen lassen Fehler nicht verschwinden – sie verschieben sie an den günstigsten Ort zur Behebung: vor Netzwerkhops, vor Rate-Limits, bevor ich um Mitternacht Protokolle lese.

Zuverlässigkeitsmuster

Nach einer Woche regelmäßiger Nutzung kamen die meisten meiner Kopfschmerzen von Wiederholungen, über die ich nicht nachdenken konnte. Die Abhilfe waren einfache Muster, die ich einem Teammitglied in einem Satz erklären konnte.

Ich teile Fehler in zwei Haufen:

- Sicher wiederholbar (vorübergehende Netzwerkprobleme, 5xx, Timeouts vor Beginn der Serverarbeit)

- Nicht blind wiederholen (Validierungsfehler, Kontingent überschritten, unbekannte Zustände)

Sobald ich das getan hatte, fiel der Rest an seinen Platz.

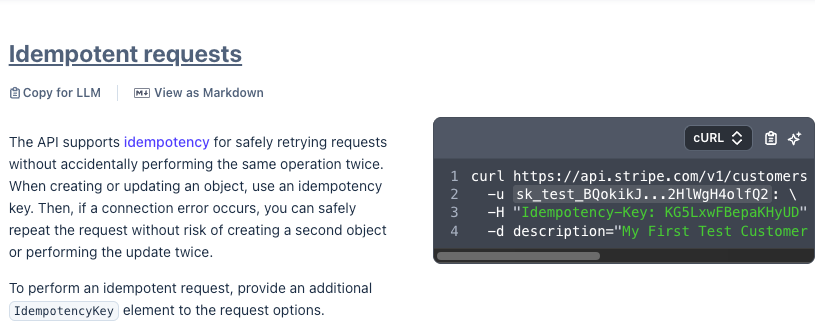

Idempotenzschlüssel + sichere Wiederholungen

Ich füge jedem Job-Einreichung einen eindeutigen Idempotenzschlüssel hinzu. Der Server sollte Wiederholungen mit demselben Schlüssel als dieselbe Anfrage behandeln. In der Praxis gehe ich davon aus, dass ich möglicherweise nicht weiß, ob eine Anfrage den Server erreicht hat. Deshalb mache ich Wiederholungen per Design sicher.

Was geholfen hat:

- Den Schlüssel aus stabilen Eingaben ableiten (z. B. eine UUID plus ein Hash des normalisierten Payloads), sodass versehentliche Duplikate absichtlich kollidieren.

- Den Schlüssel und den beabsichtigten Effekt mit kurzem TTL auf meiner Seite speichern. Wenn ich eine Antwort verliere, kann ich sicher wiederholen.

- Nicht-idempotente Operationen (wie „starten und abrechnen”) an der Client-Grenze als idempotent behandeln. Entweder erzwingt der Server dies, oder ich vermeide automatische Wiederholungen.

Wer ein solides mentales Modell möchte: Die Art, wie Payment-APIs damit umgehen, ist klar. Stripes Idempotenzschlüssel-Dokumentation ist prägnant und einen kurzen Blick wert, auch wenn man kein Geld bewegt.

Timeouts, Backoff und Wiederholungsobergrenzen

Ich halte drei Zahlen griffbereit: Request-Timeout, initialer Backoff und maximale Versuche.

Meine Standard-Konfiguration sieht so aus:

- Timeouts: konservativ, aber nicht knauserig. Lang genug für typische Serverarbeit, kurz genug, um Zombie-Sockets zu vermeiden. Wenn ein Job wirklich langläuft, bevorzuge ich einen schnellen Submit-Aufruf mit separatem Polling.

- Backoff: exponentiell mit Jitter. Jitter ist wichtig. Ohne ihn verhalten sich synchronisierte Wiederholungen wie ein kleiner DDoS.

- Obergrenzen: harte Limits für Gesamtwiederholungen und Gesamtlaufzeit pro Job. Nachdem ich eine Grenze erreicht habe, zeige ich einen benutzerfreundlichen Fehler an und höre auf. Kein stilles Thrashing.

In der Praxis haben sich diese Zahlen zweimal geändert: einmal nach dem ersten Tag (zu aggressiv), und einmal nachdem ich ein Muster kurzer Spitzen um die volle Stunde bemerkte (ich habe mehr Jitter hinzugefügt). Nichts Ausgefallenes. Es ließ das System einfach ruhiger wirken.

Beobachtbarkeit (Protokolle, Fehlerkategorien, Kostenüberwachung)

Ich jage kein vollständiges Tracing, es sei denn, ich brauche es. Für Seedance 2.0 API-Arbeit reichten drei Ansichten aus:

- Request-Protokolle mit Korrelations-IDs: Ich markiere jeden Submit-, Status- und Ergebnis-Aufruf mit derselben Korrelations-ID. Wenn etwas schiefläuft, kann ich einem Job von Anfang bis Ende folgen, ohne zu raten. OpenTelemetrys semantische Konventionen sind eine hilfreiche Orientierung, wenn man das von Grund auf neu einrichtet.

- Fehlerkategorien: Ich gruppiere Fehler nach Ursache (Validierung, Auth, Kontingent, Timeout, 5xx, Schema-Abweichung). Kategorien machen Trends sichtbar. Wenn „Kontingent” montags plötzlich beißt, plane ich darum herum, anstatt Brände zu bekämpfen.

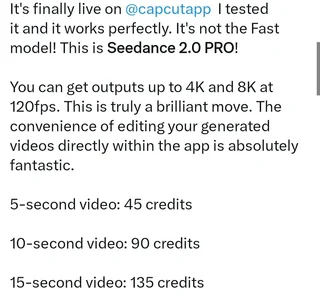

- Kostenübersicht: Ich protokolliere geschätzte Kosten pro Job – Eingaben, Ausgaben, Wiederholungen eingeschlossen – und fasse das wöchentlich zusammen. Es geht nicht um Präzision, sondern darum, die Tendenz zu spüren. Eine einfache Perzentilansicht (P50, P95) zeigt, ob einige Ausreißer still das Budget auffressen.

Eine kleine Anmerkung zu Alarmen: Ich halte sie langweilig. Kein Feuerwerk, nur Schwellenwerte, die zu Maßnahmen führen: „Fehlerkategorie > X für Y Minuten” oder „Kosten P95 steigt > Z% Woche für Woche.” Ich bemerke lieber spät als in falsch-positiven Alarmen zu leben. Die gesparte Energie zahlt sich anderswo aus.

Sicherheits- und Compliance-Grundlagen (Schlüssel, Umgang mit Nutzerinhalten)

Nichts Ausgefallenes hier – und das ist gewissermaßen der Punkt. Die Grundlagen erledigen den Großteil der Arbeit.

- Schlüssel: Ich halte API-Schlüssel aus dem Code heraus und rotiere sie nach Plan. Schlüssel pro Umgebung, geringstmögliche Rechte wenn Scopes existieren, kein teamübergreifendes Teilen. Wenn die API kurzlebige Tokens unterstützt, verwende ich sie.

- Nutzerinhalte: Ich protokolliere keine rohen Nutzerdaten. Ich protokolliere Hashes, Größen und Referenzen. Wenn ich Proben zum Debuggen benötige, schwärze oder redaktiere ich zuerst – mit einem klaren Aufbewahrungstimer.

- Datenhandhabung: Ich markiere jeden Job mit einer Mandanten- oder Nutzer-ID und trage diese Markierung in Protokolle und Speicher. Banal, aber es verhindert, dass Zugriffskontrollen zur Folklore werden.

- Speicherung: Ergebnisse landen in einem Bucket oder einer Datenbank mit serverseitiger Verschlüsselung und engen ACLs. Audit-Trails sind hier wichtiger als Cleverness.

- Compliance-Haltung: Wenn ein Team SOC 2- oder DSGVO-Sicherheit benötigt, schreibe ich genau auf, was wohin geht, wer es sehen kann und wie lange. Keine Versprechen im Dunkeln. Im Zweifelsfall prüfe ich die Sicherheitsseite und Datenverarbeitungsbedingungen des Anbieters, anstatt zu raten.

Mein Test ist einfach: Könnte ich dieses Setup einem datenschutzbewussten Kollegen ohne Handwellenbewegungen erklären? Wenn nicht, habe ich es noch nicht genug vereinfacht.

Eine letzte Anmerkung

Ich kam auf der Suche nach Geschwindigkeit. Was ich bekam, war Gleichmäßigkeit. Die Seedance 2.0 API hat keine Schritte eliminiert – sie hat sie vorhersehbar gemacht. Das reichte, um die Arbeit leichter anfühlen zu lassen. Ich beobachte noch, wie sich die Kosten über einen Monat entwickeln und ob meine Kategorien unter neuen Job-Typen standhalten. Stille Fragen, aber gute. Was meinen Sie dazu?

Möchten Sie kinematografische Videos wie Seedance 2.0 erstellen? Probieren Sie den WaveSpeed Cinematic Video Generator aus, um jetzt sofort Seedance 2.0-würdige kinematografische Videos zu erstellen.