Bauen Sie eine KI-Kreativpipeline mit GLM-5 + WaveSpeed

Bauen Sie eine vollständige KI-Kreativpipeline: GLM-5 schreibt Prompts, WaveSpeed generiert Bilder und Videos – alles orchestriert über eine API.

Hallo, ich bin Dora. Ich sprang ständig zwischen Tools hin und her, nur um einen kurzen Produktclip fertigzustellen. Brief an einem Ort. Bilder an einem anderen. Video irgendwo anders. Notizen verstreut. Nichts davon war schwierig, aber es war… unruhig. Also versuchte ich etwas Einfacheres: einen gleichmäßigen, durchgängigen Weg, der mich von einem schlichten Brief zu einem fertigen Clip bringt – ohne ständiges Hin- und Herwechseln. Ich nenne es eine GLM-5 Creative-Pipeline. Ich habe sie über zwei Wochen getestet, an drei kurzen Konzepten und einigen losen Fragmenten aus Kundenprojekten. Sie ist nicht aufregend. Aber sie hat die Arbeit leichter anfühlen lassen.

Was wir bauen (End-to-End-Überblick)

Ich wollte einen einzigen Weg von einem kurzen Brief zu einem 6–10 Sekunden langen Video, mit Raum für kleine Iterationen, aber ohne Feature-Suche. Der Ablauf sieht so aus:

- Ich schreibe einen einfachen Brief (zwei oder drei Sätze). Tonalität, Thema, eventuelle Einschränkungen.

- GLM-5 verwandelt das in klare Szenenbeschreibungen.

- FLUX oder Seedream generiert Standbilder über WaveSpeed, um die Inferenz vorhersehbar zu halten.

- WAN 2.5 oder Seedance erzeugt Bewegung aus den genehmigten Standbildern.

- GLM-5 überprüft die Ergebnisse und schlägt präzise Anpassungen vor – keine Umschreibungen.

Ein paar Regeln, die ich mir selbst gesetzt habe:

- Prompts kurz und strukturiert halten. Ich verwende jedes Mal dieselben Felder: Motiv, Umgebung, Stil, Bewegungshinweise, Einschränkungen.

- Klein batchen. Maximal drei Konzepte pro Durchlauf. Das hielt meinen Kopf klar und erleichterte den Vergleich.

- Seeds einfrieren, wenn mir etwas gefällt. Variationen später, nicht zwischendurch.

In der Praxis reduzierte die Pipeline Klicks und Zweifel mehr als sie die reine Zeit reduzierte. Im dritten Durchlauf sparte ich etwa 15 Minuten gegenüber einem typischen 90-Minuten-Durchlauf vom Konzept zum Clip. Der größere Gewinn war mental: weniger Abzweigungen, weniger „Was wäre wenn ich X versuche”-Umwege. Das war es, worauf ich aus war.

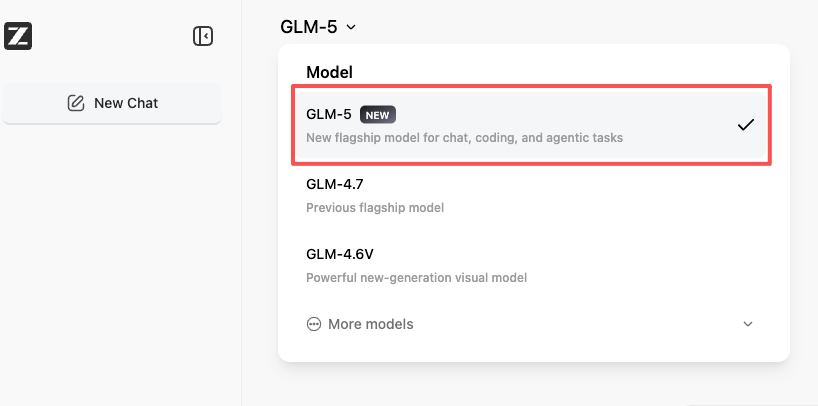

Schritt 1 — GLM-5 generiert Szenenbeschreibungen aus dem Brief

Ich begann mit einem winzigen Brief: „Warmes Morgenlicht auf einer Keramiktasse am Fenster. Weicher Dampf. Minimalistischer, ruhiger Stil. Für eine 9:16 Social Story. Markenfarben: gedämpfter Türkis-Akzent.”

GLM-5 zeichnet sich im kreativen Schreiben mit stilistischer Vielseitigkeit aus, laut der offiziellen Dokumentation von Zhipu AI. Was ich von GLM-5 brauchte, war keine Cleverness. Ich wollte Struktur: konsistente Szenenkarten, denen ein Renderer folgen konnte. Hier ist das Format, das ich angefordert habe und beibehalten habe:

- Szenenüberschrift

- Einstellungstyp (z. B. Medium Close-up)

- Komposition (Drittelregel, Hinweise zu negativem Raum)

- Beleuchtung

- Farbpalette

- Texturen/Materialien

- Bewegungshinweise (falls vorhanden)

- Harte Einschränkungen (keine Gesichter, kein Text im Bild, Ausgabeabmessungen)

Der erste Durchgang fühlte sich weitschweifig an. GLM-5 erklärte die Stimmung zu ausführlich. Ich steuerte nach: „Halte jedes Feld auf einen einzigen Satz. Verwende spezifische Substantive und Kamera-Fachbegriffe.” Das behob das meiste. Beim zweiten Durchlauf erhielt ich präzise Karten, die sich klar auf Bild-Prompts übertragen ließen.

Kleiner Gewinn: Ich bat GLM-5, „verbotene” Elemente hinzuzufügen, über die ich zuvor gestolpert war (zu viele Hände, zufällige Logos, Spiegelungen mit Gesichtern). Das reduzierte später den Aufwand beim Bereinigen. Nicht perfekt, aber weniger Überraschungen.

Dieser Teil sparte keine Zeit im Voraus: Er sparte Entscheidungsmüdigkeit später. Ich musste nicht zwischen fünf verschiedenen Prompt-Stilen raten. Ich hatte einen einzigen.

Schritt 2 — FLUX / Seedream generiert Bilder via WaveSpeed

Ich ließ sowohl FLUX als auch Seedream laufen, da sie unterschiedliche Charaktere haben. FLUX lieferte mir saubere, design-orientierte Standbilder. Seedream irrte etwas umher, fand aber manchmal wunderschöne Texturen in Keramik und Holz. Ich steuerte beide über WaveSpeed, um Schritte, Seeds und Scheduler zu standardisieren, ohne dutzende Flags manuell verwalten zu müssen.

Feldnotizen:

- WaveSpeeds Wiederholbarkeit war entscheidend. Wenn mir ein Frame gefiel, fror ich den Seed ein und passte nur Guidance und Steps an. Das hielt „glückliche Zufälle” reproduzierbar.

- Ich stellte das Seitenverhältnis von Anfang an auf die Zielausgabe (9:16) ein. Später zuschneiden ließ den Dampf immer seltsam aussehen.

- Ich hielt Prompts bei dem, was von GLM-5 kam. Keine poetischen Ausschmückungen. Nüchtern, aber das reduzierte merkwürdige Ränder.

Problemfelder: Hände und Fenster. Reflexionen erfinden gerne Menschen. Ich fügte „keine Figuren, keine Silhouetten, keine menschlichen Reflexionen” zu den Einschränkungen hinzu und erhöhte die negative Guidance leicht. Das reduzierte das Rauschen.

Die Laufzeit pro Standbild reichte von schnell bis „Kaffeepause holen”, je nach meiner Maschine. Ich generierte 8–12 Kandidaten pro Szene und schnitt hart auf 2 herunter. Wenn ich nicht schnell wählen konnte, bedeutete das, dass der Prompt nicht präzise genug war. Zurück zu GLM-5 mit einer kleinen Anpassung, statt weiter Bilder zu fischen.

Schritt 3 — WAN 2.5 / Seedance generiert Video aus Standbildern

Hier verliere ich normalerweise den Faden: zu viele Bewegungsoptionen. Ich beschränkte mich auf zwei Modi: leichtes Parallax und sanfte Kamerabewegung. WAN 2.5 handhabte Parallax überzeugend. Seedance schnitt besser bei Mikrobewegungen ab, wie Dampf und sanften Fokusverschiebungen.

Meine Übergabe-Checkliste vom Standbild zur Bewegung:

- Sauberes PNG in der Zielauflösung exportieren (1080x1920 für Tests).

- Einen präzisen Bewegungshinweis angeben (z. B. „2–3° Dolly-in, Tassenhenkel im Drittel halten, schleifenfreundlicher Dampfzug”).

- Dauer auf 6–8 Sekunden begrenzen. Längere Clips wurden matschig und lenkten die Aufmerksamkeit auf Modell-Artefakte.

Überraschungen:

- Texturflimmern. Körnige Glasuren sehen als Standbilder toll aus und werden in Bewegung unruhig. Ich reduzierte die Texturintensität in Schritt 2, wenn ich wusste, dass ich animieren würde.

- Randverzerrungen in den Ecken. Zentrierte Kompositionen hielten besser stand. Außermittige Tassen bogen sich wie Gummi.

Die besten Durchläufe fühlten sich unsichtbar an. Wenn es funktionierte, hörte ich auf, über das Modell nachzudenken, und schaute einfach zu, wie das Licht atmete. Wenn es nicht funktionierte, fiel es schnell auseinander – meist weil ich zu viel Bewegung verlangt hatte.

Schritt 4 — GLM-5 überprüft Ergebnisse und schlägt Iterationen vor

Ich holte GLM-5 als ruhigen zweiten Blick zurück. Ich bat es:

- Fertige Clips mit dem ursprünglichen Brief zu vergleichen.

- Abweichungen zu kennzeichnen (Palette, Stimmung, Einschränkungen).

- Pro Clip eine kleine Änderung vorzuschlagen – nicht fünf.

Das war hilfreicher als erwartet. GLM-5 erkannte konsistent Farbabweichungen. In einem Durchlauf bemerkte es, dass der Türkis-Akzent kalt wirkte gegen das warme Licht: Eine subtile Farbtonverschiebung im Hintergrund behob es.

Manchmal griff es aber auch zu weit, indem es neue Requisiten oder Text-Overlays vorschlug. Ich steuerte dagegen mit einer Regel: „Keine neuen Substantive. Nur Beleuchtung, Farbe oder Bewegungsintensität anpassen.” Das hielt die Iterationen geerdet.

Die Schleife hier war kurz: ein Durchlauf Notizen, ein Durchlauf Korrekturen. Wenn ich immer noch nicht zufrieden war, legte ich das Konzept beiseite, statt es zu zerdenken. Diese Zurückhaltung hielt die Pipeline schlank.

Vollständiger Code (Python, WaveSpeed SDK)

Ich hielt die Orchestrierung einfach. Ein Python-Skript verbindet die Schritte mit einigen kleinen Hilfsfunktionen:

- Eine

Brief-Klasse, die Motiv, Umgebung, Stil, Bewegung und Einschränkungen speichert. - Ein

glm5()-Helfer, der den Prompt formatiert und Szenenkarten in Dicts parst. - Ein

images()-Helfer, der WaveSpeed mit entweder FLUX oder Seedream aufruft und Seeds, Steps und negative Prompts übergibt. - Ein

video()-Helfer, der Standbilder mit Bewegungshinweisen an WAN 2.5 oder Seedance übergibt. - Ein

review()-Helfer, der Thumbnails oder kurze GIFs zur Prüfung zurück an GLM-5 gibt.

Zwei Details hielten es stabil:

- Ich schrieb Ergebnisse mit deterministischen Pfaden auf die Festplatte:

run_id/scene_01/flux_seed1234.png. Das machte Rückverfolgung einfach. - Ich protokollierte Parameter neben den Ausgaben in einer kleinen YAML-Datei. Wenn ein Clip gut aussah, wusste ich genau warum.

Ich verzichte hier auf Code, um keinen Paste-Friedhof zu erzeugen. Die obige Struktur reicht aus, um es mit dem eigenen Stack nachzubauen. Wenn du WaveSpeed bereits verwendest, geht es hauptsächlich darum, zu entscheiden, wo Zufälligkeit eingefroren und wo Drift erlaubt wird.

Kostenschätzung für 10 Assets

Kosten variieren stark je nach Anbieter und Modelleinstellungen – nimm dies als praktischen Richtwert aus meinen Tests, nicht als Versprechen. Zehn Assets bedeuten hier 10 kurze vertikale Clips (jeweils eine Szene), mit 8–12 Standbild-Kandidaten pro Szene.

- GLM-5 Prompting und Review: gering. GLM-5 API-Preise liegen bei $1,00/M Input und $3,20/M Output, deutlich günstiger als Claude Opus 4.6 ($5/M Input, $25/M Output). Bei meinen Durchläufen nutzte jedes Asset ~2–3 kurze Interaktionen plus eine Review. Bei nutzungsbasierter Abrechnung liegt das meist im niedrigen Dollar-Bereich für 10 Assets.

- Bildgenerierung: der Hauptschwankungsfaktor. Bei mittleren Steps mit 8–12 Kandidaten pro Szene lagen die Kosten bei Pay-per-Inference-Plänen im mittleren bis hohen einstelligen Bereich pro Asset. Weniger, wenn du auf eigenem GPU batchst.

- Videogenerierung: ebenfalls variabel. Einfache Parallax-Clips kosten weniger; physikbasierte Bewegung kostet mehr. In meinen Notizen kam das pro Asset ähnlich wie Standbilder heraus, manchmal etwas höher.

Grobe Gesamtschätzung für 10 Assets, gemischte Modelle, konservative Einstellungen: niedriger dreistelliger Bereich bei vollständigem Cloud-Betrieb mit großzügiger Variation, deutlich weniger, wenn du die Bildschritte selbst hostest und nur für Bewegung zahlst. Bei striktem Vorgehen – 6 statt 12 Kandidaten, ein Bewegungsdurchlauf – lässt sich das um ein Drittel reduzieren. Wer Variationen jagt, verdoppelt es schnell. Seeds und kleine Iterationsregeln helfen, die Rechnung zu zähmen.

Erweiterungen: LoRAs, Upscaling, Batch-Verarbeitung

Sobald die Basis stabil wirkte, probierte ich einige Erweiterungen.

- LoRAs für Marken-Textur: Ich trainierte ein kleines Akzentpaket für Keramikglasur und Hintergrundpapier. Das half, Materialien szenenübergreifend konsistent zu halten. Der Trick war ein bescheidenes Gewicht. Zu starke LoRAs zogen alles in denselben Look.

- Sanftes Upscaling: Ich skaliere nur nach der Bewegung hoch, nicht davor. Pre-Upscale verstärkte Artefakte. Post-Upscale mit einem leichten, detailerhaltenden Modell hielt Kanten sauber, ohne Poren auf einer Tasse zu erfinden.

- Batch-Verarbeitung: Ich fügte eine Queue hinzu, in der sich jedes Konzept als Einheit bewegt. Kein Vermischen von Schritten aus verschiedenen Briefs. Das klingt strikt, aber es bewahrte mich vor der „nur noch ein Versuch”-Spirale.

Einige Dinge, die ich nicht beibehielt:

- Auto-Untertitelung innerhalb der Pipeline. Es zog die Visuals in Richtung „Content” statt Bilder-die-sich-bewegen. Untertitel mache ich außerhalb, näher an der Veröffentlichung.

- Aggressives Stil-Mixing. Es sah gut in einem Grid aus und wirkte müde in Bewegung.

Für wen das passt: Macher, die vorhersehbare Wege und kleine, stetige Gewinne mögen. Wen es nicht begeistern wird: Menschen, die Spektakel oder hochvariante Kunst anstreben. Das ist in Ordnung.

Ich wollte die GLM-5 Creative-Pipeline ruhiger machen, nicht schlauer. An guten Tagen fühlt es sich so an: eine Tasse, etwas Licht und weniger offene Tabs als sonst. Ich nehme das.